人臉識別:insightface自定義數(shù)據(jù)集制作 | 附練手數(shù)據(jù)集

點擊上方“小白學視覺”,選擇加"星標"或“置頂”

重磅干貨,第一時間送達

轉(zhuǎn)自|小白玩轉(zhuǎn)python

01

簡單來講,人臉識別這個問題,就是給定兩個人臉,然后判定他們是不是同一個人,這是它最原始的定義。它有很多應(yīng)用場景,比如銀行柜臺、海關(guān)、手機解鎖、酒店入住、網(wǎng)吧認證,會查身份證跟你是不是同一個人。

關(guān)于人臉識別的內(nèi)容,網(wǎng)上資料很多,這里推薦一篇綜述,詳細介紹了一些人臉識別的背景和目前的相關(guān)研究,以及常用的人臉識別模型:

http://www.elecfans.com/d/709424.html

好了,直接進入主題,今天的重點:

insightface論文:https://arxiv.org/abs/1801.07698

insightface github項目:https://github.com/deepinsight/insightface

02

一、環(huán)境配置

官方提供的項目是基于mxnet框架的

因此首先需要配置好這些環(huán)境,這里假設(shè)已經(jīng)安裝好cuda等

mxnet的安裝相對來說比較簡單(相對于caffe)

(1)查詢自己cuda的版本

# 輸入nvcc -V# 輸出結(jié)果nvcc: NVIDIA (R) Cuda compiler driverCopyright (c) 2005-2017 NVIDIA CorporationBuilt on Fri_Sep__1_21:08:03_CDT_2017Cuda?compilation?tools,?release?9.0,?V9.0.176

(2)用pip安裝mxnet(GPU版本)

pip?install?mxnet-cu90# 根據(jù)自身情況查詢對應(yīng)的安裝命令,例如我服務(wù)器的cuda版本是10.0的,安裝命令為 pip install mxnet-cu100二、克隆項目和數(shù)據(jù)集下載

將insight項目克隆到本地

git clone --recursive https://github.com/deepinsight/insightface.git下載lfw數(shù)據(jù)集

鏈接:http://vis-www.cs.umass.edu/lfw/index.html#download

這里為了方便,提供了lfw的部分用于練手

練手數(shù)據(jù)集https://www.lanzous.com/i7gdxva,僅用于制作數(shù)據(jù)集練手

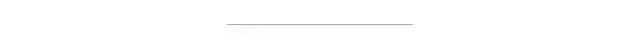

觀察數(shù)據(jù)集:

這里提供了20個用于練手,完整數(shù)據(jù)集可以去上面的鏈接或自行查找下載。

說明:每個文件夾名為人的姓名,文件夾內(nèi)包含多張人臉(>=1)。

三、開始制作所需要格式的數(shù)據(jù)集

(1)數(shù)據(jù)對齊并生成lst文件

將lfw數(shù)據(jù)集下載好并放置在datasets下(這里以lfwdata命名的文件夾),然后新建一個文件夾并命名為output保存對齊后的人臉圖片,新建一個文件夾命名為train用于保存輸出結(jié)果

運行insightface項目下 src/align下的align_lfw.py文件

python align_lfw.py --input-dir ../../datasets/lfwdata --output-dir ../../datasets/output--input :輸入需要對齊的數(shù)據(jù)的路徑

--output:輸出對齊后的數(shù)據(jù)保存路徑

對齊后的圖片

遇到問題1:

ValueError: Object arrays cannot be loaded when allow_pickle=False

解決方案:

pip3 install numpy==1.16.1?

如果已安裝了多個numpy版本,需要先將其卸載后在運行

遇到問題2:

AttributeError: module 'scipy.misc' has no attribute 'imread'

解決方案:

pip install scipy==1.1.0

如果成功運行,output文件夾下會產(chǎn)生對齊后的人臉以及一個lst文件(將lst文件改名為 train.lst,并移動到train文件下)

終端下,移動和重命名的操作

# 重命名 mv [原始文件名] [改變后的文件名]mv lst train.lst# 移動 mv [起始文件路徑] [目標文件路徑]mv train.lst ../train/

觀察生成的 lst 文件內(nèi)容:

1 ../../datasets/train/Abbas_Kiarostami/Abbas_Kiarostami_0001.jpg 01 ../../datasets/train/Abdel_Aziz_Al-Hakim/Abdel_Aziz_Al-Hakim_0001.jpg 1# 其中1代表對齊,最后的數(shù)字0,1代表class label 中間是地址;需要用\t表示tab鍵,不能用空格間隔。

(2)創(chuàng)建property配置文件

在datasets/train下創(chuàng)建property,沒有后綴

寫入下面內(nèi)容,含義1000,112,112代表ID數(shù)量,尺寸,尺寸

1000,112,112(3)生成rec&idx文件(依托于lst文件)

運行src/data face2rec2.py

python face2rec2.py ../../datasets/train/運行可能會報錯,需要修改,可能原因是源代碼是基于python2的

在python3下運行,修改第105行成如下所示:

s = mx.recordio.pack(header, b'')運行成功后會出現(xiàn)兩個文件

train.idx和train.rec將train.idx, train.rec是放置在train文件夾中,用于后續(xù)訓練使用,不然后續(xù)創(chuàng)建pair會報錯

(4)創(chuàng)建pair文件

為了做測試我們需要生成驗證集用的bin文件,bin文件生成前需要做pair文件,就是一對一對的數(shù)據(jù),每一行分別是

圖A的目錄 空格 圖B的目錄 空格 標志0/1(代表兩張圖類別一致否)在src/data下新建一個代碼generate_image_pairs.py用于生成pairs

代碼來源:https://blog.csdn.net/CLOUD_J/article/details/100672392

# coding:utf-8import sysimport osimport randomimport timeimport itertoolsimport pdbimport argparse#src = '../../datasets/lfw2'#dst = open('../../datasets/lfw/train.txt', 'a')parser = argparse.ArgumentParser(description='generate image pairs')# generalparser.add_argument('--data-dir', default='', help='')parser.add_argument('--outputtxt', default='', help='path to save.')parser.add_argument('--num-samepairs',default=100)args = parser.parse_args()cnt = 0same_list = []diff_list = []list1 = []list2 = []folders_1 = os.listdir(args.data_dir)dst = open(args.outputtxt, 'a')count = 0dst.writelines('\n')# 產(chǎn)生相同的圖像對for folder in folders_1:sublist = []same_list = []imgs = os.listdir(os.path.join(args.data_dir, folder))for img in imgs:img_root_path = os.path.join(args.data_dir, folder, img)sublist.append(img_root_path)list1.append(img_root_path)for item in itertools.combinations(sublist, 2):for name in item:same_list.append(name)if len(same_list) > 10 and len(same_list) < 13:for j in range(0, len(same_list), 2):if count < int(args.num_samepairs):#數(shù)量可以修改dst.writelines(same_list[j] + ' ' + same_list[j+1]+ ' ' + '1' + '\n')count += 1if count >= int(args.num_samepairs):breaklist2 = list1.copy()# 產(chǎn)生不同的圖像對diff = 0print(count)# 如果不同的圖像對遠遠小于相同的圖像對,則繼續(xù)重復(fù)產(chǎn)生,直到兩者相差很小while True:random.seed(time.time() * 100000 % 10000)random.shuffle(list2)for p in range(0, len(list2) - 1, 2):if list2[p] != list2[p + 1]:dst.writelines(list2[p] + ' ' + list2[p + 1] + ' ' + '0'+ '\n')diff += 1if diff >= count:break#print(diff)if diff < count:#print('--')continueelse:break

運行g(shù)enerate_image_pairs.py

python3 generate_image_pairs.py --data-dir ../../datasets/output --outputtxt ../../datasets/train/train.txt --num-samepairs 5--data-dir 后接對齊后的人臉

--outputtxt 用于保存train.txt文件

--num-samepairs ?生成多少對(具體如何設(shè)置,還需要好好研究一下)

運行成功后在datasets/train下會生成一個train.txt文件

內(nèi)容:

../../datasets/output/Abdullah/Abdullah_0002.jpg ../../datasets/output/Abdullah/Abdullah_0004.jpg 1# 前面兩個分布是生成的pairs的路徑,后面的0/1代表是否同一個人或類

(5)生成驗證集bin文件

成功后利用/src/data/下的 lfw2pack.py生成bin文件

但是存在點問題,對lfw2pack.py進行稍微的修改,修改lfw2pack.py中19行,打#的為更改的,改為兩個參數(shù),一個是txt讀出來的列表,另一個是總數(shù)量。

import mxnet as mxfrom mxnet import ndarray as ndimport argparseimport pickleimport sysimport ossys.path.append(os.path.join(os.path.dirname(__file__), '..', 'eval'))import lfwparser = argparse.ArgumentParser(description='Package LFW images')# generalparser.add_argument('--data-dir', default='', help='')# 修改1:圖像大小修改為112,112parser.add_argument('--image-size', type=str, default='112,112', help='')parser.add_argument('--output', default='', help='path to save.')# 修改2:添加解析參數(shù)parser.add_argument('--num-samepairs',default=100)args = parser.parse_args()lfw_dir = args.data_dirimage_size = [int(x) for x in args.image_size.split(',')]# 修改3:將文件名pairs.txt修改成train.txtlfw_pairs = lfw.read_pairs(os.path.join(lfw_dir, 'train.txt'))print(lfw_pairs)# 修改4:下一行進行修改成需要的格式# lfw_paths, issame_list = lfw.get_paths(lfw_dir, lfw_pairs, 'jpg')lfw_paths, issame_list = lfw.get_paths(lfw_pairs,int(args.num_samepairs)+1)#, 'jpg')lfw_bins = []#lfw_data = nd.empty((len(lfw_paths), 3, image_size[0], image_size[1]))print(len(issame_list))i = 0for path in lfw_paths:with open(path, 'rb') as fin:_bin = fin.read()lfw_bins.append(_bin)#img = mx.image.imdecode(_bin)#img = nd.transpose(img, axes=(2, 0, 1))#lfw_data[i][:] = imgi+=1if i%1000==0:print('loading lfw', i)with open(args.output, 'wb') as f:pickle.dump((lfw_bins, issame_list), f, protocol=pickle.HIGHEST_PROTOCOL)

對應(yīng)的get_paths這個文件存在src/eval/lfw.py下,把它也改了

def get_paths(pairs, same_pairs):nrof_skipped_pairs = 0path_list = []issame_list = []cnt = 1for pair in pairs:path0 = pair[0]path1 = pair[1]if cnt < same_pairs:issame = Trueelse:issame = Falseif os.path.exists(path0) and os.path.exists(path1): # Only add the pair if both paths existpath_list += (path0,path1)issame_list.append(issame)else:print('not exists', path0, path1)nrof_skipped_pairs += 1cnt += 1if nrof_skipped_pairs>0:print('Skipped %d image pairs' % nrof_skipped_pairs)return path_list, issame_list

vim中多行注釋方法:

多行注釋:1. 進入命令行模式,按ctrl + v進入 visual block模式,然后按j, 或者k選中多行,把需要注釋的行標記起來2. 按大寫字母I,再插入注釋符,例如 #3. 按esc鍵就會全部注釋了取消多行注釋:1. 進入命令行模式,按ctrl + v進入 visual block模式,按字母l橫向選中列的個數(shù),例如 # 需要選中2列2. 按字母j,或者k選中注釋符號3. 按d鍵就可全部取消注釋

之后再運行

python3 lfw2pack.py --data-dir ../../datasets/train --output ../../datasets/train/lfw.bin --num-samepairs 2注意:我這里報錯了(沒有報錯的小伙伴可以忽略)

path0 = pair[0]IndexError: list index out of range

仔細分析之后,是因為在train.txt中存在空白行導致,直接刪除即可,如果沒有報錯可以直接忽略

至此,我們已經(jīng)完成了數(shù)據(jù)集的制作,后續(xù)會更新如何訓練,以及使用。

這部分內(nèi)容,是本人摸索了很久才搞定的,本文盡可能的寫的詳細,希望能幫到大家,寫這篇的時候又重新操作了一遍,如果可以懇請小伙伴們能點個“在看”或分享到朋友圈。謝謝啦!

參考鏈接: https://blog.csdn.net/CLOUD_J/article/details/100672392

https://blog.csdn.net/hanjiangxue_wei/article/details/86566497

交流群

歡迎加入公眾號讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動駕駛、計算攝影、檢測、分割、識別、醫(yī)學影像、GAN、算法競賽等微信群(以后會逐漸細分),請掃描下面微信號加群,備注:”昵稱+學校/公司+研究方向“,例如:”張三?+?上海交大?+?視覺SLAM“。請按照格式備注,否則不予通過。添加成功后會根據(jù)研究方向邀請進入相關(guān)微信群。請勿在群內(nèi)發(fā)送廣告,否則會請出群,謝謝理解~