DeepMind最新研究:AI擊敗了人類,設(shè)計(jì)了更好的經(jīng)濟(jì)機(jī)制

大數(shù)據(jù)文摘授權(quán)轉(zhuǎn)載自學(xué)術(shù)頭條

“人類面臨的許多問(wèn)題并不僅僅是技術(shù)問(wèn)題,還需要我們?yōu)榱烁蟮睦嬖谏鐣?huì)和經(jīng)濟(jì)中進(jìn)行協(xié)調(diào)。”“要想人工智能技術(shù)能夠提供幫助,它需要直接學(xué)習(xí)人類的價(jià)值觀。”

——DeepMind 研究科學(xué)家 Raphael Koster

人工智能(AI),能否推動(dòng)人類社會(huì)進(jìn)入真正的智能化時(shí)代?

盡管經(jīng)過(guò) 60 多年的發(fā)展,人工智能行業(yè)已經(jīng)取得了突破性的進(jìn)展,且被廣泛應(yīng)用在經(jīng)濟(jì)社會(huì)的方方面面,但構(gòu)建與人類價(jià)值觀一致的人工智能系統(tǒng),仍然是一個(gè)尚未解決的問(wèn)題。

如今,一項(xiàng)來(lái)自英國(guó)人工智能公司 DeepMind 的最新研究,或許能為人工智能行業(yè)從業(yè)者解決這一問(wèn)題提供一個(gè)全新的思路。

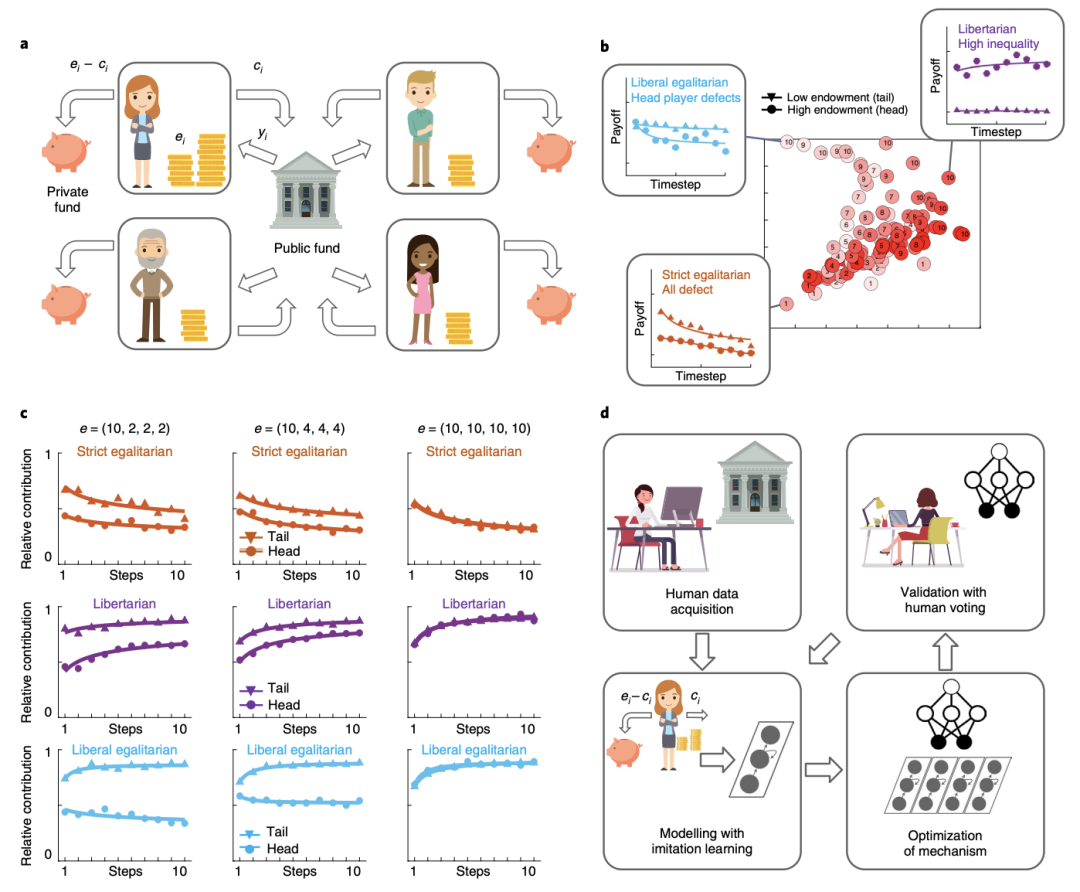

據(jù)介紹,DeepMind 的人工智能系統(tǒng)在一個(gè) 4 人在線經(jīng)濟(jì)游戲中,通過(guò)向 4000 多人學(xué)習(xí)以及在計(jì)算機(jī)模擬中學(xué)習(xí),不僅學(xué)會(huì)了制定如何重新分配公共資金的政策,而且表現(xiàn)十分優(yōu)異,戰(zhàn)勝了其他人類玩家。

該游戲涉及玩家決定是保留一筆貨幣捐贈(zèng),還是與其他人分享,以實(shí)現(xiàn)集體利益。

相關(guān)研究論文以“Human-centred mechanism design with Democratic AI”為題,于 7 月 5 日在線發(fā)表在權(quán)威科學(xué)期刊 Nature Human Behaviour 上。

(來(lái)源:Nature Human Behaviour)

(來(lái)源:Nature Human Behaviour)她還表示,民主不僅僅是讓你最喜歡的政策得到最好的執(zhí)行——它是創(chuàng)造一個(gè)過(guò)程,公民可以在這個(gè)過(guò)程中平等地相互接觸和商議(事情)。

由 AI 設(shè)計(jì)經(jīng)濟(jì)機(jī)制

如今,機(jī)器學(xué)習(xí)系統(tǒng)已經(jīng)解決了生物醫(yī)學(xué)的主要問(wèn)題,并幫助人類應(yīng)對(duì)環(huán)境挑戰(zhàn)。然而,人工智能在幫助人類設(shè)計(jì)公平和繁榮社會(huì)方面的應(yīng)用還有待開發(fā)。

在經(jīng)濟(jì)學(xué)和博弈論中,被稱為機(jī)制設(shè)計(jì)的領(lǐng)域研究如何最優(yōu)地控制財(cái)富、信息或權(quán)力在受到激勵(lì)的行為者之間的流動(dòng),以實(shí)現(xiàn)預(yù)期目標(biāo)。

在此工作中,研究團(tuán)隊(duì)試圖證明:深度強(qiáng)化學(xué)習(xí)(RL)代理可以用來(lái)設(shè)計(jì)一種經(jīng)濟(jì)機(jī)制,這種經(jīng)濟(jì)機(jī)制能夠得到被激勵(lì)人群的偏好。

在這個(gè)游戲中,玩家一開始擁有不同數(shù)量的錢,必須決定貢獻(xiàn)多少來(lái)幫助更好地發(fā)展一個(gè)公共基金池,并最終獲得一部分作為回報(bào),且會(huì)涉及反復(fù)決定是保留一筆貨幣捐贈(zèng),還是與其他玩家分享,以獲得潛在的集體利益。

研究團(tuán)隊(duì)訓(xùn)練了一個(gè)深度強(qiáng)化學(xué)習(xí)代理,來(lái)設(shè)計(jì)一個(gè)重新分配機(jī)制,即在財(cái)富平等和不平等的情況下將資金分享給玩家。

共享收益通過(guò)兩種不同的再分配機(jī)制返還給玩家,一種是由該人工智能系統(tǒng)設(shè)計(jì)的,另一種是由人類設(shè)計(jì)的。

圖|游戲設(shè)計(jì)(來(lái)源:Nature Human Behaviour)

圖|游戲設(shè)計(jì)(來(lái)源:Nature Human Behaviour)相比于“平等主義”方法(不管每個(gè)玩家貢獻(xiàn)多少都平均分配資金)和“自由主義”方法(根據(jù)每個(gè)玩家的貢獻(xiàn)占公共資金的比例分配資金),該政策從人類玩家手上贏得了更多的選票。

同時(shí),該政策也糾正了最初的財(cái)富失衡,制止了玩家的“搭便車”行為,除非玩家貢獻(xiàn)出大約一半的啟動(dòng)資金,否則他們幾乎不會(huì)得到任何回報(bào)。

但是,研究團(tuán)隊(duì)也警告道,他們的研究成果并不代表“人工智能治理”(AI government)的配方(recipe),他們也不打算為政策制定專門構(gòu)建一些由人工智能驅(qū)動(dòng)的工具。

值得信任嗎?

在此次工作中,研究團(tuán)隊(duì)使用人工智能技術(shù)來(lái)從頭學(xué)習(xí)重新分配方案,這種方法減輕了人工智能研究人員——他們自己可能有偏見或不代表更廣泛的人群——選擇一個(gè)領(lǐng)域特定目標(biāo)進(jìn)行優(yōu)化的負(fù)擔(dān)。

這一研究工作也提出了幾個(gè)問(wèn)題,其中一些在理論上具有挑戰(zhàn)性。例如,有人可能會(huì)問(wèn),把強(qiáng)調(diào)民主目標(biāo)作為一種價(jià)值校準(zhǔn)的方法是否是個(gè)好主意。該人工智能系統(tǒng)可能繼承了其他民主方法的一種傾向,即“以犧牲少數(shù)人為代價(jià)賦予多數(shù)人權(quán)利”。考慮到人們迫切擔(dān)心人工智能的部署方式可能會(huì)加劇社會(huì)中現(xiàn)有的偏見、歧視或不公平,這一點(diǎn)尤為重要。

此外,如果是口頭向玩家解釋這些機(jī)制,而不是通過(guò)經(jīng)驗(yàn)學(xué)習(xí),他們的反應(yīng)是否會(huì)有所不同。大量文獻(xiàn)表明,當(dāng)機(jī)制是“根據(jù)描述”而不是“根據(jù)經(jīng)驗(yàn)”時(shí),人們的行為有時(shí)會(huì)有所不同,特別是對(duì)于冒險(xiǎn)的選擇。然而,人工智能設(shè)計(jì)的機(jī)制可能并不總是可以用語(yǔ)言表達(dá)的,在這種情況下觀察到的行為似乎可能完全取決于研究團(tuán)隊(duì)所采用的描述的選擇。

在論文的最后,研究團(tuán)隊(duì)還強(qiáng)調(diào),這一研究結(jié)果并表示他們支持某種形式的“人工智能治理”,即自主代理在沒(méi)有人工干預(yù)的情況下做出政策決定。

他們希望,該方法的進(jìn)一步開發(fā)將提供有助于以真正符合人類的方式解決現(xiàn)實(shí)世界問(wèn)題的工具。

參考鏈接:

https://www.nature.com/articles/s41562-022-01383-x

https://www.deepmind.com/publications/human-centred-mechanism-design-with-democratic-ai

https://www.newscientist.com/article/2327107-deepminds-ai-develops-popular-policy-for-distributing-public-money/