干貨 | ELK 日志實(shí)時(shí)分析實(shí)戰(zhàn)

0、問(wèn)題來(lái)源

1、日志實(shí)時(shí)分析是 Elasticsearch 三大核心業(yè)務(wù)場(chǎng)景之一

Elasticsearch架構(gòu)選型指南——不止是搜索引擎,還有......曾強(qiáng)調(diào):Elasticsearch 三大核心業(yè)務(wù)場(chǎng)景:

搜索服務(wù)場(chǎng)景。

日志實(shí)時(shí)分析場(chǎng)景。

商業(yè)智能 BI 場(chǎng)景。

2、少啰嗦,先看東西

2.1 日志數(shù)據(jù)準(zhǔn)備

以 Python 日志作為數(shù)據(jù)源,開(kāi)搞。

在 Python 中,日志記錄可以分為 5 種不同級(jí)別:

Info — 指定信息性消息,在粗粒度級(jí)別突出顯示應(yīng)用程序的進(jìn)度。

Debug — 指定對(duì)調(diào)試應(yīng)用程序最有用的細(xì)粒度信息事件。

Warning — 指定警告/告警事件。

Error — 指定已出錯(cuò),但仍允許應(yīng)用程序繼續(xù)運(yùn)行的事件。

Critical — 指定可能導(dǎo)致應(yīng)用程序中止的非常嚴(yán)重的錯(cuò)誤事件。

日志隨機(jī)生成 Python 3.X 腳本如下:

import logging

import random

logging.basicConfig(filename="logFile.txt",

filemode='a',

format='%(asctime)s %(levelname)s-%(message)s',

datefmt='%Y-%m-%d %H:%M:%S')

for i in range(0,30):

x=random.randint(0,2)

if(x==0):

logging.warning('Log Message')

elif(x==1):

logging.critical('Log Message')

else:

logging.error('Log Message')

生成日志文件 logFile.txt 部分內(nèi)容如下:

2021-07-10 21:57:29 ERROR-Log Message

2021-07-10 21:57:29 ERROR-Log Message

2021-07-10 21:57:29 CRITICAL-Log Message

2021-07-10 21:57:29 WARNING-Log Message

2021-07-10 21:57:29 CRITICAL-Log Message

2021-07-10 21:57:29 ERROR-Log Message

2.2 Logstash 數(shù)據(jù)處理

本文 Logstash、Elasticsearch、Kibana 版本均為:7.12.0。

Logstash 三段論核心:

Input:輸入

filter:處理(最最核心)

Output:輸出

結(jié)合本文日志場(chǎng)景:

input:日志。

filter:日志處理,獲取各個(gè)細(xì)分字段核心內(nèi)容。

output:輸出到 Elasticsearch,以便于后續(xù)的 Kibana 數(shù)據(jù)分析。

input{

file{

path => "/home/elasticsearch/logstash-7.12.0/config/logFile.txt"

start_position => "beginning"

}

}

filter

{

grok{

match => {"message" => "%{TIMESTAMP_ISO8601:timestamp} %{LOGLEVEL:log-level}-%{GREEDYDATA:message}"}

}

date {

match => ["timestamp", "ISO8601"]

}

}

output{

elasticsearch{

hosts => ["172.21.0.14:19022"]

index => "my_log_index"}

stdout{codec => rubydebug}

}

input、output 基本結(jié)合字段含義都能看懂。

就中間部分的 grok、date 處理感覺(jué)有點(diǎn)云里霧里,我們下一小節(jié)拆解講解。

2.3 數(shù)據(jù)同步到 Elasticsearch

Logstash 中的 output 環(huán)節(jié)已經(jīng)設(shè)置輸出的索引名稱(chēng):my_log_index。

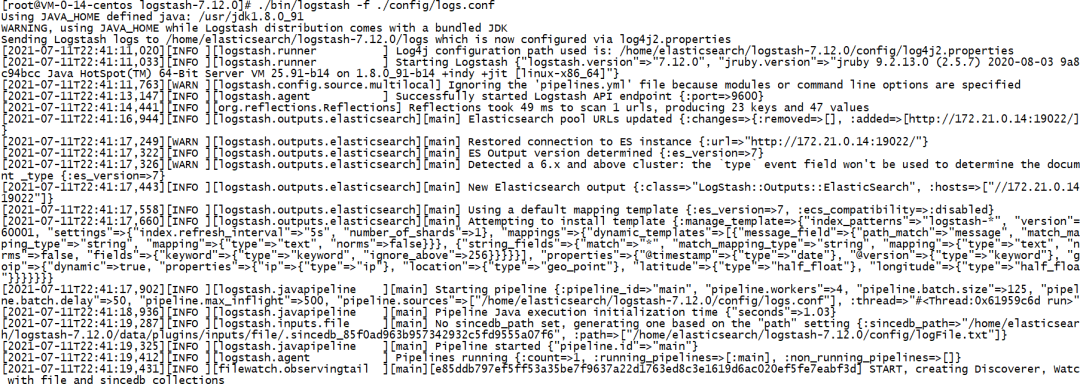

同步執(zhí)行只需要在 logstash 路徑下執(zhí)行如下命令即可:

./bin/logstash -f ./config/logs.conf

執(zhí)行成功截圖如下:

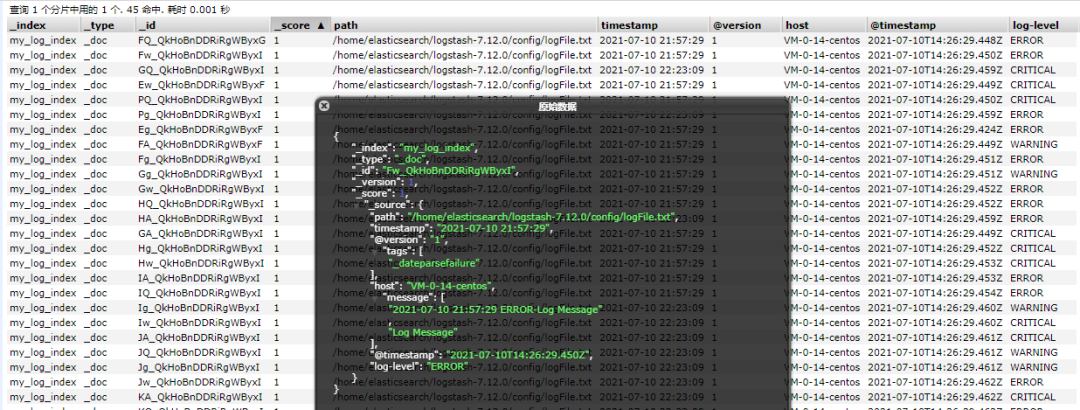

導(dǎo)入 Elasticsearch 數(shù)據(jù)如下:

{

"_index" : "my_log_index",

"_type" : "_doc",

"_id" : "FQ_QkHoBnDDRiRgWByxG",

"_score" : 1.0,

"_source" : {

"path" : "/home/elasticsearch/logstash-7.12.0/config/logFile.txt",

"timestamp" : "2021-07-10 21:57:29",

"@version" : "1",

"tags" : [

"_dateparsefailure"

],

"host" : "VM-0-14-centos",

"message" : [

"2021-07-10 21:57:29 ERROR-Log Message",

"Log Message"

],

"@timestamp" : "2021-07-10T14:26:29.448Z",

"log-level" : "ERROR"

}

},

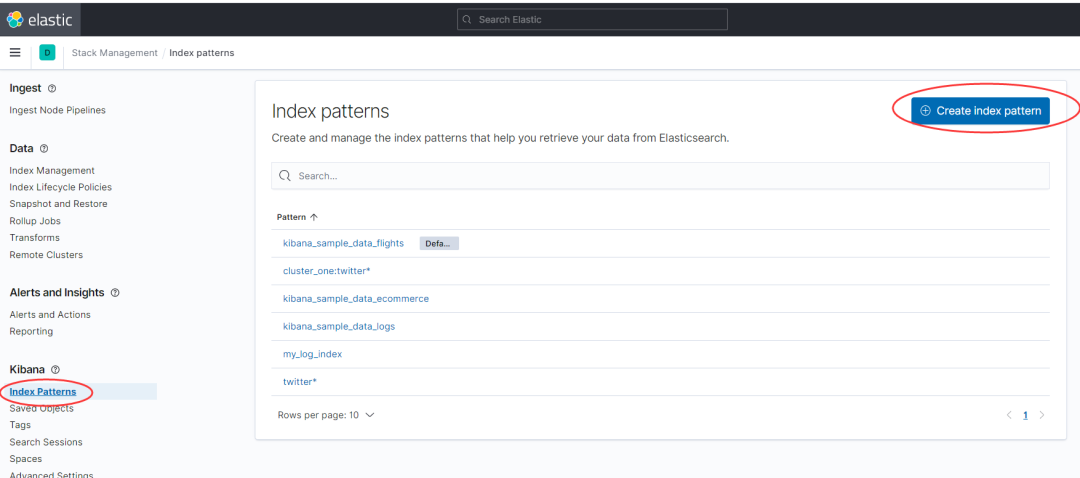

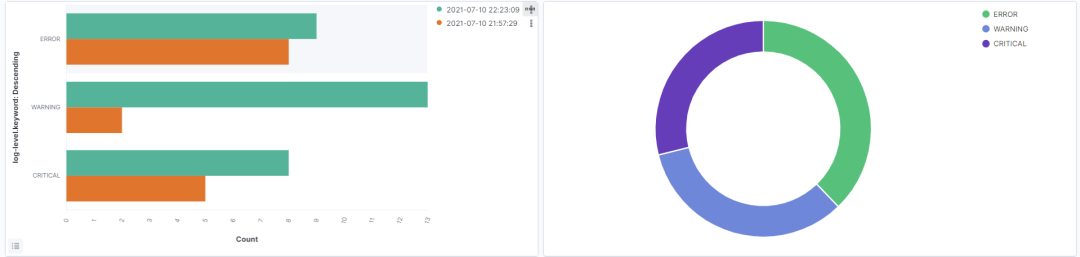

2.4 Kibana 可視化分析

Kibana 可視化分析就是基于日期維度的數(shù)據(jù)源做分析。

核心步驟如下:

步驟1:創(chuàng)建 index patterns(最關(guān)鍵一步)。

步驟2:Discover 查看數(shù)據(jù)流(非必須,可直接跳第三步)。

步驟3:日志聚合 Dashboard 分析。

如上三個(gè)環(huán)節(jié)都“中規(guī)中矩”、幾乎沒(méi)有坑,不再拆解解讀,有問(wèn)題可以留言討論。

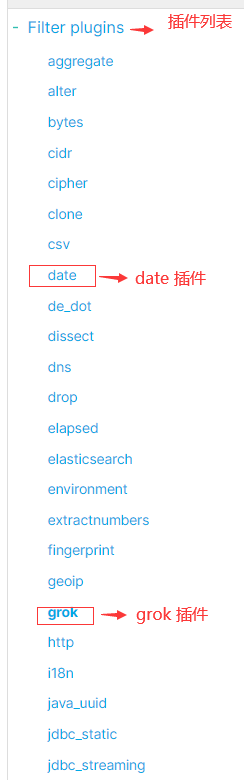

3、filter 環(huán)節(jié)核心原理解讀

filter 中間處理環(huán)節(jié)用到了兩個(gè)核心插件:

3.1 插件一:date 插件

3.1.1 date 插件定義

date 插件也可以稱(chēng)為:日期過(guò)濾器。

用途:用于解析字段中的日期,然后使用該日期或時(shí)間戳作為事件的日志記錄時(shí)間戳。

如下代碼代表將:timestamp 字段轉(zhuǎn)換成 ISO8601 數(shù)據(jù)類(lèi)型。

date {

match => ["timestamp", "ISO8601"]

}

3.1.2 date 插件適用場(chǎng)景

日期或時(shí)間戳類(lèi)型轉(zhuǎn)換。

3.1.3 date 插件核心參數(shù)解讀

ISO8601 的本質(zhì)含義:將日期字段解析為 “2011-04-19T03:44:01.103Z“ 類(lèi)型。

還有其他類(lèi)型,諸如:UNIX、UNIX_MS、TAI64N 等。

詳細(xì)解釋參考官方文檔:

https://www.elastic.co/guide/en/logstash/current/plugins-filters-date.html

3.2 插件二:grok 插件

3.2.1 grok 插件定義

將非結(jié)構(gòu)化日志數(shù)據(jù)解析為結(jié)構(gòu)化和可查詢(xún)的日志。

3.2.2 grok 插件適用場(chǎng)景

適合 syslog 日志、apache 日志和其他網(wǎng)絡(luò)服務(wù)器日志、mysql 日志,以及通常為人類(lèi)而非計(jì)算機(jī)使用編寫(xiě)的任何日志格式。

3.2.3 grok 插件附帶的 120 + 匹配模式

第一次看 filter 處理環(huán)節(jié),不理解:

%{TIMESTAMP_ISO8601:timestamp}

類(lèi)似語(yǔ)法的含義。

實(shí)際上:

TIMESTAMP_ISO8601 就是匹配模式;

timestamp 解析后存儲(chǔ) TIMESTAMP_ISO8601 格式數(shù)據(jù)的變量,且該變量會(huì)作為 elasticsearch Mapping 中的一個(gè)字段。

匹配模式的本質(zhì)其實(shí)是:正則表達(dá)式。

120 + 匹配模式對(duì)應(yīng)的官方文檔:

https://github.com/logstash-plugins/logstash-patterns-core/tree/master/patterns

本文用到的匹配模式對(duì)應(yīng)的正則表達(dá)式如下:

字段說(shuō)明:

第一列:匹配類(lèi)型名稱(chēng)。

第二列:匹配的正則表達(dá)式。

TIMESTAMP_ISO8601 %{YEAR}-%{MONTHNUM}-%{MONTHDAY}[T ]%{HOUR}:?%{MINUTE}(?::?%{SECOND})?%{ISO8601_TIMEZONE}?

LOGLEVEL ([Aa]lert|ALERT|[Tt]race|TRACE|[Dd]ebug|DEBUG|[Nn]otice|NOTICE|[Ii]nfo?(?:rmation)?|INFO?(?:RMATION)?|[Ww]arn?(?:ing)?|WARN?(?:ING)?|[Ee]rr?(?:or)?|ERR?(?:OR)?|[Cc]rit?(?:ical)?|CRIT?(?:ICAL)?|[Ff]atal|FATAL|[Ss]evere|SEVERE|EMERG(?:ENCY)?|[Ee]merg(?:ency)?)

GREEDYDATA .*

代碼面前,了無(wú)秘密。

所以,再回頭看 filter 語(yǔ)法會(huì)很通透。

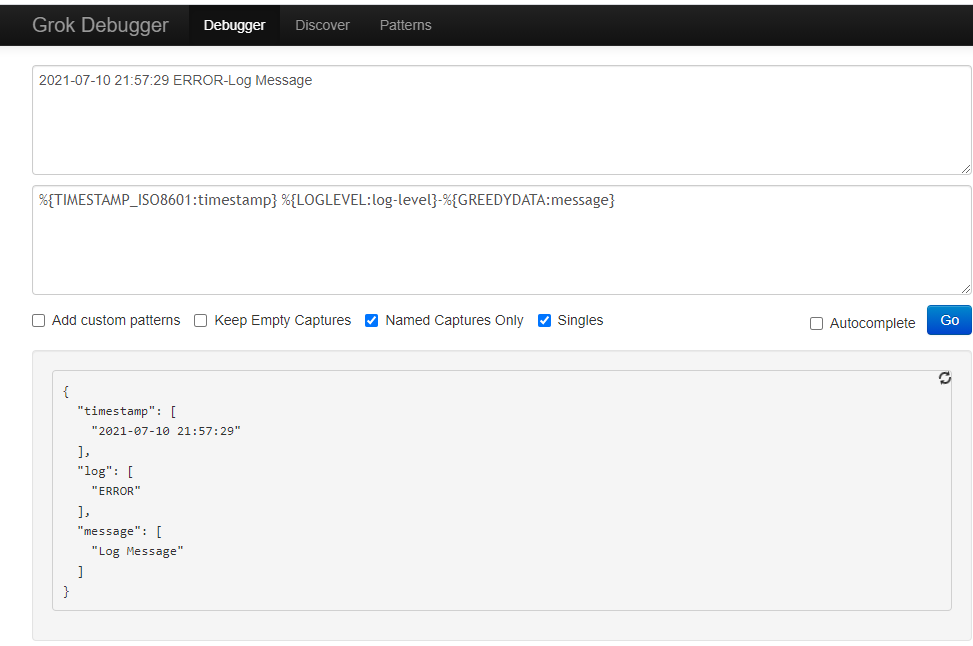

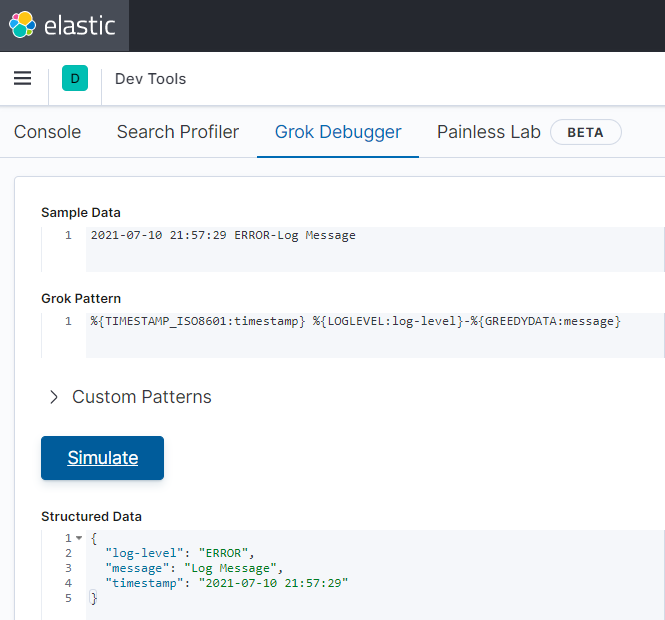

3.2.4 grok 插件測(cè)試工具

為了更方便我們的提前測(cè)試,官方也提供了匹配工具,

工具一:一個(gè)網(wǎng)站 http://grokdebug.herokuapp.com/。

工具二:kibana 自帶 Grok Debugger 工具。

顯然,Kibana 自帶 Grok Debugger 更為清爽。

4、小結(jié)

日志實(shí)時(shí)分析是 ELK 組件的核心業(yè)務(wù)場(chǎng)景之一,而核心中的核心是 Logstash 中間處理 filter 環(huán)節(jié)。

掌握了 filter 環(huán)節(jié),就掌握了 ELK 實(shí)時(shí)日志分析的精髓。

歡迎大家留言討論自己的 ELK 實(shí)戰(zhàn)遇到的問(wèn)題。

參考

https://www.elastic.co/guide/en/logstash/current/filter-plugins.html

https://medium.com/free-code-camp/how-to-use-elasticsearch-logstash-and-kibana-to-visualise-logs-in-python-in-realtime-acaab281c9de

推薦

如何系統(tǒng)的學(xué)習(xí) Elasticsearch ? 全網(wǎng)首發(fā)!《 Elasticsearch 最少必要知識(shí)教程 V1.0 》低調(diào)發(fā)布 從實(shí)戰(zhàn)中來(lái),到實(shí)戰(zhàn)中去——Elasticsearch 技能更快提升方法論 刻意練習(xí) Elasticsearch 10000 個(gè)小時(shí),鬼知道經(jīng)歷了什么?! 干貨 | Logstash自定義正則表達(dá)式ETL實(shí)戰(zhàn) 干貨 | Logstash Grok數(shù)據(jù)結(jié)構(gòu)化ETL實(shí)戰(zhàn)