時間序列預(yù)測一定需要深度學(xué)習(xí)模型嗎?

轉(zhuǎn)自:時序人

時間序列預(yù)測是機(jī)器學(xué)習(xí)中的一項(xiàng)常見的任務(wù),具有非常廣泛的應(yīng)用,例如:電力能源、交通流量和空氣質(zhì)量等預(yù)測。傳統(tǒng)的時間序列預(yù)測模型往往依賴于滾動平均、向量自回歸和自回歸綜合移動平均。另一方面,最近有人提出了深度學(xué)習(xí)和矩陣分解模型來解決時間序列預(yù)測問題,并獲得了更具競爭力的性能,但是該類模型往往過于復(fù)雜。

論文地址:https://arxiv.org/abs/2101.02118

論文源碼:https://github.com/Daniela-Shereen/GBRT-for-TSF

已有方法

時間序列預(yù)測問題分為兩類:

(1)單變量時間序列預(yù)測問題,數(shù)據(jù)只有一個通道,預(yù)測值僅由目標(biāo)通道向量序列組成;(2)多變量時間序列預(yù)測問題,其中預(yù)測器由向量對序列(x,y)組成,但任務(wù)是僅預(yù)測單個目標(biāo)通道。

ARIMA模型(Autoregressive Integrated Moving Average model),差分整合移動平均自回歸模型,又稱整合移動平均自回歸模型(移動也可稱作滑動),為時間序列預(yù)測分析方法之一。

時間正則化矩陣分解(TRMF)模型是一種高度可擴(kuò)展的基于矩陣分解的方法,因?yàn)樗軌驅(qū)?shù)據(jù)中的全局結(jié)構(gòu)進(jìn)行建模。作為本研究中較早的方法之一,該模型僅限于捕捉時間序列數(shù)據(jù)中的線性依賴關(guān)系,但還是顯示了極具競爭力的結(jié)果。

長短期時間序列網(wǎng)絡(luò)(LSTNet)強(qiáng)調(diào)了局部多變量模式,由卷積層建模,以及長期依賴關(guān)系,由遞歸網(wǎng)絡(luò)結(jié)構(gòu)捕獲。

基于注意力的雙階段RNN(DARNN)首先將模型輸入通過一個輸入注意力機(jī)制隨后采用一個配有額外時間注意力機(jī)制的編碼器-解碼器模型。

Deep Global Local Forecaster (DeepGlo) 是基于一個全局matrix factorization結(jié)構(gòu),該結(jié)構(gòu)被一個時間卷積網(wǎng)絡(luò)所規(guī)范化。該模型包含了來自日期和時間的額外通道。

時空融合轉(zhuǎn)化器(Temporal Fusion Transformer)模型是本研究中最新的DNN方法,通過將用于局部處理的遞歸層與捕捉數(shù)據(jù)中長期依賴關(guān)系的轉(zhuǎn)化器典型的自我注意層相結(jié)合,該模型不僅可以在學(xué)習(xí)過程中動態(tài)地關(guān)注相關(guān)的特征,而且還可以通過門控機(jī)抑制那些被認(rèn)為是不相關(guān)的特征。

DeepAR模型是一個自動回歸的概率RNN模型,在附加時間和分類協(xié)變量的幫助下,從時間序列中估計(jì)參數(shù)分布。

深度狀態(tài)空間模型(DeepState)是一個概率生成模型,使用RNN學(xué)習(xí)參數(shù)化的線性狀態(tài)空間模型。

深度空氣質(zhì)量預(yù)測框架(DAQFF)包括一個兩階段的特征表示;數(shù)據(jù)通過三個一維卷積層,然后是兩個雙向LSTM層和一個次級線性層進(jìn)行預(yù)測。

模型對比

該文作者嘗試回答一個問題:一個簡單但配置良好的GBRT模型與最先進(jìn)的深度學(xué)習(xí)時間序列預(yù)測方法的結(jié)果比較?

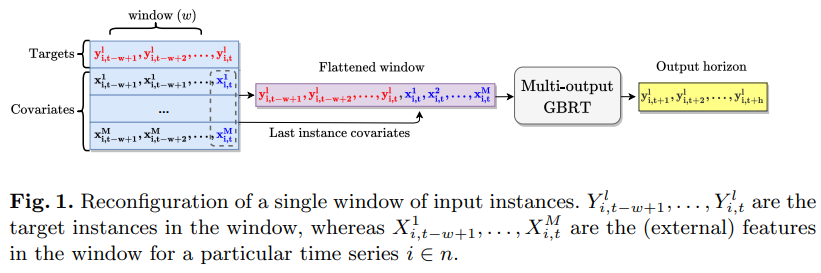

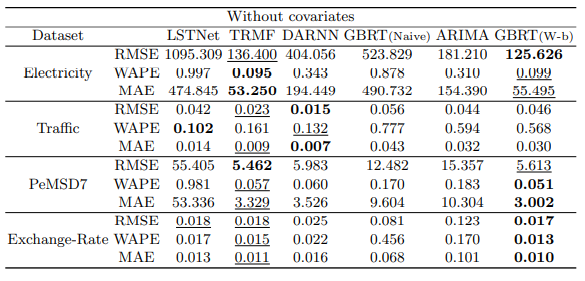

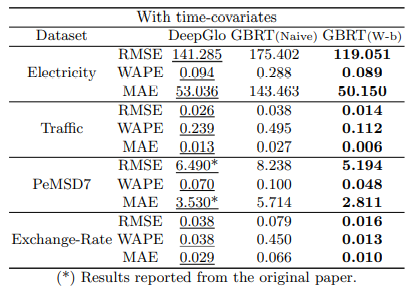

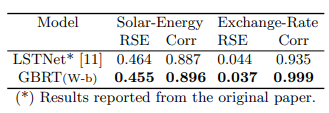

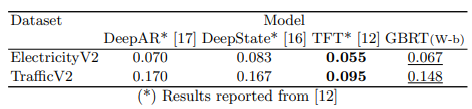

與深度神經(jīng)網(wǎng)絡(luò)(DNN)模型類似,該文作者通過將時間序列預(yù)測任務(wù)轉(zhuǎn)化為一個基于窗口的回歸問題,對GBRT模型的輸入和輸出結(jié)構(gòu)進(jìn)行了特征設(shè)計(jì),例如,對于每個訓(xùn)練窗口,目標(biāo)值與外部特征相連接,然后扁平化形成一個多輸出GBRT模型的輸入實(shí)例。作者對8個最先進(jìn)的深度學(xué)習(xí)模型的9個數(shù)據(jù)集進(jìn)行了比較研究,這些模型都是在過去幾年中在各大頂會上發(fā)表過的工作。對比結(jié)果表明,基于窗口的輸入轉(zhuǎn)換將一個簡單的GBRT模型的性能提高到超過本文所評估的所有最先進(jìn)的DNN模型的水平。

01

GBRT算法設(shè)計(jì)

本文提出的GBRT訓(xùn)練方法主要包括兩方面的修改:

轉(zhuǎn)換窗口輸入為一維向量,需要注意的是,協(xié)變量只使用最后一個時間步的協(xié)變量,實(shí)驗(yàn)部分論證了相對于使用窗口全部的協(xié)變量這種方式訓(xùn)練的模型效果更好。

將預(yù)測器包裝為支持多輸出的MultiOutputRegressor。這種設(shè)置會導(dǎo)致預(yù)測范圍內(nèi)的目標(biāo)變量是獨(dú)立預(yù)測的,模型無法從它們之間的潛在關(guān)系中獲益。但是GBRT基于窗口數(shù)據(jù)的輸入設(shè)置不僅將預(yù)測問題轉(zhuǎn)化為回歸任務(wù),還能夠捕捉目標(biāo)變量中的自相關(guān)效應(yīng),彌補(bǔ)了多輸出獨(dú)立預(yù)測的缺陷。

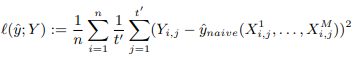

下面是訓(xùn)練的損失函數(shù):?

實(shí)驗(yàn)結(jié)果

01

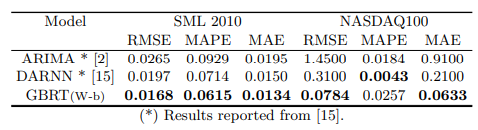

單變量時間序列預(yù)測

02

深度學(xué)習(xí)模型對比

03

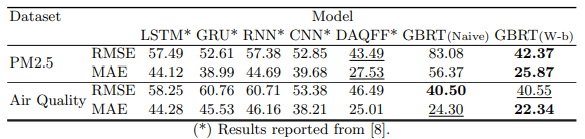

多變量時間序列預(yù)測

總結(jié)展望

該文復(fù)現(xiàn)了最近一些用于時間序列預(yù)測的深度學(xué)習(xí)的工作,并在各種數(shù)據(jù)集上與GBRT進(jìn)行比較。實(shí)驗(yàn)結(jié)果證明,GBRT雖然概念很簡單,但是可以通過對GBRT的輸入和輸出結(jié)構(gòu)進(jìn)行有效的特征工廠處理來超越最先進(jìn)的DNN模型。作者提出,不應(yīng)忽視簡單的機(jī)器學(xué)習(xí)基線方法,應(yīng)該更加謹(jǐn)慎地進(jìn)行配置使得其更加適合任務(wù),也許會獲得非常大的提升。

思考:

機(jī)器學(xué)習(xí)方法一般包括特征工程,模型架構(gòu),損失函數(shù)。其中最重要的是特征工程和損失函數(shù),分別定義了從哪里學(xué)和學(xué)什么,在優(yōu)化一個方法時,這兩點(diǎn)是我們不能忽略的,特征工程和損失函數(shù)正確的條件下,模型架構(gòu)創(chuàng)新往往非常困難而且能帶來的提升有限。

直接將預(yù)測器包裝為支持多輸出的MultiOutputRegressor,窗口數(shù)據(jù)的輸入設(shè)置可以在一定程度上彌補(bǔ)多輸出獨(dú)立預(yù)測的缺陷,但是約束不是非常強(qiáng),可以考慮增加更強(qiáng)的約束以改善效果。

相關(guān)閱讀: