收藏!機(jī)器學(xué)習(xí)算法優(yōu)缺點(diǎn)綜述

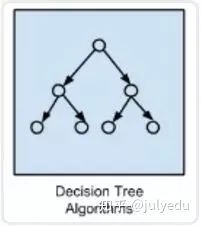

正則化算法(Regularization Algorithms) 集成算法(Ensemble Algorithms) 決策樹算法(Decision Tree Algorithm) 回歸(Regression) 人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Network) 深度學(xué)習(xí)(Deep Learning) 支持向量機(jī)(Support Vector Machine) 降維算法(Dimensionality Reduction Algorithms) 聚類算法(Clustering Algorithms) 基于實(shí)例的算法(Instance-based Algorithms) 貝葉斯算法(Bayesian Algorithms) 關(guān)聯(lián)規(guī)則學(xué)習(xí)算法(Association Rule Learning Algorithms) 圖模型(Graphical Models)

正則化算法(Regularization Algorithms)

嶺回歸(Ridge Regression) 最小絕對收縮與選擇算子(LASSO) GLASSO 彈性網(wǎng)絡(luò)(Elastic Net) 最小角回歸(Least-Angle Regression)

其懲罰會減少過擬合 總會有解決方法

懲罰會造成欠擬合 很難校準(zhǔn)

Boosting

Bootstrapped Aggregation(Bagging)

AdaBoost

層疊泛化(Stacked Generalization)(blending)

梯度推進(jìn)機(jī)(Gradient Boosting Machines,GBM)

梯度提升回歸樹(Gradient Boosted Regression Trees,GBRT)

隨機(jī)森林(Random Forest)

當(dāng)先最先進(jìn)的預(yù)測幾乎都使用了算法集成。它比使用單個模型預(yù)測出來的結(jié)果要精確的多

需要大量的維護(hù)工作

樹模型中的目標(biāo)是可變的,可以采一組有限值,被稱為分類樹;在這些樹結(jié)構(gòu)中,葉子表示類標(biāo)簽,分支表示表征這些類標(biāo)簽的連接的特征。

分類和回歸樹(Classification and Regression Tree,CART) Iterative Dichotomiser 3(ID3) C4.5 和 C5.0(一種強(qiáng)大方法的兩個不同版本)

容易解釋 非參數(shù)型

趨向過擬合 可能或陷于局部最小值中 沒有在線學(xué)習(xí)

普通最小二乘回歸(Ordinary Least Squares Regression,OLSR) 線性回歸(Linear Regression) 邏輯回歸(Logistic Regression) 逐步回歸(Stepwise Regression) 多元自適應(yīng)回歸樣條(Multivariate Adaptive Regression Splines,MARS) 本地散點(diǎn)平滑估計(Locally Estimated Scatterplot Smoothing,LOESS)

直接、快速 知名度高

要求嚴(yán)格的假設(shè) 需要處理異常值

感知器 反向傳播 Hopfield 網(wǎng)絡(luò) 徑向基函數(shù)網(wǎng)絡(luò)(Radial Basis Function Network,RBFN)

在語音、語義、視覺、各類游戲(如圍棋)的任務(wù)中表現(xiàn)極好。 算法可以快速調(diào)整,適應(yīng)新的問題。

需要大量數(shù)據(jù)進(jìn)行訓(xùn)練 訓(xùn)練要求很高的硬件配置 模型處于黑箱狀態(tài),難以理解內(nèi)部機(jī)制 元參數(shù)(Metaparameter)與網(wǎng)絡(luò)拓?fù)溥x擇困難。

深玻耳茲曼機(jī)(Deep Boltzmann Machine,DBM) Deep Belief Networks(DBN) 卷積神經(jīng)網(wǎng)絡(luò)(CNN) Stacked Auto-Encoders

在非線性可分問題上表現(xiàn)優(yōu)秀

非常難以訓(xùn)練 很難解釋

主成分分析(Principal Component Analysis (PCA)) 主成分回歸(Principal Component Regression (PCR)) 偏最小二乘回歸(Partial Least Squares Regression (PLSR)) Sammon 映射(Sammon Mapping) 多維尺度變換(Multidimensional Scaling (MDS)) 投影尋蹤(Projection Pursuit) 線性判別分析(Linear Discriminant Analysis (LDA)) 混合判別分析(Mixture Discriminant Analysis (MDA)) 二次判別分析(Quadratic Discriminant Analysis (QDA)) 靈活判別分析(Flexible Discriminant Analysis (FDA))

可處理大規(guī)模數(shù)據(jù)集 無需在數(shù)據(jù)上進(jìn)行假設(shè)

難以搞定非線性數(shù)據(jù) 難以理解結(jié)果的意義

聚類算法是指對一組目標(biāo)進(jìn)行分類,屬于同一組(亦即一個類,cluster)的目標(biāo)被劃分在一組中,與其他組目標(biāo)相比,同一組目標(biāo)更加彼此相似(在某種意義上)。

K-均值(k-Means) k-Medians 算法 Expectation Maximi 封層 ation (EM) 最大期望算法(EM) 分層集群(Hierarchical Clstering)

讓數(shù)據(jù)變得有意義

結(jié)果難以解讀,針對不尋常的數(shù)據(jù)組,結(jié)果可能無用。

K 最近鄰(k-Nearest Neighbor (kNN)) 學(xué)習(xí)向量量化(Learning Vector Quantization (LVQ)) 自組織映射(Self-Organizing Map (SOM)) 局部加權(quán)學(xué)習(xí)(Locally Weighted Learning (LWL))

算法簡單、結(jié)果易于解讀

內(nèi)存使用非常高 計算成本高 不可能用于高維特征空間

樸素貝葉斯(Naive Bayes) 高斯樸素貝葉斯(Gaussian Naive Bayes) 多項式樸素貝葉斯(Multinomial Naive Bayes) 平均一致依賴估計器(Averaged One-Dependence Estimators (AODE)) 貝葉斯信念網(wǎng)絡(luò)(Bayesian Belief Network (BBN)) 貝葉斯網(wǎng)絡(luò)(Bayesian Network (BN))

快速、易于訓(xùn)練、給出了它們所需的資源能帶來良好的表現(xiàn)

如果輸入變量是相關(guān)的,則會出現(xiàn)問題

Apriori 算法(Apriori algorithm) Eclat 算法(Eclat algorithm) FP-growth

貝葉斯網(wǎng)絡(luò)(Bayesian network) 馬爾可夫隨機(jī)域(Markov random field) 鏈圖(Chain Graphs) 祖先圖(Ancestral graph)

模型清晰,能被直觀地理解

確定其依賴的拓?fù)浜芾щy,有時候也很模糊

原文鏈接:

https://static.coggle.it/diagram/WHeBqDIrJRk-kDDY/t/categories-of-algorithms-non-exhaustive

評論

圖片

表情