深度圖像修復(fù)的一個突破

來源:AI公園 本文約4000字,干貨滿滿,建議閱讀6分鐘

本文介紹了如何使用上下文注意力來進行深度圖像修復(fù)。

回顧

動機

介紹

方案

貢獻

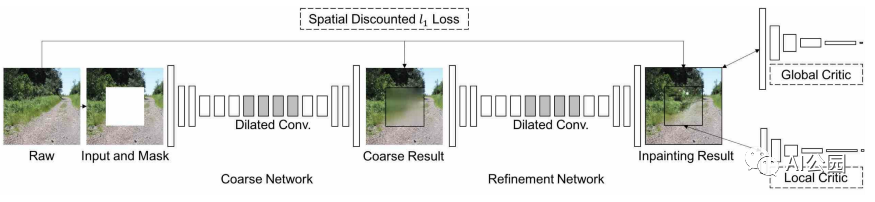

方法

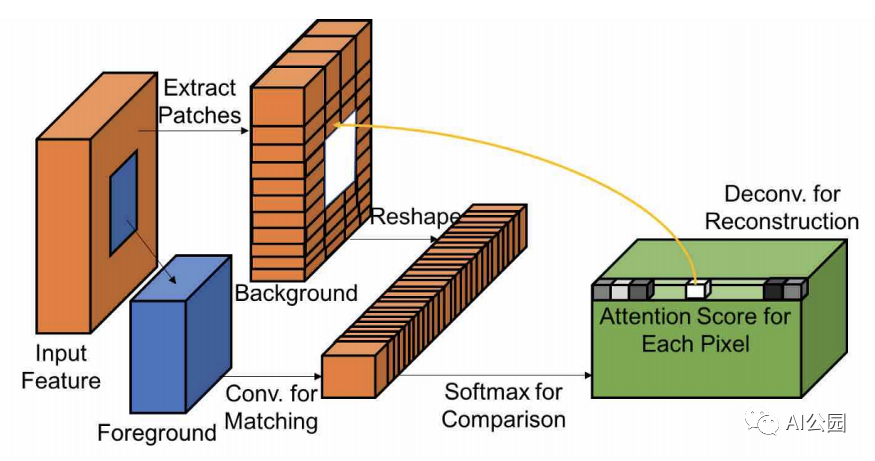

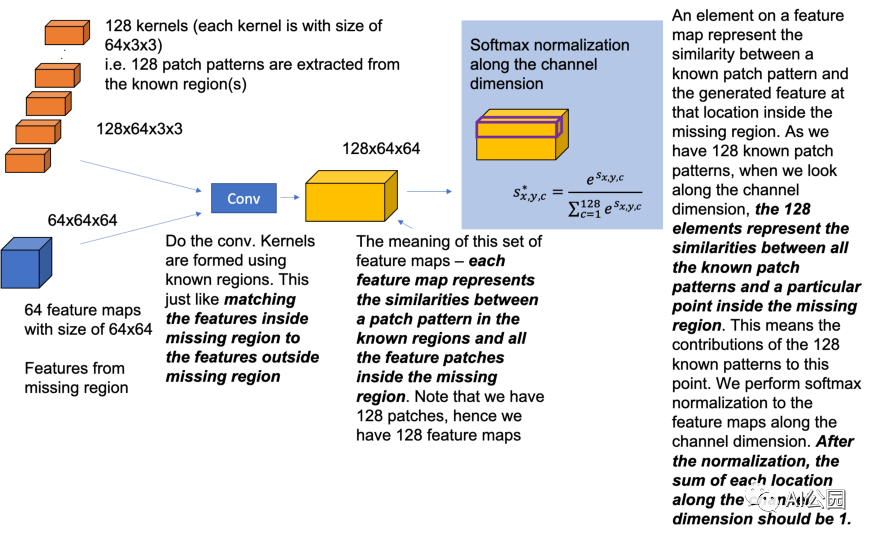

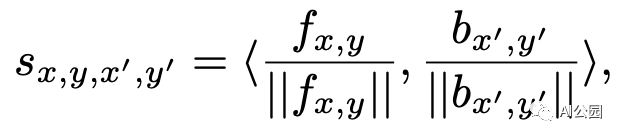

上下文注意力

與上一篇文章中提到的Shift-Net相比,你可以看到,這一次我們給每個已知特征的patch分配了權(quán)重,來表示重建的時候每個特征位置對于缺失區(qū)域的重要性(軟分配),而不是對于缺失區(qū)域的每個位置找一個最相似的(硬分配)。這也是為什么提出的上下文注意力是可微的。

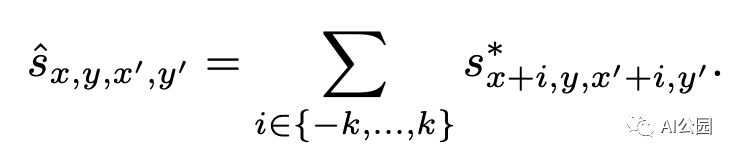

注意力傳播

以較大的步長提取已知的特征patch,以減少kernel數(shù)量。

操作前先對特征圖大小進行向下采樣,獲取注意力圖后再進行上采樣。

網(wǎng)絡(luò)中的注意力

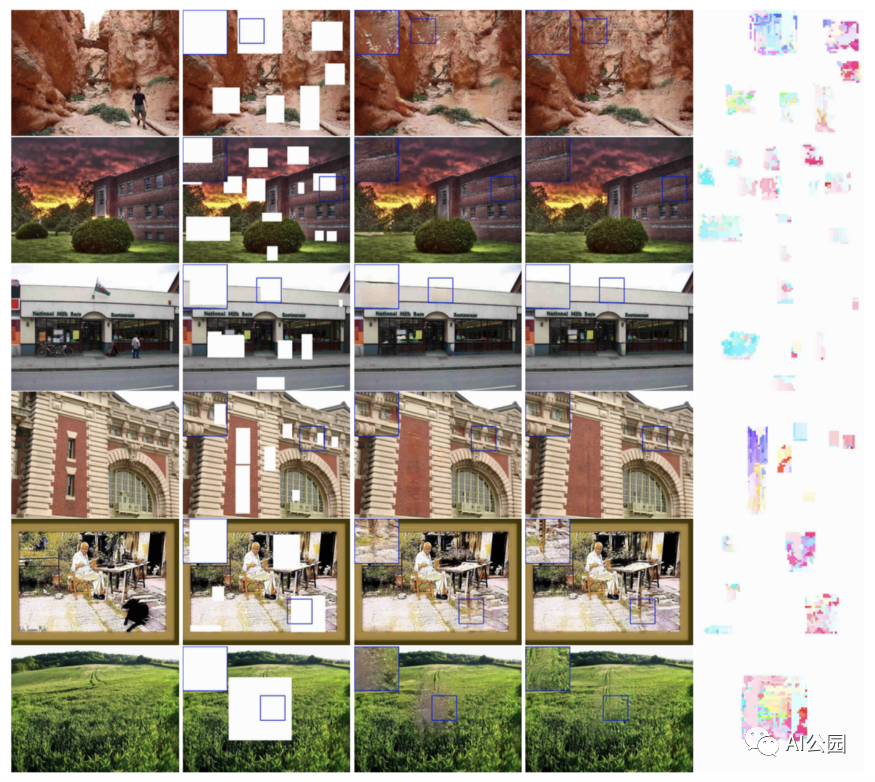

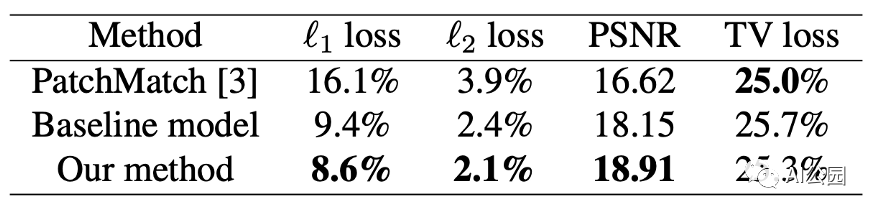

實驗

消融研究

總結(jié)

要點

英文原文:

https://towardsdatascience.com/a-breakthrough-in-deep-image-inpainting-review-generative-image-inpainting-with-contextual-1099c195f3f0

編輯:王菁

校對:汪雨晴

評論

圖片

表情