像監(jiān)管核武器一樣監(jiān)管AI,OpenAI高層集體撰文探討「超級(jí)智能」監(jiān)管!

OpenAI

這次聽證會(huì)是一系列聽證會(huì)中的第一次,國會(huì)議員們希望更多地了解人工智能的潛在利弊,并最終為其「制定規(guī)則」,避免重蹈「監(jiān)管社交媒體為時(shí)已晚」的覆轍。

聽證會(huì)上,Altman 基本上同意議員們的觀點(diǎn),即有必要對(duì)他的公司以及谷歌和微軟等公司正在開發(fā)的日益強(qiáng)大的人工智能技術(shù)進(jìn)行監(jiān)管。不過,在對(duì)話早期階段,他們和立法者都不能說,這種監(jiān)管應(yīng)該是什么樣子。

如今,聽證會(huì)已經(jīng)過去一周,OpenAI 高層又以書面的形式闡述了他們對(duì)監(jiān)管的看法。在一篇題為「Governance of superintelligence」的博客中,Altman 等人寫道,「現(xiàn)在是一個(gè)開始思考超級(jí)智能(superintelligence)監(jiān)管的良好時(shí)機(jī) —— 未來的 AI 系統(tǒng)將比 AGI 都要強(qiáng)大」

這次聽證會(huì)是一系列聽證會(huì)中的第一次,國會(huì)議員們希望更多地了解人工智能的潛在利弊,并最終為其「制定規(guī)則」,避免重蹈「監(jiān)管社交媒體為時(shí)已晚」的覆轍。

聽證會(huì)上,Altman 基本上同意議員們的觀點(diǎn),即有必要對(duì)他的公司以及谷歌和微軟等公司正在開發(fā)的日益強(qiáng)大的人工智能技術(shù)進(jìn)行監(jiān)管。不過,在對(duì)話早期階段,他們和立法者都不能說,這種監(jiān)管應(yīng)該是什么樣子。

如今,聽證會(huì)已經(jīng)過去一周,OpenAI 高層又以書面的形式闡述了他們對(duì)監(jiān)管的看法。在一篇題為「Governance of superintelligence」的博客中,Altman 等人寫道,「現(xiàn)在是一個(gè)開始思考超級(jí)智能(superintelligence)監(jiān)管的良好時(shí)機(jī) —— 未來的 AI 系統(tǒng)將比 AGI 都要強(qiáng)大」

Altman 等人認(rèn)為,未來十年內(nèi),AI 系統(tǒng)有望超過專家水平,在大多數(shù)領(lǐng)域展現(xiàn)出與當(dāng)今最大企業(yè)相當(dāng)?shù)纳a(chǎn)能力。然而,超級(jí)智能技術(shù)帶來的潛在利益和風(fēng)險(xiǎn)將比過去任何其他技術(shù)更加巨大。為了實(shí)現(xiàn)更加繁榮的未來,我們必須管理好超級(jí)智能的風(fēng)險(xiǎn),并確保其與社會(huì)的順利融合。

Altman 等人認(rèn)為,未來十年內(nèi),AI 系統(tǒng)有望超過專家水平,在大多數(shù)領(lǐng)域展現(xiàn)出與當(dāng)今最大企業(yè)相當(dāng)?shù)纳a(chǎn)能力。然而,超級(jí)智能技術(shù)帶來的潛在利益和風(fēng)險(xiǎn)將比過去任何其他技術(shù)更加巨大。為了實(shí)現(xiàn)更加繁榮的未來,我們必須管理好超級(jí)智能的風(fēng)險(xiǎn),并確保其與社會(huì)的順利融合。

為了實(shí)現(xiàn)這一目標(biāo),Altman 等人指出,我們有很多事情可做。首先,我們需要在領(lǐng)先的開發(fā)努力之間進(jìn)行協(xié)調(diào),確保超級(jí)智能的發(fā)展安全可控。此外,我們還需要建立類似于國際原子能機(jī)構(gòu)的國際機(jī)構(gòu)來監(jiān)督超級(jí)智能的研究和應(yīng)用,確保其符合安全標(biāo)準(zhǔn),并限制其部署和安全級(jí)別。此外,我們需要致力于研發(fā)使超級(jí)智能安全可控的技術(shù)能力。

但 Altman 等人也提醒說,盡管要減輕當(dāng)今 AI 技術(shù)的風(fēng)險(xiǎn),但不應(yīng)將類似的監(jiān)管機(jī)制應(yīng)用于低于重要能力閾值的模型。

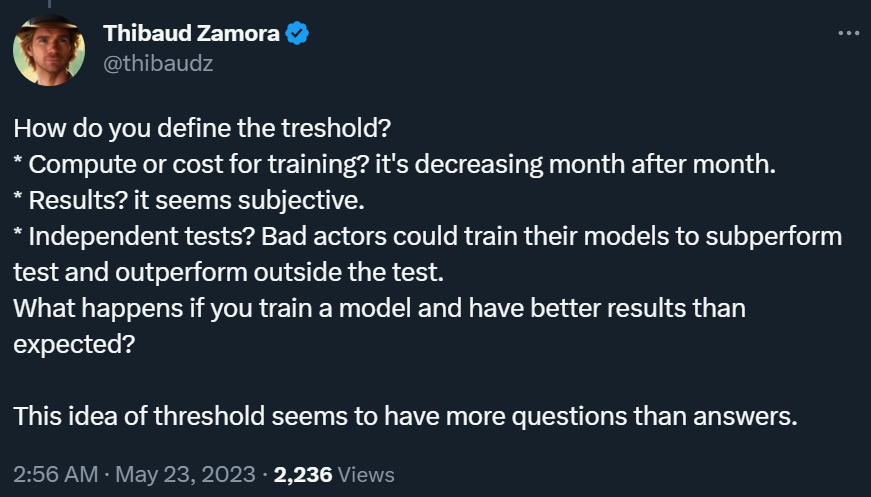

不過,這里的閾值如何定義也是一個(gè)令人頭疼的問題。

為了實(shí)現(xiàn)這一目標(biāo),Altman 等人指出,我們有很多事情可做。首先,我們需要在領(lǐng)先的開發(fā)努力之間進(jìn)行協(xié)調(diào),確保超級(jí)智能的發(fā)展安全可控。此外,我們還需要建立類似于國際原子能機(jī)構(gòu)的國際機(jī)構(gòu)來監(jiān)督超級(jí)智能的研究和應(yīng)用,確保其符合安全標(biāo)準(zhǔn),并限制其部署和安全級(jí)別。此外,我們需要致力于研發(fā)使超級(jí)智能安全可控的技術(shù)能力。

但 Altman 等人也提醒說,盡管要減輕當(dāng)今 AI 技術(shù)的風(fēng)險(xiǎn),但不應(yīng)將類似的監(jiān)管機(jī)制應(yīng)用于低于重要能力閾值的模型。

不過,這里的閾值如何定義也是一個(gè)令人頭疼的問題。

以下是博客原文:

超級(jí)智能的治理

考慮到我們當(dāng)前所看到的情況,可以想象在接下來的十年內(nèi),人工智能系統(tǒng)在大多數(shù)領(lǐng)域?qū)⒊^專家水平,并且能夠執(zhí)行與今天最大的企業(yè)相當(dāng)?shù)纳a(chǎn)活動(dòng)。

從潛在的優(yōu)勢(shì)和劣勢(shì)來看,超級(jí)智能將比人類過去所面對(duì)的其他技術(shù)更為強(qiáng)大。我們可以擁有一個(gè)更加繁榮的未來,但我們必須管理風(fēng)險(xiǎn)才能實(shí)現(xiàn)這一目標(biāo)。鑒于存在滅絕性風(fēng)險(xiǎn)的可能性,我們不能僅僅是被動(dòng)應(yīng)對(duì)。在具備這種特性的技術(shù)中,核能、合成生物學(xué)都是常用的例子。

我們必須減輕今天的人工智能技術(shù)風(fēng)險(xiǎn),但超級(jí)智能將需要特殊的處理和協(xié)調(diào)。

起點(diǎn)

對(duì)于我們來說,有許多理念能夠幫助我們更好地把握這一發(fā)展方向。在這里,我們初步提出了我們對(duì)其中三個(gè)問題的思考。

首先,我們需要在主要發(fā)展努力之間進(jìn)行一定程度的協(xié)調(diào),以確保超級(jí)智能的發(fā)展以一種既能確保安全,又能有助于將這些系統(tǒng)與社會(huì)進(jìn)行順利整合的方式進(jìn)行。這可以通過多種方式實(shí)施;全球各主要政府可以設(shè)立一個(gè)項(xiàng)目,讓許多當(dāng)前的努力成為其中的一部分,或者我們可以達(dá)成共識(shí)(在像下文提到的那種新組織的支持下),將前沿人工智能能力每年的增長速度限制在一定速率內(nèi)。

當(dāng)然,個(gè)別公司應(yīng)該被要求以極高的標(biāo)準(zhǔn)行事,履行責(zé)任。

其次,我們可能最終需要類似國際原子能機(jī)構(gòu)(IAEA)的機(jī)構(gòu)來監(jiān)管超級(jí)智能方面的工作;任何超過一定能力(或計(jì)算資源等)門檻的努力都需要受到國際機(jī)構(gòu)的監(jiān)督,該機(jī)構(gòu)可以檢查系統(tǒng)、要求進(jìn)行審計(jì)、測(cè)試產(chǎn)品是否符合安全標(biāo)準(zhǔn),對(duì)部署程度和安全級(jí)別進(jìn)行限制等等。追蹤計(jì)算資源和能源的使用情況可以在很大程度上幫助我們實(shí)現(xiàn)這一想法。

第一步,公司可以自愿同意開始實(shí)施該機(jī)構(gòu)某一天可能要求的要素;第二步,各個(gè)國家可以實(shí)施。重要的是,這樣的機(jī)構(gòu)應(yīng)該專注于降低滅絕性風(fēng)險(xiǎn),而不是解決應(yīng)該由各個(gè)國家決定的問題,比如定義人工智能應(yīng)該允許說些什么。

第三步,我們需要具備使超級(jí)智能系統(tǒng)安全的技術(shù)能力。這是一個(gè)開放的研究問題,我們和其他人都在付出很多努力來解決這個(gè)問題。

監(jiān)管范圍

我們認(rèn)為,允許公司和開源項(xiàng)目開發(fā)低于重要能力閾值的模型是很重要的,他們不需要我們?cè)谶@里描述的那種監(jiān)管(包括繁瑣的許可證或?qū)徲?jì)等機(jī)制)。

當(dāng)前的系統(tǒng)將為世界創(chuàng)造巨大的價(jià)值,盡管它們確實(shí)存在風(fēng)險(xiǎn),但這些風(fēng)險(xiǎn)的水平似乎與其他互聯(lián)網(wǎng)技術(shù)相當(dāng),并且社會(huì)的應(yīng)對(duì)方式似乎是適當(dāng)?shù)摹?/span>

相比之下,我們所關(guān)注的系統(tǒng)將擁有超越目前任何技術(shù)的力量,我們應(yīng)該小心,不要通過將類似的標(biāo)準(zhǔn)應(yīng)用于遠(yuǎn)遠(yuǎn)低于這一水平的技術(shù)來削弱對(duì)它們的關(guān)注。

公眾意見及潛力

然而,對(duì)于最強(qiáng)大的系統(tǒng)的治理以及它們的部署決策,必須進(jìn)行嚴(yán)格的公眾監(jiān)督。我們認(rèn)為,全世界的人們應(yīng)該民主地決定 AI 系統(tǒng)的范圍和默認(rèn)設(shè)置。我們尚不清楚如何設(shè)計(jì)這樣的機(jī)制,但我們計(jì)劃對(duì)它的發(fā)展進(jìn)行試驗(yàn)。我們?nèi)匀徽J(rèn)為,在這些廣泛的范圍內(nèi),個(gè)體用戶應(yīng)該對(duì)所使用的 AI 的行為有很大的控制權(quán)。

考慮到風(fēng)險(xiǎn)和困難,為什么要構(gòu)建這項(xiàng)技術(shù)是一個(gè)值得思考的問題。

在 OpenAI,我們有兩個(gè)基本出發(fā)點(diǎn)。首先,我們相信超級(jí)智能將帶來一個(gè)比我們今天所能想象的世界更美好的未來(我們已經(jīng)在教育、創(chuàng)造性工作和個(gè)人生產(chǎn)力等領(lǐng)域看到了早期的例子)。世界面臨著許多需要我們更多幫助才能解決的問題;這項(xiàng)技術(shù)可以改善我們的社會(huì),每個(gè)人使用這些新工具的創(chuàng)造能力肯定會(huì)讓我們大吃一驚。經(jīng)濟(jì)增長和生活質(zhì)量的提高將令人震驚。

原文鏈接:https://openai.com/blog/governance-of-superintelligence

以下是博客原文:

超級(jí)智能的治理

考慮到我們當(dāng)前所看到的情況,可以想象在接下來的十年內(nèi),人工智能系統(tǒng)在大多數(shù)領(lǐng)域?qū)⒊^專家水平,并且能夠執(zhí)行與今天最大的企業(yè)相當(dāng)?shù)纳a(chǎn)活動(dòng)。

從潛在的優(yōu)勢(shì)和劣勢(shì)來看,超級(jí)智能將比人類過去所面對(duì)的其他技術(shù)更為強(qiáng)大。我們可以擁有一個(gè)更加繁榮的未來,但我們必須管理風(fēng)險(xiǎn)才能實(shí)現(xiàn)這一目標(biāo)。鑒于存在滅絕性風(fēng)險(xiǎn)的可能性,我們不能僅僅是被動(dòng)應(yīng)對(duì)。在具備這種特性的技術(shù)中,核能、合成生物學(xué)都是常用的例子。

我們必須減輕今天的人工智能技術(shù)風(fēng)險(xiǎn),但超級(jí)智能將需要特殊的處理和協(xié)調(diào)。

起點(diǎn)

對(duì)于我們來說,有許多理念能夠幫助我們更好地把握這一發(fā)展方向。在這里,我們初步提出了我們對(duì)其中三個(gè)問題的思考。

首先,我們需要在主要發(fā)展努力之間進(jìn)行一定程度的協(xié)調(diào),以確保超級(jí)智能的發(fā)展以一種既能確保安全,又能有助于將這些系統(tǒng)與社會(huì)進(jìn)行順利整合的方式進(jìn)行。這可以通過多種方式實(shí)施;全球各主要政府可以設(shè)立一個(gè)項(xiàng)目,讓許多當(dāng)前的努力成為其中的一部分,或者我們可以達(dá)成共識(shí)(在像下文提到的那種新組織的支持下),將前沿人工智能能力每年的增長速度限制在一定速率內(nèi)。

當(dāng)然,個(gè)別公司應(yīng)該被要求以極高的標(biāo)準(zhǔn)行事,履行責(zé)任。

其次,我們可能最終需要類似國際原子能機(jī)構(gòu)(IAEA)的機(jī)構(gòu)來監(jiān)管超級(jí)智能方面的工作;任何超過一定能力(或計(jì)算資源等)門檻的努力都需要受到國際機(jī)構(gòu)的監(jiān)督,該機(jī)構(gòu)可以檢查系統(tǒng)、要求進(jìn)行審計(jì)、測(cè)試產(chǎn)品是否符合安全標(biāo)準(zhǔn),對(duì)部署程度和安全級(jí)別進(jìn)行限制等等。追蹤計(jì)算資源和能源的使用情況可以在很大程度上幫助我們實(shí)現(xiàn)這一想法。

第一步,公司可以自愿同意開始實(shí)施該機(jī)構(gòu)某一天可能要求的要素;第二步,各個(gè)國家可以實(shí)施。重要的是,這樣的機(jī)構(gòu)應(yīng)該專注于降低滅絕性風(fēng)險(xiǎn),而不是解決應(yīng)該由各個(gè)國家決定的問題,比如定義人工智能應(yīng)該允許說些什么。

第三步,我們需要具備使超級(jí)智能系統(tǒng)安全的技術(shù)能力。這是一個(gè)開放的研究問題,我們和其他人都在付出很多努力來解決這個(gè)問題。

監(jiān)管范圍

我們認(rèn)為,允許公司和開源項(xiàng)目開發(fā)低于重要能力閾值的模型是很重要的,他們不需要我們?cè)谶@里描述的那種監(jiān)管(包括繁瑣的許可證或?qū)徲?jì)等機(jī)制)。

當(dāng)前的系統(tǒng)將為世界創(chuàng)造巨大的價(jià)值,盡管它們確實(shí)存在風(fēng)險(xiǎn),但這些風(fēng)險(xiǎn)的水平似乎與其他互聯(lián)網(wǎng)技術(shù)相當(dāng),并且社會(huì)的應(yīng)對(duì)方式似乎是適當(dāng)?shù)摹?/span>

相比之下,我們所關(guān)注的系統(tǒng)將擁有超越目前任何技術(shù)的力量,我們應(yīng)該小心,不要通過將類似的標(biāo)準(zhǔn)應(yīng)用于遠(yuǎn)遠(yuǎn)低于這一水平的技術(shù)來削弱對(duì)它們的關(guān)注。

公眾意見及潛力

然而,對(duì)于最強(qiáng)大的系統(tǒng)的治理以及它們的部署決策,必須進(jìn)行嚴(yán)格的公眾監(jiān)督。我們認(rèn)為,全世界的人們應(yīng)該民主地決定 AI 系統(tǒng)的范圍和默認(rèn)設(shè)置。我們尚不清楚如何設(shè)計(jì)這樣的機(jī)制,但我們計(jì)劃對(duì)它的發(fā)展進(jìn)行試驗(yàn)。我們?nèi)匀徽J(rèn)為,在這些廣泛的范圍內(nèi),個(gè)體用戶應(yīng)該對(duì)所使用的 AI 的行為有很大的控制權(quán)。

考慮到風(fēng)險(xiǎn)和困難,為什么要構(gòu)建這項(xiàng)技術(shù)是一個(gè)值得思考的問題。

在 OpenAI,我們有兩個(gè)基本出發(fā)點(diǎn)。首先,我們相信超級(jí)智能將帶來一個(gè)比我們今天所能想象的世界更美好的未來(我們已經(jīng)在教育、創(chuàng)造性工作和個(gè)人生產(chǎn)力等領(lǐng)域看到了早期的例子)。世界面臨著許多需要我們更多幫助才能解決的問題;這項(xiàng)技術(shù)可以改善我們的社會(huì),每個(gè)人使用這些新工具的創(chuàng)造能力肯定會(huì)讓我們大吃一驚。經(jīng)濟(jì)增長和生活質(zhì)量的提高將令人震驚。

原文鏈接:https://openai.com/blog/governance-of-superintelligence

轉(zhuǎn)自:機(jī)器之心

AI 領(lǐng)域也需要一個(gè)類似「國際原子能機(jī)構(gòu)」的組織?前段時(shí)間,一向衣著休閑的 OpenAI 首席執(zhí)行官 Sam Altman 以西裝革履的形式出現(xiàn)在了公眾面前,出席一個(gè)主題為「AI 監(jiān)管:人工智能規(guī)則(Oversight of AI: Rules for Artificial Intelligence)」的聽證會(huì)。和他一起作證的還有長期批評(píng)人工智能的 Gary Marcus 以及 IBM 首席隱私和信任官 Christina Montgomery。

這次聽證會(huì)是一系列聽證會(huì)中的第一次,國會(huì)議員們希望更多地了解人工智能的潛在利弊,并最終為其「制定規(guī)則」,避免重蹈「監(jiān)管社交媒體為時(shí)已晚」的覆轍。

聽證會(huì)上,Altman 基本上同意議員們的觀點(diǎn),即有必要對(duì)他的公司以及谷歌和微軟等公司正在開發(fā)的日益強(qiáng)大的人工智能技術(shù)進(jìn)行監(jiān)管。不過,在對(duì)話早期階段,他們和立法者都不能說,這種監(jiān)管應(yīng)該是什么樣子。

如今,聽證會(huì)已經(jīng)過去一周,OpenAI 高層又以書面的形式闡述了他們對(duì)監(jiān)管的看法。在一篇題為「Governance of superintelligence」的博客中,Altman 等人寫道,「現(xiàn)在是一個(gè)開始思考超級(jí)智能(superintelligence)監(jiān)管的良好時(shí)機(jī) —— 未來的 AI 系統(tǒng)將比 AGI 都要強(qiáng)大」

這次聽證會(huì)是一系列聽證會(huì)中的第一次,國會(huì)議員們希望更多地了解人工智能的潛在利弊,并最終為其「制定規(guī)則」,避免重蹈「監(jiān)管社交媒體為時(shí)已晚」的覆轍。

聽證會(huì)上,Altman 基本上同意議員們的觀點(diǎn),即有必要對(duì)他的公司以及谷歌和微軟等公司正在開發(fā)的日益強(qiáng)大的人工智能技術(shù)進(jìn)行監(jiān)管。不過,在對(duì)話早期階段,他們和立法者都不能說,這種監(jiān)管應(yīng)該是什么樣子。

如今,聽證會(huì)已經(jīng)過去一周,OpenAI 高層又以書面的形式闡述了他們對(duì)監(jiān)管的看法。在一篇題為「Governance of superintelligence」的博客中,Altman 等人寫道,「現(xiàn)在是一個(gè)開始思考超級(jí)智能(superintelligence)監(jiān)管的良好時(shí)機(jī) —— 未來的 AI 系統(tǒng)將比 AGI 都要強(qiáng)大」

Altman 等人認(rèn)為,未來十年內(nèi),AI 系統(tǒng)有望超過專家水平,在大多數(shù)領(lǐng)域展現(xiàn)出與當(dāng)今最大企業(yè)相當(dāng)?shù)纳a(chǎn)能力。然而,超級(jí)智能技術(shù)帶來的潛在利益和風(fēng)險(xiǎn)將比過去任何其他技術(shù)更加巨大。為了實(shí)現(xiàn)更加繁榮的未來,我們必須管理好超級(jí)智能的風(fēng)險(xiǎn),并確保其與社會(huì)的順利融合。

Altman 等人認(rèn)為,未來十年內(nèi),AI 系統(tǒng)有望超過專家水平,在大多數(shù)領(lǐng)域展現(xiàn)出與當(dāng)今最大企業(yè)相當(dāng)?shù)纳a(chǎn)能力。然而,超級(jí)智能技術(shù)帶來的潛在利益和風(fēng)險(xiǎn)將比過去任何其他技術(shù)更加巨大。為了實(shí)現(xiàn)更加繁榮的未來,我們必須管理好超級(jí)智能的風(fēng)險(xiǎn),并確保其與社會(huì)的順利融合。

為了實(shí)現(xiàn)這一目標(biāo),Altman 等人指出,我們有很多事情可做。首先,我們需要在領(lǐng)先的開發(fā)努力之間進(jìn)行協(xié)調(diào),確保超級(jí)智能的發(fā)展安全可控。此外,我們還需要建立類似于國際原子能機(jī)構(gòu)的國際機(jī)構(gòu)來監(jiān)督超級(jí)智能的研究和應(yīng)用,確保其符合安全標(biāo)準(zhǔn),并限制其部署和安全級(jí)別。此外,我們需要致力于研發(fā)使超級(jí)智能安全可控的技術(shù)能力。

但 Altman 等人也提醒說,盡管要減輕當(dāng)今 AI 技術(shù)的風(fēng)險(xiǎn),但不應(yīng)將類似的監(jiān)管機(jī)制應(yīng)用于低于重要能力閾值的模型。

不過,這里的閾值如何定義也是一個(gè)令人頭疼的問題。

為了實(shí)現(xiàn)這一目標(biāo),Altman 等人指出,我們有很多事情可做。首先,我們需要在領(lǐng)先的開發(fā)努力之間進(jìn)行協(xié)調(diào),確保超級(jí)智能的發(fā)展安全可控。此外,我們還需要建立類似于國際原子能機(jī)構(gòu)的國際機(jī)構(gòu)來監(jiān)督超級(jí)智能的研究和應(yīng)用,確保其符合安全標(biāo)準(zhǔn),并限制其部署和安全級(jí)別。此外,我們需要致力于研發(fā)使超級(jí)智能安全可控的技術(shù)能力。

但 Altman 等人也提醒說,盡管要減輕當(dāng)今 AI 技術(shù)的風(fēng)險(xiǎn),但不應(yīng)將類似的監(jiān)管機(jī)制應(yīng)用于低于重要能力閾值的模型。

不過,這里的閾值如何定義也是一個(gè)令人頭疼的問題。

以下是博客原文:

超級(jí)智能的治理

考慮到我們當(dāng)前所看到的情況,可以想象在接下來的十年內(nèi),人工智能系統(tǒng)在大多數(shù)領(lǐng)域?qū)⒊^專家水平,并且能夠執(zhí)行與今天最大的企業(yè)相當(dāng)?shù)纳a(chǎn)活動(dòng)。

從潛在的優(yōu)勢(shì)和劣勢(shì)來看,超級(jí)智能將比人類過去所面對(duì)的其他技術(shù)更為強(qiáng)大。我們可以擁有一個(gè)更加繁榮的未來,但我們必須管理風(fēng)險(xiǎn)才能實(shí)現(xiàn)這一目標(biāo)。鑒于存在滅絕性風(fēng)險(xiǎn)的可能性,我們不能僅僅是被動(dòng)應(yīng)對(duì)。在具備這種特性的技術(shù)中,核能、合成生物學(xué)都是常用的例子。

我們必須減輕今天的人工智能技術(shù)風(fēng)險(xiǎn),但超級(jí)智能將需要特殊的處理和協(xié)調(diào)。

起點(diǎn)

對(duì)于我們來說,有許多理念能夠幫助我們更好地把握這一發(fā)展方向。在這里,我們初步提出了我們對(duì)其中三個(gè)問題的思考。

首先,我們需要在主要發(fā)展努力之間進(jìn)行一定程度的協(xié)調(diào),以確保超級(jí)智能的發(fā)展以一種既能確保安全,又能有助于將這些系統(tǒng)與社會(huì)進(jìn)行順利整合的方式進(jìn)行。這可以通過多種方式實(shí)施;全球各主要政府可以設(shè)立一個(gè)項(xiàng)目,讓許多當(dāng)前的努力成為其中的一部分,或者我們可以達(dá)成共識(shí)(在像下文提到的那種新組織的支持下),將前沿人工智能能力每年的增長速度限制在一定速率內(nèi)。

當(dāng)然,個(gè)別公司應(yīng)該被要求以極高的標(biāo)準(zhǔn)行事,履行責(zé)任。

其次,我們可能最終需要類似國際原子能機(jī)構(gòu)(IAEA)的機(jī)構(gòu)來監(jiān)管超級(jí)智能方面的工作;任何超過一定能力(或計(jì)算資源等)門檻的努力都需要受到國際機(jī)構(gòu)的監(jiān)督,該機(jī)構(gòu)可以檢查系統(tǒng)、要求進(jìn)行審計(jì)、測(cè)試產(chǎn)品是否符合安全標(biāo)準(zhǔn),對(duì)部署程度和安全級(jí)別進(jìn)行限制等等。追蹤計(jì)算資源和能源的使用情況可以在很大程度上幫助我們實(shí)現(xiàn)這一想法。

第一步,公司可以自愿同意開始實(shí)施該機(jī)構(gòu)某一天可能要求的要素;第二步,各個(gè)國家可以實(shí)施。重要的是,這樣的機(jī)構(gòu)應(yīng)該專注于降低滅絕性風(fēng)險(xiǎn),而不是解決應(yīng)該由各個(gè)國家決定的問題,比如定義人工智能應(yīng)該允許說些什么。

第三步,我們需要具備使超級(jí)智能系統(tǒng)安全的技術(shù)能力。這是一個(gè)開放的研究問題,我們和其他人都在付出很多努力來解決這個(gè)問題。

監(jiān)管范圍

我們認(rèn)為,允許公司和開源項(xiàng)目開發(fā)低于重要能力閾值的模型是很重要的,他們不需要我們?cè)谶@里描述的那種監(jiān)管(包括繁瑣的許可證或?qū)徲?jì)等機(jī)制)。

當(dāng)前的系統(tǒng)將為世界創(chuàng)造巨大的價(jià)值,盡管它們確實(shí)存在風(fēng)險(xiǎn),但這些風(fēng)險(xiǎn)的水平似乎與其他互聯(lián)網(wǎng)技術(shù)相當(dāng),并且社會(huì)的應(yīng)對(duì)方式似乎是適當(dāng)?shù)摹?/span>

相比之下,我們所關(guān)注的系統(tǒng)將擁有超越目前任何技術(shù)的力量,我們應(yīng)該小心,不要通過將類似的標(biāo)準(zhǔn)應(yīng)用于遠(yuǎn)遠(yuǎn)低于這一水平的技術(shù)來削弱對(duì)它們的關(guān)注。

公眾意見及潛力

然而,對(duì)于最強(qiáng)大的系統(tǒng)的治理以及它們的部署決策,必須進(jìn)行嚴(yán)格的公眾監(jiān)督。我們認(rèn)為,全世界的人們應(yīng)該民主地決定 AI 系統(tǒng)的范圍和默認(rèn)設(shè)置。我們尚不清楚如何設(shè)計(jì)這樣的機(jī)制,但我們計(jì)劃對(duì)它的發(fā)展進(jìn)行試驗(yàn)。我們?nèi)匀徽J(rèn)為,在這些廣泛的范圍內(nèi),個(gè)體用戶應(yīng)該對(duì)所使用的 AI 的行為有很大的控制權(quán)。

考慮到風(fēng)險(xiǎn)和困難,為什么要構(gòu)建這項(xiàng)技術(shù)是一個(gè)值得思考的問題。

在 OpenAI,我們有兩個(gè)基本出發(fā)點(diǎn)。首先,我們相信超級(jí)智能將帶來一個(gè)比我們今天所能想象的世界更美好的未來(我們已經(jīng)在教育、創(chuàng)造性工作和個(gè)人生產(chǎn)力等領(lǐng)域看到了早期的例子)。世界面臨著許多需要我們更多幫助才能解決的問題;這項(xiàng)技術(shù)可以改善我們的社會(huì),每個(gè)人使用這些新工具的創(chuàng)造能力肯定會(huì)讓我們大吃一驚。經(jīng)濟(jì)增長和生活質(zhì)量的提高將令人震驚。

原文鏈接:https://openai.com/blog/governance-of-superintelligence

以下是博客原文:

超級(jí)智能的治理

考慮到我們當(dāng)前所看到的情況,可以想象在接下來的十年內(nèi),人工智能系統(tǒng)在大多數(shù)領(lǐng)域?qū)⒊^專家水平,并且能夠執(zhí)行與今天最大的企業(yè)相當(dāng)?shù)纳a(chǎn)活動(dòng)。

從潛在的優(yōu)勢(shì)和劣勢(shì)來看,超級(jí)智能將比人類過去所面對(duì)的其他技術(shù)更為強(qiáng)大。我們可以擁有一個(gè)更加繁榮的未來,但我們必須管理風(fēng)險(xiǎn)才能實(shí)現(xiàn)這一目標(biāo)。鑒于存在滅絕性風(fēng)險(xiǎn)的可能性,我們不能僅僅是被動(dòng)應(yīng)對(duì)。在具備這種特性的技術(shù)中,核能、合成生物學(xué)都是常用的例子。

我們必須減輕今天的人工智能技術(shù)風(fēng)險(xiǎn),但超級(jí)智能將需要特殊的處理和協(xié)調(diào)。

起點(diǎn)

對(duì)于我們來說,有許多理念能夠幫助我們更好地把握這一發(fā)展方向。在這里,我們初步提出了我們對(duì)其中三個(gè)問題的思考。

首先,我們需要在主要發(fā)展努力之間進(jìn)行一定程度的協(xié)調(diào),以確保超級(jí)智能的發(fā)展以一種既能確保安全,又能有助于將這些系統(tǒng)與社會(huì)進(jìn)行順利整合的方式進(jìn)行。這可以通過多種方式實(shí)施;全球各主要政府可以設(shè)立一個(gè)項(xiàng)目,讓許多當(dāng)前的努力成為其中的一部分,或者我們可以達(dá)成共識(shí)(在像下文提到的那種新組織的支持下),將前沿人工智能能力每年的增長速度限制在一定速率內(nèi)。

當(dāng)然,個(gè)別公司應(yīng)該被要求以極高的標(biāo)準(zhǔn)行事,履行責(zé)任。

其次,我們可能最終需要類似國際原子能機(jī)構(gòu)(IAEA)的機(jī)構(gòu)來監(jiān)管超級(jí)智能方面的工作;任何超過一定能力(或計(jì)算資源等)門檻的努力都需要受到國際機(jī)構(gòu)的監(jiān)督,該機(jī)構(gòu)可以檢查系統(tǒng)、要求進(jìn)行審計(jì)、測(cè)試產(chǎn)品是否符合安全標(biāo)準(zhǔn),對(duì)部署程度和安全級(jí)別進(jìn)行限制等等。追蹤計(jì)算資源和能源的使用情況可以在很大程度上幫助我們實(shí)現(xiàn)這一想法。

第一步,公司可以自愿同意開始實(shí)施該機(jī)構(gòu)某一天可能要求的要素;第二步,各個(gè)國家可以實(shí)施。重要的是,這樣的機(jī)構(gòu)應(yīng)該專注于降低滅絕性風(fēng)險(xiǎn),而不是解決應(yīng)該由各個(gè)國家決定的問題,比如定義人工智能應(yīng)該允許說些什么。

第三步,我們需要具備使超級(jí)智能系統(tǒng)安全的技術(shù)能力。這是一個(gè)開放的研究問題,我們和其他人都在付出很多努力來解決這個(gè)問題。

監(jiān)管范圍

我們認(rèn)為,允許公司和開源項(xiàng)目開發(fā)低于重要能力閾值的模型是很重要的,他們不需要我們?cè)谶@里描述的那種監(jiān)管(包括繁瑣的許可證或?qū)徲?jì)等機(jī)制)。

當(dāng)前的系統(tǒng)將為世界創(chuàng)造巨大的價(jià)值,盡管它們確實(shí)存在風(fēng)險(xiǎn),但這些風(fēng)險(xiǎn)的水平似乎與其他互聯(lián)網(wǎng)技術(shù)相當(dāng),并且社會(huì)的應(yīng)對(duì)方式似乎是適當(dāng)?shù)摹?/span>

相比之下,我們所關(guān)注的系統(tǒng)將擁有超越目前任何技術(shù)的力量,我們應(yīng)該小心,不要通過將類似的標(biāo)準(zhǔn)應(yīng)用于遠(yuǎn)遠(yuǎn)低于這一水平的技術(shù)來削弱對(duì)它們的關(guān)注。

公眾意見及潛力

然而,對(duì)于最強(qiáng)大的系統(tǒng)的治理以及它們的部署決策,必須進(jìn)行嚴(yán)格的公眾監(jiān)督。我們認(rèn)為,全世界的人們應(yīng)該民主地決定 AI 系統(tǒng)的范圍和默認(rèn)設(shè)置。我們尚不清楚如何設(shè)計(jì)這樣的機(jī)制,但我們計(jì)劃對(duì)它的發(fā)展進(jìn)行試驗(yàn)。我們?nèi)匀徽J(rèn)為,在這些廣泛的范圍內(nèi),個(gè)體用戶應(yīng)該對(duì)所使用的 AI 的行為有很大的控制權(quán)。

考慮到風(fēng)險(xiǎn)和困難,為什么要構(gòu)建這項(xiàng)技術(shù)是一個(gè)值得思考的問題。

在 OpenAI,我們有兩個(gè)基本出發(fā)點(diǎn)。首先,我們相信超級(jí)智能將帶來一個(gè)比我們今天所能想象的世界更美好的未來(我們已經(jīng)在教育、創(chuàng)造性工作和個(gè)人生產(chǎn)力等領(lǐng)域看到了早期的例子)。世界面臨著許多需要我們更多幫助才能解決的問題;這項(xiàng)技術(shù)可以改善我們的社會(huì),每個(gè)人使用這些新工具的創(chuàng)造能力肯定會(huì)讓我們大吃一驚。經(jīng)濟(jì)增長和生活質(zhì)量的提高將令人震驚。

原文鏈接:https://openai.com/blog/governance-of-superintelligence

評(píng)論

圖片

表情