無人機(jī)視覺導(dǎo)航,還有哪些問題需要解決?

點(diǎn)擊上方“小白學(xué)視覺”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時(shí)間送達(dá)

本文轉(zhuǎn)載自航空工業(yè)電子

時(shí)間砥礪信仰,歲月見證初心。在公司成立15周年之際,航空工業(yè)電子推出“博士說”系列專題,定期更新內(nèi)容,歡迎關(guān)注和支持。

博 士 說 · 2022

·

導(dǎo)語

目前國(guó)內(nèi)外都在致力于針對(duì)無人機(jī)的GNSS拒止條件下的定位導(dǎo)航研究。其中視覺導(dǎo)航(Vision-Based Navigation,VBN)因抗干擾能力強(qiáng)、功耗低、成本低、體積小、設(shè)備結(jié)構(gòu)簡(jiǎn)單、被動(dòng)式、定位精度高等優(yōu)點(diǎn)得到了廣泛關(guān)注。近幾年隨著AI在計(jì)算機(jī)視覺領(lǐng)域的爆發(fā),不僅突破了之前很多難以解決的視覺難題,更極大提升了對(duì)圖像認(rèn)知的水平,因此VBN迅速成為導(dǎo)航領(lǐng)域的研究熱點(diǎn)。但是目前的技術(shù)還存在哪些問題需要解決呢?

1

引言

目前的組合導(dǎo)航系統(tǒng)基本上是以INS為主GNSS等為輔的導(dǎo)航方式。INS存在誤差積累,因此需要GNSS進(jìn)行修正,但GNSS衛(wèi)星信號(hào)落地功率僅-130dbm,頻段公開,極易被干擾,當(dāng)GNSS信號(hào)被干擾時(shí),一般情況下可以利用IMU進(jìn)行航位推算,但隨著時(shí)間的推移,誤差累計(jì)嚴(yán)重,無人機(jī)無法完成預(yù)定任務(wù),甚至難以返航。因此在GPS拒止區(qū)域(如室內(nèi)、水下、叢林、城市樓群間、高山峽谷、作戰(zhàn)敵方干擾區(qū)等)如何完成無人機(jī)在自主飛行、定位、執(zhí)行任務(wù)是一個(gè)迫切的挑戰(zhàn)。

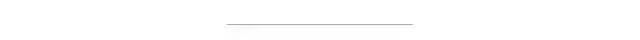

美國(guó)于2014年開始發(fā)展5項(xiàng)不依賴于GPS的導(dǎo)航技術(shù),包括Micro-PNT、ANS等項(xiàng)目。美國(guó)的諾斯羅普?格魯曼公司提出的Assured PNT(ASSURED POSITIONING, NAVIGATION AND TIMING)系統(tǒng)中,包含了對(duì)GPS拒止條件下的各類輔助導(dǎo)航方式,包括天文導(dǎo)航、地形匹配、激光測(cè)距/激光雷達(dá)、磁力計(jì)、里程計(jì)等方式。

圖1 諾格公司的Assured PNT系統(tǒng)

視覺導(dǎo)航主要是指通過飛行器機(jī)載的視覺成像設(shè)備(可見光、紅外、SAR 等)對(duì)地拍照的圖像進(jìn)行各種導(dǎo)航參數(shù)的測(cè)量。視覺導(dǎo)航定位技術(shù)是通過圖像匹配算法結(jié)合含有地理位置信息的基準(zhǔn)圖實(shí)現(xiàn)的。

目前視覺導(dǎo)航按照是否需要導(dǎo)航地圖(即數(shù)字景象基準(zhǔn)數(shù)據(jù)庫(kù))可分為地圖型導(dǎo)航和無地圖導(dǎo)航。地圖型導(dǎo)航需要使用預(yù)先存儲(chǔ)包含精確地理信息的導(dǎo)航地圖,利用一幀實(shí)拍圖像與導(dǎo)航地圖匹配即可實(shí)現(xiàn)飛行器的絕對(duì)定位。當(dāng)導(dǎo)航地圖采用景象圖或地形圖時(shí),地圖導(dǎo)航可分為景象匹配導(dǎo)航和地形匹配導(dǎo)航。由于景象匹配制導(dǎo)的精度比地形匹配制導(dǎo)的精度高一個(gè)數(shù)量級(jí),因此地形匹配制導(dǎo)一般用于中制導(dǎo),景象匹配制導(dǎo)一般用于末制導(dǎo)。

2

國(guó)內(nèi)外研究現(xiàn)狀以及存在的問題

景象匹配系統(tǒng)

國(guó)外對(duì)景象匹配系統(tǒng)的研究始于巡航導(dǎo)彈的制導(dǎo)。景象匹配制導(dǎo)利用目標(biāo)區(qū)的圖像信息進(jìn)行制導(dǎo),主要攻擊目標(biāo)為機(jī)場(chǎng)、交通樞紐、軍事基地等等。導(dǎo)彈的制導(dǎo)精度取決于實(shí)時(shí)圖質(zhì)量、基準(zhǔn)圖精度和匹配方法性能等。該方法實(shí)質(zhì)上是一種基于模板匹配的目標(biāo)定位方法。

景象匹配輔助導(dǎo)航系統(tǒng)具有自主性和高精度的突出優(yōu)點(diǎn),然而該技術(shù)仍未達(dá)到完全成熟的程度。景象匹配一般結(jié)合衛(wèi)星導(dǎo)航、慣性導(dǎo)航和地形匹配導(dǎo)航使用,其作用區(qū)域一般為數(shù)百平方米或數(shù)平方公里且存在以下問題:

(1) 嚴(yán)重依賴于離線基準(zhǔn)圖,是否能夠獲得高精度地圖也是景象匹配問題的關(guān)鍵因素之一,目前其制圖難度較大;

(2) 對(duì)于低空飛行、大起伏地形情況下時(shí)造成的視角變化,目前的算法效果較差;

(3) 由于基準(zhǔn)圖的制作往往較機(jī)載圖像傳感提前很長(zhǎng)時(shí)間,地圖和機(jī)載圖像信息往往可能是在不同日期、不同傳感器、不同觀測(cè)點(diǎn)/角度、不同氣象條件下獲得的,因此需要景象匹配算法具備很強(qiáng)的光照、季節(jié)、角度不變性,而目前的傳統(tǒng)算法基本無法應(yīng)對(duì)不同傳感器、時(shí)間、季節(jié)、角度差下地理面貌發(fā)生的改變;

(4) 景象匹配技術(shù)可以為無人機(jī)提供實(shí)時(shí)的位置信息,因此應(yīng)具備高精度、實(shí)時(shí)計(jì)算等特性。而高精度和實(shí)時(shí)性受景象的特征點(diǎn)集合大小、匹配算法、搜索范圍、地圖大小等多方面的制約,因此基本只適用于小范圍內(nèi)定位導(dǎo)航。

地形匹配導(dǎo)航

地形匹配導(dǎo)航技術(shù)需要飛行路線上的地形數(shù)據(jù)作為基礎(chǔ),在飛行器飛行過程中,將實(shí)際飛行過程中測(cè)量到的地形高程數(shù)據(jù)與基準(zhǔn)地形數(shù)據(jù)進(jìn)行不斷比較來實(shí)現(xiàn)匹配定位,并對(duì)飛行器進(jìn)行導(dǎo)航修正。地形匹配主要利用雷達(dá)高度表和氣壓高度表等設(shè)備測(cè)量沿航線的地形高程數(shù)據(jù),按最佳匹配確定飛行器的地理位置。

地形匹配一般用于巡航導(dǎo)彈飛越特定地區(qū),可以修正INS的導(dǎo)航信息,消除INS的累計(jì)誤差,提高導(dǎo)航精度,但存在以下問題:

(1) 需要地形數(shù)據(jù)作為基礎(chǔ),對(duì)地形要求嚴(yán)格,使用中盡量回避地形特征貧乏的平坦地區(qū)和地形高程變劇烈的山區(qū);

(2) 需要高度表連續(xù)獲取地形高程序列,算法處理屬于后驗(yàn)證估計(jì),實(shí)時(shí)性差,一般用于修正導(dǎo)航誤差;

(3) 對(duì)航向誤差敏感,定位過程中無法機(jī)動(dòng)。

視覺SLAM技術(shù)

視覺SLAM為代表的技術(shù)在視覺導(dǎo)航領(lǐng)域主要以回環(huán)檢測(cè)(Loop Detection)、視覺重定位(Visual Re-localization)、視覺場(chǎng)景識(shí)(Visual Place Recognition)、視覺相對(duì)地形導(dǎo)航(visual terrain relative navigation)或地理配準(zhǔn)、圖像檢索為代表,近年隨著SLAM、深度學(xué)習(xí)和計(jì)算機(jī)視覺技術(shù)的發(fā)展有極大進(jìn)步,尤其以眾多海內(nèi)外高校、無人機(jī)/自動(dòng)駕駛公司為主。

視覺的導(dǎo)航因采集信息豐富、成本低廉,在針對(duì)商用和工業(yè)無人機(jī)的自主降落、避障和跟飛應(yīng)用等特定條件下的研究取得了較大進(jìn)展。在商業(yè)無人機(jī)領(lǐng)域,美國(guó)的Skydio 2使用NVIDIA Jetson TX2的嵌入式AI計(jì)算設(shè)備,計(jì)算6個(gè)4K攝像頭采集到的圖像信息,實(shí)現(xiàn)了全自動(dòng)避障功能。大疆無人機(jī)提出的Flight Autonomy是依靠由6個(gè)視覺傳感器、主相機(jī)、2組紅外傳感器、1組超聲波傳感器、GPS/GLONASS雙模衛(wèi)星定位系統(tǒng)、IMU和指南針雙冗余傳感器等實(shí)現(xiàn)的。當(dāng)GPS信號(hào)丟失時(shí),無人機(jī)利用視覺傳感器與其他傳感器融合,可具備一定的全局定位和導(dǎo)航能力。

雖然目前商用和工業(yè)無人機(jī)、自動(dòng)駕駛領(lǐng)域,暫時(shí)還沒有完全依賴視覺導(dǎo)航的產(chǎn)品,但已有不少高校和公司正在開展了基于視覺的全局定位導(dǎo)航系統(tǒng),如特斯拉的FSD(Full Self-Driving),目前發(fā)布的10.1版本拋棄了高精地圖和激光雷達(dá),主要依靠純視覺和AI可實(shí)現(xiàn)部分復(fù)雜場(chǎng)景下的自動(dòng)駕駛能力,其路測(cè)結(jié)果顯示了視覺的巨大潛力。

定位地圖通常是使用Structure-from-Motion (SfM) 從一組數(shù)據(jù)庫(kù)圖像預(yù)先構(gòu)建3D場(chǎng)景點(diǎn)組成的,每個(gè)3D地標(biāo)可以與一組局部圖像描述符對(duì)應(yīng)。當(dāng)無人機(jī)獲取一張新的觀測(cè)即圖像后,系統(tǒng)可以利用從圖像特征和地標(biāo)之間2D-3D匹配中計(jì)算出相對(duì)或絕對(duì)位置。但是在無人機(jī)SLAM這類應(yīng)用中,因?yàn)榈貥?biāo)描述符的高內(nèi)存要求,將完整場(chǎng)景模型保留在設(shè)備上的定位方法通常僅限于較小的探索空間,如200m*200m。

在大場(chǎng)景(Large Scale)中,一般會(huì)將圖像回傳至地面服務(wù)器去執(zhí)行大規(guī)模的實(shí)時(shí)地圖重建、姿態(tài)估計(jì)、定位和跟蹤,并將結(jié)果回傳至無人機(jī)。但一般情況下如果GPS被干擾時(shí),鏈路的可靠性也難以保證。

SeqSLAM利用連續(xù)幀序列圖像的相似度判斷地點(diǎn)匹配,是目前最成功的閉環(huán)檢測(cè)算法之一,能夠處理重大的環(huán)境條件變化,包括由于照明、天氣和一天中不同的時(shí)段等。但此方法多用于路邊駕駛等情況,對(duì)無人機(jī)在不同高度、角度飛行,且存在空中自由機(jī)動(dòng)的情況還需要繼續(xù)補(bǔ)充研究。

另一方面,當(dāng)場(chǎng)景擴(kuò)大后,環(huán)境的復(fù)雜性會(huì)急劇增加,容易造成感知混淆。感知混淆是一種在不同的地方中產(chǎn)生相似的視覺區(qū)域現(xiàn)象,這通常會(huì)導(dǎo)致錯(cuò)誤的定位,如圖2所示,同一個(gè)場(chǎng)景可能會(huì)檢索定位到地圖中不同的位置,從而造成定位錯(cuò)誤。

圖2 大規(guī)模場(chǎng)景下的(城市級(jí)別)感知混淆

典型無人機(jī)自主視覺感知定位算法多見于地面無人車、機(jī)器人和小型商業(yè)無人機(jī),一般適用于小尺度規(guī)模場(chǎng)景。而傳統(tǒng)的景象匹配算法一般結(jié)合其他導(dǎo)航方式應(yīng)用于末制導(dǎo)等場(chǎng)合,使用條件受限。

GNSS拒止條件下當(dāng)無人機(jī)進(jìn)行長(zhǎng)航程自主飛行時(shí),需要研究解決長(zhǎng)航時(shí)導(dǎo)航地圖的壓縮、存儲(chǔ)瓶頸問題,提升不同季節(jié)、光照、視角下的特征的穩(wěn)健性,提高圖像檢索和匹配算法的泛化性、準(zhǔn)確性,解決大規(guī)模地圖下的實(shí)時(shí)快速的搜索問題等。近年來AI技術(shù)的興起為VBN問題的解決提供了新的方式。

3

GNSS拒止環(huán)境下

VBN待解決的問題和措施

在GNSS信號(hào)受到干擾時(shí)可靠的視覺輔助導(dǎo)航應(yīng)具備高度的條件(季節(jié)、結(jié)構(gòu)、光照、異源傳感器等)和視角(不同視角、飛行高度)不變性,能夠部署在無人機(jī)的邊緣終端。

視角和外觀不變性的穩(wěn)健圖像/地圖表征

視覺導(dǎo)航某種程度上可以被視為一個(gè)圖像檢索任務(wù),必須使用相同的特征類型進(jìn)行模型構(gòu)建和匹配。當(dāng)無人機(jī)達(dá)到一定飛行高度,可以假設(shè)平面單應(yīng)性,但對(duì)地形變化較大的地區(qū)依然具備一定透視效果。機(jī)載圖像與地圖基準(zhǔn)圖像的成像時(shí)間、成像條件不同,即使經(jīng)過預(yù)處理校正后,依然可能會(huì)存在不同程度的光照差別、旋轉(zhuǎn)與角度變化、季節(jié)變化、植被變化等,如果地圖表征不當(dāng),極易導(dǎo)致錯(cuò)誤匹配,需要提取穩(wěn)健的成像條件不變性和視角、尺度不變性的地圖場(chǎng)景表征。同時(shí),考慮到機(jī)載計(jì)算平臺(tái)有限的存儲(chǔ)資源和計(jì)算資源,因此地圖場(chǎng)景表征同時(shí)也要具備高效、低冗余描述等特點(diǎn)。

場(chǎng)景和地圖的描述通常分為局部特征描述子(例如SIFT和SURF特征)以及全局描述子(如Gist等)。局部特征描述在像素級(jí)別上使用固定的局部空間鄰域進(jìn)行優(yōu)化描述,具備視角旋轉(zhuǎn)不變性且可實(shí)現(xiàn)高精度的定位;而全局描述子對(duì)位置進(jìn)行了優(yōu)化,通常在直接對(duì)外觀和光照變化方面魯棒性更強(qiáng),但增加視角不變性將不可避免地降低一定程度的外觀不變性。

因此需要采用基于深度學(xué)習(xí)將核心的局部特征納入全局描述符形成新的表征,學(xué)習(xí)過程采用基于注意力機(jī)制,例如Transformers和圖神經(jīng)網(wǎng)絡(luò)(Graph Neural Networks)。這其中,網(wǎng)絡(luò)的底層輸出對(duì)外觀變化更具備穩(wěn)健性,而高層輸出對(duì)視角變換更具備穩(wěn)健性,因此學(xué)習(xí)到的特征能夠有效地應(yīng)對(duì)環(huán)境以及視角的變化。比如SuperPoint、D2、R2D2等深度學(xué)習(xí)特征代替?zhèn)鹘y(tǒng)SIFT、SURF等局部特征,具備更好的視角不變性;采用如NetVLAD、CALC等用神經(jīng)網(wǎng)絡(luò)模擬傳統(tǒng)特征提取策略,可獲得更好的魯棒性。

實(shí)時(shí)可靠的高精度視覺導(dǎo)航匹配

當(dāng)GNSS信號(hào)丟失時(shí)間較長(zhǎng)時(shí),慣導(dǎo)的定位誤差累積,需要視覺導(dǎo)航在較大范圍內(nèi)進(jìn)行搜索,這樣會(huì)極大增加匹配算法的計(jì)算量。雖然利用語義和傳統(tǒng)圖像檢索技術(shù),可以粗篩出一組與當(dāng)前機(jī)載圖像相似的地圖圖像,供后續(xù)精細(xì)搜索,但隨著地圖和搜索規(guī)模的擴(kuò)大,視覺導(dǎo)航的感知混疊現(xiàn)象越來越嚴(yán)重,粗篩的結(jié)果會(huì)含有越來越多的不相關(guān)。因此需要研究快速的圖像檢索和圖像匹配技術(shù)。

視覺輔助導(dǎo)航系統(tǒng)的核心是圖像匹配算法的選擇,該算法要解決的關(guān)鍵問題是異源圖像之間的實(shí)時(shí)可靠匹配。大多數(shù)最先進(jìn)的圖像描述和表征都是高維的(維度從512到70,000不等)。隨著無人機(jī)飛行時(shí)間的增加,視覺導(dǎo)航搜索的空間急劇變大,而且當(dāng)無人機(jī)長(zhǎng)期自主時(shí),通常必須使用多個(gè)地圖參考集。若匹配算法過于復(fù)雜,搜索效率將會(huì)降低,會(huì)導(dǎo)致整個(gè)匹配過程耗時(shí)過長(zhǎng),影響導(dǎo)航效果。

因此,設(shè)計(jì)分層的實(shí)時(shí)可靠視覺導(dǎo)航匹配技術(shù)。首先利用,對(duì)高維的描述符空間進(jìn)行投影、量化和聚類,以最小的精度損失提高了最近鄰 (NN)搜索的效率采,用反向索引加速圖像檢索速度,選擇出最佳的候選地點(diǎn)集合(如排名前20個(gè)地點(diǎn))。然后在候選地圖集合中,利用航拍成像條件和地圖信息,利用幾何信息,實(shí)時(shí)解算出飛機(jī)的絕對(duì)位置和姿態(tài)。

此外,場(chǎng)景的語義線索不像像素強(qiáng)度那樣容易受到條件變化的影響,因此可以采用基于深度學(xué)習(xí)的物體檢測(cè)和語義信息分割技術(shù),對(duì)場(chǎng)景進(jìn)行識(shí)別、跟蹤和語義的標(biāo)記,可以剔除部分場(chǎng)景中的無效區(qū)域(如空中云彩等),重點(diǎn)利用外觀不變的對(duì)象如標(biāo)志性建筑形成穩(wěn)定的圖像描述符,可加速地圖匹配和搜索的過程。同時(shí)利用環(huán)境的動(dòng)/靜分割加強(qiáng)無人機(jī)對(duì)地圖場(chǎng)景的理解,可以適應(yīng)地圖一定程度的動(dòng)態(tài)變化。

視覺導(dǎo)航在有限計(jì)算資源機(jī)載平臺(tái)的部署

傳統(tǒng)的視覺輔助導(dǎo)航技術(shù)難以突破在不同場(chǎng)景下的可靠定位瓶頸,基于深度學(xué)學(xué)習(xí)的技術(shù)在場(chǎng)景光照變化大,相機(jī)視野變化大等方面對(duì)傳統(tǒng)方法形成碾壓性優(yōu)勢(shì),是未來基于視覺無人機(jī)導(dǎo)航發(fā)展的必然趨勢(shì)。但是深度學(xué)習(xí)技術(shù)計(jì)算量大,參數(shù)動(dòng)輒百萬級(jí),現(xiàn)有的CPU、FPGA等傳統(tǒng)機(jī)載計(jì)算平臺(tái)難以滿足實(shí)時(shí)性的計(jì)算要求。隨著低成本低功耗的AI加速芯片的推出,可將深度學(xué)習(xí)模型部署到無人機(jī)平臺(tái),利用AI芯片的異構(gòu)加速技術(shù),降低視覺導(dǎo)航流程的時(shí)延,不僅可以實(shí)現(xiàn)態(tài)勢(shì)感知、目標(biāo)識(shí)別跟蹤等任務(wù),更可以利用圖像語義分析的信息,無人機(jī)視覺導(dǎo)航定位,使其更適用與動(dòng)態(tài)環(huán)境下的自主飛行。

·

總結(jié)

視覺導(dǎo)航但因成像時(shí)存在不同季節(jié)、光照、視角、傳感器等原因,其使用收到較大限制。同時(shí),如何處理大規(guī)模地圖的建圖和搜索也是部署到無人機(jī)終端一個(gè)亟待解決的問題。近年來,隨著AI技術(shù)的發(fā)展,國(guó)內(nèi)外各研究機(jī)構(gòu)陸續(xù)開展了VBN問題的研究,并進(jìn)行了各種實(shí)際數(shù)據(jù)采集和應(yīng)用挑戰(zhàn)賽,如近年來ICCV等會(huì)議陸續(xù)推出場(chǎng)景識(shí)別比賽等。后續(xù)可充分借鑒自動(dòng)駕駛、商用無人機(jī)、機(jī)器人等先進(jìn)技術(shù),結(jié)合長(zhǎng)航程自主飛行的傳感器特點(diǎn)、使用需求、計(jì)算資源等進(jìn)行研究和測(cè)試。

本文僅做學(xué)術(shù)分享,如有侵權(quán),請(qǐng)聯(lián)系刪文。

下載1:OpenCV-Contrib擴(kuò)展模塊中文版教程

在「小白學(xué)視覺」公眾號(hào)后臺(tái)回復(fù):擴(kuò)展模塊中文教程,即可下載全網(wǎng)第一份OpenCV擴(kuò)展模塊教程中文版,涵蓋擴(kuò)展模塊安裝、SFM算法、立體視覺、目標(biāo)跟蹤、生物視覺、超分辨率處理等二十多章內(nèi)容。

下載2:Python視覺實(shí)戰(zhàn)項(xiàng)目52講

在「小白學(xué)視覺」公眾號(hào)后臺(tái)回復(fù):Python視覺實(shí)戰(zhàn)項(xiàng)目,即可下載包括圖像分割、口罩檢測(cè)、車道線檢測(cè)、車輛計(jì)數(shù)、添加眼線、車牌識(shí)別、字符識(shí)別、情緒檢測(cè)、文本內(nèi)容提取、面部識(shí)別等31個(gè)視覺實(shí)戰(zhàn)項(xiàng)目,助力快速學(xué)校計(jì)算機(jī)視覺。

下載3:OpenCV實(shí)戰(zhàn)項(xiàng)目20講

在「小白學(xué)視覺」公眾號(hào)后臺(tái)回復(fù):OpenCV實(shí)戰(zhàn)項(xiàng)目20講,即可下載含有20個(gè)基于OpenCV實(shí)現(xiàn)20個(gè)實(shí)戰(zhàn)項(xiàng)目,實(shí)現(xiàn)OpenCV學(xué)習(xí)進(jìn)階。

交流群

歡迎加入公眾號(hào)讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動(dòng)駕駛、計(jì)算攝影、檢測(cè)、分割、識(shí)別、醫(yī)學(xué)影像、GAN、算法競(jìng)賽等微信群(以后會(huì)逐漸細(xì)分),請(qǐng)掃描下面微信號(hào)加群,備注:”昵稱+學(xué)校/公司+研究方向“,例如:”張三 + 上海交大 + 視覺SLAM“。請(qǐng)按照格式備注,否則不予通過。添加成功后會(huì)根據(jù)研究方向邀請(qǐng)進(jìn)入相關(guān)微信群。請(qǐng)勿在群內(nèi)發(fā)送廣告,否則會(huì)請(qǐng)出群,謝謝理解~