快速回顧 R-CNN Family

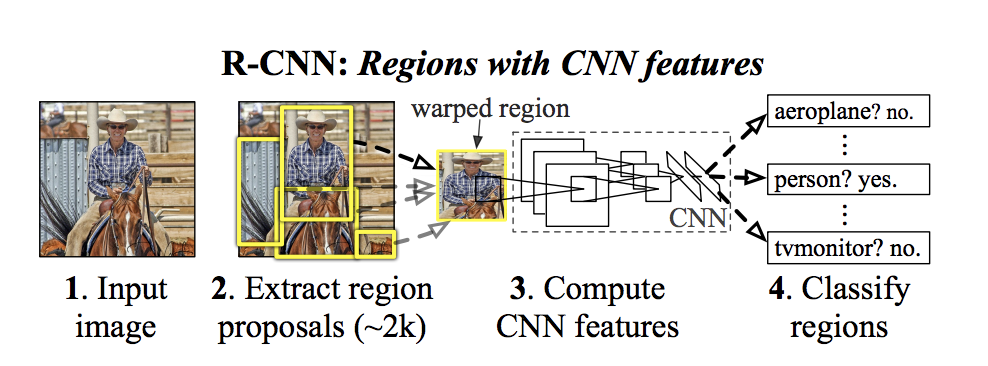

Region-based Convolutional Neural Networks (基于區(qū)域的CNN)

主要思想:使用selecting search,它可以確定候選框的數(shù)量和ROI。然后從每個(gè)區(qū)域中獨(dú)立提取CNN特征進(jìn)行分類

Model Workflow

1、預(yù)訓(xùn)練CNN網(wǎng)絡(luò),例如對(duì)VGG或ResNet進(jìn)行ImageNet數(shù)據(jù)集訓(xùn)練

2、通過(guò)seective search提出 proposal regions(ROI),這些區(qū)域可能包含目標(biāo)對(duì)象,并且它們的大小不同

3、將proposal regions warped成相同大小,這是由于CNN要求輸入相同的大小

4、微調(diào)CNN

5、給定每個(gè)圖像區(qū)域,通過(guò)CNN的一次正向傳播會(huì)提取特征向量。使用SVM進(jìn)行分類。

6、減小localization error,訓(xùn)練回歸模型來(lái)調(diào)整預(yù)測(cè)的bounding box

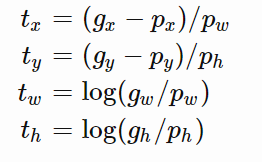

Bounding Box Regression

g=(gx,gy,gw,gh)的中心進(jìn)行尺度不變變換scale-invariant,高度和寬度進(jìn)行對(duì)數(shù)尺度變換log-scale transformation

標(biāo)準(zhǔn)回歸模型可以通過(guò)正則化將SSE loss最小化來(lái)解決

值得注意的是并非所有的 predicted bounding 都有 ground truth box,在這里僅保留IOU大于0.6的predicted bounding用于bbox 回歸模型的訓(xùn)練

NMS(Non-Maximum Suppression)

Speed Bottleneck

(2)整個(gè)過(guò)程缺少shared computation,整個(gè)過(guò)程包括CNN提出特征和SVM分類和回歸模型預(yù)測(cè)bounding box

Fast R-CNN

主要思想:為了加速R-CNN,將三個(gè)獨(dú)立的模塊統(tǒng)一到一個(gè)共同的訓(xùn)練框架中并且增加了共享計(jì)算結(jié)果(shared computation result)來(lái)改進(jìn)訓(xùn)練過(guò)程。不在為每一個(gè)region proposal提出CNN特征,而是對(duì)整個(gè)圖像提出特征,所有region proposal共享這個(gè)特征矩陣。

ROI Pooling

1、首先,在圖像分類任務(wù)上預(yù)訓(xùn)練CNN網(wǎng)絡(luò)

2、通過(guò)選擇性搜索Propose regions

3、更改預(yù)訓(xùn)練的CNN:

(1)用RoI pooling layer替換經(jīng)過(guò)預(yù)訓(xùn)練的CNN的最后一個(gè)最大池化層。RoI pooling layer輸出region proposals的固定長(zhǎng)度特征向量。共享CNN計(jì)算非常有意義,因?yàn)橥粓D像的許多Propose regions高度重疊。

(2)將最后一個(gè)完全連接的層和最后一個(gè)softmax層(K個(gè)類)替換為一個(gè)完全連接的層,并在K + 1個(gè)類上替換softmax。

4、最后,模型分為兩個(gè)輸出層:

(1)K + 1類的softmax估計(jì)量(與R-CNN中相同,+ 1是“背景”類),每個(gè)RoI輸出離散的概率分布。

(2)bounding - box 回歸模型,針對(duì)K個(gè)類別中的每個(gè)類別,相對(duì)于原始RoI預(yù)測(cè)偏移。

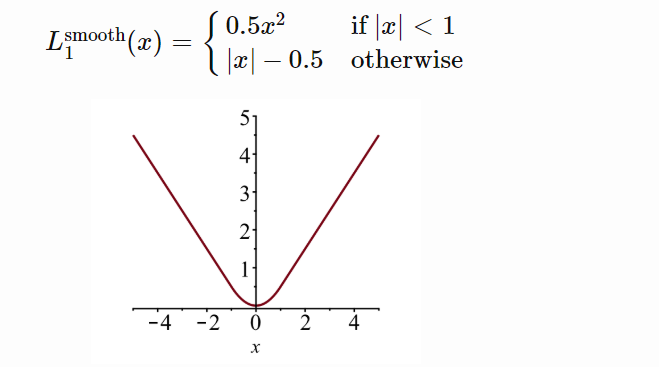

多任務(wù)loss function 結(jié)合了classification loss和bounding box regression

忽略背景ROI,即那些分類為無(wú)類別的ROI

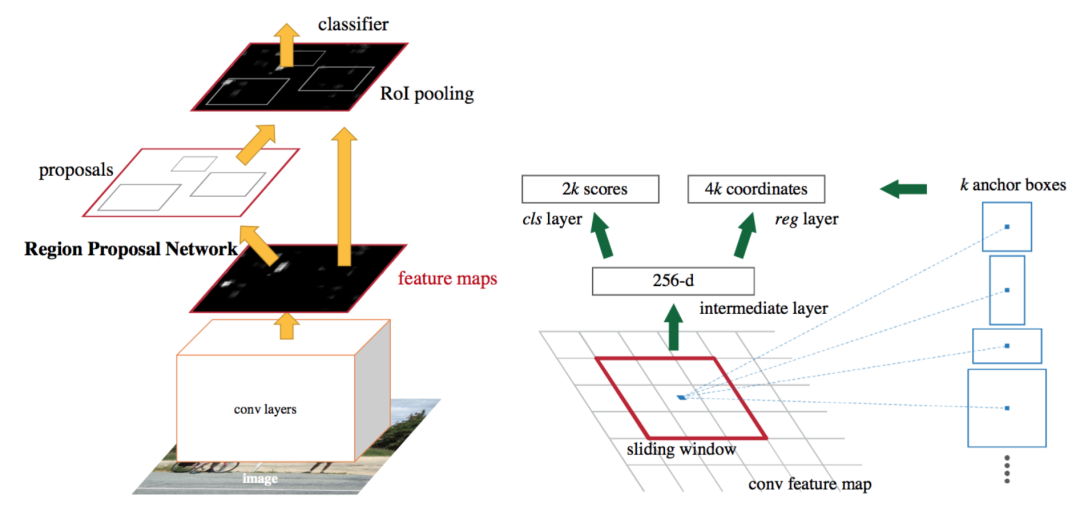

Faster R-CNN

主要思想:它是第一個(gè)端到端,第一個(gè)近實(shí)時(shí)的深度學(xué)習(xí)檢測(cè)器。它的主要貢獻(xiàn)是引入了 RPN,使區(qū)域提議近乎無(wú)時(shí)間損耗。它將區(qū)域提議、特征提取、邊界框回歸集成在一個(gè)統(tǒng)一的,端到端框架中。通過(guò)構(gòu)建一個(gè)RPN(regionproposal network)和具有共享卷積特征層的Fast R-CNN。

1、預(yù)訓(xùn)練CNN

2、微調(diào)RPN(region proposal network),該任務(wù)由訓(xùn)練前圖像分類器初始化。正樣本的IoU> 0.7,而負(fù)樣本的IoU <0.3。

在整個(gè)圖像的轉(zhuǎn)換特征圖上滑動(dòng)一個(gè)小的nxn空間窗口。

在每個(gè)滑動(dòng)窗口的中心,我們同時(shí)預(yù)測(cè)各種比例和比率的多個(gè)區(qū)域。anchor是(滑動(dòng)窗口中心,比例,比率)的組合。例如,每個(gè)滑動(dòng)位置有3個(gè)比例+ 3個(gè)比率=> 9個(gè)anchor。

3、使用當(dāng)前RPN生成的 proposals 訓(xùn)練Fast R-CNN的對(duì)象檢測(cè)模型

4、然后使用 Fast R-CNN 網(wǎng)絡(luò)初始化 RPN 訓(xùn)練。在保留共享卷積層的同時(shí),僅微調(diào)RPN特定的層。在這個(gè)階段,RPN和檢測(cè)網(wǎng)絡(luò)具有共享的卷積層

5、最后,微調(diào) Fast R-CNN 的 unique layers

6、如果需要,可以重復(fù)步驟4-5來(lái)訓(xùn)練RPN和Fast R-CNN。

其中

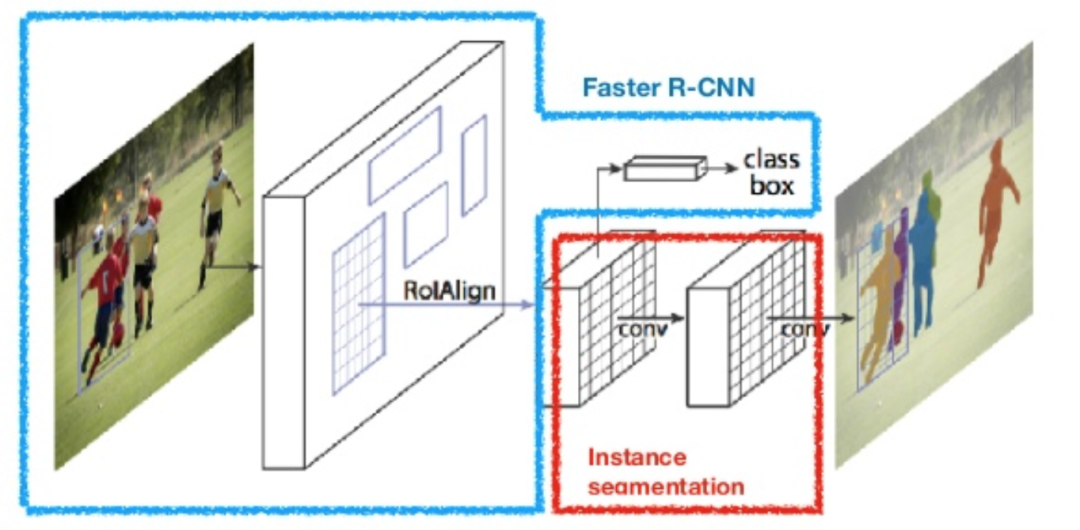

Mask R-CNN

10000+人已加入「大毛CV」

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

敬正在努力的我們!