Kafka面試題系列之進階篇

Kafka目前有哪些內(nèi)部topic,它們都有什么特征?各自的作用又是什么?

__consumer_offsets:作用是保存 Kafka 消費者的位移信息

__transaction_state:用來存儲事務(wù)日志消息

優(yōu)先副本是什么?它有什么特殊的作用?

所謂的優(yōu)先副本是指在AR集合列表中的第一個副本。

理想情況下,優(yōu)先副本就是該分區(qū)的leader 副本,所以也可以稱之為 preferred leader。Kafka 要確保所有主題的優(yōu)先副本在 Kafka 集群中均勻分布,這樣就保證了所有分區(qū)的 leader 均衡分布。以此來促進集群的負(fù)載均衡,這一行為也可以稱為“分區(qū)平衡”。

Kafka有哪幾處地方有分區(qū)分配的概念?簡述大致的過程及原理

生產(chǎn)者的分區(qū)分配是指為每條消息指定其所要發(fā)往的分區(qū)。可以編寫一個具體的類實現(xiàn)org.apache.kafka.clients.producer.Partitioner接口。

消費者中的分區(qū)分配是指為消費者指定其可以消費消息的分區(qū)。Kafka 提供了消費者客戶端參數(shù) partition.assignment.strategy 來設(shè)置消費者與訂閱主題之間的分區(qū)分配策略。

分區(qū)副本的分配是指為集群制定創(chuàng)建主題時的分區(qū)副本分配方案,即在哪個 broker 中創(chuàng)建哪些分區(qū)的副本。kafka-topics.sh 腳本中提供了一個 replica-assignment 參數(shù)來手動指定分區(qū)副本的分配方案。

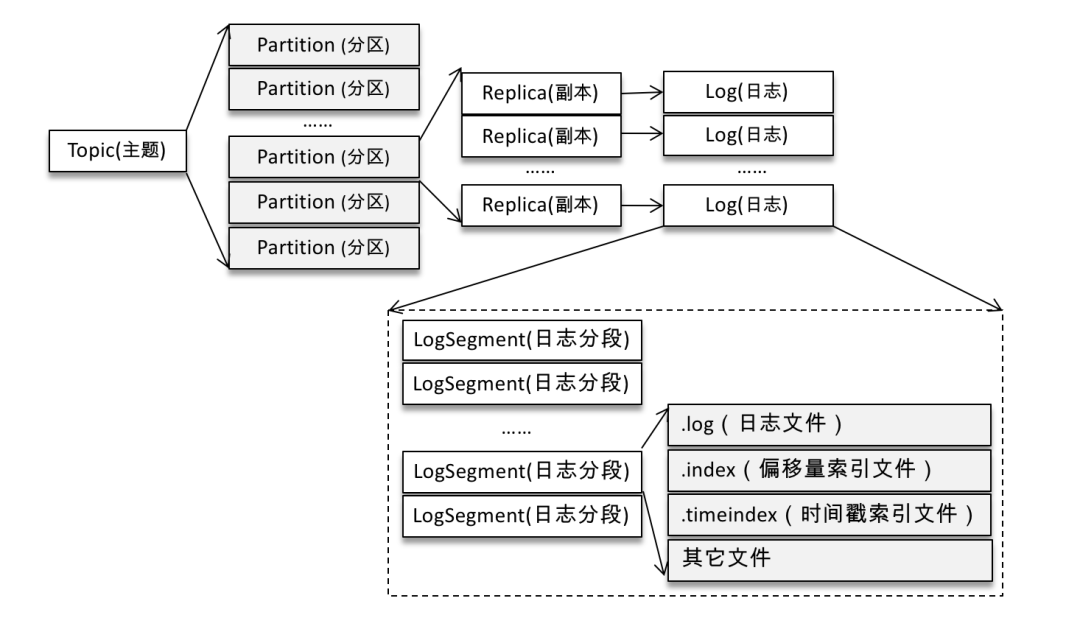

簡述Kafka的日志目錄結(jié)構(gòu)

Kafka 中的消息是以主題為基本單位進行歸類的,各個主題在邏輯上相互獨立。每個主題又可以分為一個或多個分區(qū)。不考慮多副本的情況,一個分區(qū)對應(yīng)一個日志(Log)。為了防止 Log 過大,Kafka 又引入了日志分段(LogSegment)的概念,將 Log 切分為多個 LogSegment,相當(dāng)于一個巨型文件被平均分配為多個相對較小的文件。

Log 和 LogSegment 也不是純粹物理意義上的概念,Log 在物理上只以文件夾的形式存儲,而每個 LogSegment 對應(yīng)于磁盤上的一個日志文件和兩個索引文件,以及可能的其他文件(比如以“.txnindex”為后綴的事務(wù)索引文件)

Kafka中有哪些索引文件?

每個日志分段文件對應(yīng)了兩個索引文件,主要用來提高查找消息的效率。

偏移量索引文件用來建立消息偏移量(offset)到物理地址之間的映射關(guān)系,方便快速定位消息所在的物理文件位置

時間戳索引文件則根據(jù)指定的時間戳(timestamp)來查找對應(yīng)的偏移量信息。

如果我指定了一個offset,Kafka怎么查找到對應(yīng)的消息?

Kafka是通過seek() 方法來指定消費的,在執(zhí)行seek() 方法之前要去執(zhí)行一次poll()方法,等到分配到分區(qū)之后會去對應(yīng)的分區(qū)的指定位置開始消費,如果指定的位置發(fā)生了越界,那么會根據(jù)auto.offset.reset 參數(shù)設(shè)置的情況進行消費。

如果我指定了一個timestamp,Kafka怎么查找到對應(yīng)的消息?

Kafka提供了一個 offsetsForTimes() 方法,通過 timestamp 來查詢與此對應(yīng)的分區(qū)位置。offsetsForTimes() 方法的參數(shù) timestampsToSearch 是一個 Map 類型,key 為待查詢的分區(qū),而 value 為待查詢的時間戳,該方法會返回時間戳大于等于待查詢時間的第一條消息對應(yīng)的位置和時間戳,對應(yīng)于 OffsetAndTimestamp 中的 offset 和 timestamp 字段。

聊一聊你對Kafka的Log Retention的理解

日志刪除(Log Retention):按照一定的保留策略直接刪除不符合條件的日志分段。

我們可以通過 broker 端參數(shù) log.cleanup.policy 來設(shè)置日志清理策略,此參數(shù)的默認(rèn)值為“delete”,即采用日志刪除的清理策略。

基于時間

日志刪除任務(wù)會檢查當(dāng)前日志文件中是否有保留時間超過設(shè)定的閾值(retentionMs)來尋找可刪除的日志分段文件集合(deletableSegments)retentionMs 可以通過 broker 端參數(shù) log.retention.hours、log.retention.minutes 和 log.retention.ms 來配置,其中 log.retention.ms 的優(yōu)先級最高,log.retention.minutes 次之,log.retention.hours 最低。默認(rèn)情況下只配置了 log.retention.hours 參數(shù),其值為168,故默認(rèn)情況下日志分段文件的保留時間為7天。

刪除日志分段時,首先會從 Log 對象中所維護日志分段的跳躍表中移除待刪除的日志分段,以保證沒有線程對這些日志分段進行讀取操作。然后將日志分段所對應(yīng)的所有文件添加上“.deleted”的后綴(當(dāng)然也包括對應(yīng)的索引文件)。最后交由一個以“delete-file”命名的延遲任務(wù)來刪除這些以“.deleted”為后綴的文件,這個任務(wù)的延遲執(zhí)行時間可以通過 file.delete.delay.ms 參數(shù)來調(diào)配,此參數(shù)的默認(rèn)值為60000,即1分鐘。基于日志大小

日志刪除任務(wù)會檢查當(dāng)前日志的大小是否超過設(shè)定的閾值(retentionSize)來尋找可刪除的日志分段的文件集合(deletableSegments)。

retentionSize 可以通過 broker 端參數(shù) log.retention.bytes 來配置,默認(rèn)值為-1,表示無窮大。注意 log.retention.bytes 配置的是 Log 中所有日志文件的總大小,而不是單個日志分段(確切地說應(yīng)該為 .log 日志文件)的大小。單個日志分段的大小由 broker 端參數(shù) log.segment.bytes 來限制,默認(rèn)值為1073741824,即 1GB。

這個刪除操作和基于時間的保留策略的刪除操作相同。基于日志起始偏移量

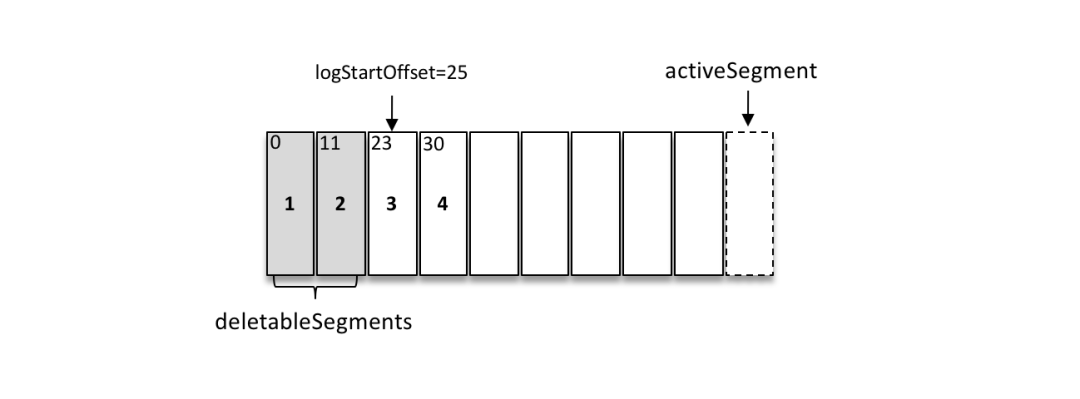

基于日志起始偏移量的保留策略的判斷依據(jù)是某日志分段的下一個日志分段的起始偏移量 baseOffset 是否小于等于 logStartOffset,若是,則可以刪除此日志分段。

如上圖所示,假設(shè) logStartOffset 等于25,日志分段1的起始偏移量為0,日志分段2的起始偏移量為11,日志分段3的起始偏移量為23,通過如下動作收集可刪除的日志分段的文件集合 deletableSegments:

從頭開始遍歷每個日志分段,日志分段1的下一個日志分段的起始偏移量為11,小于 logStartOffset 的大小,將日志分段1加入 deletableSegments。

日志分段2的下一個日志偏移量的起始偏移量為23,也小于 logStartOffset 的大小,將日志分段2加入 deletableSegments。

日志分段3的下一個日志偏移量在 logStartOffset 的右側(cè),故從日志分段3開始的所有日志分段都不會加入 deletableSegments。

收集完可刪除的日志分段的文件集合之后的刪除操作同基于日志大小的保留策略和基于時間的保留策略相同

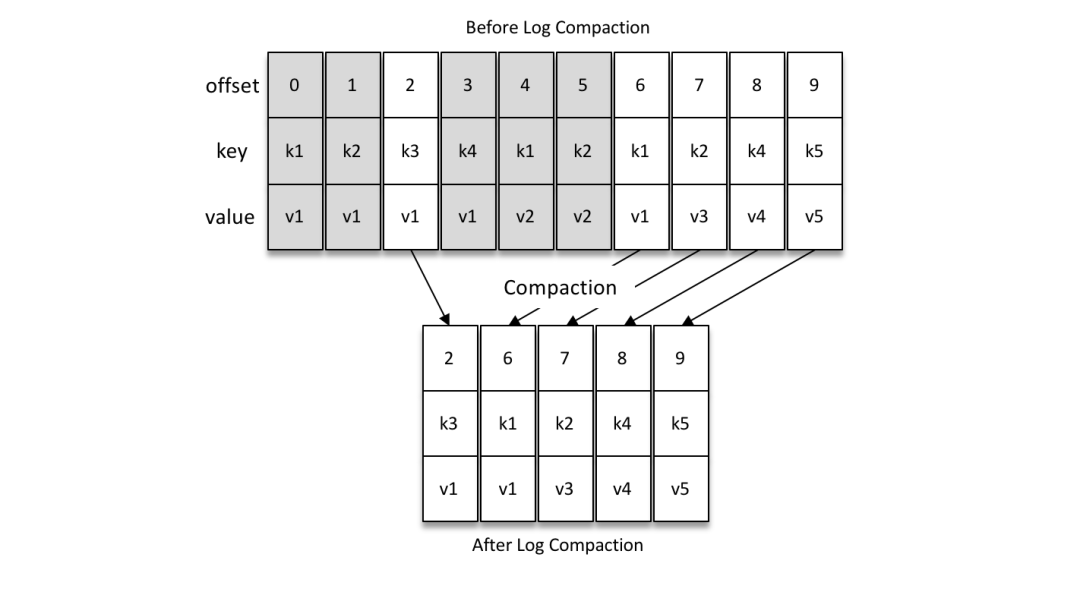

聊一聊你對Kafka的Log Compaction的理解

日志壓縮(Log Compaction):針對每個消息的 key 進行整合,對于有相同 key 的不同 value 值,只保留最后一個版本。

如果要采用日志壓縮的清理策略,就需要將 log.cleanup.policy 設(shè)置為“compact”,并且還需要將 log.cleaner.enable (默認(rèn)值為 true)設(shè)定為 true。

如下圖所示,Log Compaction 對于有相同 key 的不同 value 值,只保留最后一個版本。如果應(yīng)用只關(guān)心 key 對應(yīng)的最新 value 值,則可以開啟 Kafka 的日志清理功能,Kafka 會定期將相同 key 的消息進行合并,只保留最新的 value 值。

聊一聊你對Kafka底層存儲的理解

頁緩存

頁緩存是操作系統(tǒng)實現(xiàn)的一種主要的磁盤緩存,以此用來減少對磁盤 I/O 的操作。具體來說,就是把磁盤中的數(shù)據(jù)緩存到內(nèi)存中,把對磁盤的訪問變?yōu)閷?nèi)存的訪問。

當(dāng)一個進程準(zhǔn)備讀取磁盤上的文件內(nèi)容時,操作系統(tǒng)會先查看待讀取的數(shù)據(jù)所在的頁(page)是否在頁緩存(pagecache)中,如果存在(命中)則直接返回數(shù)據(jù),從而避免了對物理磁盤的 I/O 操作;如果沒有命中,則操作系統(tǒng)會向磁盤發(fā)起讀取請求并將讀取的數(shù)據(jù)頁存入頁緩存,之后再將數(shù)據(jù)返回給進程。

同樣,如果一個進程需要將數(shù)據(jù)寫入磁盤,那么操作系統(tǒng)也會檢測數(shù)據(jù)對應(yīng)的頁是否在頁緩存中,如果不存在,則會先在頁緩存中添加相應(yīng)的頁,最后將數(shù)據(jù)寫入對應(yīng)的頁。被修改過后的頁也就變成了臟頁,操作系統(tǒng)會在合適的時間把臟頁中的數(shù)據(jù)寫入磁盤,以保持?jǐn)?shù)據(jù)的一致性。

用過 Java 的人一般都知道兩點事實:對象的內(nèi)存開銷非常大,通常會是真實數(shù)據(jù)大小的幾倍甚至更多,空間使用率低下;Java 的垃圾回收會隨著堆內(nèi)數(shù)據(jù)的增多而變得越來越慢。基于這些因素,使用文件系統(tǒng)并依賴于頁緩存的做法明顯要優(yōu)于維護一個進程內(nèi)緩存或其他結(jié)構(gòu),至少我們可以省去了一份進程內(nèi)部的緩存消耗,同時還可以通過結(jié)構(gòu)緊湊的字節(jié)碼來替代使用對象的方式以節(jié)省更多的空間。

此外,即使 Kafka 服務(wù)重啟,頁緩存還是會保持有效,然而進程內(nèi)的緩存卻需要重建。這樣也極大地簡化了代碼邏輯,因為維護頁緩存和文件之間的一致性交由操作系統(tǒng)來負(fù)責(zé),這樣會比進程內(nèi)維護更加安全有效。

零拷貝

除了消息順序追加、頁緩存等技術(shù),Kafka 還使用零拷貝(Zero-Copy)技術(shù)來進一步提升性能。所謂的零拷貝是指將數(shù)據(jù)直接從磁盤文件復(fù)制到網(wǎng)卡設(shè)備中,而不需要經(jīng)由應(yīng)用程序之手。零拷貝大大提高了應(yīng)用程序的性能,減少了內(nèi)核和用戶模式之間的上下文切換。對 Linux 操作系統(tǒng)而言,零拷貝技術(shù)依賴于底層的 sendfile() 方法實現(xiàn)。對應(yīng)于 Java 語言,F(xiàn)ileChannal.transferTo() 方法的底層實現(xiàn)就是 sendfile() 方法。

聊一聊Kafka的延時操作的原理

Kafka 中有多種延時操作,比如延時生產(chǎn),還有延時拉取(DelayedFetch)、延時數(shù)據(jù)刪除(DelayedDeleteRecords)等。

延時操作創(chuàng)建之后會被加入延時操作管理器(DelayedOperationPurgatory)來做專門的處理。延時操作有可能會超時,每個延時操作管理器都會配備一個定時器(SystemTimer)來做超時管理,定時器的底層就是采用時間輪(TimingWheel)實現(xiàn)的。

聊一聊Kafka控制器的作用

在 Kafka 集群中會有一個或多個 broker,其中有一個 broker 會被選舉為控制器(Kafka Controller),它負(fù)責(zé)管理整個集群中所有分區(qū)和副本的狀態(tài)。當(dāng)某個分區(qū)的 leader 副本出現(xiàn)故障時,由控制器負(fù)責(zé)為該分區(qū)選舉新的 leader 副本。當(dāng)檢測到某個分區(qū)的 ISR 集合發(fā)生變化時,由控制器負(fù)責(zé)通知所有broker更新其元數(shù)據(jù)信息。當(dāng)使用 kafka-topics.sh 腳本為某個 topic 增加分區(qū)數(shù)量時,同樣還是由控制器負(fù)責(zé)分區(qū)的重新分配。

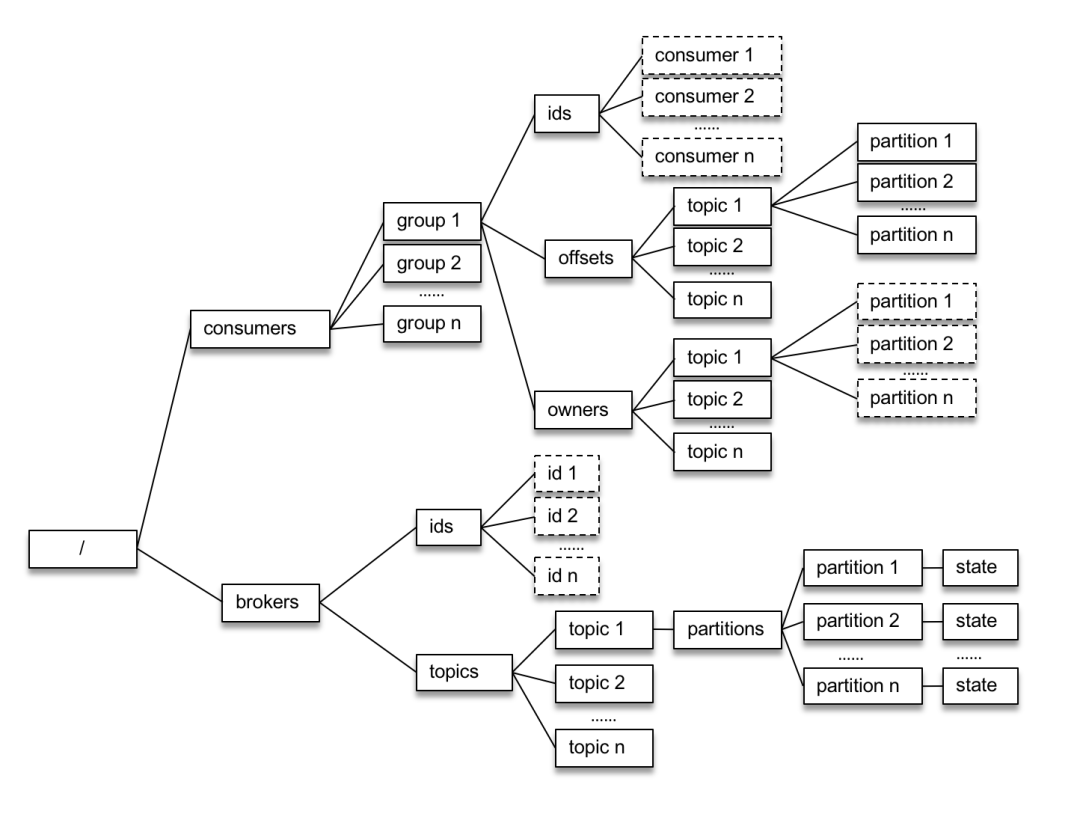

Kafka的舊版Scala的消費者客戶端的設(shè)計有什么缺陷?

如上圖,舊版消費者客戶端每個消費組(

每個消費者在啟動時都會在 /consumers/

這種方式下每個消費者對 ZooKeeper 的相關(guān)路徑分別進行監(jiān)聽,當(dāng)觸發(fā)再均衡操作時,一個消費組下的所有消費者會同時進行再均衡操作,而消費者之間并不知道彼此操作的結(jié)果,這樣可能導(dǎo)致 Kafka 工作在一個不正確的狀態(tài)。與此同時,這種嚴(yán)重依賴于 ZooKeeper 集群的做法還有兩個比較嚴(yán)重的問題。

羊群效應(yīng)(Herd Effect):所謂的羊群效應(yīng)是指ZooKeeper 中一個被監(jiān)聽的節(jié)點變化,大量的 Watcher 通知被發(fā)送到客戶端,導(dǎo)致在通知期間的其他操作延遲,也有可能發(fā)生類似死鎖的情況。

腦裂問題(Split Brain):消費者進行再均衡操作時每個消費者都與 ZooKeeper 進行通信以判斷消費者或broker變化的情況,由于 ZooKeeper 本身的特性,可能導(dǎo)致在同一時刻各個消費者獲取的狀態(tài)不一致,這樣會導(dǎo)致異常問題發(fā)生。

消費再均衡的原理是什么?(提示:消費者協(xié)調(diào)器和消費組協(xié)調(diào)器)

就目前而言,一共有如下幾種情形會觸發(fā)再均衡的操作:

有新的消費者加入消費組。

有消費者宕機下線。消費者并不一定需要真正下線,例如遇到長時間的GC、網(wǎng)絡(luò)延遲導(dǎo)致消費者長時間未向 GroupCoordinator 發(fā)送心跳等情況時,GroupCoordinator 會認(rèn)為消費者已經(jīng)下線。

有消費者主動退出消費組(發(fā)送 LeaveGroupRequest 請求)。比如客戶端調(diào)用了 unsubscrible() 方法取消對某些主題的訂閱。

消費組所對應(yīng)的 GroupCoorinator 節(jié)點發(fā)生了變更。

消費組內(nèi)所訂閱的任一主題或者主題的分區(qū)數(shù)量發(fā)生變化。

GroupCoordinator 是 Kafka 服務(wù)端中用于管理消費組的組件。而消費者客戶端中的 ConsumerCoordinator 組件負(fù)責(zé)與 GroupCoordinator 進行交互。

第一階段(FIND_COORDINATOR)

消費者需要確定它所屬的消費組對應(yīng)的 GroupCoordinator 所在的 broker,并創(chuàng)建與該 broker 相互通信的網(wǎng)絡(luò)連接。如果消費者已經(jīng)保存了與消費組對應(yīng)的 GroupCoordinator 節(jié)點的信息,并且與它之間的網(wǎng)絡(luò)連接是正常的,那么就可以進入第二階段。否則,就需要向集群中的某個節(jié)點發(fā)送 FindCoordinatorRequest 請求來查找對應(yīng)的 GroupCoordinator,這里的“某個節(jié)點”并非是集群中的任意節(jié)點,而是負(fù)載最小的節(jié)點。

第二階段(JOIN_GROUP)

在成功找到消費組所對應(yīng)的 GroupCoordinator 之后就進入加入消費組的階段,在此階段的消費者會向 GroupCoordinator 發(fā)送 JoinGroupRequest 請求,并處理響應(yīng)。

選舉消費組的leader

如果消費組內(nèi)還沒有 leader,那么第一個加入消費組的消費者即為消費組的 leader。如果某一時刻 leader 消費者由于某些原因退出了消費組,那么會重新選舉一個新的 leader

選舉分區(qū)分配策略

收集各個消費者支持的所有分配策略,組成候選集 candidates。

每個消費者從候選集 candidates 中找出第一個自身支持的策略,為這個策略投上一票。

計算候選集中各個策略的選票數(shù),選票數(shù)最多的策略即為當(dāng)前消費組的分配策略。

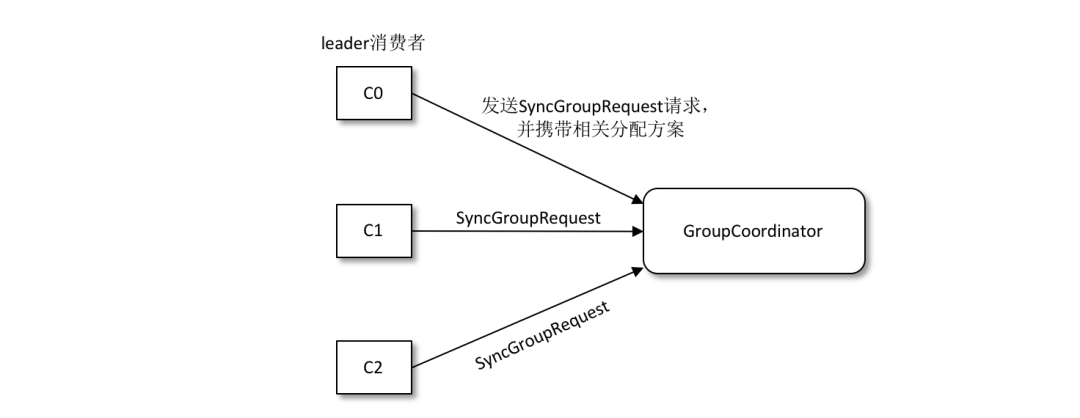

第三階段(SYNC_GROUP)

leader 消費者根據(jù)在第二階段中選舉出來的分區(qū)分配策略來實施具體的分區(qū)分配,在此之后需要將分配的方案同步給各個消費者,通過 GroupCoordinator 這個“中間人”來負(fù)責(zé)轉(zhuǎn)發(fā)同步分配方案的。

第四階段(HEARTBEAT)

進入這個階段之后,消費組中的所有消費者就會處于正常工作狀態(tài)。在正式消費之前,消費者還需要確定拉取消息的起始位置。假設(shè)之前已經(jīng)將最后的消費位移提交到了 GroupCoordinator,并且 GroupCoordinator 將其保存到了 Kafka 內(nèi)部的 __consumer_offsets 主題中,此時消費者可以通過 OffsetFetchRequest 請求獲取上次提交的消費位移并從此處繼續(xù)消費。

消費者通過向 GroupCoordinator 發(fā)送心跳來維持它們與消費組的從屬關(guān)系,以及它們對分區(qū)的所有權(quán)關(guān)系。只要消費者以正常的時間間隔發(fā)送心跳,就被認(rèn)為是活躍的,說明它還在讀取分區(qū)中的消息。心跳線程是一個獨立的線程,可以在輪詢消息的空檔發(fā)送心跳。如果消費者停止發(fā)送心跳的時間足夠長,則整個會話就被判定為過期,GroupCoordinator 也會認(rèn)為這個消費者已經(jīng)死亡,就會觸發(fā)一次再均衡行為。

Kafka中的冪等是怎么實現(xiàn)的?

為了實現(xiàn)生產(chǎn)者的冪等性,Kafka 為此引入了 producer id(以下簡稱 PID)和序列號(sequence number)這兩個概念。

每個新的生產(chǎn)者實例在初始化的時候都會被分配一個 PID,這個 PID 對用戶而言是完全透明的。對于每個 PID,消息發(fā)送到的每一個分區(qū)都有對應(yīng)的序列號,這些序列號從0開始單調(diào)遞增。生產(chǎn)者每發(fā)送一條消息就會將

broker 端會在內(nèi)存中為每一對

推薦閱讀: