高糊圖片可以做什么?

點(diǎn)擊上方“小白學(xué)視覺(jué)”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時(shí)間送達(dá)

本文轉(zhuǎn)自:視學(xué)算法

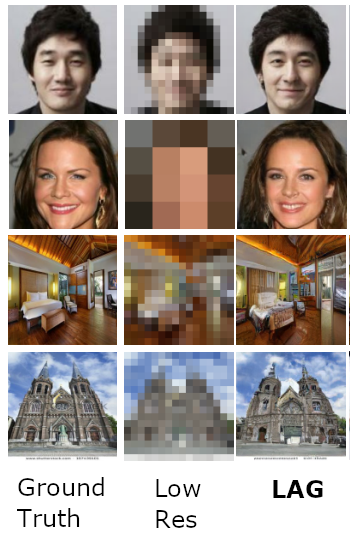

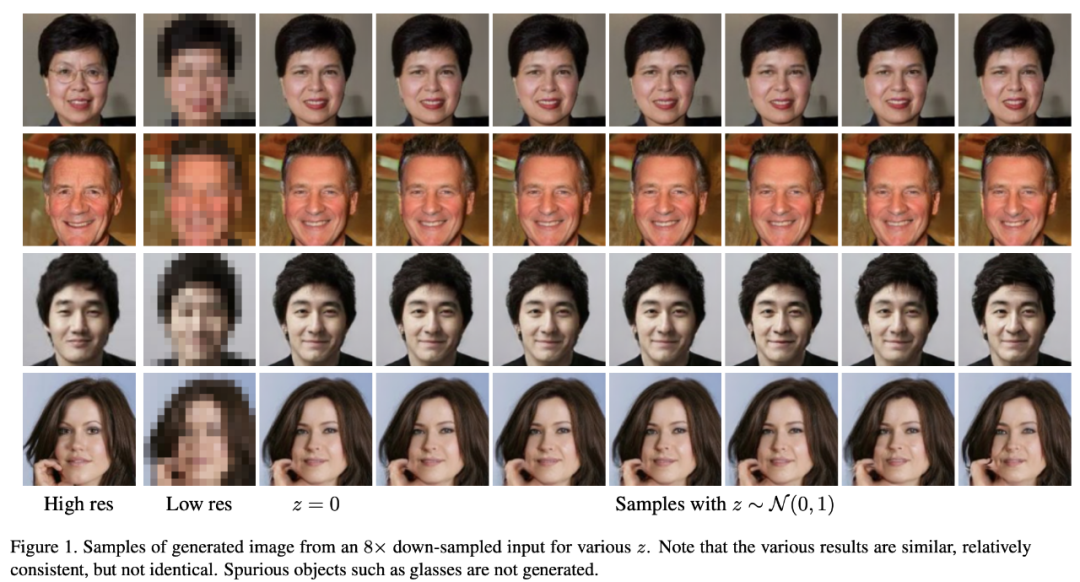

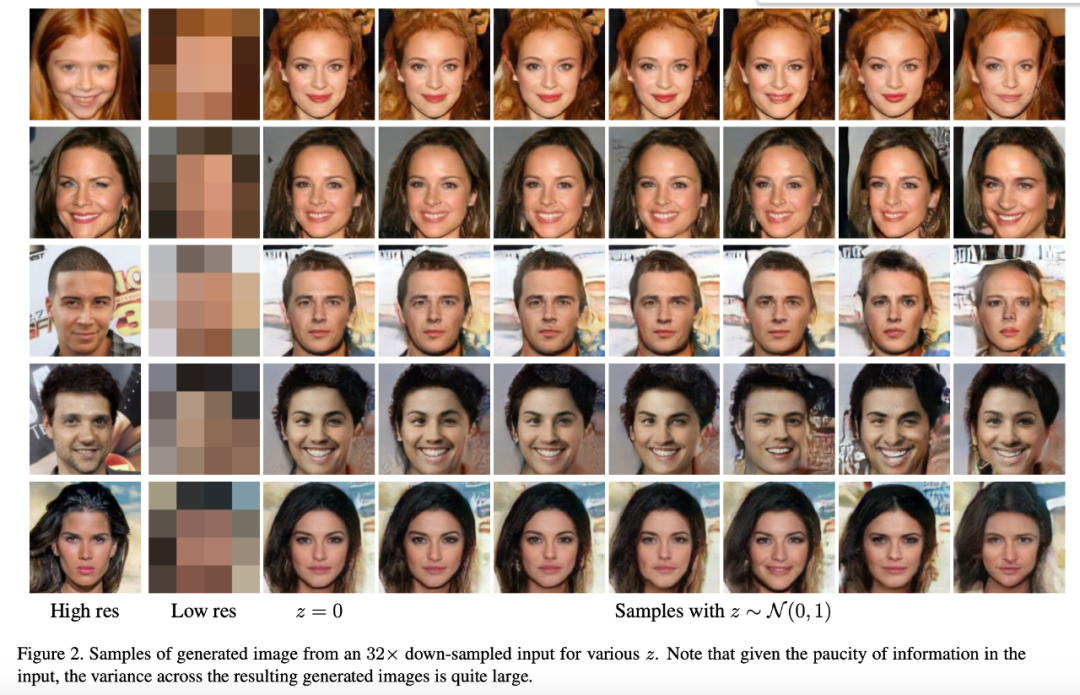

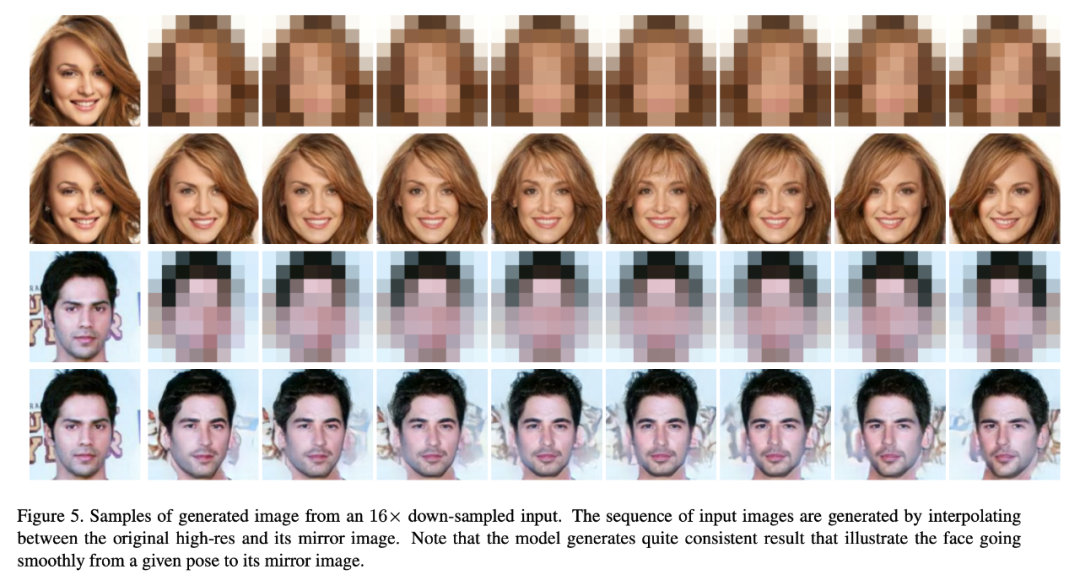

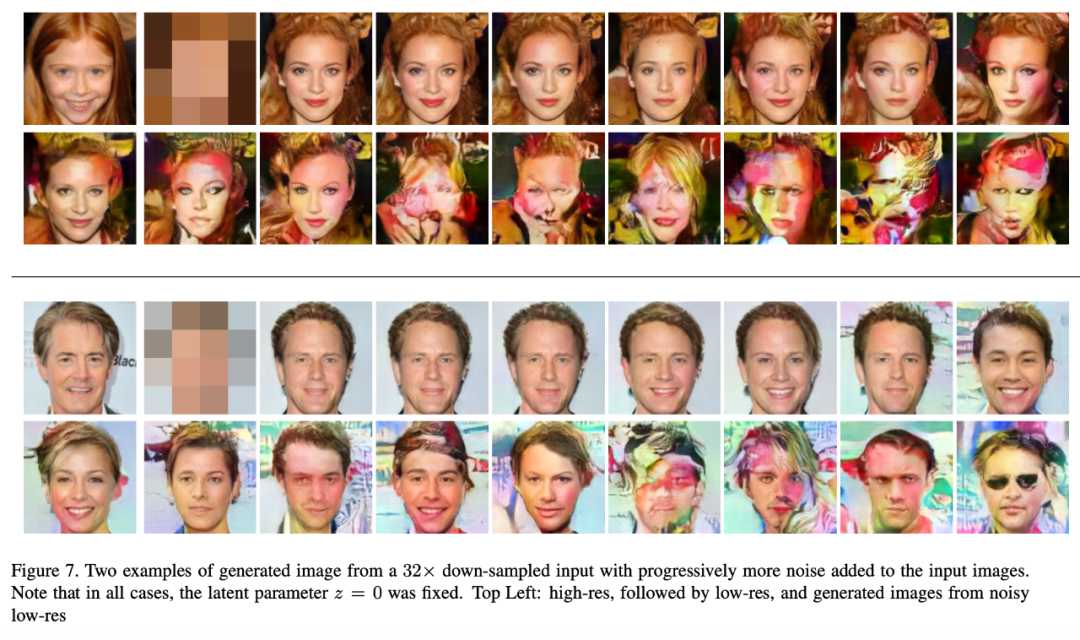

給出一張低分辨率圖像,你可以用它做什么,用機(jī)器學(xué)習(xí)方法將它盡量恢復(fù)原貌?除此之外呢?近日,谷歌 David Berthelot、Peyman Milanfar,以及 Goodfellow 提出了一種名為 LAG 的生成器,可以基于一張低分辨率圖像生成一組合理的高分辨率圖像。

論文鏈接:https://arxiv.org/pdf/2003.02365.pdf

代碼地址:https://github.com/google-research/lag

將輸入圖像建模為一組可能的圖像,而不是單張圖像,即建模了(低分辨率)輸入圖像的流形;

學(xué)習(xí)單個(gè)感知潛在空間,來(lái)描述預(yù)測(cè)和真值之間的距離;

分析條件 GAN(conditional GAN)和 LAG 之間的關(guān)系。

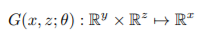

從圖像到潛在空間 p 的投影 P;

從該潛在空間到 R 的映射 F。

交流群

歡迎加入公眾號(hào)讀者群一起和同行交流,目前有SLAM、三維視覺(jué)、傳感器、自動(dòng)駕駛、計(jì)算攝影、檢測(cè)、分割、識(shí)別、醫(yī)學(xué)影像、GAN、算法競(jìng)賽等微信群(以后會(huì)逐漸細(xì)分),請(qǐng)掃描下面微信號(hào)加群,備注:”昵稱+學(xué)校/公司+研究方向“,例如:”張三 + 上海交大 + 視覺(jué)SLAM“。請(qǐng)按照格式備注,否則不予通過(guò)。添加成功后會(huì)根據(jù)研究方向邀請(qǐng)進(jìn)入相關(guān)微信群。請(qǐng)勿在群內(nèi)發(fā)送廣告,否則會(huì)請(qǐng)出群,謝謝理解~

評(píng)論

圖片

表情