SpringBoot整合ELK實(shí)現(xiàn)日志收集

點(diǎn)擊上方藍(lán)色字體,選擇“標(biāo)星公眾號”

優(yōu)質(zhì)文章,第一時間送達(dá)

76套java從入門到精通實(shí)戰(zhàn)課程分享

ELK簡介

ELK是三個開源軟件的縮寫,分別表示:elasticsearch、logstash、kibana

Elasticsearch是個開源分布式搜索引擎,它的特點(diǎn)有:分布式,零配置,自動發(fā)現(xiàn),索引自動分片,索引副本機(jī)制,restful風(fēng)格接口,多數(shù)據(jù)源,自動搜索負(fù)載等。

Logstash是一個完全開源的工具,他可以對你的日志進(jìn)行收集、過濾,并將其存儲供以后使用(如,搜索)。

Kibana也是一個開源和免費(fèi)的工具,它Kibana可以為 Logstash 和 ElasticSearch 提供的日志分析友好的 Web 界面,可以幫助您匯總、分析和搜索重要數(shù)據(jù)日志。

實(shí)現(xiàn)日志收集的方案

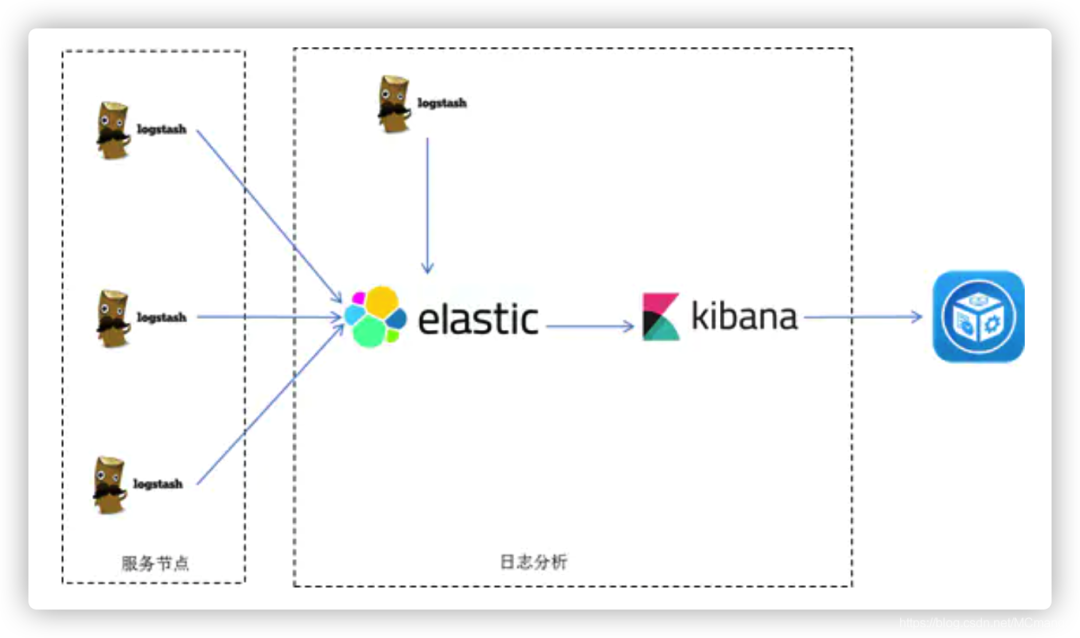

方案一:logstash->elasticsearch->kibana

將logstash部署到每個節(jié)點(diǎn),收集相關(guān)的日志,并經(jīng)過分析過濾后發(fā)送到elasticsearch進(jìn)行存儲,elasticsearch將數(shù)據(jù)以分片的形勢進(jìn)行壓縮存儲,通過kibana對日志進(jìn)行圖形化的展示。

優(yōu)點(diǎn):此架構(gòu)搭建簡單,容易上手

缺點(diǎn):

- 1、每個節(jié)點(diǎn)部署logstash,運(yùn)行時占用CPU,內(nèi)存大,會對節(jié)點(diǎn)性能造成一定的影響

- 2、沒有將日志數(shù)據(jù)進(jìn)行緩存,存在丟失的風(fēng)險

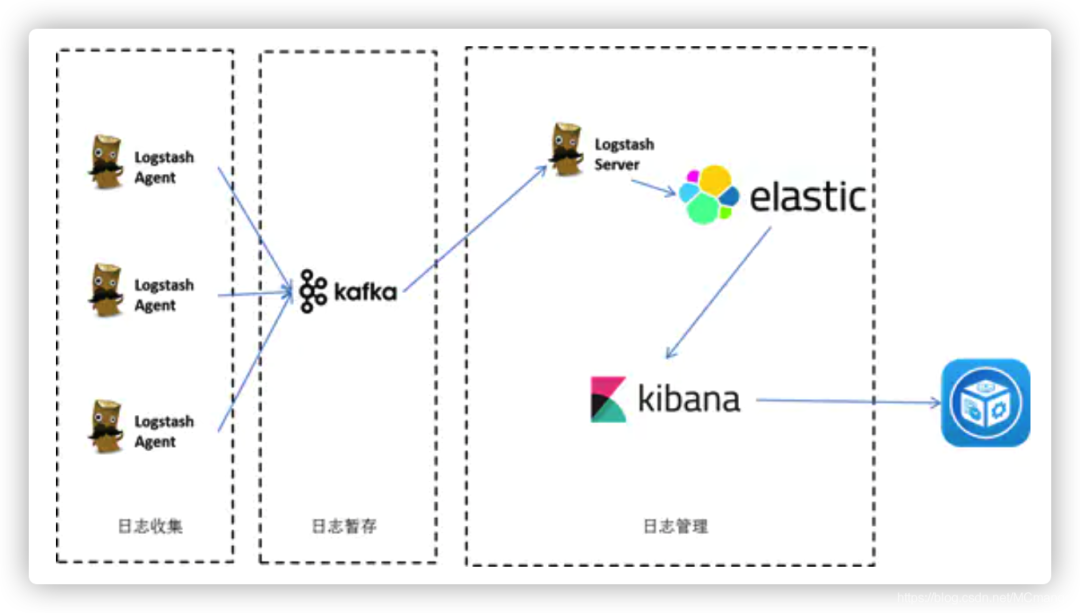

方案二:logstash->kafka->elasticsearch->kibana

logstash agent監(jiān)控過濾日志,將過濾的日志內(nèi)容發(fā)送給Kafka,logstash server將日志收集一起交給elasticsearch,引入了消息隊列機(jī)制作為緩存池,即使logstash server出現(xiàn)異常,由于日志暫存在kafka消息隊列中,能避免日志數(shù)據(jù)丟失,但是還是沒有解決性能問題。

這次選擇的是第一種方案,比較簡單,容易理解

使用docker compose搭建ELK環(huán)境

下載docker鏡像

docker pull elasticsearch:6.4.0

docker pull logstash:6.4.0

docker pull kibana:6.4.0

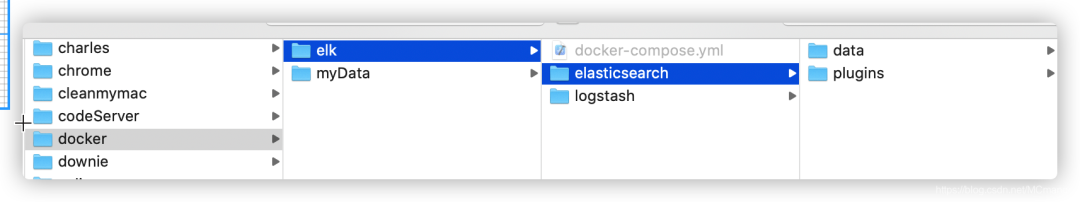

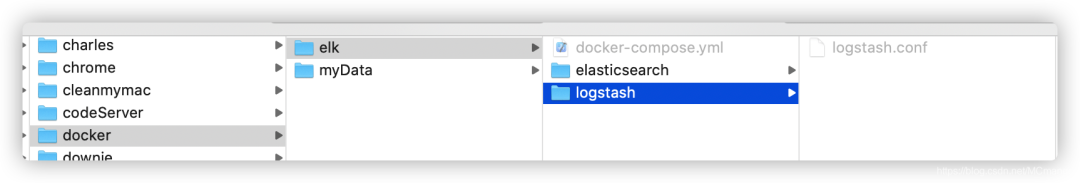

在本地創(chuàng)建好存放文件的目錄

創(chuàng)建elasticsearch和logstash目錄,后面用于存放配置文件

logstash.conf的內(nèi)容:

input {

tcp {

mode => "server"

host => "0.0.0.0"

port => 4560

codec => json_lines

}

}

output {

elasticsearch {

hosts => "es:9200"

index => "springboot-%{+YYYY.MM.dd}"

}

}

使用docker-compose.yml腳本啟動ELK服務(wù)

docker-compose.yml的內(nèi)容為:

version: '3'

services:

elasticsearch:

image: elasticsearch:6.4.0

container_name: elasticsearch

environment:

- "cluster.name=elasticsearch" #設(shè)置集群名稱為elasticsearch

- "discovery.type=single-node" #以單一節(jié)點(diǎn)模式啟動

- "ES_JAVA_OPTS=-Xms512m -Xmx512m" #設(shè)置使用jvm內(nèi)存大小

volumes:

- /Users/mango/Downloads/install/docker/elk/elasticsearch/plugins:/usr/share/elasticsearch/plugins #插件文件掛載

- /Users/mango/Downloads/install/docker/elk/elasticsearch/data:/usr/share/elasticsearch/data #數(shù)據(jù)文件掛載

ports:

- 9200:9200

- 9300:9300

kibana:

image: kibana:6.4.0

container_name: kibana

links:

- elasticsearch:es #可以用es這個域名訪問elasticsearch服務(wù)

depends_on:

- elasticsearch #kibana在elasticsearch啟動之后再啟動

environment:

- "elasticsearch.hosts=http://es:9200" #設(shè)置訪問elasticsearch的地址

ports:

- 5601:5601

logstash:

image: logstash:6.4.0

container_name: logstash

volumes:

- /Users/mango/Downloads/install/docker/elk/logstash/logstash.conf:/usr/share/logstash/pipeline/logstash.conf #掛載logstash的配置文件

depends_on:

- elasticsearch #kibana在elasticsearch啟動之后再啟動

links:

- elasticsearch:es #可以用es這個域名訪問elasticsearch服務(wù)

ports:

- 4560:4560

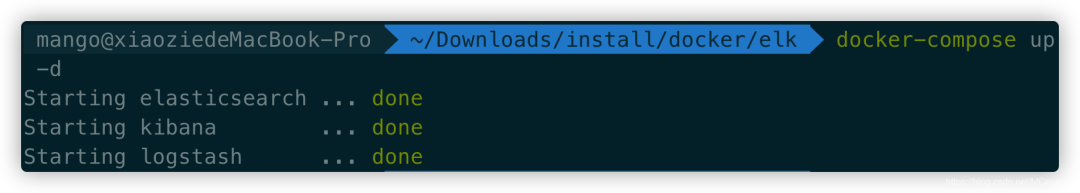

在該文件的目錄下執(zhí)行docker-compose命令運(yùn)行:

docker-compose up -d

之后顯示如下內(nèi)容:

在logstash中安裝json_lines插件

# 進(jìn)入logstash容器(e9c845c8d48e為容器id)

docker exec -it e9c845c8d48e /bin/bash

# 進(jìn)入bin目錄

cd /bin/

# 安裝插件

logstash-plugin install logstash-codec-json_lines

# 退出容器

exit

# 重啟logstash服務(wù)

docker restart logstash

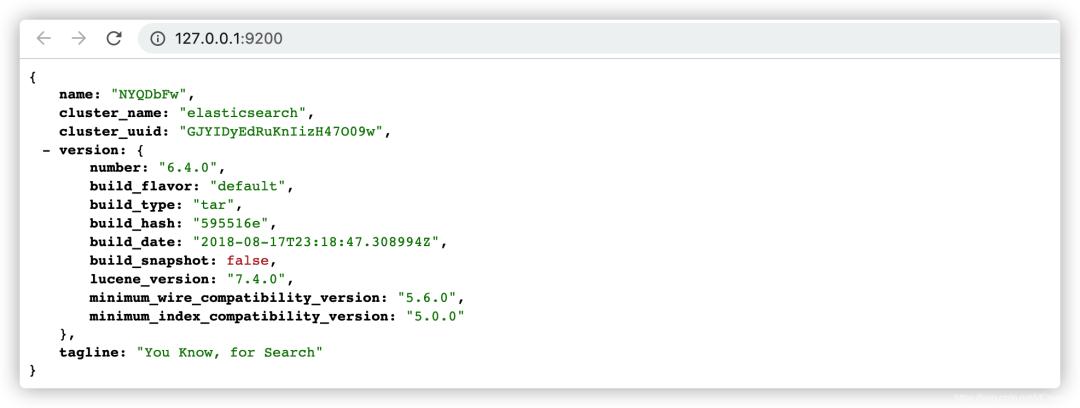

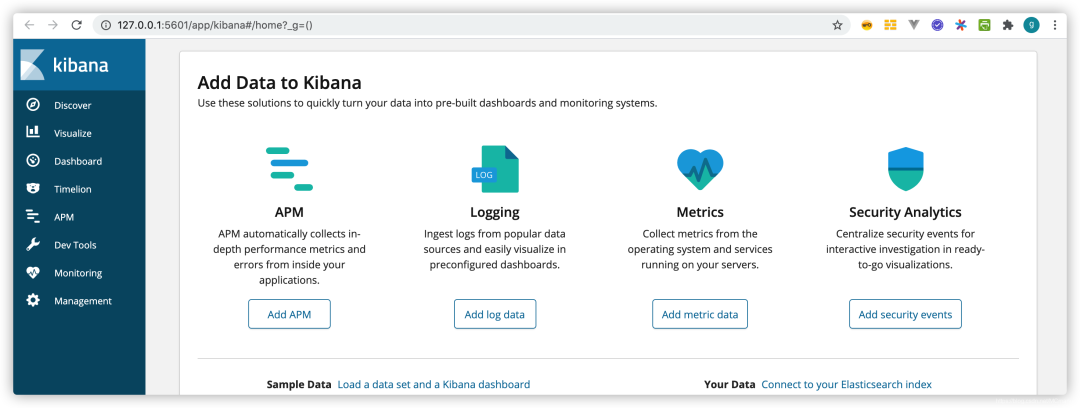

查看界面

訪問地址:http://127.0.0.1:9200/

訪問地址:http://127.0.0.1:5601

Springboot集成logstash

在pom.xml中添加logstash-logback-encoder依賴

<!--集成logstash-->

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>5.3</version>

</dependency>

添加配置文件logback-spring.xml讓logback的日志輸出到logstash

<?xml version="1.0" encoding="UTF-8"?>

<!--該日志將日志級別不同的log信息保存到不同的文件中 -->

<configuration>

<include resource="org/springframework/boot/logging/logback/defaults.xml" />

<springProperty scope="context" name="springAppName"

source="spring.application.name" />

<!-- 日志在工程中的輸出位置 -->

<property name="LOG_FILE" value="${BUILD_FOLDER:-build}/${springAppName}" />

<!-- 控制臺的日志輸出樣式 -->

<property name="CONSOLE_LOG_PATTERN"

value="%clr(%d{yyyy-MM-dd HH:mm:ss.SSS}){faint} %clr(${LOG_LEVEL_PATTERN:-%5p}) %clr(${PID:- }){magenta} %clr(---){faint} %clr([%15.15t]){faint} %m%n${LOG_EXCEPTION_CONVERSION_WORD:-%wEx}}" />

<!-- 控制臺輸出 -->

<appender name="console" class="ch.qos.logback.core.ConsoleAppender">

<filter class="ch.qos.logback.classic.filter.ThresholdFilter">

<level>INFO</level>

</filter>

<!-- 日志輸出編碼 -->

<encoder>

<pattern>${CONSOLE_LOG_PATTERN}</pattern>

<charset>utf8</charset>

</encoder>

</appender>

<!-- 為logstash輸出的JSON格式的Appender -->

<appender name="logstash"

class="net.logstash.logback.appender.LogstashTcpSocketAppender">

<!--可以訪問的logstash日志收集端口-->

<destination>127.0.0.1:4560</destination>

<!-- 日志輸出編碼 -->

<encoder

class="net.logstash.logback.encoder.LoggingEventCompositeJsonEncoder">

<providers>

<timestamp>

<timeZone>UTC</timeZone>

</timestamp>

<pattern>

<pattern>

{

"severity": "%level",

"service": "${springAppName:-}",

"trace": "%X{X-B3-TraceId:-}",

"span": "%X{X-B3-SpanId:-}",

"exportable": "%X{X-Span-Export:-}",

"pid": "${PID:-}",

"thread": "%thread",

"class": "%logger{40}",

"rest": "%message"

}

</pattern>

</pattern>

</providers>

</encoder>

</appender>

<!-- 日志輸出級別 -->

<root level="INFO">

<appender-ref ref="console" />

<appender-ref ref="logstash" />

</root>

</configuration>

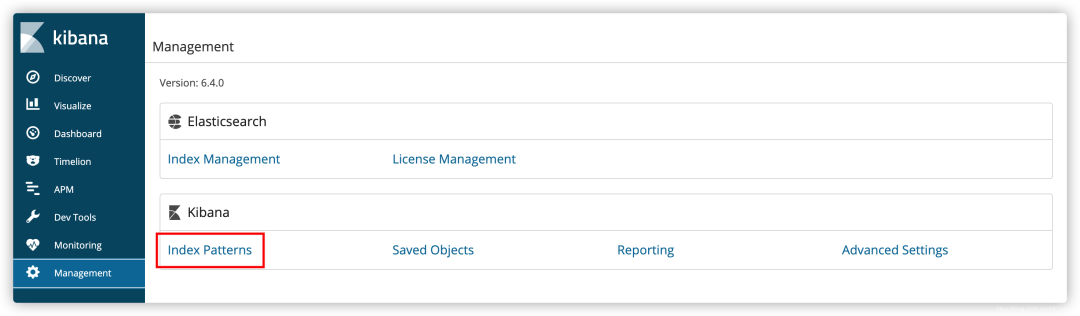

在kibana中查看日志信息

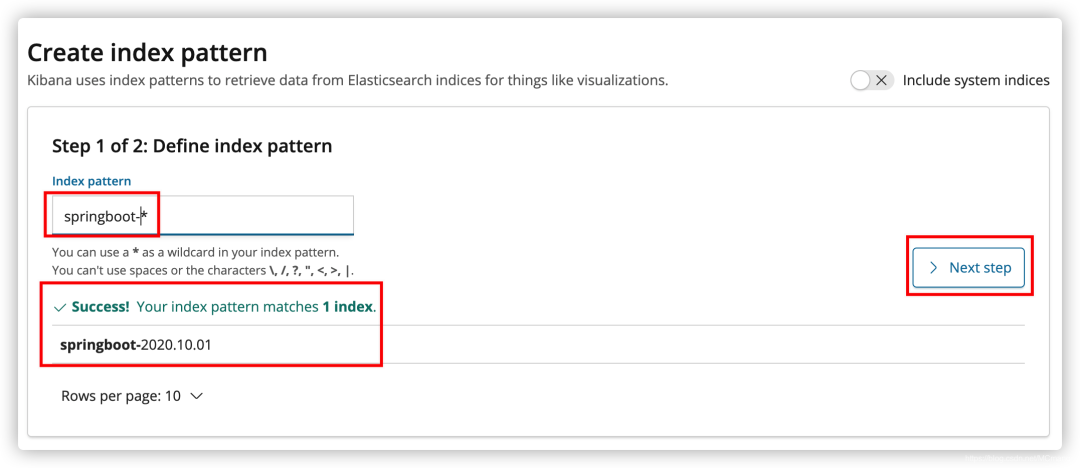

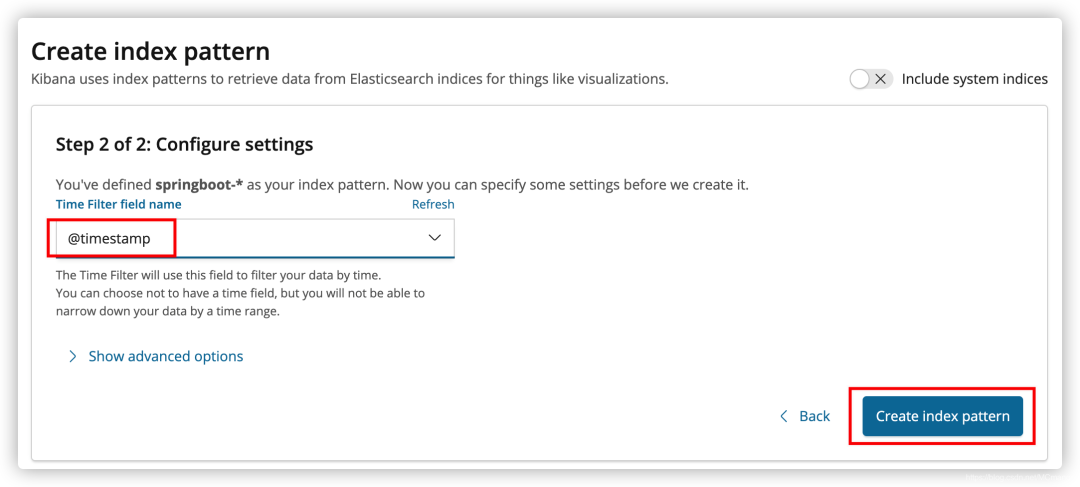

創(chuàng)建index pattern

配置 pattern 輸入springboot-*,匹配相關(guān)數(shù)據(jù)。

選擇時間@timestamp,這樣數(shù)據(jù)展示會以時間排序

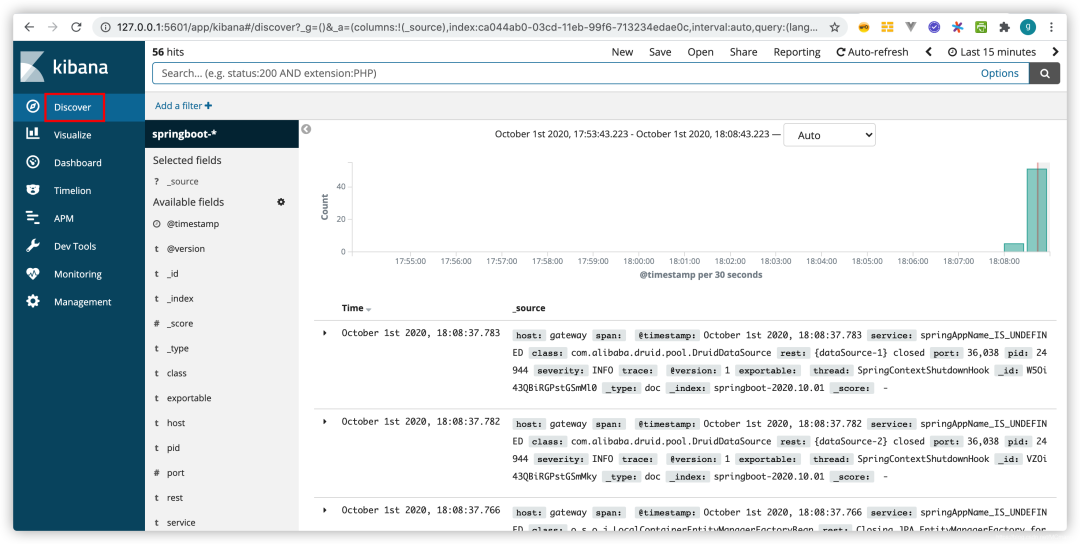

查看收集的日志

啟動我們的項目就可以看到啟動日志已經(jīng)輸出到elasticsearch中了:

點(diǎn)擊discover:

總結(jié)

搭建了ELK日志系統(tǒng)后,我們就可以直接在kibana上看系統(tǒng)的日志了,還可以進(jìn)行搜索

參考資料

https://juejin.im/post/6844903784632549390

https://juejin.im/post/6844904008499331079

版權(quán)聲明:本文為博主原創(chuàng)文章,遵循 CC 4.0 BY-SA 版權(quán)協(xié)議,轉(zhuǎn)載請附上原文出處鏈接和本聲明。

本文鏈接:

https://blog.csdn.net/MCmango/article/details/114022493

鋒哥最新SpringCloud分布式電商秒殺課程發(fā)布

??????

??長按上方微信二維碼 2 秒

感謝點(diǎn)贊支持下哈