深度學(xué)習(xí)計(jì)算機(jī)視覺有哪些經(jīng)典數(shù)據(jù)集?

CV數(shù)據(jù)集

很多朋友在學(xué)習(xí)了神經(jīng)網(wǎng)絡(luò)和深度學(xué)習(xí)之后,早已迫不及待要開始動手實(shí)戰(zhàn)了。第一個遇到的問題通常就是數(shù)據(jù)。作為個人學(xué)習(xí)和實(shí)驗(yàn)來說,很難獲得像工業(yè)界那樣較高質(zhì)量的貼近實(shí)際應(yīng)用的大量數(shù)據(jù)集,這時候一些公開數(shù)據(jù)集往往就成了大家通往AI路上的反復(fù)摩擦的對象。

深度學(xué)習(xí)(CV方向)的經(jīng)典數(shù)據(jù)集包括MNIST手寫數(shù)字?jǐn)?shù)據(jù)集、Fashion MNIST數(shù)據(jù)集、CIFAR-10和CIFAR-100數(shù)據(jù)集、ILSVRC競賽的ImageNet數(shù)據(jù)集、用于檢測和分割的PASCAL VOC和COCO數(shù)據(jù)集等等。本節(jié)就分別對這些經(jīng)典數(shù)據(jù)集進(jìn)行一個概述。

MNIST

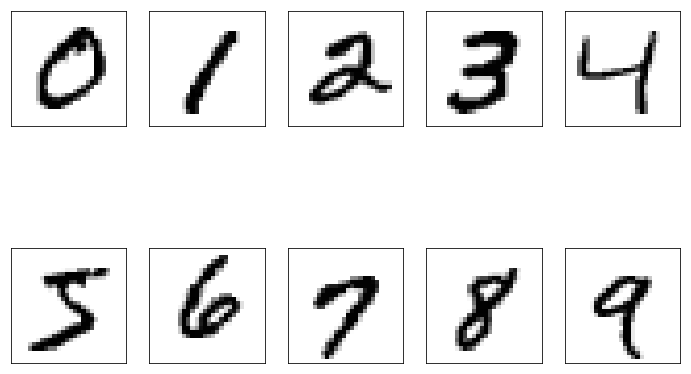

MNIST(Mixed National Institute of Standards and Technology database)數(shù)據(jù)集大家可以說是耳熟能詳。可以說是每個入門深度學(xué)習(xí)的人都會使用MNIST進(jìn)行實(shí)驗(yàn)。作為領(lǐng)域內(nèi)最早的一個大型數(shù)據(jù)集,MNIST于1998年由Yann LeCun等人設(shè)計(jì)構(gòu)建。MNIST數(shù)據(jù)集包括60000個示例的訓(xùn)練集以及10000個示例的測試集,每個手寫數(shù)字的大小均為28*28。

MNIST數(shù)據(jù)集官網(wǎng)地址:

http://yann.lecun.com/exdb/mnist/

MNIST在TensorFlow中可以直接導(dǎo)入使用。在TensorFlow2.0中使用示例如下:

from tensorflow.keras.datasets import mnist(x_train, y_train), (x_test, y_test) = mnist.load_data()print(x_train.shape, y_train.shape, x_test.shape, y_test.shape)

(60000, 28, 28) (60000,) (10000, 28, 28) (10000,)可視化展示0-9十個數(shù)字:

import matplotlib.pyplot as pltimport numpy as npplt.figure(figsize=(12,8))for i in range(10):plt.subplot(2,5,i+1)plt.xticks([])plt.yticks([])img = x_train[y_train == i][0].reshape(28, 28)plt.imshow(img, cmap=plt.cm.binary)

Fashion MNIST

可能是見MNIST太爛大街了,德國的一家名為Zalando的時尚科技公司提供了Fashion-MNIST來作為MNIST數(shù)據(jù)集的替代數(shù)據(jù)集。Fashion MNIST包含了10種類別70000個不同時尚穿戴品的圖像,整體數(shù)據(jù)結(jié)構(gòu)上跟MNIST完全一致。每張圖像的尺寸同樣是28*28。

Fashion MNIST數(shù)據(jù)集地址:

https://research.zalando.com/welcome/mission/research-projects/fashion-mnist/

Fashion MNIST同樣也可以在TensorFlow中直接導(dǎo)入。

from tensorflow.keras.datasets import fashion_mnist(x_train, y_train), (x_test, y_test) = fashion_mnist.load_data()print(x_train.shape, y_train.shape, x_test.shape, y_test.shape)

(60000, 28, 28) (60000,) (10000, 28, 28) (10000,)可視化展示10種類別:

class_names = ['T-shirt/top', 'Trouser', 'Pullover', 'Dress', 'Coat','Sandal', 'Shirt', 'Sneaker', 'Bag', 'Ankle boot']plt.figure(figsize=(12,8))for i in range(10):plt.subplot(2,5,i+1)plt.xticks([])plt.yticks([])plt.grid(False)img = x_train[y_train == i][0].reshape(28, 28)plt.imshow(x_train[i], cmap=plt.cm.binary)plt.xlabel(class_names[y_train[i]])

CIFAR-10

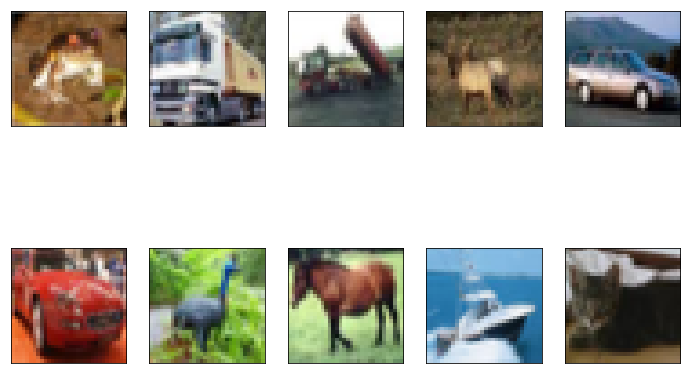

相較于MNIST和Fashion MNIST的灰度圖像,CIFAR-10數(shù)據(jù)集由10個類的60000個32*32彩色圖像組成,每個類有6000個圖像。有50000個訓(xùn)練圖像和10000個測試圖像。

CIFAR-10是由Hinton的學(xué)生Alex Krizhevsky(AlexNet的作者)和Ilya Sutskever 整理的一個用于識別普適物體的彩色圖像數(shù)據(jù)集。一共包含10個類別的RGB彩色圖片:飛機(jī)( airplane)、汽車(automobile)、鳥類(bird)、貓(cat)、鹿(deer)、狗(dog)、蛙類(frog)、馬(horse)、船(ship)和卡車(truck)。

CIFAR-10的官方地址如下:

https://www.cs.toronto.edu/~kriz/cifar.html

CIFAR-10在TensorFlow中導(dǎo)入方式如下:

from tensorflow.keras.datasets import cifar10(x_train, y_train), (x_test, y_test) = cifar10.load_data()print(x_train.shape, y_train.shape, x_test.shape, y_test.shape)

(50000, 32, 32, 3) (50000, 1) (10000, 32, 32, 3) (10000, 1)CIFAR-10的可視化展示如下:

plt.figure(figsize=(12,8))for i in range(10):plt.subplot(2,5,i+1)plt.xticks([])plt.yticks([])plt.grid(False)plt.imshow(x_train[i], cmap=plt.cm.binary)

CIFAR-100

CIFAR-100可以看作是CIFAR-10的擴(kuò)大版,CIFAR-100將類別擴(kuò)大到100個類,每個類包含了600張圖像,分別有500張訓(xùn)練圖像和100張測試圖像。CIFAR-100的100個類被分為20個大類,每個大類又有一定數(shù)量的小類,大類和大類之間區(qū)分度較高,但小類之間有些圖像具有較高的相似度,這對于分類模型來說會更具挑戰(zhàn)性。

CIFAR-100數(shù)據(jù)集地址:

https://www.cs.toronto.edu/~kriz/cifar.html

CIFAR-10在TensorFlow中導(dǎo)入方式如下:

from tensorflow.keras.datasets import cifar100(x_train, y_train), (x_test, y_test) = cifar100.load_data()print(x_train.shape, y_train.shape, x_test.shape, y_test.shape)

(50000, 32, 32, 3) (50000, 1) (10000, 32, 32, 3) (10000, 1)CIFAR-100的可視化展示如下:

plt.figure(figsize=(12,8))for i in range(100):plt.subplot(10,10,i+1)plt.xticks([])plt.yticks([])plt.grid(False)plt.imshow(x_train[i], cmap=plt.cm.binary)

ImageNet

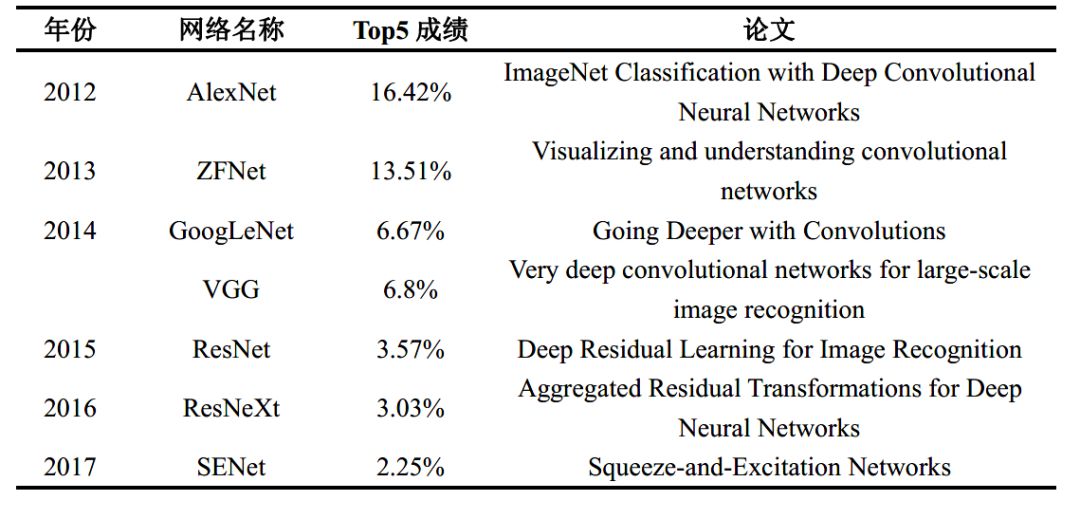

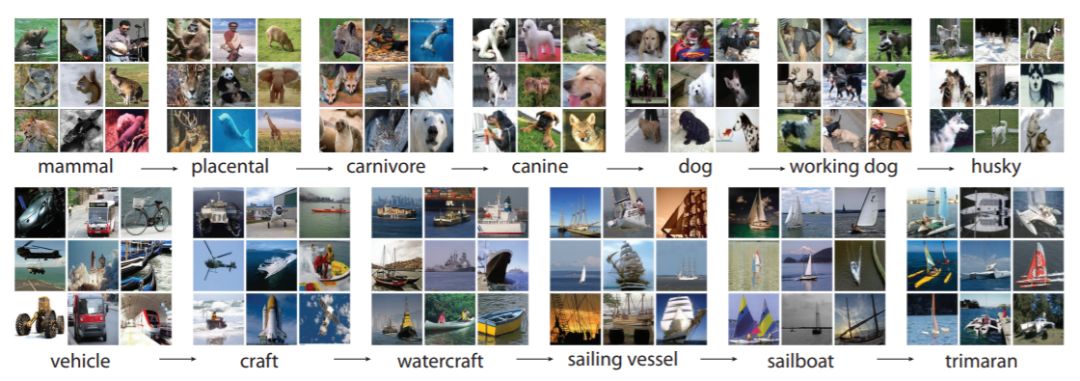

ImageNet圖像數(shù)據(jù)集是在2009年由斯坦福的李飛飛主導(dǎo)的一個項(xiàng)目形成的一個數(shù)據(jù)集。李飛飛在CVPR2009上發(fā)表了一篇名為《ImageNet: A Large-Scale Hierarchical Image Database》的論文,之后從2010年開始基于ImageNet數(shù)據(jù)集的7屆ILSVRC大賽,這使得ImageNet極大的推動了深度學(xué)習(xí)和計(jì)算機(jī)視覺的發(fā)展。ILSVRC大賽歷屆經(jīng)典網(wǎng)絡(luò)。

目前ImageNet中總共有14197122張圖像,分為21841個類別,數(shù)據(jù)官網(wǎng)地址為:

http://www.image-net.org/

ImageNet數(shù)據(jù)集示例:

PASCAL VOC

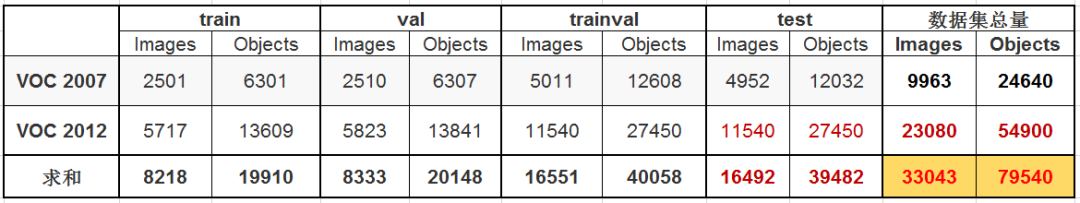

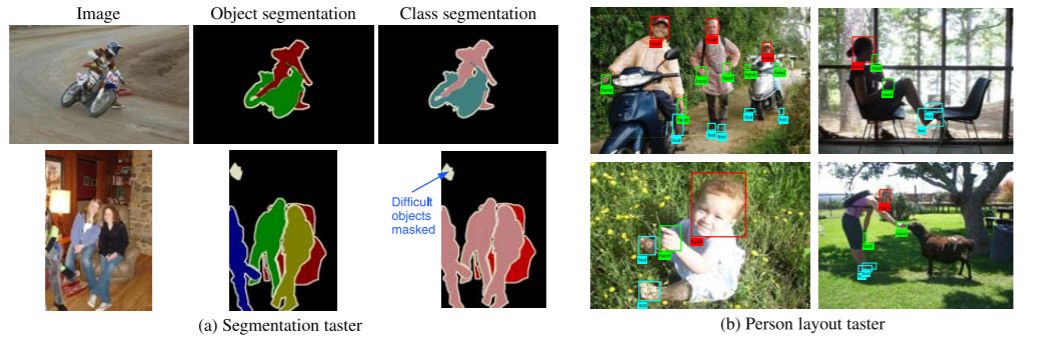

PASCAL VOC挑戰(zhàn)賽(The PASCAL Visual Object Classes)是一個世界級的計(jì)算機(jī)視覺挑戰(zhàn)賽, 其全稱為Pattern Analysis, Statical Modeling and Computational Learning,從2005年開始到2012年結(jié)束,PASCAL VOC最初主要用于目標(biāo)檢測,很多經(jīng)典的目標(biāo)檢測網(wǎng)絡(luò)都是在PASCAL VOC上訓(xùn)練出來的,比如Fast R-CNN系列的各種網(wǎng)絡(luò)。后來逐漸增加了分類、分割、動作識別和人體布局等五類比賽。

目前PASCAL VOC主要分為VOC2007和VOC2012兩個版本的數(shù)據(jù)集。VOC2007和

VOC2012的數(shù)據(jù)統(tǒng)計(jì)對比:

VOC數(shù)據(jù)集示例:

PASCAL VOC 數(shù)據(jù)集地址:

http://host.robots.ox.ac.uk/pascal/VOC/

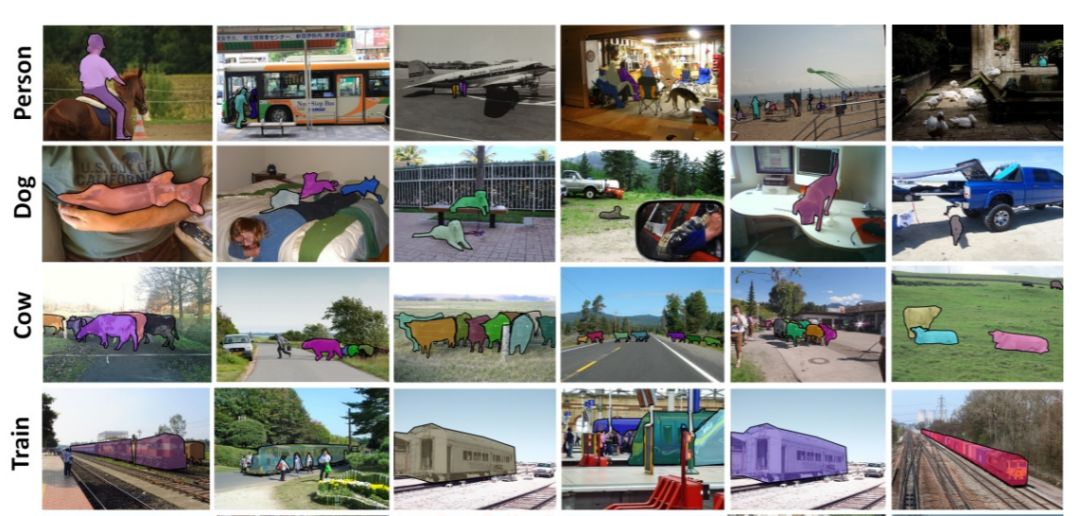

COCO

COCO數(shù)據(jù)集是微軟在ImageNet和PASCAL VOC數(shù)據(jù)集標(biāo)注上的基礎(chǔ)上產(chǎn)生的,主要是用于圖像分類、檢測和分割等任務(wù)。COCO全稱為Common Objects in Context,2014年微軟在ECCV Workshops里發(fā)表了Microsoft COCO: Common Objects in Context。文章中說明了COCO數(shù)據(jù)集以場景理解為目標(biāo),主要從復(fù)雜的日常場景中截取,圖像中的目標(biāo)通過精確的分割進(jìn)行位置的標(biāo)定。COCO包括91個類別目標(biāo),其中有82個類別的數(shù)據(jù)量都超過了5000張。

COCO數(shù)據(jù)集主頁地址:

http://cocodataset.org/#home

COCO數(shù)據(jù)集示例:

當(dāng)然,筆者這里所列的主要都是視覺方向的通用數(shù)據(jù)集,關(guān)于NLP和其他細(xì)分領(lǐng)域的一些經(jīng)典數(shù)據(jù)集,我們后續(xù)內(nèi)容再做介紹。

往期精彩:

【原創(chuàng)首發(fā)】機(jī)器學(xué)習(xí)公式推導(dǎo)與代碼實(shí)現(xiàn)30講.pdf

【原創(chuàng)首發(fā)】深度學(xué)習(xí)語義分割理論與實(shí)戰(zhàn)指南.pdf

算法工程師的日常,一定不能脫離產(chǎn)業(yè)實(shí)踐

求個在看