圖像中的裂紋檢測

點擊上方“小白學(xué)視覺”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時間送達(dá)

推薦閱讀

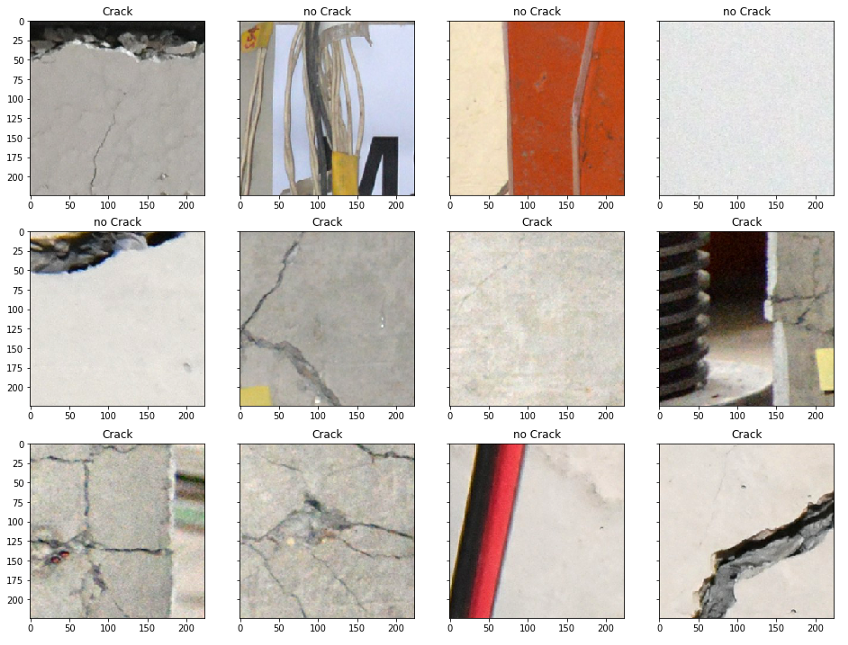

我們首先需要從互聯(lián)網(wǎng)上獲取包含墻壁裂縫的圖像(URL格式)數(shù)據(jù)。總共包含1428張圖像:其中一半是新的且未損壞的墻壁;其余部分顯示了各種尺寸和類型的裂縫。

第一步:讀取圖像,并調(diào)整大小。

images = []for url in tqdm.tqdm(df['content']):response = requests.get(url)img = Image.open(BytesIO(response.content))img = img.resize((224, 224))numpy_img = img_to_array(img)img_batch = np.expand_dims(numpy_img, axis=0)images.append(img_batch.astype('float16'))images = np.vstack(images)

從下面的示例中您可以看到,在我們的數(shù)據(jù)中顯示了不同類型的墻體裂縫,其中一些對我來說也不容易識別。

圖例

我們想要建立一個機(jī)器學(xué)習(xí)模型,該模型能夠?qū)Ρ趫D像進(jìn)行分類并同時檢測異常的位置。為了達(dá)到這個目的需要建立一個有效的分類器。它將能夠讀取輸入圖像并將其分類為“損壞”或“未損壞”兩個部分。在最后一步,我們將利用分類器學(xué)到的知識來提取有用的信息,這將有助于我們檢測異常情況。對于這個類任務(wù),我們選擇在Keras中重載VGG16來完成它。

vgg_conv = vgg16.VGG16(weights='imagenet', include_top=False, input_shape = (224, 224, 3))for layer in vgg_conv.layers[:-8]:layer.trainable = False

導(dǎo)入了VGG架構(gòu),并允許訓(xùn)練最后兩個卷積模塊,以便我們的模型能夠具有一定的特殊性。除此之外,我們還需要去除原始模型的頂層,并將其替換為另一種結(jié)構(gòu)。

x = vgg_conv.outputx = GlobalAveragePooling2D()(x)x = Dense(2, activation="softmax")(x)model = Model(vgg_conv.input, x)model.compile(loss = "categorical_crossentropy", optimizer = optimizers.SGD(lr=0.0001, momentum=0.9), metrics=["accuracy"])

在分類階段,GlobalAveragePooling層通過提取每個要素圖的平均值來減小前一層的大小,這種選擇加上中間致密層的省略用法可以避免過度擬合。如果小伙伴可以使用GPU,則培訓(xùn)非常簡單。COLAB為我們提供了加快這一過程所需的武器。我們還使用了Keras提供的簡單數(shù)據(jù)生成器進(jìn)行圖像增強(qiáng)。

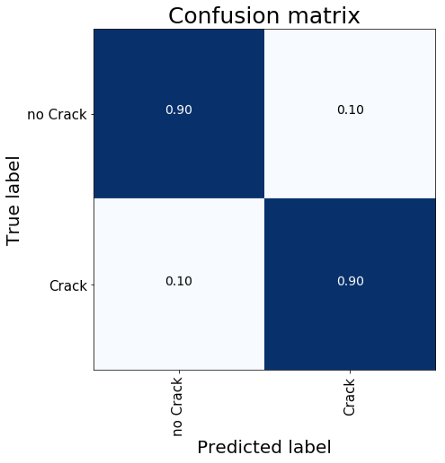

最終,我們能夠達(dá)到0.90的整體精度,還不錯!

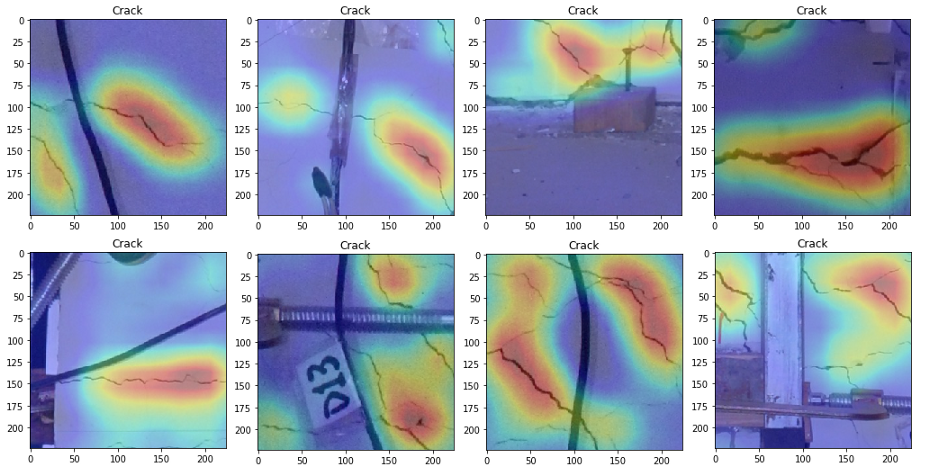

局部異常

現(xiàn)在我們要對檢測出異常的圖像進(jìn)行一定的操作,使墻壁圖像裂縫被突出。我們需要的有用信息位于頂層。因此我們可以訪問:卷積層:上層是VGG結(jié)構(gòu),還有網(wǎng)絡(luò)創(chuàng)建的更多重要功能。我們選擇了最后一個卷積層(“?block5_conv3?”),并在此處剪切了我們的分類模型。我們已經(jīng)重新創(chuàng)建了一個中間模型,該模型以原始圖像為輸入,輸出相關(guān)的激活圖。考慮到維度,我們的中間模型增加了初始圖像的通道(新功能)并減小了尺寸(高度和寬度)。

最終密度層:對于每個感興趣的類別,我們都需要這些權(quán)重,這些權(quán)重負(fù)責(zé)提供分類的最終結(jié)果。

有了這些壓縮的物體,我們掌握了定位裂縫的所有知識。我們希望將它們“繪制”在原始圖像上,以使結(jié)果易于理解且易于看清。“解壓縮”此信息在python中很容易:我們只需進(jìn)行雙線性上采樣即可調(diào)整每個激活圖的大小并計算點積。

執(zhí)行一個簡單的函數(shù)即可訪問:

def plot_activation(img):pred = model.predict(img[np.newaxis,:,:,:])pred_class = np.argmax(pred)weights = model.layers[-1].get_weights()[0]class_weights = weights[:, pred_class]intermediate = Model(model.input,model.get_layer("block5_conv3").output)conv_output = intermediate.predict(img[np.newaxis,:,:,:])conv_output = np.squeeze(conv_output)h = int(img.shape[0]/conv_output.shape[0])w = int(img.shape[1]/conv_output.shape[1])act_maps = sp.ndimage.zoom(conv_output, (h, w, 1), order=1)out = np.dot(act_maps.reshape((img.shape[0]*img.shape[1],512)),class_weights).reshape(img.shape[0],img.shape[1])plt.imshow(img.astype('float32').reshape(img.shape[0],img.shape[1],3))plt.imshow(out, cmap='jet', alpha=0.35)plt.title('Crack' if pred_class == 1 else 'No Crack')

我在下面的圖像中顯示結(jié)果,在該圖像中,我已在分類為裂紋的測試圖像上繪制了裂紋熱圖。我們可以看到,熱圖能夠很好地泛化并指出包含裂縫的墻塊。

在裂紋圖像中顯示異常

在這篇文章中,我們?yōu)楫惓WR別和定位提供了一種機(jī)器學(xué)習(xí)解決方案。所有這些功能都可以通過實現(xiàn)單個分類模型來訪問。在訓(xùn)練過程中,我們的神經(jīng)網(wǎng)絡(luò)會獲取所有相關(guān)信息,從而可以進(jìn)行分類,并在最后給出墻壁裂紋的信息。

交流群

歡迎加入公眾號讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動駕駛、計算攝影、檢測、分割、識別、醫(yī)學(xué)影像、GAN、算法競賽等微信群(以后會逐漸細(xì)分),請掃描下面微信號加群,備注:”昵稱+學(xué)校/公司+研究方向“,例如:”張三?+?上海交大?+?視覺SLAM“。請按照格式備注,否則不予通過。添加成功后會根據(jù)研究方向邀請進(jìn)入相關(guān)微信群。請勿在群內(nèi)發(fā)送廣告,否則會請出群,謝謝理解~