首個“開源ChatGPT”來了!但是我敢打賭:你跑不起來!

點藍色字關(guān)注

“機器學(xué)習(xí)算法工程師

”

點藍色字關(guān)注

“機器學(xué)習(xí)算法工程師

”

設(shè)為 星標(biāo) ,干貨直達!

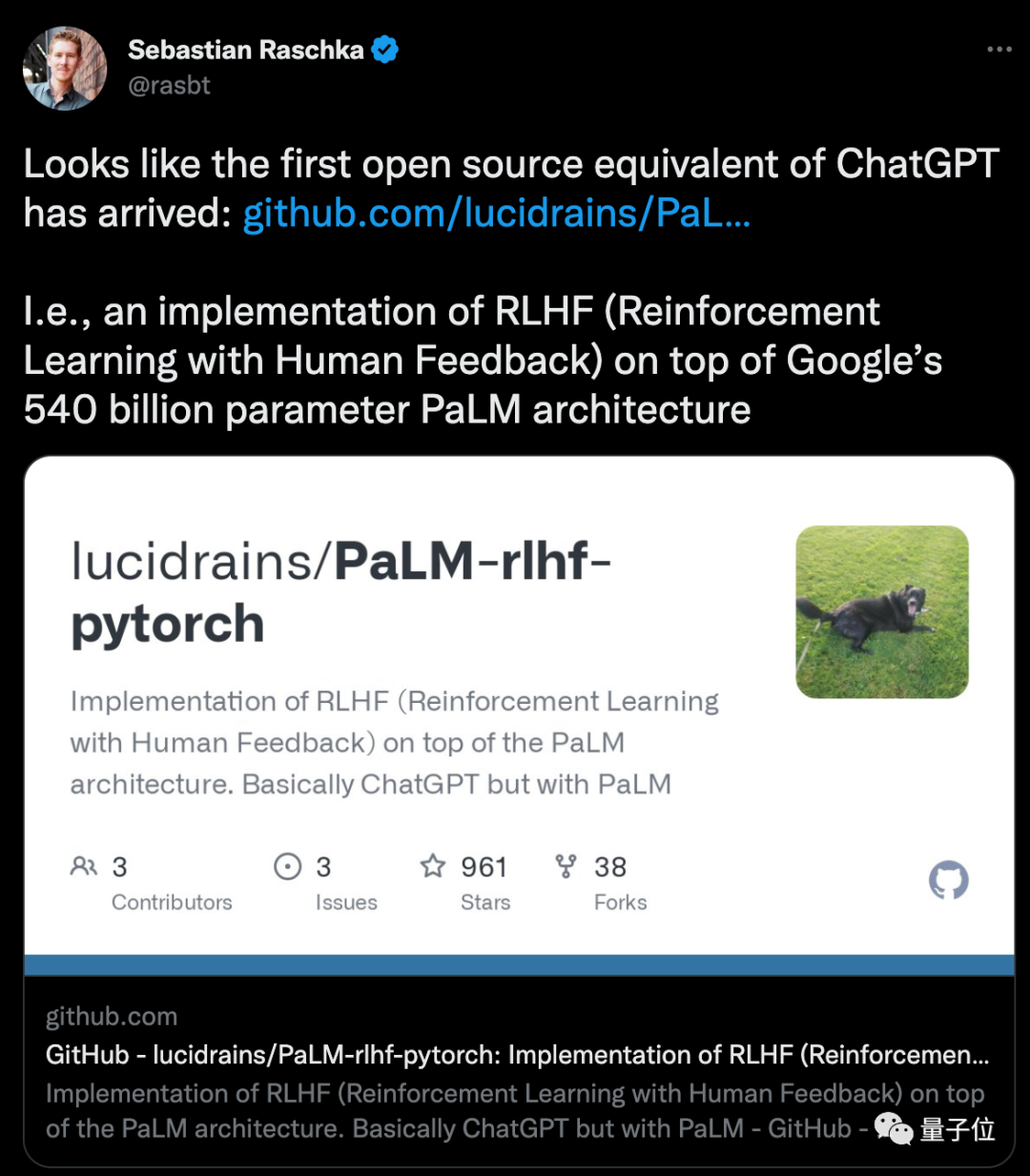

就說程序員的手速有多快吧,首個開源ChatGPT項目已經(jīng)出現(xiàn)了!

基于谷歌語言大模型PaLM架構(gòu),以及使用從人類反饋中強化學(xué)習(xí)的方法(RLHF),華人小哥Phillip Wang復(fù)刻了一個ChatGPT出來。

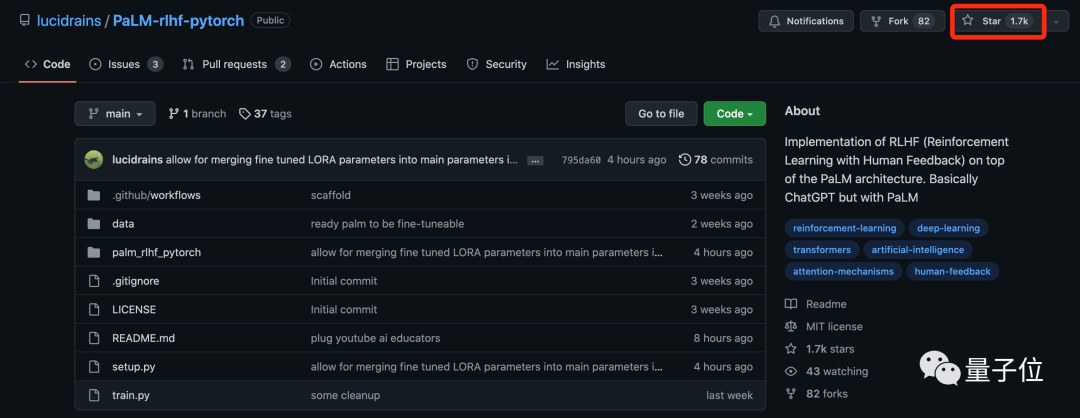

項目GitHub星已經(jīng)超過1.7k了,而且還在一路飆升ing。

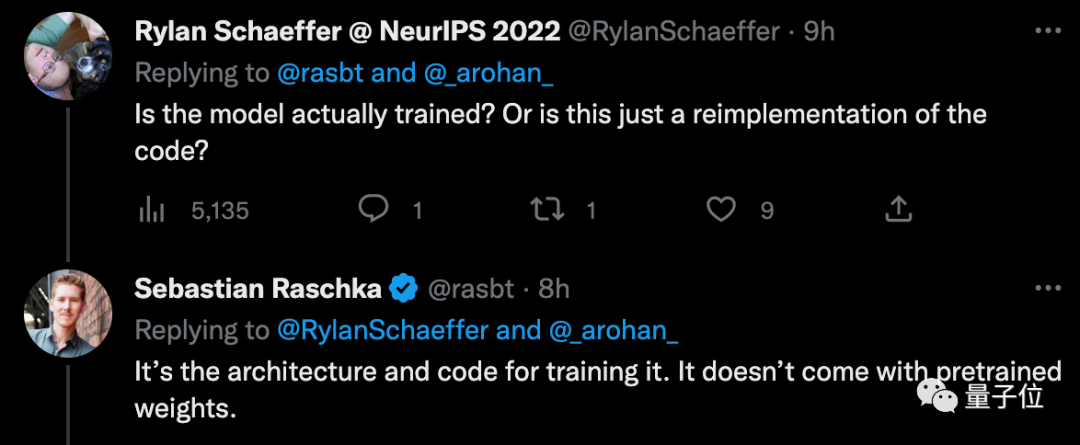

不過一反常態(tài)的是,網(wǎng)友們看到“開源ChatGPT”卻沒有火速開沖,反倒齊刷刷在發(fā)問:

這……有人能run?

開源了但沒完全開?

項目的核心內(nèi)容,是在PaLM架構(gòu)上實現(xiàn)基于人類反饋的強化學(xué)習(xí)。

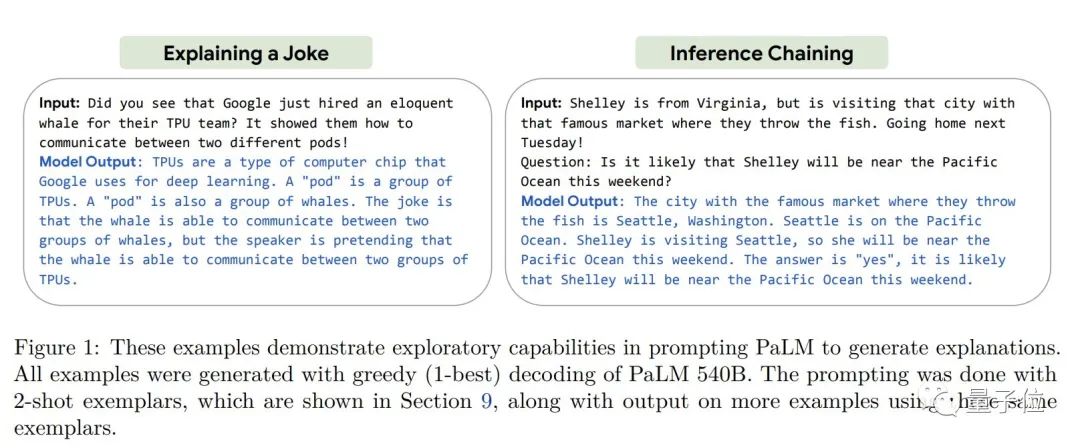

其中,PaLM(Pathways Language Model)是谷歌在今年4月發(fā)布的5400億參數(shù)全能大模型,基于Pathways系統(tǒng)訓(xùn)練,BERT之父Jacob Devlin為主要貢獻者之一。

PaLM可以完成寫代碼、聊天、語言理解等任務(wù),并且在大多數(shù)任務(wù)上實現(xiàn)了SOTA少樣本學(xué)習(xí)性能。

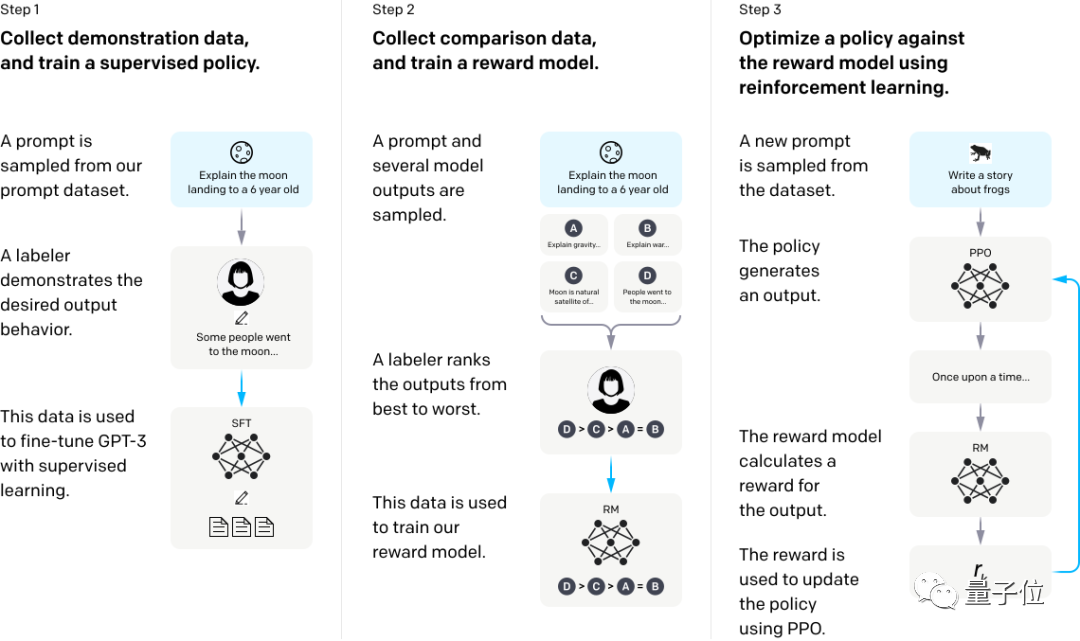

另一個核心點是RLHF“從人類反饋中強化學(xué)習(xí)”。

OpenAI提出InstructGPT時就用到了這一方法,它能讓AI的回答更加符合情景要求,降低“有害性”。

具體分三步:

第一步,找一些人寫下示范答案,來微調(diào)GPT-3模型,訓(xùn)練監(jiān)督模型baseline。

第二步,收集某個問題的幾組不同輸出數(shù)據(jù),由人類對幾組答案進行排序,在此數(shù)據(jù)集上訓(xùn)練獎勵模型。

第三步,使用RM作為獎勵函數(shù),近端策略優(yōu)化(PPO)算法微調(diào)GPT-3策略,以強化學(xué)習(xí)方法最大化獎勵。

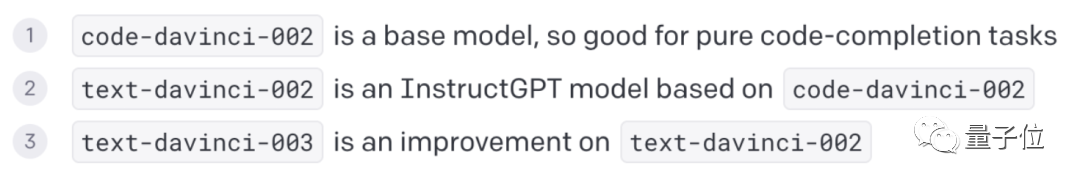

ChatGPT使用的GPT-3.5,其中text-davinci-002就是在code-davinci-002的基礎(chǔ)上,采用了InstructGPT訓(xùn)練方法改進得到。

正是基于如上兩方面核心內(nèi)容,作者實現(xiàn)了ChatGPT的復(fù)刻。

大致步驟有3步:

首先來訓(xùn)練一下PaLM,就和其他自回歸Transformer一樣。

第二……

等等,訓(xùn)練PaLM???這確定不是在開玩笑?

現(xiàn)在明白為啥大家都覺得這個開源項目完全不能run了……

打個不恰當(dāng)?shù)谋确剑@就像如果想吃熊肉,那先自己去打頭熊來。

項目中只有PaLM架構(gòu)和代碼,沒有預(yù)先訓(xùn)練好的權(quán)重。

所以完成第一步,大概效果就是……

話雖如此,但還是繼續(xù)接著往下看看……

第二步,就要訓(xùn)練基于RLHF的獎勵模型了。作者使用的是一種輕量級訓(xùn)練大語言模型方法LoRA,這種方法是開源的。

然后,再把之前訓(xùn)練好的模型和獎勵模型用強化學(xué)習(xí)進行微調(diào)。

經(jīng)過這三步后,就能得到一個開源版的ChatGPT了。

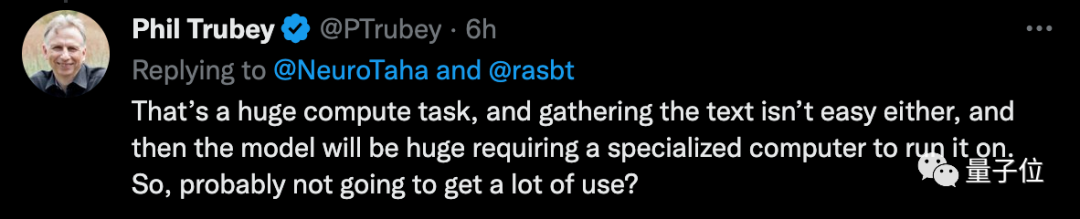

這中間面臨的問題包括巨大的計算量、超大模型和難收集的文本……所以有人也不免發(fā)問:

有沒有一種可能,它也沒啥用?

不過有網(wǎng)友覺得這本質(zhì)上還是一件好事啦。

AI的一個關(guān)鍵區(qū)別就是,每有一個重大突破,很快就會出現(xiàn)一個開源版本。

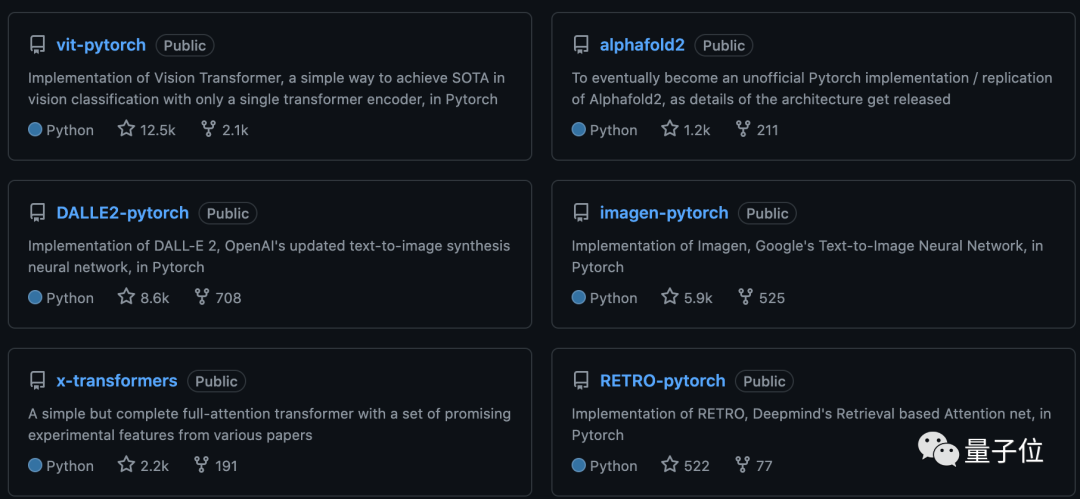

實際上,開源項目作者小哥Philip Wang一直都熱衷于復(fù)刻各種明星項目,過去還嘗試過Dall·E 2、AlphaFold 2等。

以及LAION也發(fā)起了一個類似項目Open Assistant,他們將通過“眾籌腦力”的方式,共同開發(fā)一個開源的聊天AI。

Stable Diffusion用的開放數(shù)據(jù)集,就是這一組織做的。

感興趣的童鞋不妨去試試看~

PaLM-rlhf-pytorch主頁:

https://github.com/lucidrains/PaLM-rlhf-pytorch

Open Assistant主頁:

https://github.com/LAION-AI/Open-Assistant

參考鏈接:

[1]

https://twitter.com/rasbt/status/1608133663937495041

[2]

https://twitter.com/omarsar0/status/1608143718460055552

本文轉(zhuǎn)自量子位

推薦閱讀

輔助模塊加速收斂,精度大幅提升!移動端實時的NanoDet-Plus來了!

機器學(xué)習(xí)算法工程師

? ??? ? ? ? ? ? ? ? ? ? ????????? ??一個用心的公眾號