ECCV2020 最佳論文提名 | 流感知技術(shù)

點擊上方“小白學視覺”,選擇加"星標"或“置頂”

重磅干貨,第一時間送達

前一段時間,ECCV2020公布了最佳論文提名獎,卡耐基梅隆大學以《Towards Streaming Perception》榮獲該獎項.他們開發(fā)了一種新的衡量自動駕駛汽車對不斷變化的交通狀況的反應(yīng)能力的標準,這使比較感知系統(tǒng)的準確性和反應(yīng)時間首次成為可能.

論文鏈接:https://arxiv.org/abs/2005.10420

代碼鏈接:https://github.com/mtli/sAP

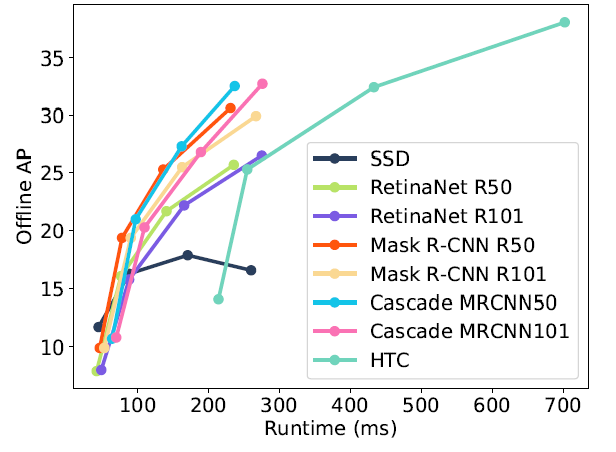

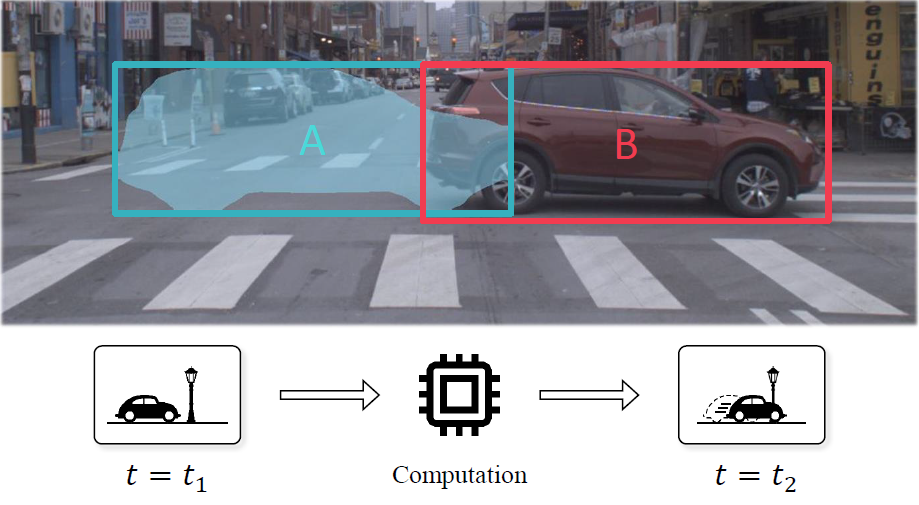

自動駕駛以及虛擬現(xiàn)實等應(yīng)用都需要低延遲的算法來支撐,為了保證安全和提供給用戶足夠的視覺沉浸感,算法的延遲標準應(yīng)該和人類對場景改變的反應(yīng)時間保持一致,通常是200毫秒。近來的計算機視覺算法也開始考慮延遲(Latency)對算法性能的影響,但也僅僅是在離線環(huán)境下考慮如何提高算法的準確率(Accuracy),并在二者之間尋找一個平衡點。

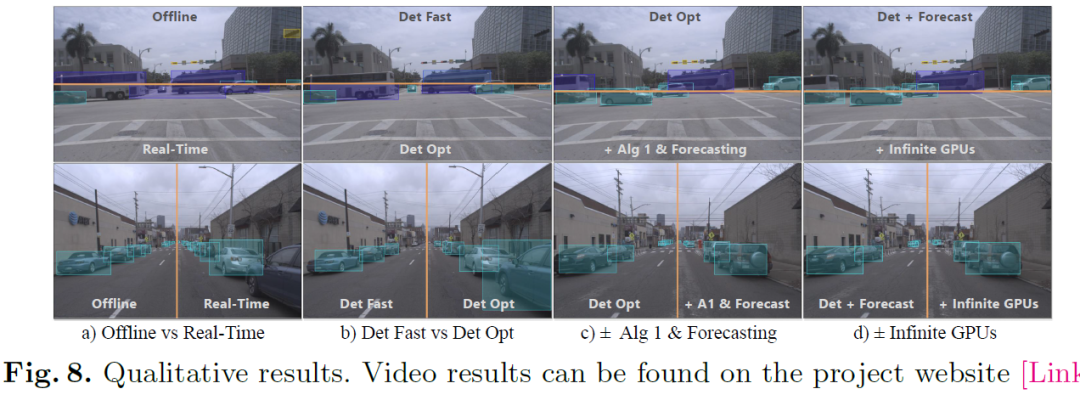

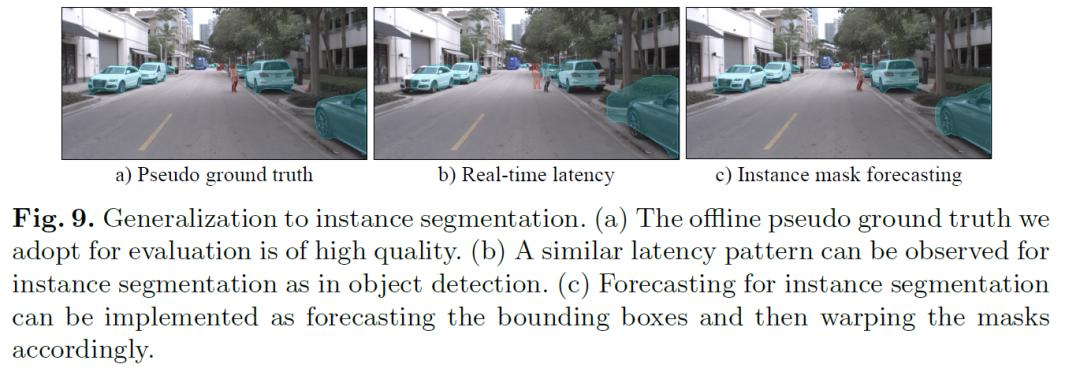

以這種評估方法優(yōu)化得到的算法還無法應(yīng)用在實時在線的感知場景中,因為當算法完成對某一幀圖像的處理時,比如200ms后,周圍的環(huán)境就已經(jīng)發(fā)生了變化。如下面的視頻所示,算法在得到第一幀中車輛的分割結(jié)果后,車輛就已經(jīng)運動到另一個位置了,那此時所得到的分割結(jié)果的意義就很小了。

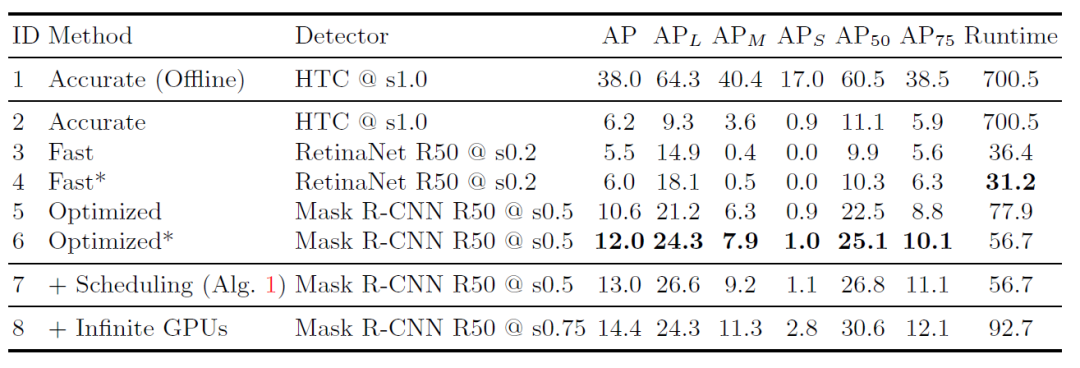

本文提出了一種方法可以將延遲和準確率結(jié)合起來應(yīng)用在實時的算法評估中,作者稱之為“流準確率”,并在此度量的基礎(chǔ)上,提出了流感知的元基準,可以將任何單幀任務(wù)轉(zhuǎn)換為流感知任務(wù)。

Single GPU vs Infinite GPUs

Instance Segmentation

Forecasting

Detectors Only

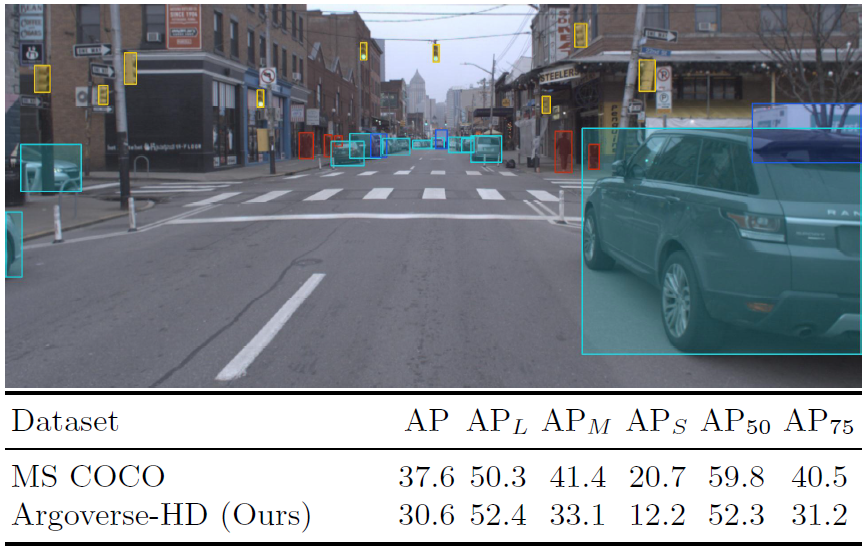

作者選擇了Argoverse1.1數(shù)據(jù)集,作者重點選擇其中的RGB圖像數(shù)據(jù),對其做了額外的密集標注構(gòu)成了Argoverse-HD(High-frame-rate-Detection),新數(shù)據(jù)集中每個場景的視頻的幀率為30FPS,同時標注密度與該幀率保持一致.