最新 ICCV 2021 | GAN隱私保護(33)醫(yī)學圖像(34)生成對抗GAN

圖像編輯系列之(2)基于StyleGAN(3)GAN逆映射(4)人臉 (5)語義生成?

圖像恢復系列之(6)超分(7)反光去除(8)光斑去除 (9)陰影去除(10)水下圖像失真去除?

圖像檢測系列之(12)異常檢測(13)拼接偽造(14)deepfake?

圖像轉(zhuǎn)換 image translation系列(17)

虛擬試衣(21)圖像編輯-文本引導(22)圖像編輯-單樣本(23)

GAN少樣本(26)實例可控(27)視圖合成(28)細粒度生成(29)細粒度檢索(30)

三十三、隱私保護

84、Personalized and Invertible Face De-identification by Disentangled Identity Information Manipulation

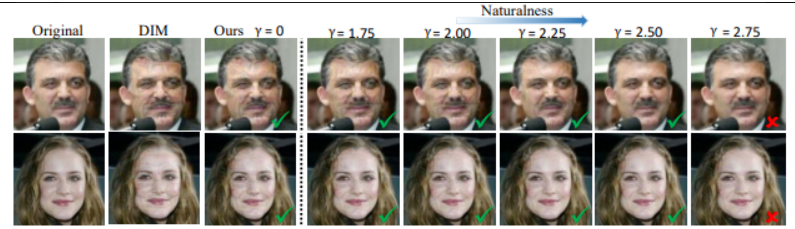

智能手機和監(jiān)控攝像頭在內(nèi)的智能設(shè)備的普及,導致更嚴重的隱私問題。“去識別( De-identification)”被認為是通過隱藏或替換身份信息的過程來保護視覺隱私的有效工具。

大多數(shù)現(xiàn)有的去識別方法都有一些限制,因為它們主要關(guān)注保護過程并且通常不可逆。本文提出一種基于深度生成模型的可逆去識別方法,其主要思想是引入用戶特定密碼和可調(diào)節(jié)的參數(shù)來控制身份變化的方向和程度。

85、Towards Face Encryption by Generating Adversarial Identity Masks

社交媒體和網(wǎng)絡(luò)共享的時代,數(shù)據(jù)隱私和安全性越來越受到關(guān)注。本文開發(fā)一種可以加密個人照片的技術(shù),以便它們可以保護用戶免受未經(jīng)授權(quán)的人臉識別系統(tǒng)的侵害,但在視覺上與人類的原始版本保持一致。

為了實現(xiàn)這一點,提出了一種有針對性的身份保護迭代方法(TIP-IM)來生成可以覆蓋在人臉圖像上的對抗性身份掩碼,從而可以在不犧牲視覺質(zhì)量的情況下隱藏原始身份。大量實驗表明,在實際測試場景下,TIP-IM 針對各種最先進的人臉識別模型提供了 95% 以上的保護成功率。

三十四、醫(yī)學圖像

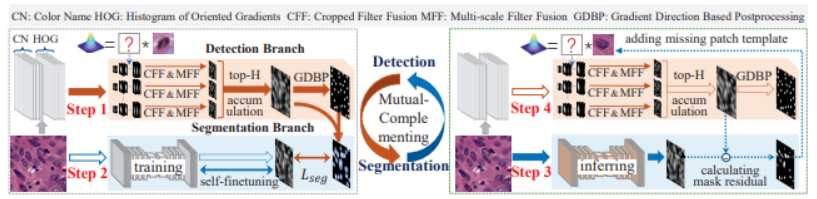

86、Mutual-Complementing Framework for Nuclei Detection and Segmentation in Pathology Image

細胞核的檢測和分割是病理圖像中的基本分析操作,從中得出的評估是癌癥診斷的重要評判標準之一。手動分割細胞核既昂貴又耗時。更重要的是,由于外觀變化大、細胞核連體重疊、組織結(jié)構(gòu)退化嚴重,細胞核的準確分割檢測具有挑戰(zhàn)性。監(jiān)督方法高度依賴大量帶注釋的樣本。現(xiàn)有的兩種無監(jiān)督方法在退化樣本上容易失敗。

本文提出一種用于病理圖像中的細胞核檢測和分割的相互補充框架 (MCF)。MCF的兩個分支以相互補充的方式進行訓練,其中檢測分支補充分割分支的偽掩模,而漸進訓練的分割分支通過計算預(yù)測掩模和檢測結(jié)果之間的掩模殘差來補充缺失的核模板。大量實驗表明MCF的有效性。

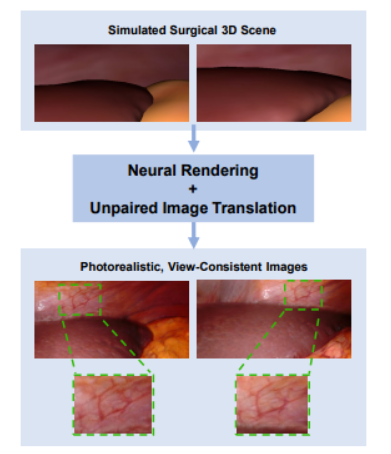

87、Long-Term Temporally Consistent Unpaired Video Translation from Simulated Surgical 3D Data

非配對視頻轉(zhuǎn)換的研究主要集中在通過調(diào)節(jié)相鄰幀來實現(xiàn)短期時間一致性。對于從模擬到逼真的序列轉(zhuǎn)換,有關(guān)基礎(chǔ)幾何的可用信息為實現(xiàn)跨視圖的全局一致性可以提供信息。

本文提出將不成對的圖像轉(zhuǎn)換與神經(jīng)渲染相結(jié)合,模擬轉(zhuǎn)換為逼真手術(shù)腹部場景。通過引入全局可學習紋理和光照不變的視圖一致性損失,方法可完成任意視圖的一致轉(zhuǎn)換,實現(xiàn)一致性良好的視頻合成效果。

代碼和數(shù)據(jù)http://opencas.dkfz.de/video-sim2real/

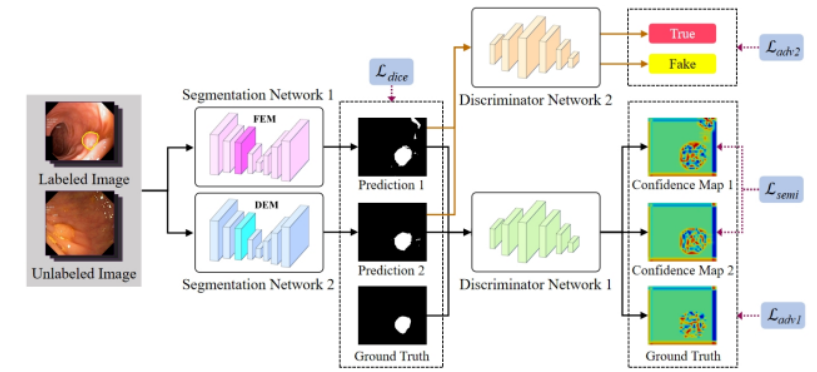

88、Collaborative and Adversarial Learning of Focused and Dispersive Representations for Semi-supervised Polyp Segmentation

結(jié)腸鏡息肉圖像的自動分割是計算機輔助診斷結(jié)直腸癌的重要步驟。近年來報道的大多數(shù)息肉分割方法都是基于全監(jiān)督的深度學習方法。然而,醫(yī)生在診斷期間對息肉圖像進行打標注成本極高。

本文提出一種新的半監(jiān)督息肉分割方法,通過協(xié)作和對抗學習的聚焦(focused)和分散(dispersive )表示學習模型,處理息肉位置和形狀的多樣性。此外,判別器在對抗性訓練框架中生成的置信度圖顯示了利用未標記數(shù)據(jù)和提高分割網(wǎng)絡(luò)性能的有效性。

對兩個著名的息肉數(shù)據(jù)集Kvasir-SEG 和 CVC-Clinic DB進行了廣泛的實驗,結(jié)果證明了方法的有效性和先進性。

猜您喜歡:

?戳我,查看GAN的系列專輯~!

?戳我,查看GAN的系列專輯~!附下載 |《TensorFlow 2.0 深度學習算法實戰(zhàn)》

《基于深度神經(jīng)網(wǎng)絡(luò)的少樣本學習綜述》