451頁(yè)長(zhǎng)文!Facebook科學(xué)家用馬斯克堅(jiān)信的「第一性原理」闡釋DNN, LeCun站臺(tái)

新智元報(bào)道

新智元報(bào)道

來(lái)源:FAIR

編輯:yaxin, LQ

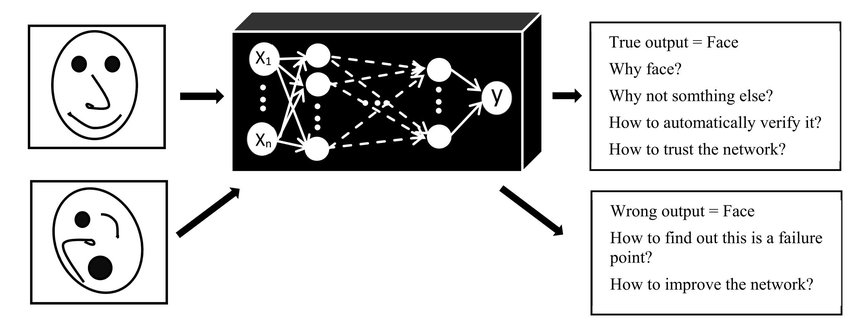

【新智元導(dǎo)讀】馬斯克堅(jiān)信,世界只是「矩陣模擬」!他用自己推崇的思維模式「第一性原理」來(lái)思考這個(gè)物理世界。近日,F(xiàn)acebook科學(xué)家Sho Yaida撰寫(xiě)的一書(shū)從「第一性原理」解釋了深度神經(jīng)網(wǎng)絡(luò)。LeCun表示,這是首批致力于DL理論的書(shū)。

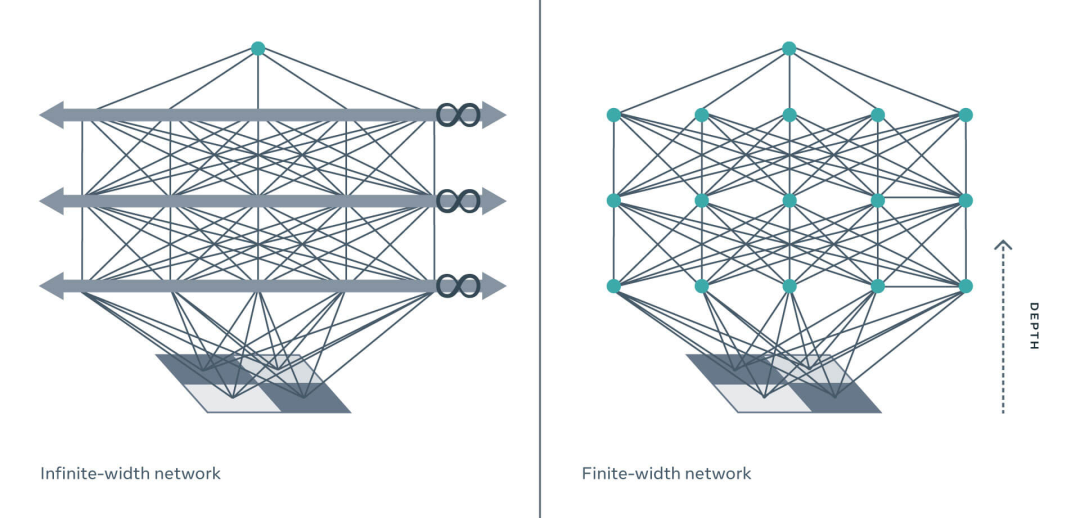

相互作用的神經(jīng)元

相互作用的神經(jīng)元

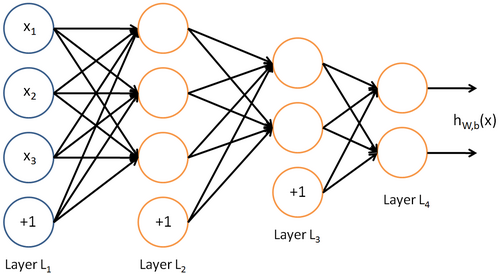

通過(guò)第一性原理理解DNN

通過(guò)第一性原理理解DNN

LeCun為同事站臺(tái)

LeCun為同事站臺(tái)

作者介紹

作者介紹

參考資料:

https://ai.facebook.com/blog/advancing-ai-theory-with-a-first-principles-understanding-of-deep-neural-networks/

評(píng)論

圖片

表情