PyTorch里這個bug,你知道嗎?

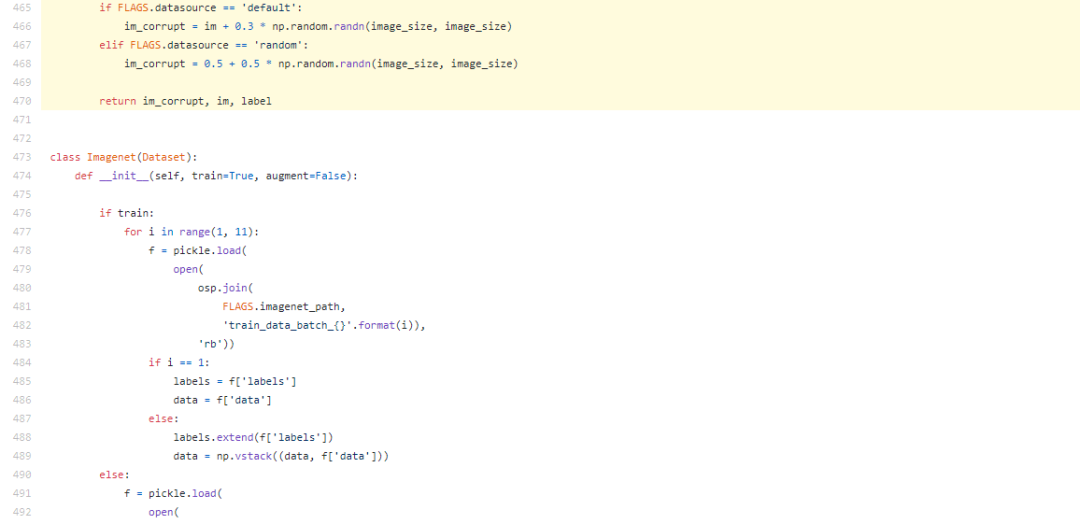

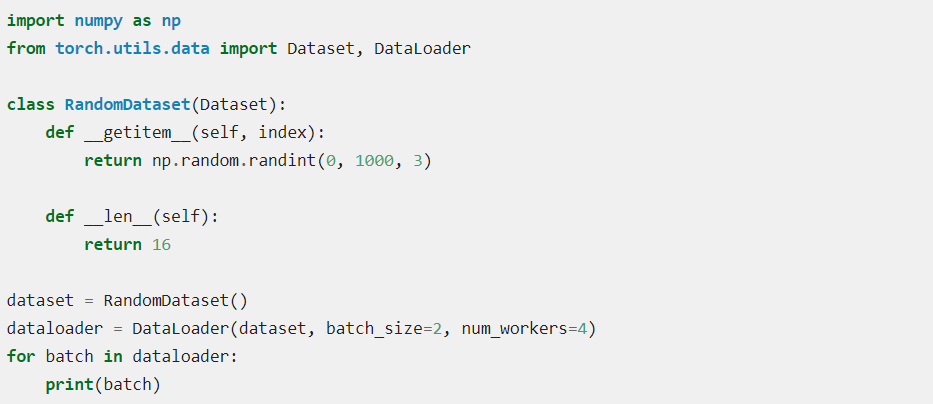

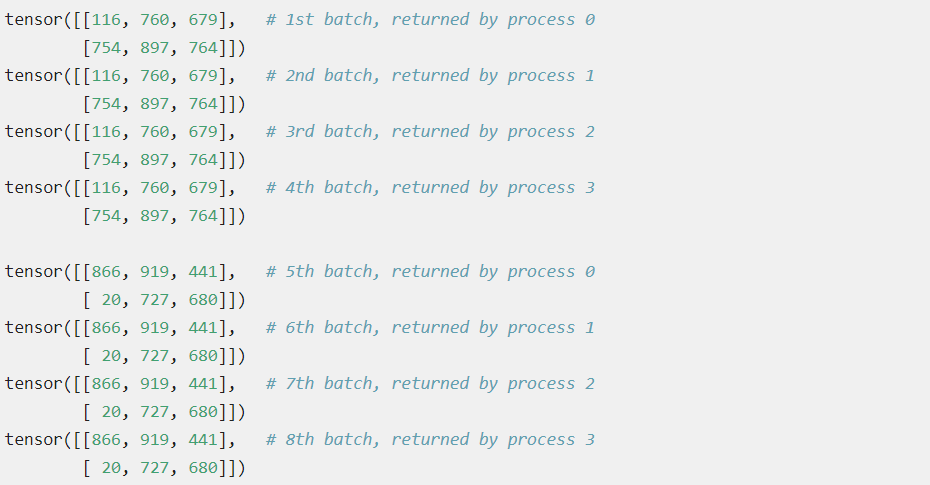

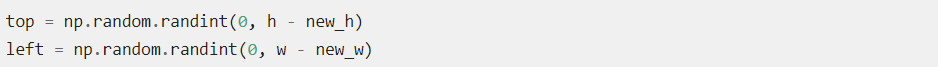

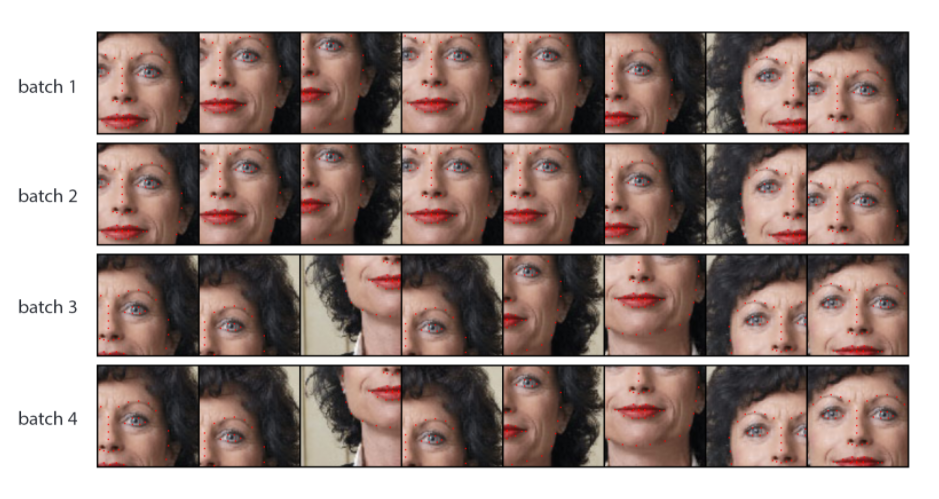

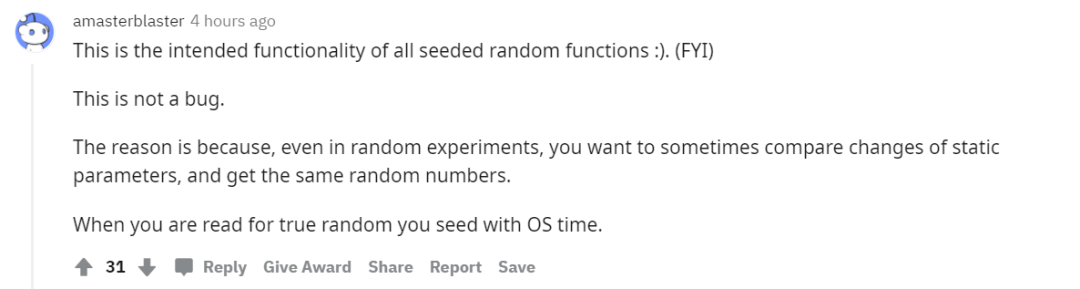

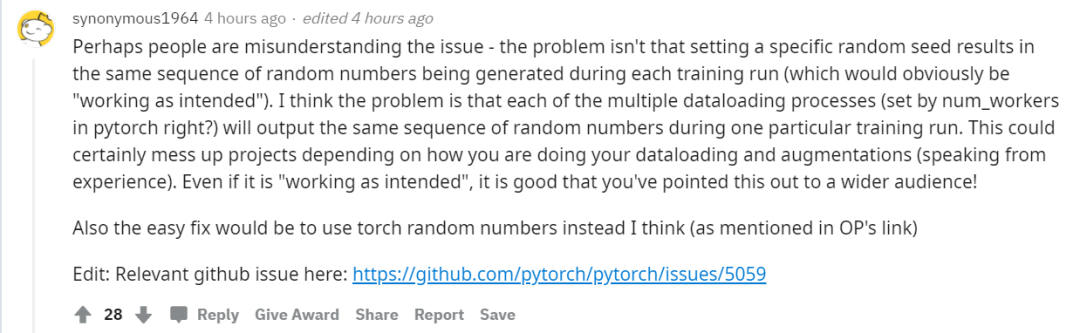

近日,有用戶在自己的項目中發(fā)現(xiàn)了一個微小的 bug,在 PyTorch 同時使用 NumPy 的隨機數(shù)生成器和多進程數(shù)據(jù)加載會導(dǎo)致相同的擴充數(shù)據(jù),只有專門設(shè)置 seed 才可以解決這個 bug,否則會降低模型的準(zhǔn)確率。不過,有人認(rèn)為這并不是一個 bug,而是預(yù)期功能,是「按預(yù)期工作的」。

亞馬遜云科技線上黑客松2021

識別二維碼,立即報名參賽。

? THE END

轉(zhuǎn)載請聯(lián)系本公眾號獲得授權(quán)

投稿或?qū)で髨蟮溃篶[email protected]

評論

圖片

表情