【NLP】ACL2020 | 詞向量性別偏見(jiàn)

作者?| Salesforce?Research? 編譯 |?NewBeeNLP

ACL2020關(guān)于詞嵌入性別偏見(jiàn)的蠻有意思的一項(xiàng)工作:

論文地址:https://arxiv.org/abs/2005.00965

代碼地址:https://github.com/uvavision/Double-Hard-Debias

TL; DR

從人類(lèi)生成的語(yǔ)料庫(kù)中學(xué)習(xí)到的單詞嵌入繼承了強(qiáng)烈的「性別偏見(jiàn)(gender bias)」,并且會(huì)通過(guò)下游模型進(jìn)一步放大。我們發(fā)現(xiàn)諸如單詞頻率之類(lèi)的語(yǔ)料庫(kù)規(guī)則會(huì)對(duì)現(xiàn)有的post-hoc debiasing算法產(chǎn)生負(fù)面影響,并建議在推斷和刪除性別子空間之前針對(duì)此類(lèi)語(yǔ)料庫(kù)規(guī)則來(lái)凈化詞向量。

詞嵌入中的性別偏見(jiàn)

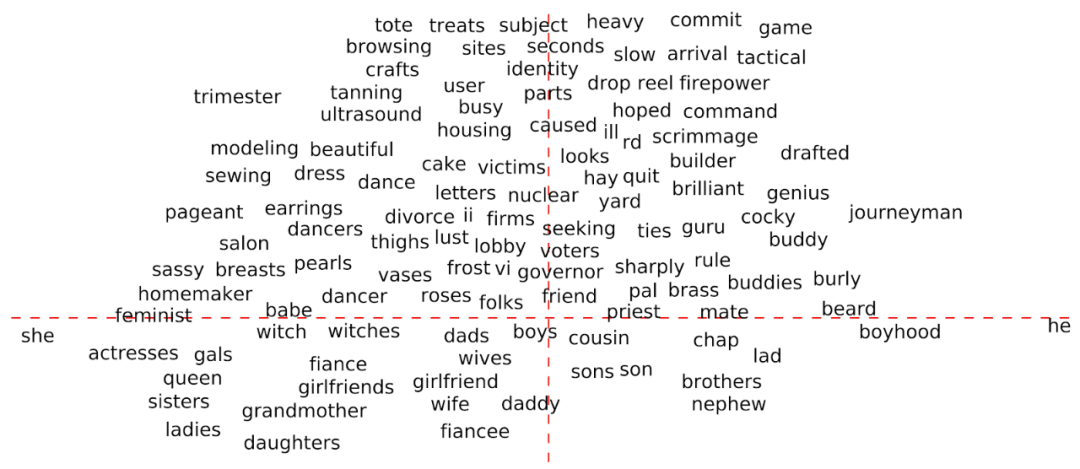

詞嵌入是詞匯表中單詞的向量表示,它們能夠捕獲單詞的語(yǔ)義和句法含義以及與其他單詞的關(guān)系。盡管在自然語(yǔ)言處理(NLP)任務(wù)中廣泛使用了詞嵌入,但由于其從訓(xùn)練語(yǔ)料庫(kù)中繼承了意想不到的性別偏見(jiàn),因此飽受批評(píng)。如論文中所討論的(Man is to Computer Programmer as Woman is to Homemaker? Debiasing Word Embeddings[1]),我們認(rèn)為一個(gè)單詞在定義上與性別無(wú)關(guān)但其學(xué)習(xí)的嵌入更接近于某個(gè)性別時(shí),這就產(chǎn)生了性別偏見(jiàn)。例如,在下圖中, 軸是對(duì)「他(he)」 和 「她(she)」 兩個(gè)詞的嵌入之間差異的投影,而 軸是在嵌入過(guò)程中捕獲性別中立性的方向,與性別無(wú)關(guān)的位于上半部分,而與性別有關(guān)的詞位于下半部分。盡管從定義上說(shuō),brilliant和genius不分性別,但它們的embedding更加接近男性(he)。同樣,homemaker和sewing與女性(her)聯(lián)系更緊密。

為什么性別偏見(jiàn)如此重要?

詞嵌入中的性別偏見(jiàn)是一個(gè)嚴(yán)重的問(wèn)題。想象一下,人們基于有偏詞嵌入開(kāi)發(fā)了一個(gè)簡(jiǎn)歷過(guò)濾模型。該模型可以潛在地過(guò)濾掉像程序員這樣的職位的女性候選人,也可以排除像理發(fā)店這樣的職位的男性候選人。同樣,當(dāng)QA模型被用于解析醫(yī)學(xué)報(bào)告時(shí),如果將醫(yī)生全部默認(rèn)為男性而護(hù)士全部默認(rèn)為女性的則很大可能會(huì)提供錯(cuò)誤的答案。

早期的硬Debias方法

先前的工作[1]通過(guò)后處理(post-processing)從詞嵌入中減去與性別相關(guān)的成分,從而減少了性別偏見(jiàn)。具體而言,它需要一組特定于性別的單詞對(duì),并計(jì)算這些單詞對(duì)的差異向量的第一個(gè)主成分作為嵌入空間中的性別方向。其次,它將有偏見(jiàn)的詞嵌入投射到與推斷的性別方向正交的子空間中,以消除性別偏見(jiàn)。雖然證明了這種方法可以緩解單詞類(lèi)比任務(wù)中的性別偏見(jiàn),但這篇論文(Lipstick on a Pig: Debiasing Methods Cover up Systematic Gender Biases in Word Embeddings But do not Remove Them[2])認(rèn)為這些努力的效果是有限的,因?yàn)樾詣e偏見(jiàn)仍然可以從去偏后的嵌入幾何圖中恢復(fù)。

詞頻會(huì)扭曲性別傾向

在某種情況下,我們假設(shè)很難以現(xiàn)有的「Hard Debias」方法所采用的方式來(lái)識(shí)別單詞嵌入的真實(shí)性別方向。參考資料[3]和[4]表明詞頻顯著影響詞嵌入的幾何形狀。例如,流行詞和稀有詞聚集在嵌入空間的不同子區(qū)域中,盡管事實(shí)上這些詞在語(yǔ)義上并不相似。這可能會(huì)對(duì)識(shí)別性別方向的過(guò)程產(chǎn)生負(fù)面影響,并因此降低“硬性偏見(jiàn)”消除性別偏見(jiàn)的能力。我們通過(guò)經(jīng)驗(yàn)證明,某些單詞的頻率變化會(huì)導(dǎo)致相應(yīng)差異向量與其他差異向量之間的相似性發(fā)生重大變化,如下圖所示。

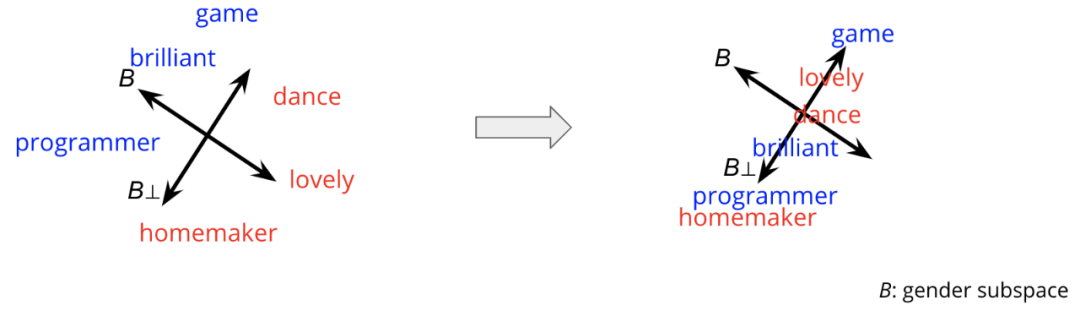

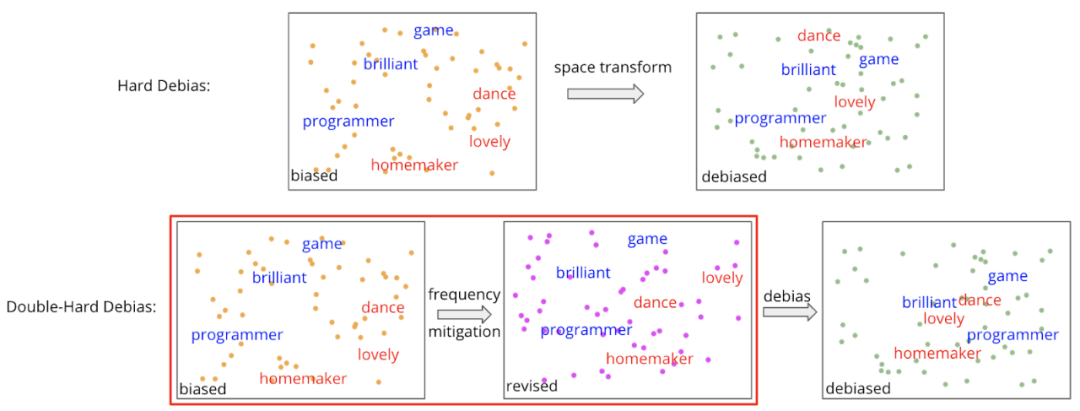

雙重硬性偏差:通過(guò)消除頻率影響來(lái)改善硬性偏差

由于單詞頻率會(huì)扭曲性別方向,因此我們建議使用「Double-Hard Debias」消除單詞頻率的負(fù)面影響。關(guān)鍵思想是在應(yīng)用Hard Debias之前將單詞嵌入投影到intermediate subspace。回想一下,Hard Debias通過(guò)將嵌入空間轉(zhuǎn)換為無(wú)性別的空間來(lái)減少性別偏見(jiàn)。同樣,在Double-Hard Debias中,我們首先將所有單詞嵌入轉(zhuǎn)換為「無(wú)頻率子空間」,在該子空間中,我們能夠計(jì)算出更準(zhǔn)確的性別方向。更具體地說(shuō),我們嘗試找到對(duì)頻率信息進(jìn)行編碼的維度,該頻率信息分散了性別方向的計(jì)算。然后,我們沿著字詞嵌入的這個(gè)特定維度投影組件,以獲得修正的嵌入,并對(duì)修正的嵌入應(yīng)用Hard Debias。

為了識(shí)別此維度,我們采用top biased words的聚類(lèi)作為代理,并反復(fù)測(cè)試詞嵌入的主成分。詳細(xì)步驟如下:

計(jì)算所有單詞嵌入的主成分作為頻率維度候選; 選擇一組最偏(top-biased)的男性和女性詞匯(例如,程序員,家庭主婦,游戲,舞蹈等); 對(duì)沒(méi)有候選維度 分別重讀步驟4-6; 投影嵌入(embedding)到與 正交的中間空間中,從而獲得經(jīng)過(guò)修正的嵌入; 對(duì)修正的嵌入應(yīng)用 Hard Debias; 對(duì)選定的top biased詞的debiased embedding進(jìn)行聚類(lèi),并計(jì)算聚類(lèi)精度。

如果步驟6中的聚類(lèi)算法仍將有偏見(jiàn)的詞聚類(lèi)為與性別對(duì)齊的兩組,則意味著刪除 不能改善去偏性。因此,我們選擇導(dǎo)致有偏詞聚類(lèi)準(zhǔn)確性下降幅度最大的 并將其刪除。

Double-Hard Debias的表現(xiàn)如何?

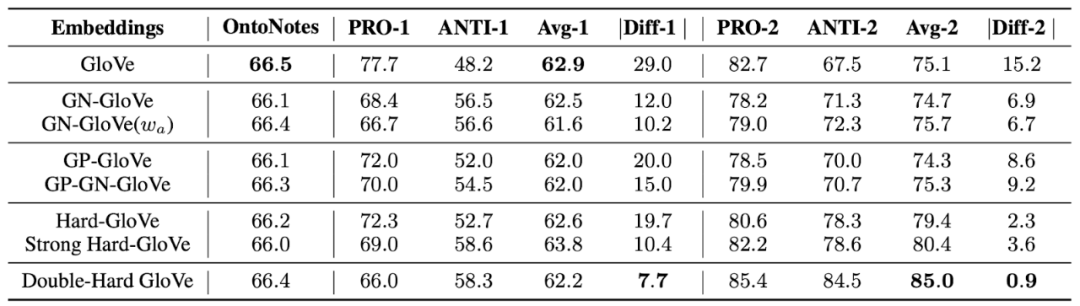

我們?cè)趲讉€(gè)bias mitigation基準(zhǔn)上評(píng)估Double-Hard Debias,包括重要的下游任務(wù)--conference resolution。我們使用 WinoBias數(shù)據(jù)集來(lái)量化性別偏見(jiàn)。WinoBias由兩種類(lèi)型的句子組成。每種類(lèi)型的句子可以分為pro-stereotype子集和anti stereotype子集,性別是這兩個(gè)子集之間的唯一區(qū)別。類(lèi)型1句子中的一個(gè)示例包含一個(gè)定型觀念句子:「The physician hired the secretary because he was overwhelmed with clients」。還有一個(gè)反刻板印象的句子:「The physician hired the secretary because she was overwhelmed with clients」。前定型和反定型之間的性能差異反映了共指系統(tǒng)在男性和女性群體中的表現(xiàn)差異。因此,我們將此差距視為性別偏見(jiàn)得分。最初的GloVe嵌入帶有明顯的性別偏見(jiàn),因?yàn)槲覀兛梢钥吹絻煞N類(lèi)型的句子的性能差距分別達(dá)到29點(diǎn)和15點(diǎn)。與Hard Debias和其他最新的debiasing方法相比,我們的方法在兩種共指句子中都實(shí)現(xiàn)了最小的差異。同時(shí),Double-Hard Debias還保留了詞嵌入中有用的語(yǔ)義信息。在原始測(cè)試集上,我們僅觀察到F1分?jǐn)?shù)下降了0.1%。

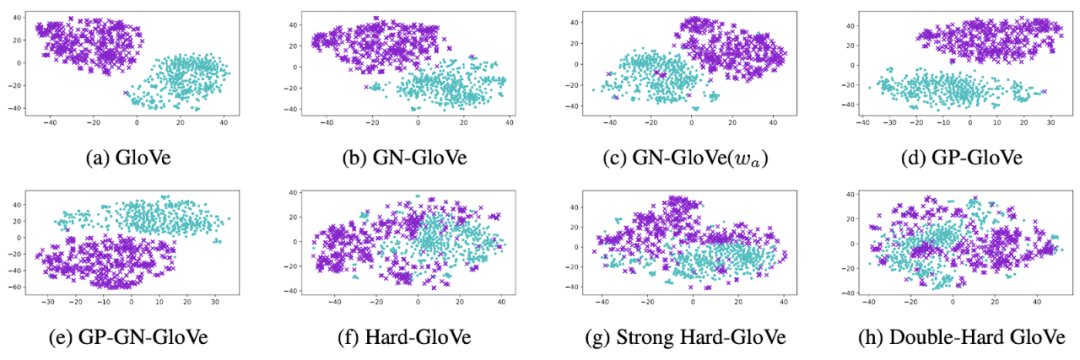

我們還對(duì)所有前500個(gè)有偏見(jiàn)的女性和男性嵌入進(jìn)行tSNE預(yù)測(cè)。如下圖所示,原始的GloVe嵌入明顯投影到了不同的區(qū)域,表明強(qiáng)烈的性別偏見(jiàn)。與其他方法相比,Double-Hard GloVe最大程度地混合了男性和女性的嵌入,顯示出在消除偏見(jiàn)后可以捕獲到較少的性別信息。

結(jié)論

我們發(fā)現(xiàn)單詞頻率統(tǒng)計(jì)信息的簡(jiǎn)單變化可能會(huì)對(duì)用于消除單詞嵌入中性別偏見(jiàn)的去偏方法產(chǎn)生不良影響。盡管迄今為止在以前的性別偏見(jiàn)減少工作中都忽略了詞頻統(tǒng)計(jì),但是我們提出了Double-Hard Debias,它減輕了詞頻特征對(duì)去偏算法的負(fù)面影響。我們認(rèn)為,提供公平實(shí)用的單詞嵌入很重要,希望這項(xiàng)工作能夠激發(fā)沿這個(gè)方向的進(jìn)一步研究。

本文參考資料

Man is to Computer Programmer as Woman is to Homemaker? Debiasing Word Embeddings: https://arxiv.org/abs/1607.06520

[2][Lipstick on a Pig: Debiasing Methods Cover up Systematic Gender Biases in Word Embeddings But do not Remove Them: https://arxiv.org/abs/1903.03862

-?END?-

往期精彩回顧

獲取一折本站知識(shí)星球優(yōu)惠券,復(fù)制鏈接直接打開(kāi):

https://t.zsxq.com/yFQV7am

本站qq群1003271085。

加入微信群請(qǐng)掃碼進(jìn)群: