MongoDB vs MySQL,哪個效率更高?

一、MongoDB批量操作

BulkWriteResult??com.mongodb.client.MongoCollection.bulkWrite(List>?requests)

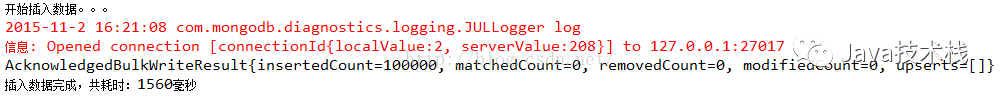

1、插入操作

public?void?bulkWriteInsert(List?documents){

?List>?requests?=?new?ArrayList>();

?for?(Document?document?:?documents)?{

??//構造插入單個文檔的操作模型

??InsertOneModel??iom?=?new?InsertOneModel(document);

??requests.add(iom);

?}

?BulkWriteResult??bulkWriteResult?=?collection.bulkWrite(requests);

?System.out.println(bulkWriteResult.toString());

}

TestMongoDB?instance?=?TestMongoDB.getInstance();

ArrayList?documents?=?new?ArrayList();

for?(int?i?=?0;?i??Product?product?=?new?Product(i,"書籍","追風箏的人",22.5);

?//將java對象轉換成json字符串

?String?jsonProduct?=?JsonParseUtil.getJsonString4JavaPOJO(product);

?//將json字符串解析成Document對象

?Document?docProduct?=?Document.parse(jsonProduct);

?documents.add(docProduct);

}

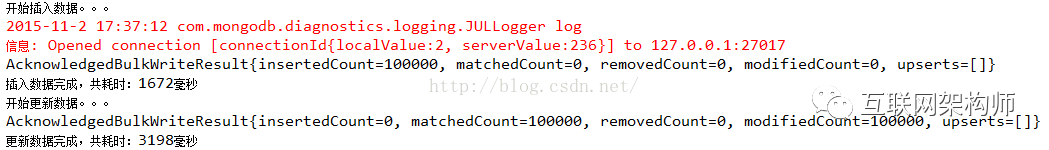

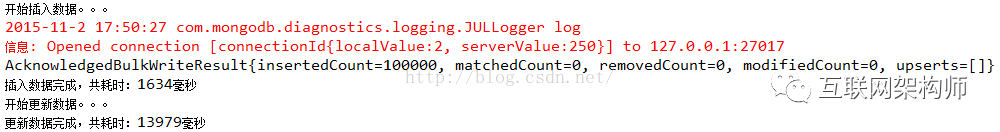

System.out.println("開始插入數(shù)據(jù)。。。");

long?startInsert?=?System.currentTimeMillis();

instance.bulkWriteInsert(documents);

System.out.println("插入數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?startInsert)+"毫秒");

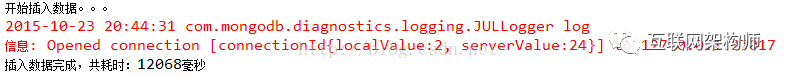

(2)、逐條插入

下面再通過非批量插入10萬個數(shù)據(jù)對比下,方法如下:

?public?void?insertOneByOne(List?documents)?throws?ParseException{

??for?(Document?document?:?documents){

???collection.insertOne(document);

??}

?}

測試:10萬條數(shù)據(jù)

System.out.println("開始插入數(shù)據(jù)。。。");

long?startInsert?=?System.currentTimeMillis();

instance.insertOneByOne(documents);

System.out.println("插入數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?startInsert)+"毫秒");

結果:12068毫秒,差距非常大。由此可見,MongoDB批量插入比逐條數(shù)據(jù)插入效率提高了非常多。

補充:

MongoCollection的insertMany()方法和bulkWrite()方法是等價的,測試時間差不多,不再貼圖。

?public?void?insertMany(List?documents)?throws?ParseException{

??//和bulkWrite()方法等價

??collection.insertMany(documents);

?}

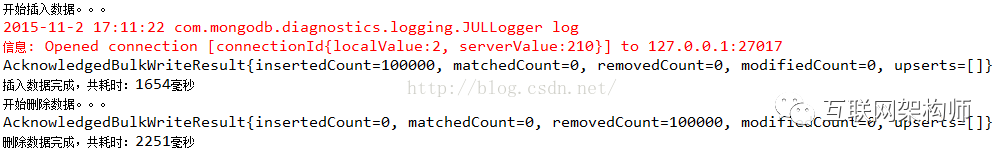

2、刪除操作

_id字段,該字段在文檔插入數(shù)據(jù)庫后自動生成,沒插入數(shù)據(jù)庫前document.get("_id")為null,如果使用其他條件比如productId,那么要在文檔插入到collection后在productId字段上添加索引collection.createIndex(new?Document("productId",?1));

因為隨著collection數(shù)據(jù)量的增大,查找將越耗時,添加索引是為了提高查找效率,進而加快刪除效率。另外,值得一提的是DeleteOneModel表示至多刪除一條匹配條件的記錄,DeleteManyModel表示刪除匹配條件的所有記錄。為了防止一次刪除多條記錄,這里使用DeleteOneModel,保證一個操作只刪除一條記錄。當然這里不可能匹配多條記錄,因為_id是唯一的。搜索公眾號互聯(lián)網(wǎng)架構師后臺回復“2T”,獲取一份驚喜禮包。

public?void?bulkWriteDelete(List?documents){

?List>?requests?=?new?ArrayList>();

?for?(Document?document?:?documents)?{

??//刪除條件

??Document?queryDocument?=?new?Document("_id",document.get("_id"));

??//構造刪除單個文檔的操作模型,

??DeleteOneModel??dom?=?new?DeleteOneModel(queryDocument);

??requests.add(dom);

?}

?BulkWriteResult?bulkWriteResult?=?collection.bulkWrite(requests);

?System.out.println(bulkWriteResult.toString());

}

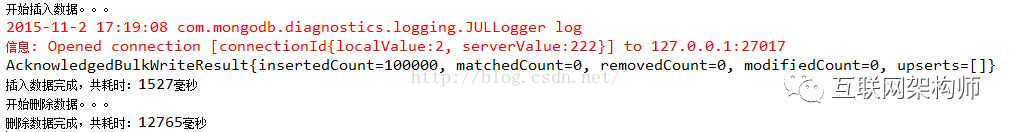

System.out.println("開始刪除數(shù)據(jù)。。。");

long?startDelete?=?System.currentTimeMillis();

instance.bulkWriteDelete(documents);

System.out.println("刪除數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?startDelete)+"毫秒");

(2)、逐條刪

來看看在非批量下的刪除

?public?void?deleteOneByOne(List?documents){

??for?(Document?document?:?documents)?{

???Document?queryDocument?=?new?Document("_id",document.get("_id"));

???DeleteResult?deleteResult?=?collection.deleteOne(queryDocument);

??}

?}

System.out.println("開始刪除數(shù)據(jù)。。。");

long?startDelete?=?System.currentTimeMillis();

instance.deleteOneByOne(documents);

System.out.println("刪除數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?startDelete)+"毫秒");

3、更新操作

(1)、批量更新

?public?void?bulkWriteUpdate(List?documents){

??List>?requests?=?new?ArrayList>();

??for?(Document?document?:?documents)?{

???//更新條件

???Document?queryDocument?=?new?Document("_id",document.get("_id"));

???//更新內(nèi)容,改下書的價格

???Document?updateDocument?=?new?Document("$set",new?Document("price","30.6"));

???//構造更新單個文檔的操作模型

???UpdateOneModel?uom?=?new?UpdateOneModel(queryDocument,updateDocument,new?UpdateOptions().upsert(false));

???//UpdateOptions代表批量更新操作未匹配到查詢條件時的動作,默認false,什么都不干,true時表示將一個新的Document插入數(shù)據(jù)庫,他是查詢部分和更新部分的結合

???requests.add(uom);

??}

??BulkWriteResult?bulkWriteResult?=?collection.bulkWrite(requests);

??System.out.println(bulkWriteResult.toString());

?}

System.out.println("開始更新數(shù)據(jù)。。。");

long?startUpdate?=?System.currentTimeMillis();

instance.bulkWriteUpdate(documents);

System.out.println("更新數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?startUpdate)+"毫秒");

(2)、逐條更新

對比非批量下的更新

?public?void?updateOneByOne(List?documents){

??for?(Document?document?:?documents)?{

???Document?queryDocument?=?new?Document("_id",document.get("_id"));

???Document?updateDocument?=?new?Document("$set",new?Document("price","30.6"));

???UpdateResult?UpdateResult?=?collection.updateOne(queryDocument,?updateDocument);

??}

?}

System.out.println("開始更新數(shù)據(jù)。。。");

long?startUpdate?=?System.currentTimeMillis();

instance.updateOneByOne(documents);

System.out.println("更新數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?startUpdate)+"毫秒");

4、混合批量操作

?public?void?bulkWriteMix(){

??List>?requests?=?new?ArrayList>();

???InsertOneModel??iom?=?new?InsertOneModel(new?Document("name","kobe"));

???UpdateManyModel?umm?=?new?UpdateManyModel(new?Document("name","kobe"),

?????new?Document("$set",new?Document("name","James")),new?UpdateOptions().upsert(true));

???DeleteManyModel??dmm?=?new?DeleteManyModel(new?Document("name","James"));

???requests.add(iom);

???requests.add(umm);

???requests.add(dmm);

???BulkWriteResult?bulkWriteResult?=?collection.bulkWrite(requests);

???System.out.println(bulkWriteResult.toString());

?}

注意:updateMany()、deleteMany()兩個方法和insertMany()不同,它倆不是批量操作,而是代表更新(刪除)匹配條件的所有數(shù)據(jù)。

二、與MySQL性能對比

1、插入操作

與MongoDB一樣,也是插入Product實體對象,代碼如下

?public?void?insertBatch(ArrayList?list)?throws?Exception{

??Connection?conn?=?DBUtil.getConnection();

??try?{

???PreparedStatement?pst?=?conn.prepareStatement("insert?into?t_product?value(?,?,?,?)");

???int?count?=?1;

???for?(Product?product?:?list)?{

????pst.setInt(1,?product.getProductId());

????pst.setString(2,?product.getCategory());

????pst.setString(3,?product.getName());

????pst.setDouble(4,?product.getPrice());

????pst.addBatch();

????if(count?%?1000?==?0){

?????pst.executeBatch();

?????pst.clearBatch();//每1000條sql批處理一次,然后置空PreparedStatement中的參數(shù),這樣也能提高效率,防止參數(shù)積累過多事務超時,但實際測試效果不明顯

????}

????count++;

???}

???conn.commit();

??}?catch?(SQLException?e)?{

???e.printStackTrace();

??}

??DBUtil.closeConnection(conn);

?}

connection.setAutoCommit(false);

public?static?void?main(String[]?args)?throws?Exception?{

????????????TestMysql?test?=?new?TestMysql();

????????????ArrayList?list?=?new?ArrayList();

????????????for?(int?i?=?0;?i?????????????????Product?product?=?new?Product(i,?"書籍",?"追風箏的人",?20.5);

????????????????list.add(product);

????????????}

????????????System.out.println("MYSQL開始插入數(shù)據(jù)。。。");

????????????long?insertStart?=?System.currentTimeMillis();

????????????test.insertBatch(list);

????????????System.out.println("MYSQL插入數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?insertStart)+"毫秒");

}

再來看看mysql逐條插入,代碼如下:

?public?void?insertOneByOne(ArrayList?list)?throws?Exception{

??Connection?conn?=?DBUtil.getConnection();

??try?{

???for?(Product?product?:?list)?{

????PreparedStatement?pst?=?conn.prepareStatement("insert?into?t_product?value(?,?,?,?)");

????pst.setInt(1,?product.getProductId());

????pst.setString(2,?product.getCategory());

????pst.setString(3,?product.getName());

????pst.setDouble(4,?product.getPrice());

????pst.executeUpdate();

????//conn.commit();//加上這句每次插入都提交事務,結果將是非常耗時

???}

???conn.commit();

??}?catch?(SQLException?e)?{

???e.printStackTrace();

??}

??DBUtil.closeConnection(conn);

?}

System.out.println("MYSQL開始插入數(shù)據(jù)。。。");

long?insertStart?=?System.currentTimeMillis();

test.insertOneByOne(list);

System.out.println("MYSQL插入數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?insertStart)+"毫秒");

2、刪除操作

?public?void?deleteBatch(ArrayList?list)?throws?Exception{

??Connection?conn?=?DBUtil.getConnection();

??try?{

???PreparedStatement?pst?=?conn.prepareStatement("delete?from?t_product?where?id?=??");//按主鍵查,否則全表遍歷很慢

???int?count?=?1;

???for?(Product?product?:?list)?{

????pst.setInt(1,?product.getProductId());

????pst.addBatch();

????if(count?%?1000?==?0){

?????pst.executeBatch();

?????pst.clearBatch();

????}

????count++;

???}

???conn.commit();

??}?catch?(SQLException?e)?{

???e.printStackTrace();

??}

??DBUtil.closeConnection(conn);

?}

System.out.println("MYSQL開始刪除數(shù)據(jù)。。。");

long?deleteStart?=?System.currentTimeMillis();

test.deleteBatch(list);

System.out.println("MYSQL刪除數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?deleteStart)+"毫秒");

?public?void?deleteOneByOne(ArrayList?list)?throws?Exception{

??Connection?conn?=?DBUtil.getConnection();

??PreparedStatement?pst?=?null;

??try?{

???for?(Product?product?:?list)?{

????pst?=?conn.prepareStatement("delete?from?t_product?where?id?=??");

????pst.setInt(1,?product.getProductId());

????pst.executeUpdate();

????//conn.commit();//加上這句每次插入都提交事務,結果將是非常耗時

???}

???conn.commit();

??}?catch?(SQLException?e)?{

???e.printStackTrace();

??}

??DBUtil.closeConnection(conn);

?}

System.out.println("MYSQL開始刪除數(shù)據(jù)。。。");

long?deleteStart?=?System.currentTimeMillis();

test.deleteOneByOne(list);

System.out.println("MYSQL刪除數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?deleteStart)+"毫秒");

3、更新操作

?public?void?updateBatch(ArrayList?list)?throws?Exception{

??Connection?conn?=?DBUtil.getConnection();

??try?{

???PreparedStatement?pst?=?conn.prepareStatement("update?t_product?set?price=31.5?where?id=?");

???int?count?=?1;

???for?(Product?product?:?list)?{

????pst.setInt(1,?product.getProductId());

????pst.addBatch();

????if(count?%?1000?==?0){

?????pst.executeBatch();

?????pst.clearBatch();//每1000條sql批處理一次,然后置空PreparedStatement中的參數(shù),這樣也能提高效率,防止參數(shù)積累過多事務超時,但實際測試效果不明顯

????}

????count++;

???}

???conn.commit();

??}?catch?(SQLException?e)?{

???e.printStackTrace();

??}

??DBUtil.closeConnection(conn);

?}

System.out.println("MYSQL開始更新數(shù)據(jù)。。。");

long?updateStart?=?System.currentTimeMillis();

test.updateBatch(list);

System.out.println("MYSQL更新數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?updateStart)+"毫秒");

public?void?updateOneByOne(ArrayList?list)?throws?Exception{

??Connection?conn?=?DBUtil.getConnection();

??try?{

???for?(Product?product?:?list)?{

????PreparedStatement?pst?=?conn.prepareStatement("update?t_product?set?price=30.5?where?id=?");

????pst.setInt(1,?product.getProductId());

????pst.executeUpdate();

????//conn.commit();//加上這句每次插入都提交事務,結果將是非常耗時

???}

???conn.commit();

??}?catch?(SQLException?e)?{

???e.printStackTrace();

??}

??DBUtil.closeConnection(conn);

?}

System.out.println("MYSQL開始更新數(shù)據(jù)。。。");

long?updateStart?=?System.currentTimeMillis();

test.updateOneByOne(list);

System.out.println("MYSQL更新數(shù)據(jù)完成,共耗時:"+(System.currentTimeMillis()?-?updateStart)+"毫秒");

三、總結

原文鏈接:https://blog.csdn.net/u014513883/article/details/49365987

?「全棧架構社區(qū)」建立了讀者架構師交流群,大家可以添加小編微信進行加群。歡迎有想法、樂于分享的朋友們一起交流學習。

掃描添加好友邀你進架構師群,加我時注明【姓名+公司+職位】

看完本文有收獲?請轉發(fā)分享給更多人

往期資源: