開源|CVPR 2021:第一個針對行為識別的黑盒攻擊算法BASAR

單位|利茲大學(xué),西南交通大學(xué),浙江大學(xué),巴斯大學(xué)

極市導(dǎo)讀

本文主要是研究了一種特殊但十分重要的時序數(shù)據(jù)——骨架動作下的對抗攻擊,提出了第一個針對骨架行為識別的黑盒攻擊方法BASAR。這是第一次在對抗攻擊時間序列數(shù)據(jù)的背景下引入數(shù)據(jù)流形的概念。 >>加入極市CV技術(shù)交流群,走在計算機(jī)視覺的最前沿

對抗樣本是近年來非常熱門的研究問題,但是大多數(shù)的研究往往針對于靜態(tài)數(shù)據(jù)(圖像、文本、幾何),然而時序數(shù)據(jù)上的探索往往較少,本文主要是研究了一種特殊但十分重要的時序數(shù)據(jù)——骨架動作下的對抗攻擊。我們提出了第一個針對骨架行為識別的黑盒攻擊方法BASAR。與現(xiàn)有方法在攻擊時主要考慮分類邊界不同,BASAR探索了分類邊界與自然運(yùn)動流形(natural motion manifold)之間的相互作用,這也是第一次在對抗攻擊時間序列數(shù)據(jù)的背景下引入數(shù)據(jù)流形的概念。

原文鏈接:https://arxiv.org/abs/2103.05266

代碼鏈接:https://github.com/realcrane/BASAR-Black-box-Attack-on-Skeletal-Action-Recognition

行為識別對抗攻防項目鏈接:http://drhewang.com/pages/AAHAR.html

1 引言

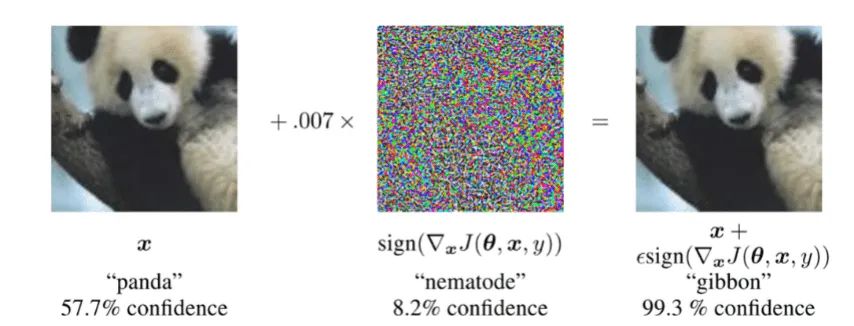

對抗樣本 通常是指對輸入樣本添加一些人為無法察覺到的擾動,導(dǎo)致模型以高置信度給出一個錯誤的輸出,例如圖例中原樣本的標(biāo)簽為“熊貓”,經(jīng)過添加擾動后,分類器分類為錯誤的標(biāo)簽“長臂猿”。目前對抗樣本在靜態(tài)數(shù)據(jù)上(圖像、文本、幾何)已經(jīng)做了大量的研究,但是對于時序數(shù)據(jù)相關(guān)的研究較少。骨架運(yùn)動數(shù)據(jù),作為一種特殊的時序數(shù)據(jù),在人類行為活動識別中起著至關(guān)重要的作用,因此骨架行為識別的安全性問題最近開始也漸漸受到了大家的關(guān)注。但是當(dāng)前的針對骨架行為識別的安全性研究主要有兩個方面的問題還沒有被解決:

1)目前基于骨架行為識別的攻擊方法和魯棒性研究主要是在“白盒”設(shè)定下的,即模型參數(shù)可以完全被外界獲取。然而,在現(xiàn)實場景中,模型參數(shù)往往難以獲得,因此白盒設(shè)定下的骨架運(yùn)動攻擊無法被視為是現(xiàn)實中對模型真實存在的威脅。在本文中,我們證明了這種威脅在現(xiàn)實中是真實存在的。為此,我們提出了第一個骨架黑盒攻擊方法BASAR。

2)通常的觀點認(rèn)為對抗樣本是被人為精心制造出來的,盡管這種擾動在現(xiàn)實中不存在,只要人工生成的擾動足夠小,加入到圖片等靜態(tài)數(shù)據(jù)中往往難以被人察覺,但是這種生成對抗擾動的方式直接應(yīng)用到骨架數(shù)據(jù)上時會面臨一些問題。首先,骨架數(shù)據(jù)具有低維度性(Low-dimensionality)和Dynamics Sensitivity,骨骼運(yùn)動具有人類感知系統(tǒng)可以充分識別的運(yùn)動學(xué)特點,并且每幀的關(guān)節(jié)數(shù)是一定的,這就使得相比于圖片,可以攻擊的維度較少而易被察覺,并且就算是認(rèn)為添加較小的擾動,也有可能破壞了運(yùn)動學(xué)特性而被人輕易的觀察出來。(例如添加在脊柱上的擾動,盡管很小但也可能違背了人體動力學(xué)而造成不自然的抖動)

為解決上述兩個問題,我們提出了第一個骨架黑盒攻擊方法BASAR。更重要的是,不同于一般對于對抗樣本是人為制造出來,與原始樣本不在同一個數(shù)據(jù)分布上的觀點,我們利用BASAR證明了骨架上的對抗樣本完全可以是現(xiàn)實中真實存在的,也就是說可以與原始樣本在一個分布上。我們將這種對抗樣本稱為流形對抗樣本(on-manifold adversarial samples)。

通過詳盡的評估和比較,我們表明BASAR可以在不同的模型、數(shù)據(jù)集和攻擊方式下完成攻擊。另外,由于骨架運(yùn)動獨(dú)特的約束限制(骨長、關(guān)節(jié)旋轉(zhuǎn)角度)和動力學(xué)特性,單單依靠傳統(tǒng)的距離度量方法(比如I norm based distance)無法在骨架運(yùn)動問題上作為一個可靠的感知度量方法。因此,我們采用感知研究來評估BASAR生成樣本的不可察覺性,結(jié)果表明BASAR可以實現(xiàn)有效而不易察覺的攻擊。通過分析對不同行為識別算法的攻擊,BASAR可以幫助確定其脆弱性的潛在原因,并提供了什么樣的行為識別分類器可以更強(qiáng)大地抵御對抗攻擊的見解。我們希望通過我們的研究引起人們對行為識別模型的安全隱患的關(guān)注,因為通過本文已經(jīng)證明了行為識別的對抗樣本在現(xiàn)實中是真實存在的。

2 論文貢獻(xiàn)

該論文的貢獻(xiàn)可以總結(jié)為如下三條:

-

提出了第一個骨架黑盒攻擊方法,并全面評估了幾種最新骨架識別模型的脆弱性。 -

顯示了流形對抗樣本在不同數(shù)據(jù)集上的廣泛存在,并對什么類型的分類器可以抵御流形對抗樣本提出了自己的見解。 -

顯示了流形對抗性樣本是真正危險的,因為即使在嚴(yán)格的感知測試下,它們也不容易被發(fā)現(xiàn)

3 方法

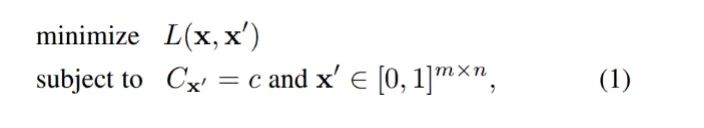

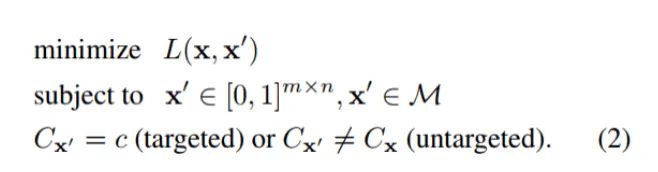

一般的對抗樣本可以被定義為公式(1):

其中, 和 '分別為原樣本和對抗樣本, 為距離度量函數(shù), 為分類器的分類標(biāo)簽, 為正確的分類結(jié)果。然而, 簡單的在骨架運(yùn)動中應(yīng)用公式 (1) 是行不通的。考慮到人類的 pose 都位于一個自然的流形 上, 我們因此對公式 添加了另一個約束 :

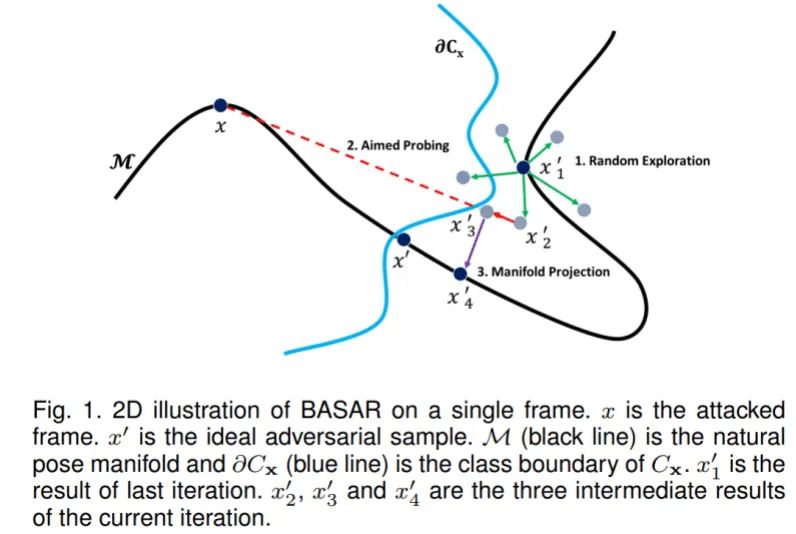

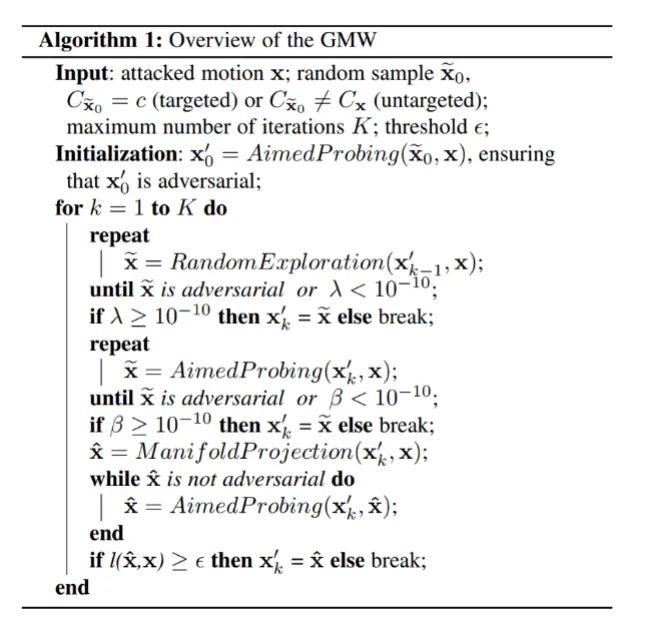

由于公式(2)是高度非線性的,難以用解析形式求解,我們因此提出了一種稱為Guided Manifold Walk(GMW)的數(shù)值解方法。其主要思路是在每次迭代中,執(zhí)行Random Exploration, Aimed Probing 和 Manifold Projection三個子程序。執(zhí)行Random Exploration的目的是在接近分類邊界的地方進(jìn)行探索;執(zhí)行Aimed Probing的目的是找到一個更接近原始樣本的新的對抗樣本。在執(zhí)行完Random Exploration和Aimed Probing后的對抗樣本通常遠(yuǎn)離真實的流形空間,使得pose看起來不真實和不自然。我們因此需要執(zhí)行Manifold Projection將非流形空間上的對抗樣本重新投影到流形空間上。更多的算法細(xì)節(jié)可以參考原文。

4 實驗結(jié)果

4.1數(shù)值評估

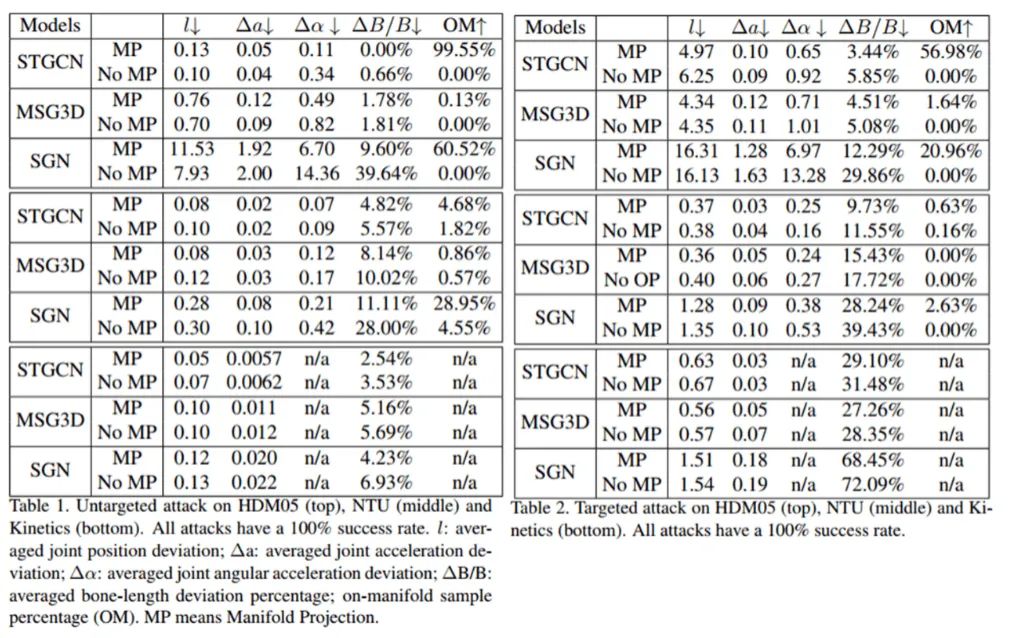

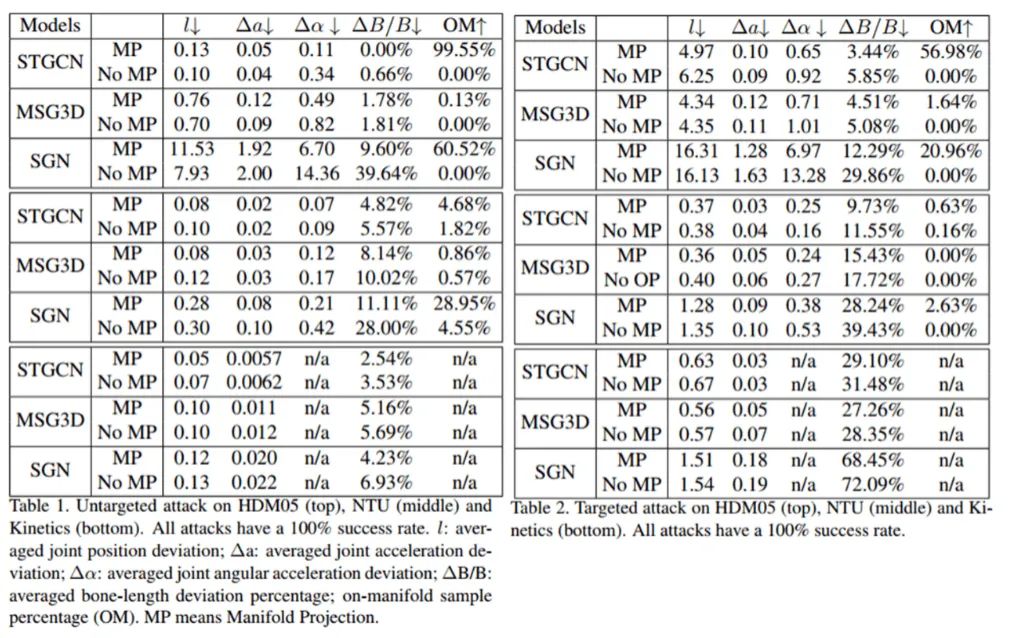

我們選擇了三個 state-of-the-art 模型 STGCN, MSG3D 和 SGN; 選擇的數(shù)據(jù)集為 HDM05, NTU 60 和 Kinetics。除了攻擊成功率, 我們還報告了對抗樣本和原樣本之間的距離誤差 (I), 加速度誤差 , 角加速度誤差 , 骨長誤差 和生成流形對抗樣本的概率(OM)作為 數(shù)值評估指標(biāo)。如下表所示,BASAR 在非目標(biāo)攻擊/目標(biāo)攻擊下生成流行對抗樣本的概率可 以高達(dá) 。同時通過消融實驗可以發(fā)現(xiàn),執(zhí)行了 Manifold Projection 生成的對抗 樣本幾乎各項數(shù)值評價指標(biāo)都要高于未執(zhí)行 Manifold Projection 生成的對抗樣本。

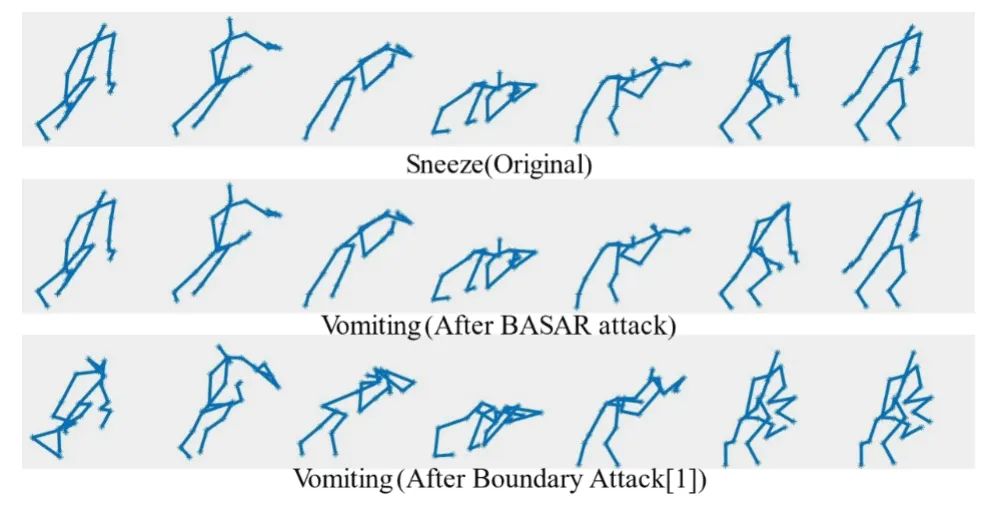

由于BASAR是第一個黑盒骨架攻擊方法,沒有其他的基線方法可以用來比較,因此我們采用了與我們最相似的幾種方法與我們的進(jìn)行比較,分別是骨架遷移攻擊SMART,時序數(shù)據(jù)黑盒攻擊方法MTS和圖像黑盒攻擊方法Boundary Attack。從結(jié)果中可以看書,BASAR的表現(xiàn)遠(yuǎn)遠(yuǎn)高于這三種方法。

4.2感知評估

單獨(dú)的數(shù)值評估并不足以評估骨架對抗樣本的不可感知性,因為距離度量函數(shù)在高維空間下不符合人類的感性性,因此它們不能準(zhǔn)確地表明攻擊是否能被人類察覺。為此我們采用user-study的方式進(jìn)行了三種感知研究:可欺騙性,自然性和不可分辨性。

可欺騙性(Deceitfulness) 感知研究是用來測試BASAR是否在視覺上改變了動作的語義,結(jié)果顯示79.64%的參加實驗者認(rèn)為BASAR在視覺上沒有改變動作的語義。

自然性(Naturalness) 感知研究是用來測試流形對抗樣本和非流形對抗樣本哪一種看起來更自然,結(jié)果顯示85%的參加實驗者認(rèn)為執(zhí)行了Manifold Projection的動作看起來更自然。不可分辨性(Indistinguishability) 是最嚴(yán)格的感知測試,用來測試用戶是否可以察覺到對抗樣本的任何改動,結(jié)果顯示89.9%的對抗樣本與原始樣本無法區(qū)分。其中94.63%的流形對抗樣本與原視樣本無法被區(qū)分,84.69%的非流形對抗樣本與原樣本無法被區(qū)分。

4.3 模型魯棒性的分析

從BASAR的攻擊結(jié)果來看,一般考慮了運(yùn)動的語義信息,骨長信息的模型防御表現(xiàn)更好,具體的分析結(jié)果請看原文。

本文亮點總結(jié)

-

提出了第一個骨架黑盒攻擊方法,并全面評估了幾種最新骨架識別模型的脆弱性。 -

顯示了流形對抗樣本在不同數(shù)據(jù)集上的廣泛存在,并對什么類型的分類器可以抵御流形對抗樣本提出了自己的見解。 -

顯示了流形對抗性樣本是真正危險的,因為即使在嚴(yán)格的感知測試下,它們也不容易被發(fā)現(xiàn)

如果覺得有用,就請分享到朋友圈吧!

公眾號后臺回復(fù)“79”獲取CVPR 2021:TransT 直播鏈接~

# CV技術(shù)社群邀請函 #

備注:姓名-學(xué)校/公司-研究方向-城市(如:小極-北大-目標(biāo)檢測-深圳)

即可申請加入極市目標(biāo)檢測/圖像分割/工業(yè)檢測/人臉/醫(yī)學(xué)影像/3D/SLAM/自動駕駛/超分辨率/姿態(tài)估計/ReID/GAN/圖像增強(qiáng)/OCR/視頻理解等技術(shù)交流群

每月大咖直播分享、真實項目需求對接、求職內(nèi)推、算法競賽、干貨資訊匯總、與 10000+來自港科大、北大、清華、中科院、CMU、騰訊、百度等名校名企視覺開發(fā)者互動交流~