使用姿勢(shì)估計(jì)進(jìn)行跌倒檢測(cè)

點(diǎn)擊下面卡片關(guān)注“AI算法與圖像處理”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時(shí)間送達(dá)

所有目標(biāo)檢測(cè)已成為動(dòng)作識(shí)別研究的重要墊腳石,即訓(xùn)練AI對(duì)行走和坐下等一般動(dòng)作進(jìn)行分類。為了使AI能夠理解接收到的輸入,我們需要教它檢測(cè)特定的圖案和形狀,并制定自己的規(guī)則。

為了構(gòu)建能夠檢測(cè)跌倒的AI ,我們決定不收集大型數(shù)據(jù)集和為此目的專門訓(xùn)練模型。相反,我們使用姿勢(shì)估計(jì)作為構(gòu)建基塊。

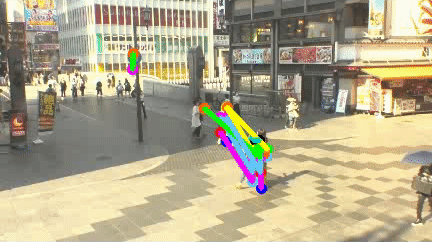

姿勢(shì)估計(jì)是人體關(guān)節(jié)(通常稱為關(guān)鍵點(diǎn))在圖像和視頻幀中的定位。通常,每個(gè)人都將由多個(gè)關(guān)鍵點(diǎn)組成。將在關(guān)鍵點(diǎn)對(duì)之間繪制線條,有效地繪制人的粗略形狀。基于輸入和檢測(cè)方法的姿勢(shì)估計(jì)方法有很多種。

為了使每個(gè)人都可以輕松訪問(wèn)此模型,我將輸入選擇為RGB圖像并由OpenCV處理。這意味著它與典型的網(wǎng)絡(luò)攝像頭,視頻文件甚至HTTP / RTSP流兼容。

我們使用的姿勢(shì)估計(jì)模型是EPFL的VITA實(shí)驗(yàn)室的OpenPifPaf。檢測(cè)方法是自下而上的,這意味著AI首先分析整個(gè)圖像并找出它看到的所有關(guān)鍵點(diǎn)。然后,它將關(guān)鍵點(diǎn)組合在一起以確定圖像中的人物。這與自頂向下方法不同,在自頂向下方法中,AI使用基本人員檢測(cè)器來(lái)識(shí)別感興趣的區(qū)域,然后再放大以識(shí)別各個(gè)關(guān)鍵點(diǎn)。要了解有關(guān)OpenPifPaf如何開發(fā)的更多信息,請(qǐng)查看其CVPR 2019論文或閱讀其源代碼。

大多數(shù)開源模型只能在任何時(shí)候處理單個(gè)輸入。為了將來(lái)使它更具通用性和可擴(kuò)展性,我們使用了Python中的多處理庫(kù)來(lái)使用子進(jìn)程同時(shí)處理多個(gè)流。這使我們能夠在具有此功能的計(jì)算機(jī)上充分利用多個(gè)處理器。

在有多個(gè)人的視頻幀中,可能很難找出一個(gè)跌倒的人。這是因?yàn)樗惴ㄐ枰谶B續(xù)的幀之間關(guān)聯(lián)同一個(gè)人。但是,如果他/她不斷移動(dòng),它如何知道是否在看同一個(gè)人呢?

解決方案是實(shí)施多人跟蹤器。不一定要花哨;只需一個(gè)簡(jiǎn)單的通用對(duì)象跟蹤器就足夠了。如何完成跟蹤非常簡(jiǎn)單明了,可以在以下步驟中進(jìn)行概述:

1. 計(jì)算質(zhì)心(以脖子為準(zhǔn))。

2. 為每個(gè)質(zhì)心分配唯一的ID。

3. 在下一幀中計(jì)算新質(zhì)心。

4. 計(jì)算當(dāng)前幀和上一幀的質(zhì)心之間的歐幾里得距離,并根據(jù)最小距離對(duì)其進(jìn)行關(guān)聯(lián)。

5. 如果找到相關(guān)性,請(qǐng)使用舊質(zhì)心的ID更新新質(zhì)心。

6. 如果未找到相關(guān)性,則給新質(zhì)心一個(gè)唯一的ID(新人進(jìn)入框架)。

7. 如果此人離開框架達(dá)一定數(shù)量的框架,請(qǐng)移除質(zhì)心和ID。

概念化的初始跌倒檢測(cè)算法相對(duì)簡(jiǎn)單。我首先選擇脖子作為穩(wěn)定的參考點(diǎn)(與擺動(dòng)的胳膊和腿比較)。接下來(lái),我根據(jù)定義整個(gè)人的邊界框計(jì)算了人的感知高度。然后,我以幀間隔計(jì)算了脖子點(diǎn)之間的垂直距離。如果垂直距離超過(guò)人的感知身高的一半,則該算法將發(fā)出跌倒信號(hào)。

但是,在觀看多部關(guān)于摔倒的YouTube視頻之后,我意識(shí)到摔倒的方式和方向不同。當(dāng)視場(chǎng)傾斜時(shí),未檢測(cè)到一些跌倒,因?yàn)槭芎φ咚坪醪](méi)有劇烈運(yùn)動(dòng)變化。我的模型也不夠精確,當(dāng)人們彎腰綁鞋帶或直接沿著視頻幀奔跑時(shí),我的模型總是會(huì)產(chǎn)生誤報(bào)。

我們決定實(shí)施更多功能來(lái)完善算法:

我們沒(méi)有分析一維運(yùn)動(dòng)(y軸),而是分析了二維運(yùn)動(dòng)(x軸和y軸)以包含不同的相機(jī)角度。

添加了邊界框檢查,以查看人的寬度是否大于其身高。這假定該人在地面上而不是直立的。通過(guò)使用這種方法,快速移動(dòng)的人或騎自行車的人可以消除誤報(bào)。

添加了兩點(diǎn)檢查功能,僅當(dāng)可以同時(shí)檢測(cè)到該人的脖子和腳踝點(diǎn)時(shí)才注意跌倒。如果由于遮擋而無(wú)法完全識(shí)別人的身高,這可以防止對(duì)人的身高進(jìn)行不正確的計(jì)算

在撰寫本文時(shí),缺乏大量的跌倒檢測(cè)數(shù)據(jù)集。我們選擇UR跌倒檢測(cè)數(shù)據(jù)集來(lái)測(cè)試我的模型,因?yàn)樗煌牡箞?chǎng)景。在總共30個(gè)視頻中,該模型正確地識(shí)別了25個(gè)跌倒,并在主體掉出畫面時(shí)錯(cuò)過(guò)了另外5個(gè)跌倒。這給了我們83.33%的精確度和90.91%的F1分?jǐn)?shù)。

這些結(jié)果可以被認(rèn)為是一個(gè)良好的開端,但由于樣本量較小,因此尚無(wú)定論。由于沒(méi)有其他類似跌倒的動(dòng)作(例如系鞋帶),這也意味著我無(wú)法對(duì)模型進(jìn)行壓力測(cè)試。

該測(cè)試是在兩臺(tái)NVIDIA Quadro GV100上執(zhí)行的,平均速度為6 FPS,僅夠進(jìn)行實(shí)時(shí)處理。由于眾多層的結(jié)果,計(jì)算量非常大。聲稱以高于15 FPS的速度運(yùn)行的模型通常是不準(zhǔn)確的,或者由可怕的GPU支持。

跌倒檢測(cè)可用于許多情況下以提供幫助。一個(gè)非詳盡的清單包括:

1. 喝醉的人

2. 老人

3. 孩子們?cè)诓賵?chǎng)上

4. 患有心臟病或中風(fēng)等疾病的人

5. 粗心的人跌倒

對(duì)于更嚴(yán)重的情況,對(duì)跌倒的迅速反應(yīng)可能意味著生與死之間的差異。

跌倒檢測(cè)的準(zhǔn)確性在很大程度上取決于姿勢(shì)估計(jì)的準(zhǔn)確性。典型的姿勢(shì)估計(jì)模型是在具有對(duì)象正面視圖的清晰圖像上訓(xùn)練的。但是,跌倒會(huì)導(dǎo)致對(duì)象被扭曲為怪異的姿勢(shì),并且大多數(shù)姿勢(shì)估計(jì)模型都無(wú)法在這種情況下準(zhǔn)確定義骨骼。此外,這些模型的魯棒性不足以克服遮擋或圖像噪聲。

為了達(dá)到人類水平的檢測(cè)精度,當(dāng)前的姿勢(shì)估計(jì)模型將需要在更多種姿勢(shì)上進(jìn)行訓(xùn)練,并包括具有遮擋的低分辨率圖像。

當(dāng)前的硬件限制也阻礙了姿勢(shì)估計(jì)模型在具有高幀頻的視頻上平穩(wěn)運(yùn)行的能力。這些模型將需要一段時(shí)間才能在具有基本GPU甚至僅具有CPU的任何筆記本電腦上輕松運(yùn)行。

除了姿勢(shì)估計(jì)之外,專門針對(duì)跌倒進(jìn)行訓(xùn)練的深度學(xué)習(xí)模型可能會(huì)表現(xiàn)得甚至更好。必須仔細(xì)訓(xùn)練模型,以將跌倒與其他類似跌倒的動(dòng)作區(qū)分開。當(dāng)然,這必須與廣泛的數(shù)據(jù)集相結(jié)合,以訓(xùn)練模型。當(dāng)然,這種模型的范圍是有限的,因?yàn)樗荒軜?biāo)識(shí)一個(gè)特定的動(dòng)作,而不能標(biāo)識(shí)各種動(dòng)作。

另一種可能的方法也將是基于知識(shí)的系統(tǒng),該系統(tǒng)正在開發(fā)一種模型,以使其能夠?qū)W習(xí)人類的行為。這可以通過(guò)基于規(guī)則的系統(tǒng)在其中基于某些規(guī)則進(jìn)行決策來(lái)實(shí)現(xiàn),也可以通過(guò)基于案例的系統(tǒng)在過(guò)去的案例中應(yīng)用相似性來(lái)實(shí)現(xiàn),而過(guò)去的案例表明該案例可以對(duì)新案例做出明智的判斷。

為了解決包括多個(gè)動(dòng)作在內(nèi)的一般動(dòng)作識(shí)別這一更困難的問(wèn)題,我們必須首先理解并掌握檢測(cè)單個(gè)動(dòng)作的復(fù)雜性。如果我們能夠開發(fā)出一個(gè)可以輕松識(shí)別跌倒的模型,那么我們將能夠提取某些模式,從而使該模型能夠輕松地檢測(cè)其他類型的動(dòng)作。

推薦一波我好朋友的公眾號(hào):

個(gè)人微信(如果沒(méi)有備注不拉群!) 請(qǐng)注明:地區(qū)+學(xué)校/企業(yè)+研究方向+昵稱

下載1:何愷明頂會(huì)分享

在「AI算法與圖像處理」公眾號(hào)后臺(tái)回復(fù):何愷明,即可下載。總共有6份PDF,涉及 ResNet、Mask RCNN等經(jīng)典工作的總結(jié)分析

下載2:終身受益的編程指南:Google編程風(fēng)格指南

在「AI算法與圖像處理」公眾號(hào)后臺(tái)回復(fù):c++,即可下載。歷經(jīng)十年考驗(yàn),最權(quán)威的編程規(guī)范!

下載3 CVPR2021

在「AI算法與圖像處理」公眾號(hào)后臺(tái)回復(fù):CVPR,即可下載1467篇CVPR 2020論文 和 CVPR 2021 最新論文

點(diǎn)亮  ,告訴大家你也在看

,告訴大家你也在看