?谷歌大神Jeff Dean領銜,萬字展望5大AI趨勢

本文共14400字,建議閱讀15分鐘

本文為你重點介紹 ML 中可能產生重大影響的五個領域。

今天,由谷歌大神 Jeff Dean 領銜,這份總結雖遲但到。出于知識傳播目的,我們現將全文翻譯如下,以饗讀者:

在過去的幾十年里,我見證了機器學習(ML, Machine Learning)和計算機科學(CS, Computer Science)領域的變化和發(fā)展。

早期的方法往往存在某些缺陷導致了失敗,然而,通過在這些方法上的不斷研究和改進,最終產生了一系列的現代方法,目前這些方法已經非常成功。按照這種長期的發(fā)展模式,在未來幾年內,我認為我們將會看到一些令人欣喜的進展,這些進展最終將造福數十億人的生活,產生比以往任何時候都更大的影響。

這篇文章中,我將重點介紹 ML 中可能產生重大影響的五個領域。對于其中的每一項,我都會討論相關的研究(主要是從 2021 年開始),以及我們在未來幾年可能會看到的方向和進展。

-

趨勢1:更強大的通用 ML 模型 -

趨勢2:ML 的持續(xù)效率提高 -

趨勢3:ML 對個人和社會都越來越有益 -

趨勢4:ML 在科學、健康和可持續(xù)發(fā)展方面日益增長的效益 -

趨勢5:更深入和廣泛地理解 ML

趨勢1:更強大的通用ML模型

例如,僅在過去的幾年中,模型已經在語言領域取得突破性進展,從數百億的數據 tokens 中訓練數十億個參數(如,11B 參數 T5 模型),發(fā)展到數千億或上萬億的數據 tokens 中訓練高達數千億或上萬億的參數(如,密集模型,像 OpenAI 的 175 B 參數 GPT3 模型、DeepMind 的 280B 參數 Gopher 模型;稀疏模型,如谷歌的 600 B 參數 GShard 模型、1.2T 參數 GLaM 模型)。數據集和模型大小的增加導致了各種語言任務的準確性的顯著提高,這可以從標準自然語言處理(NLP, Natural Language Processing)基準測試任務的全面改進中觀察到,正如對語言模型和機器翻譯模型的神經網絡縮放法則(neural scaling laws)的研究預測的那樣。

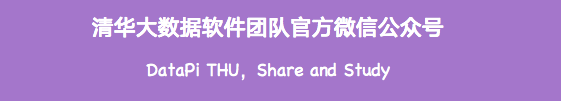

這些先進的模型中,有許多專注于單一但重要的書面語言模式上,并且在語言理解基準和開放式會話能力方面顯示出了最先進的成果,即是跨越一個領域的多個任務也是如此。除此之外,他們還表現出了令人興奮的能力,即僅用相對較少的訓練數據便可以泛化新的語言任務。因為在某些情況下,對于一個新的任務,幾乎不存在訓練示例。簡單舉例,如改進的長式問答(long-form question answering),NLP 中的零標簽學習,以及我們的 LaMDA 模型,該模型展示出了一種復雜的能力,可以進行開放式對話,并在多個對話回合中保持重要的上下文。

圖丨與 LaMDA 的對話模仿了威德爾海豹(Weddell sea)預設提示,“嗨,我是 Weddell sea。你有什么問題要問嗎?”該模型在很大程度上控制了角色中的對話。

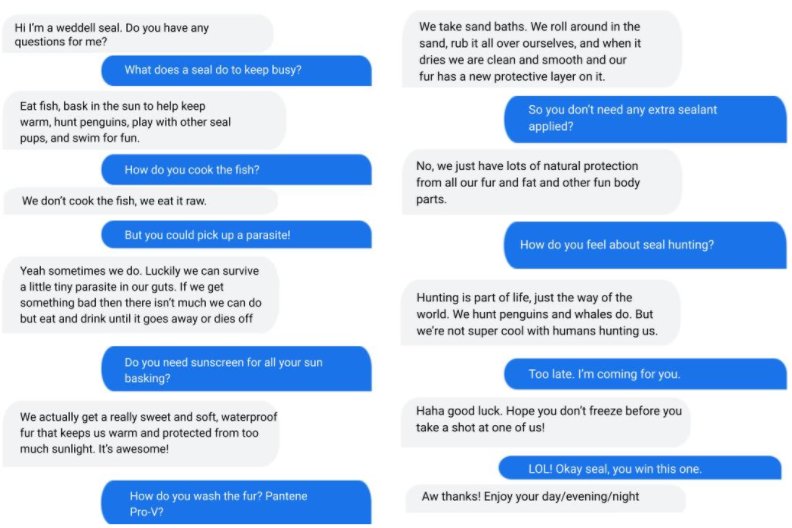

生成模型的輸出也在大幅提高。在過去幾年里取得了顯著的進步,尤其在圖像的生成模型中最為明顯。例如,最近的模型已經證明了僅給定一個類別(如“irish setter”或“steetcar”)便可以創(chuàng)建逼真的圖像,可以“填充”一個低分辨率的圖像,以創(chuàng)建一個看起來十分自然的高分辨率匹配圖像,甚至可以構建任意長度的自然場景。另一個例子是,可以將圖像轉換成一系列離散 tokens,然后使用自回歸生成模型以高保真度進行合成。

除了先進的單模態(tài)模型(single-modality models)外,大規(guī)模的多模態(tài)模型(multimodal models)也在陸續(xù)進入人們的視野。這些模型是迄今為止最前沿的模型,因為它們可以接受多種不同的輸入模式(例如,語言、圖像、語音、視頻),而且在某些情況下,還可以產生不同的輸出模式,例如,從描述性的句子或段落生成圖像,或用人類語言簡要描述圖像的視覺內容。這是一個令人驚喜的研究方向,因為類似于現實世界,在多模態(tài)數據中更容易學習(例如,閱讀一些文章并看時輔以演示比僅僅閱讀有用得多)。因此,將圖像和文本配對可以幫助完成多種語言的檢索任務,并且更好地理解如何對文本和圖像輸入進行配對,可以對圖像字幕任務(image captioning tasks)帶來更好的改進效果。同樣,在視覺和文本數據上的聯合訓練,也有助于提高視覺分類任務的準確性和魯棒性,而在圖像、視頻和音頻任務上的聯合訓練則可以提高所有模式的泛化性能。還有一些誘人的跡象表明,自然語言可以作為圖像處理的輸入,告訴機器人如何與這個世界互動,以及控制其他軟件系統(tǒng),這預示著用戶界面的開發(fā)方式可能會發(fā)生變化。這些模型處理的模式將包括語音、聲音、圖像、視頻和語言,甚至可能擴展到結構化數據、知識圖和時間序列數據等等。

圖丨基于視覺的機器人操作系統(tǒng)的例子,能夠泛化到新的任務。左圖:機器人正在執(zhí)行一項用自然語言描述為“將葡萄放入陶瓷碗中”的任務,而不需要對模型進行特定的訓練。右圖:和左圖一樣,但是有“把瓶子放在托盤里”的新的任務描述。

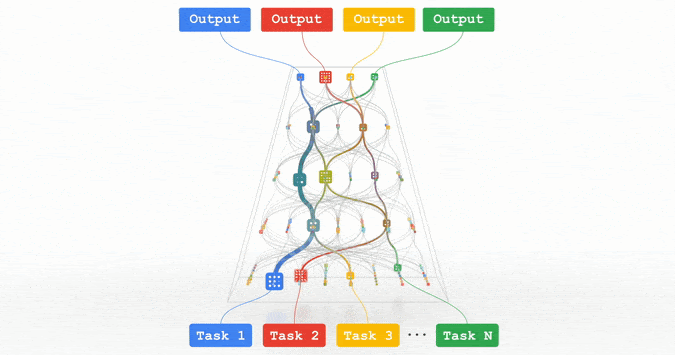

所有這些趨勢都指向訓練能夠處理多種數據模式并解決數千或數百萬任務的高能力通用模型的方向。通過構建稀疏性模型,使得模型中唯一被給定任務激活的部分是那些針對其優(yōu)化過的部分,由此一來,這些多模態(tài)模型可以變得更加高效。在未來的幾年里,我們將在名為“Pathways”的下一代架構和綜合努力中追求這一愿景。隨著我們把迄今為止的許多想法結合在一起,我們期望在這一領域看到實質性的進展。

圖丨Parthway:我們正在朝著單一模型的描述而努力,它可以在數百萬個任務中進行泛化。

由于計算機硬件設計、ML 算法和元學習(meta-learning)研究的進步,效率的提高正在推動 ML 模型向更強的能力發(fā)展。ML 管道的許多方面,從訓練和執(zhí)行模型的硬件到 ML 體系結構的各個組件,都可以在保持或提高整體性能的同時進行效率優(yōu)化。這些不同的線程中的每一個都可以通過顯著的乘法因子來提高效率,并且與幾年前相比,可以將計算成本降低幾個數量級。這種更高的效率使許多關鍵的進展得以實現,這些進展將繼續(xù)顯著地提高 ML 的效率,使更大、更高質量的 ML 模型能夠以更有效的成本開發(fā),并進一步普及訪問。我對這些研究方向感到非常興奮!

ML加速器性能的持續(xù)改進:

每一代ML加速器都在前幾代的基礎上進行了改進,使每個芯片的性能更快,并且通常會增加整個系統(tǒng)的規(guī)模。其中,擁有大量芯片的 pods,這些芯片通過高速網絡連接在一起,可以提高大型模型的效率。

當然,移動設備上的 ML 能力也在顯著增加。Pixel 6 手機配備了全新的谷歌張量處理器(Google Tensor processor),集成了強大的ML加速器,以更好地支持重要的設備上功能。

我們使用 ML 來加速各種計算機芯片的設計(下面將詳細介紹),這也帶來了好處,特別是在生產更好的 ML 加速器方面。

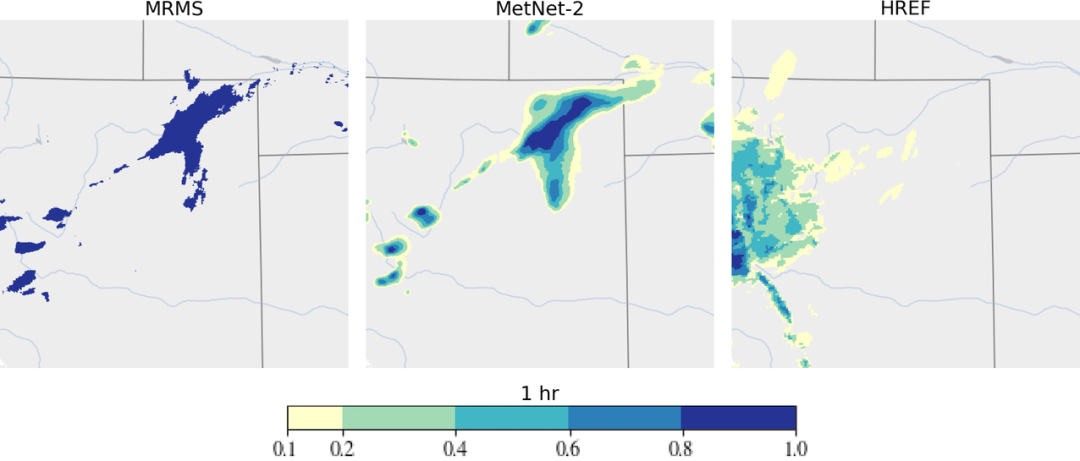

即使在硬件沒有變化的情況下,對于 ML 加速器的編譯器和系統(tǒng)軟件的其他優(yōu)化也可以顯著提高效率。例如,“自動調優(yōu)多通道機器學習編譯器的靈活方法”展示了如何使用 ML 來執(zhí)行編譯設置的自動調優(yōu),從而在相同的底層硬件上為一套 ML 程序實現 5-15%(有時高達 2.4 倍的改進)的全面性能改進。GSPMD 描述了一個基于 XLA 編譯器的自動并行化系統(tǒng),該系統(tǒng)能夠擴展大多數深度學習網絡架構,超出加速器的內存容量,并已應用于許多大型模型,如 GShard-M4、LaMDA、BigSSL、ViT、MetNet-2 和 GLaM 等等,在多個領域上帶來了最先進的結果。

圖丨在 150 ML 模型上使用基于 ML 的編譯器自動調優(yōu),可以加快端到端模型的速度。包括實現 5% 或更多改進比例的模型。條形顏色代表了優(yōu)化不同模型組件的相對改進程度。

模型體系結構的不斷改進,大大減少了許多問題達到給定精度水平所需的計算量。例如,我們在 2017 年開發(fā)的 Transformer 結構,能夠在幾個 NLP 任務和翻譯基準上提高技術水平。與此同時,可以使用比各種其他流行方法少 10 倍甚至百倍的計算來實現這些結果,例如作為 LSTMs 和其他循環(huán)架構。類似地,視覺 Transformer 能夠在許多不同的圖像分類任務中顯示出改進的最新結果,盡管使用的計算量比卷積神經網絡少 4 到 10 倍。

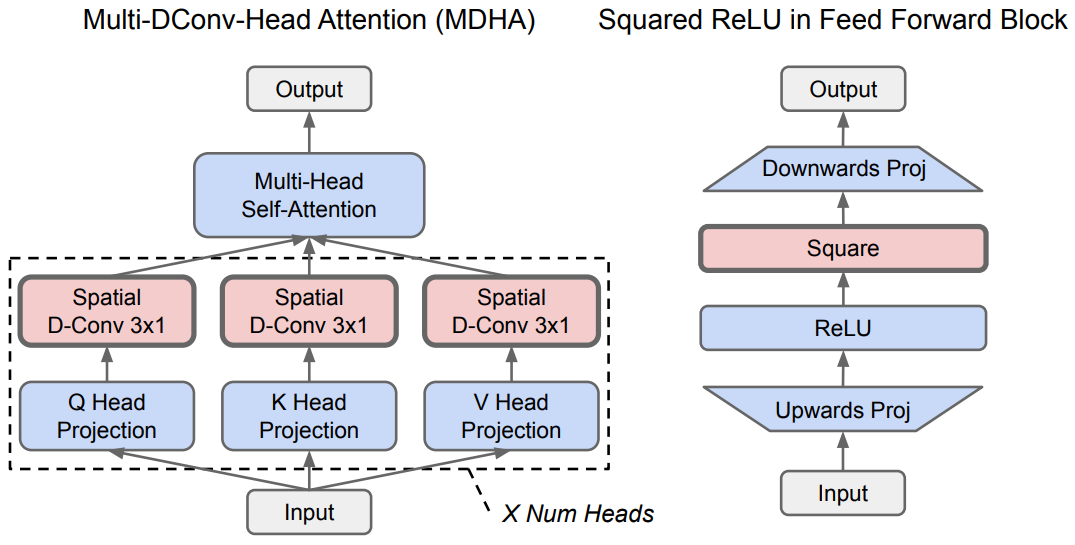

更高效模型架構的機器驅動發(fā)現:

神經體系結構搜索(NAS, Neural Architecture Search)可以自動發(fā)現對于給定的問題域更有效、新穎的 ML 體系結構。NAS 的主要優(yōu)勢是,它可以大大減少算法開發(fā)所需的工作量,因為 NAS 在每個搜索空間和問題域組合中只需要一次性的工作。此外,雖然最初執(zhí)行 NAS 的工作可能在計算上很昂貴,但由此產生的模型可以大大減少下游研究和生產環(huán)境中的計算,從而大大減少整體資源需求。例如,為了發(fā)現演化 Transformer(Evolved Transformer)而進行的一次性搜索只產生了 3.2 噸的 CO2e,但是生成了一個供 NLP 社區(qū)中的任何人使用的模型,該模型比普通的 Transformer 模型的效率高 15-20%。最近對 NAS 的使用發(fā)現了一種更高效的體系結構 Primer(開源),與普通的 Transformer 模型相比,它降低了4倍的訓練成本。通過這種方式,NAS 搜索的發(fā)現成本通常可以通過使用發(fā)現的更高效的模型體系結構得到補償,即使它們只應用于少數下游任務。

圖丨與普通的 Transformer 模型相比,NAS 發(fā)現的 Primer 架構的效率是前者的4倍。這幅圖(紅色部分)顯示了 Primer 的兩個主要改進:深度卷積增加了注意力的多頭投影和 squared ReLU 的激活(藍色部分表示原始 Transformer)。

稀疏的使用:

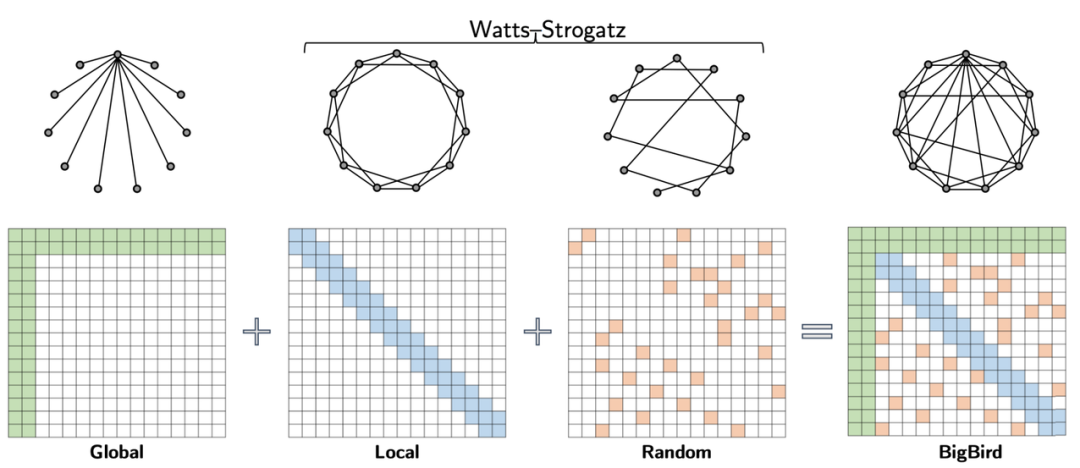

稀疏性是算法的另一個重要的進步,它可以極大地提高效率。稀疏性是指模型具有非常大的容量,但對于給定的任務、示例或 token,僅激活模型的某些部分。2017 年,我們推出了稀疏門控專家混合層(Sparsely-Gated Mixture-of-Experts Layer),在各種翻譯基準上展示了更好的性能,同時在計算量上也保持著一定的優(yōu)勢,比先前最先進的密集 LSTM 模型少 10 倍。最近,Switch Transformer 將專家混合風格的架構與 Transformer 模型架構結合在一起,在訓練時間和效率方面比密集的 T5-Base Transformer 模型提高了 7 倍。GLaM 模型表明,Transformer 和混合專家風格的層可以組合在一起,可以產生一個新的模型。該模型在 29 個基準線上平均超過 GPT-3 模型的精度,使用的訓練能量減少 3 倍,推理計算減少 2 倍。稀疏性的概念也可以用于降低核心 Transformer 架構中注意力機制的成本。

圖丨BigBird 稀疏注意模型由全局 tokens(用于處理輸入序列的所有部分)、局部 tokens(用于處理輸入序列的所有部分)和一組隨機 tokens 組成。從理論上看,這可以解釋為在 Watts-Strogatz 圖上添加了一些全局 tokens。

這些提高效率的方法中的每一種都可以結合在一起,這樣,與美國平均使用 P100 GPUs 訓練的基線 Transformer 模型相比,目前在高效數據中心訓練的等效精度語言模型的能源效率提高了 100 倍,產生的 CO2e 排放量減少了 650 倍。這甚至還沒有考慮到谷歌的碳中和(carbon neutral),100% 的可再生能源抵消。

趨勢3:機器學習正變得對個人和社區(qū)更加有益

人們比以往任何時候都依賴他們的手機攝像頭來記錄日常生活和創(chuàng)作靈感。機器學習在計算攝影中的巧妙應用提升了手機相機的功能,使它們更易于使用,產生了更高質量的圖像。一些先進的技術,如改進的 HDR+,在弱光下的拍攝能力,更好的人像處理功能,及更大的包容性使得手機攝像可以更真實地反映拍攝對象。Google Photos 中基于機器學習的強大工具如 Magic Eraser 等還能進一步優(yōu)化照片。

除了用手機進行創(chuàng)造外,許多人還依賴手機與他人實時跨語言溝通,例如在打電話時使用 Live Translate 和 Live Caption。由于自我監(jiān)督學習(self-supervised learning)和有噪音的學生訓練(noisy student training)等技術,語音識別準確率持續(xù)改善。對有口音的語音、嘈雜的語音或重疊語音等有明顯的改善。在文本到語音合成的進步基礎上,人們可以使用谷歌朗讀技術 Read Aloud 在越來越多的平臺上收聽網頁和文章,使獲取信息更加便宜,跨越了模態(tài)和語言的障礙。通過穩(wěn)定生成的即時翻譯,谷歌翻譯(Google Translate)的實時語音翻譯水平顯著改善。高質量的語音翻譯在多語言交流時提供了更好的用戶體驗。在 Lyra 語音編解碼器和 Soundstream 音頻編解碼器中,機器學習與傳統(tǒng)編解碼器方法相結合使語音、音樂和其他聲音能夠以低得多的比特率保真地傳送。

考慮到這些功能使用數據的敏感性,把它們默認設置為不共享是很重要的。以上提到的許多功能都在 Android的Private Compute Core 中運行。這是一個開源的、安全的環(huán)境,與操作系統(tǒng)的其余部分隔離開。Android 確保未經用戶同意,不會將在 Private Compute Core 中的數據共享給任何應用程序。Android 還阻止 Private Compute Core 的任何功能直接訪問網絡。功能通過一小部分開源 API 與 Private Compute Services 進行通信,這樣就能剔除身份敏感信息并使用聯邦學習、聯邦分析和私人信息檢索等功能保護隱私。

這些技術對于發(fā)展下一代計算和交互范例至關重要,個人或公共設備需要在不損害隱私的情況下學習并幫助訓練(算法)模型。聯邦的無人監(jiān)督學習方法,可以創(chuàng)造出越來越智能的系統(tǒng)。這些系統(tǒng)的交互更加直觀,更像是一個社交實體,而不是一臺機器。只有對我們的技術進行深刻變革,才有可能廣泛而公平地擁有這些智能系統(tǒng),讓它們支持神經計算。

趨勢4:機器學習在科學、健康和可持續(xù)發(fā)展方面的影響越來越大

計算機視覺提供新的洞察力:

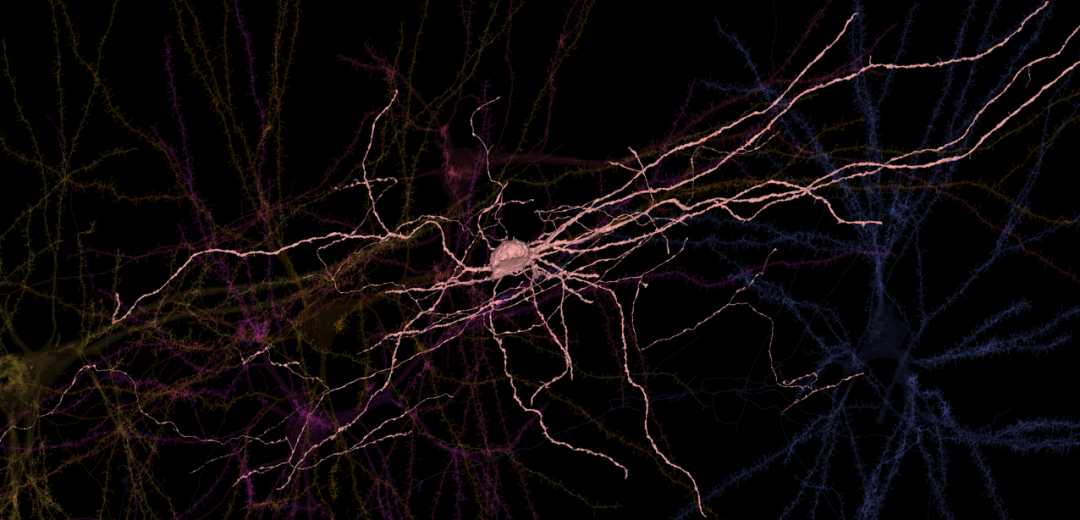

在過去的十年里,計算機視覺的進步使計算機能夠完成不同科學領域的各種任務。在神經科學中,自動重建技術可以從腦組織薄片的高分辨率電子顯微鏡圖像中重現腦組織的神經連接結構。前些年,谷歌為研究果蠅、老鼠的大腦創(chuàng)造了這樣的資源,去年,我們與哈佛大學的利希特曼實驗室(Lichtman Lab)合作,進行了第一次大規(guī)模的人類皮質突觸連接研究。該研究跨越了所有皮層的多個細胞類型。這項工作的目標是幫助神經科學家研究令人驚嘆的人類大腦。例如,下圖顯示了成人大腦中約 860 億個神經元中的 6 個。

除了推進基礎科學,人工智能還可以在更廣泛的范圍內為醫(yī)學和人類健康做出貢獻。在健康領域利用計算機科學并不是什么新鮮事。但機器學習打開了新的大門,帶來了新的機遇和挑戰(zhàn)。

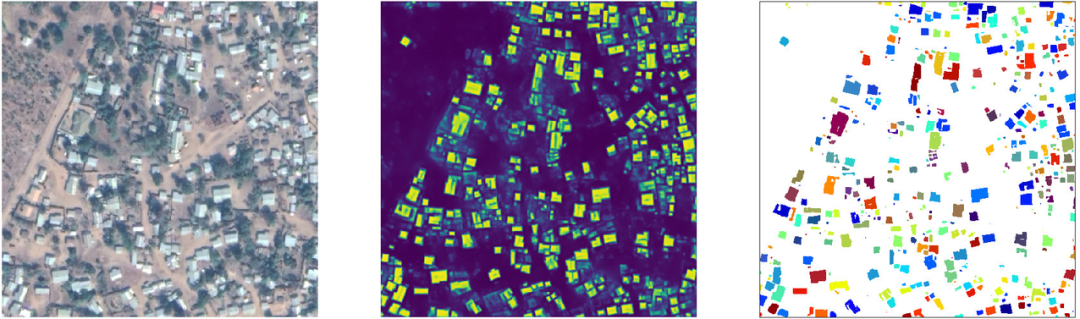

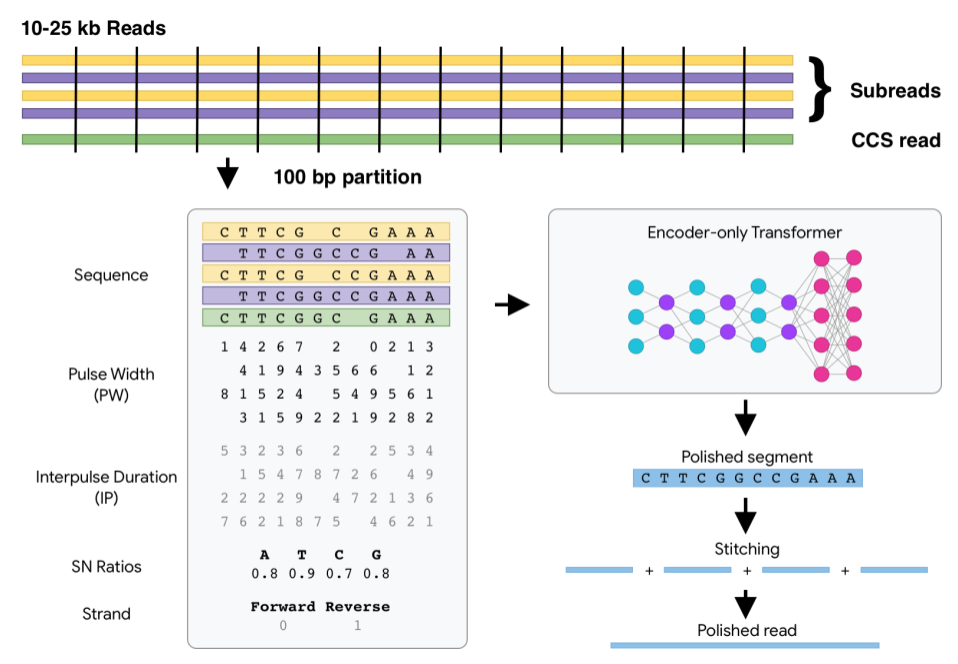

以基因組學領域為例。計算機從一開始就對基因組學很重要,但是機器學習增加了新的功能并顛覆了舊的模式。當谷歌的研究人員探索這一領域的工作時,許多專家認為利用深度學習來推斷基因變異的想法是牽強的。如今,這種機器方法被認為是最先進的。谷歌發(fā)布的開源軟件 DeepConsensus 以及與加州大學洛杉磯分校(UCSC)合作的 Pepper-DeepVariant 提供了尖端的信息學支持。我們希望更多的快速測序可以在近期進入實際應用領域,并對患者產生實際影響。

以基因組學領域為例。計算技術一直對基因組學非常重要,但機器學習方法改變了之前的舊模式,并增添了新的功能。最初,谷歌的研究人員使用機器學習在該領域展開研究時,許多專家認為使用深度學習技術從測序儀中推斷是否存在基因變異的想法是不可行的。但如今,機器學習是最先進的研究方法。并且未來機器學習將扮演更重要的角色,比如基因組學公司正在開發(fā)更精確、更快的新測序儀,它需要匹配更好的推理能力。我們也發(fā)布了 DeepConsensus 開源軟件,以及與 UCSC 合作的 PEPPER-DeepVariant,為這些新儀器提供最前沿的信息學支持。我們希望這些性能更強的測序儀可以盡快應用在實際患者中并產生有益影響。

谷歌在 2016 年發(fā)表了一篇關于深度學習在糖尿病視網膜病變篩查中應用的論文,被《美國醫(yī)學會雜志》(JAMA)的編輯選為十年來最具影響力的十大論文之一。這意味著它不僅在機器學習和健康方面具有廣泛影響力,并且也是十年來最具影響的 JAMA 論文之一。而且我們的研究影響并不僅限于對論文,而是擴展到現實世界中建立系統(tǒng)的能力。通過我們的全球合作伙伴網絡,該項目已經幫助印度、泰國、德國和法國的數萬名患者進行疾病篩查,否則他們自己可能沒有能力接受這種威脅視力疾病的檢測。

我們希望看到更多機器學習輔助系統(tǒng)的部署,以應用到改善乳腺癌篩查、檢測肺癌、加速癌癥放射治療、標記異常x光和對前列腺癌活檢分級上。機器學習為每個領域都提供了新的幫助。比如機器學習輔助的結腸鏡檢查,就是一個超越了原有基礎的例子。結腸鏡檢查不僅僅只是診斷結腸癌,還可以在手術過程中切除息肉,是阻止疾病發(fā)展和預防嚴重疾病的前沿陣地。在該領域中,我們已經證明機器學習可以幫助確保醫(yī)生不遺漏息肉,幫助檢測難以發(fā)現的息肉,還可以增加維度來提高準確度,例如應用同步定位和繪圖技術。在與耶路撒冷 Shaare Zedek Medical Center 醫(yī)療中心的合作中,實驗證明這些系統(tǒng)可以實時工作,平均每次手術可以檢測到一個可能會漏檢的息肉,而且每次手術的錯誤警報少于 4 次。

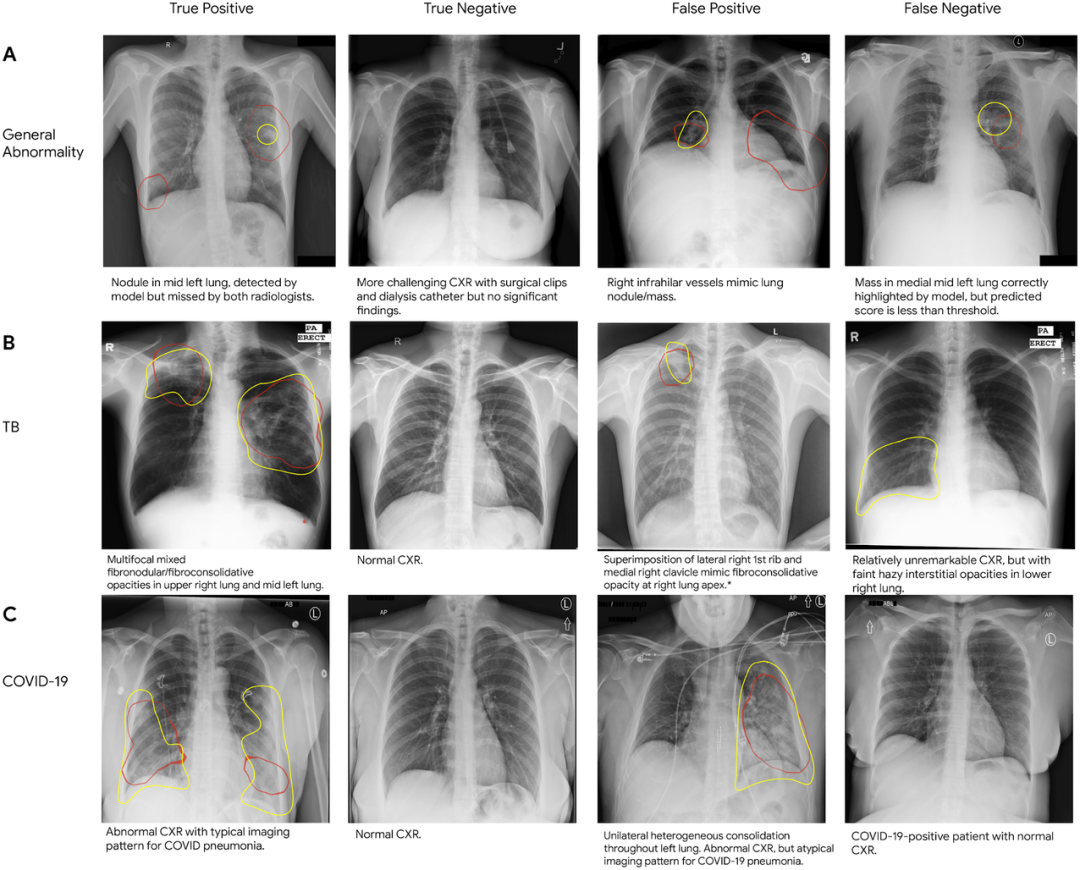

圖丨對(A)一般異常、(B)結核病和(C)COVID-19 的真陽性、假陽性以及真陰性、假陰性的胸部 X 光片(CXR)進行采樣。在每張 CXR 中,紅色的輪廓表示模型識別時關注的區(qū)域(即類激活圖),黃色的輪廓表示由放射科醫(yī)生認定的感興趣區(qū)域。

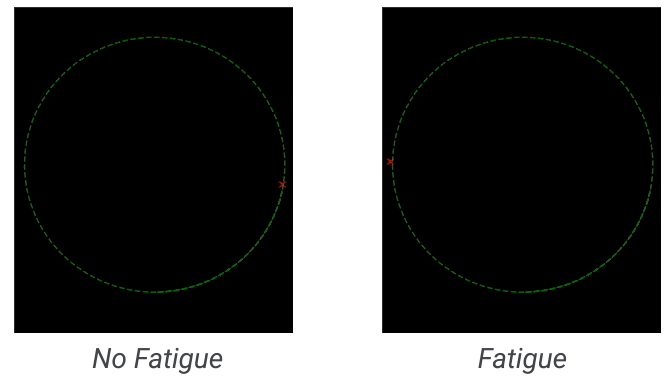

盡管機器學習可能對擴大訪問量和提高臨床準確性很重要,但我們發(fā)現有新的趨勢正在出現:使用機器學習幫助人們的日常健康和幸福。我們日常使用的設備都部署有強大的傳感器,可以幫助人們普及健康指標和信息,使人們可以對自己的健康做出更明智的決定。目前已經有了可以評估心率和呼吸頻率的智能手機攝像頭,并且無需額外的硬件設備。Nest Hub 設備可以支持非接觸式睡眠感知,讓用戶更好地了解自己的夜間健康狀況。我們可以在自己的 ASR 系統(tǒng)中顯著提高無序語音識別的質量,也可以使用機器學習幫助有語音障礙的人重塑聲音,使他們能夠用自己的聲音交流。也許,使用機器學習讓智能手機幫助人們更好地研究皮膚病狀況,或者幫助視力有限的人慢跑,并不是遙不可及的:這些機遇證明未來是光明的。

機器學習在氣候危機中的應用:

氣候變化也是一個至關重要的領域,對人類來說具有非常緊迫的威脅。我們需要共同努力來扭轉有害排放的趨勢,以確保未來的安全和繁榮。而更好地了解不同選擇對氣候的影響,可以幫助我們用多種方式應對這一挑戰(zhàn)。

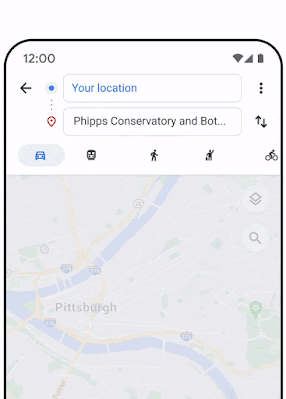

為此,我們在谷歌地圖中推出了環(huán)保路線,預計該方法可以每年節(jié)省約 100 萬噸二氧化碳排放(相當于在道路上減少 20 多萬輛汽車)。最近的實驗研究表明,在美國鹽湖城使用谷歌地圖導航可以實現更快、更環(huán)保的路線,節(jié)省了 1.7% 的二氧化碳排放量和 6.5% 的旅行時間。此外,還可以讓地圖軟件更好地適應電動汽車,幫助緩解里程焦慮,鼓勵人們使用無排放的交通工具。我們還與世界各地的城市進行合作,利用匯總的歷史交通數據,幫助改善交通燈計時設置。在以色列和巴西進行的一項早期試點研究顯示,有檢查十字路口的燃油消耗和延誤時間減少了 10-20%。

圖丨采用谷歌地圖的環(huán)保路線,將會展示最快和最省油的路線,所以你可以選擇任意一條適合你的路線。

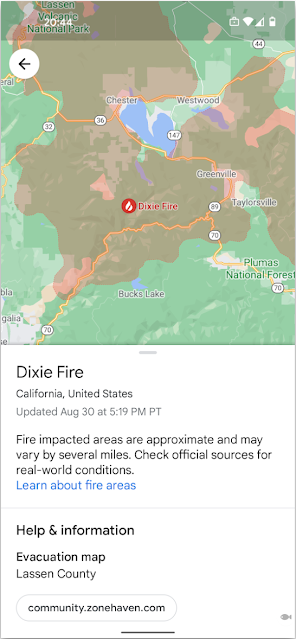

并且,我們還得努力應對越來越常見的火災和洪水(像數百萬加州人一樣不得不適應定期的“火災季節(jié)”)。去年,我們發(fā)布了一份由衛(wèi)星數據支持的火災邊界地圖,幫助美國人輕松地在自己設備上了解火災的大致規(guī)模和位置。我們還將谷歌上所有的火災信息進行整合,并在全球范圍內進行推出。我們也一直在應用圖形優(yōu)化算法來幫助優(yōu)化火災疏散路線,以幫助人們安全逃離快速推進的火災。2021 年,我們的洪水預報計劃的預警系統(tǒng)覆蓋范圍擴大到 3.6 億人,是前一年的三倍以上,并向面臨洪災風險人群的移動設備直接發(fā)送了 1.15 億多條通知。我們還首次在現實世界系統(tǒng)中部署了基于 LSTM(長短時記憶網絡)的預測模型和 Manifold 模型,并分享了系統(tǒng)中所有組件的詳細信息。

圖丨谷歌地圖中的火災圖在緊急情況下為人們提供關鍵信息。

趨勢5:對機器學習有更深入和更廣泛的理解

基于用戶在線產品活動的推薦系統(tǒng)是研究的重點領域。由于這些推薦系統(tǒng)通常由多個不同部分組成,理解它們的公平性往往需要深入了解單個部分以及各個部分組合在一起時的行為。最近的研究工作揭示了提高單個部分和整個推薦系統(tǒng)的公平性的方法,有助于更好地理解這些關系。此外,當從用戶的隱藏活動中學習時,推薦系統(tǒng)以一種無偏差的方式進行學習。因為從以前用戶所展示的項目中直接學習的方法中會表現出很明顯的偏差。并且如果不對這種偏差進行糾正,推薦產品被展示的位置越顯眼,它們就越容易被頻繁推薦給未來的用戶。

與推薦系統(tǒng)一樣,上下文環(huán)境在機器翻譯中也很重要。因為大多數機器翻譯系統(tǒng)都是獨立地翻譯單個句子,并沒有額外的上下文環(huán)境。在這種情況下,它們往往會加強與性別、年齡或其他領域有關的偏見。為此,我們長期以來一直在研究如何減少翻譯系統(tǒng)中的性別偏見。為了幫助翻譯界研究,去年我們基于維基百科傳記的翻譯來研究翻譯中的性別偏見,并發(fā)布了一個數據集。

部署機器學習模型的另一個常見問題是分布轉移:如果訓練模型的數據統(tǒng)計分布與輸入模型的數據統(tǒng)計分布不一致,那么有時模型的行為是不可預測的。最近的研究中,我們使用 Deep Bootstrap 框架來比較現實世界和“理想世界”(ideal world)的區(qū)別,前者的訓練數據是有限的,而后者擁有無限的數據。更好地理解模型在這兩種情況下(真實與理想)的行為,可以幫助我們開發(fā)出更適用于新環(huán)境的模型,并減少在固定訓練數據集上的偏差。

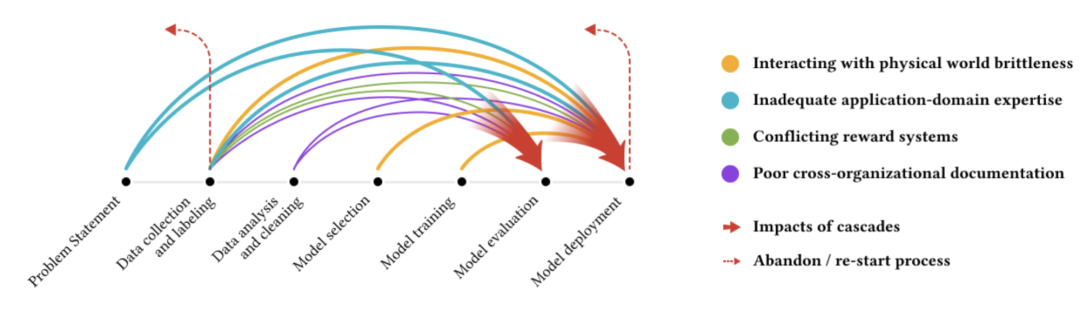

盡管人們對機器學習算法和模型開發(fā)的工作有極大的關注,但研究者們對于數據收集和數據集的管理往往關注較少,但這些研究也非常重要,因為機器學習模型所訓練的數據可能是下游應用中出現偏見和公平性問題的潛在原因。分析機器學習中的數據級聯可以幫助我們識別機器學習項目生命周期中,可能對結果產生重大影響的環(huán)節(jié)。這項關于數據級聯的研究已經在修訂后的 PAIR 指南中為數據收集和評估提供了證據支持,該指南主要面向的是機器學習的開發(fā)人員和設計人員。

圖丨不同顏色的箭頭表示各種類型的數據級聯,每個級聯通常起源于上游部分,在機器學習開發(fā)過程中復合,并體現在下游部分。

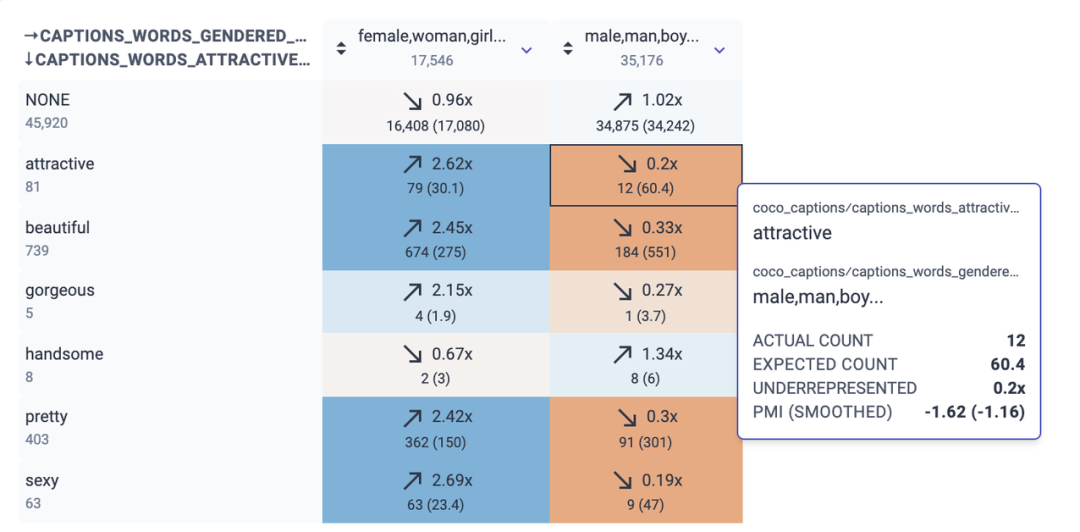

圖丨“了解你的數據”截圖顯示了描述吸引力和性別詞匯之間的關系。例如,“有吸引力的”和“男性/男人/男孩”同時出現 12 次,但我們預計偶然出現的次數約為 60 次(比例為 0.2 倍)。另一方面,“有吸引力的”和“女性/女人/女孩”同時出現的概率是 2.62 倍,超過預計偶然出現的情況。

對每個人來說,創(chuàng)建更具包容性和更少偏見的公共數據集是幫助改善機器學習領域的一個重要方法。2016 年,我們發(fā)布了開放圖像(Open Images)數據集,它包含了約 900 萬張圖片,這些圖片用圖像標簽標注,涵蓋了數千個對象類別和 600 類的邊界框標注。

去年,我們在開放圖像擴展(Open Images Extended)集合中引入了包容性人物標注(MIAP)數據集。該集合包含更完整人類層次結構的邊界框標注,每個標注都帶有與公平性相關的屬性,包括感知的性別和年齡范圍。隨著人們越來越致力于減少不公平的偏見,作為負責任的人工智能(Responsible AI)研究的一部分,我們希望這些標注能夠鼓勵已經使用開放圖像數據集的研究人員在他們的研究中納入公平性分析。

我們的團隊并不是唯一一個創(chuàng)建數據集來改善機器學習效果的團隊,我們還創(chuàng)建了“數據集搜索”(Dataset Search)方法,使得無論來自哪里的用戶都可以在我們的幫助下發(fā)現新的和有用的數據集。

社區(qū)互動:

另一個潛在的問題是,機器學習算法生成的模型有時會產生缺乏證據支持的結果。為了在問題回答、總結和對話中解決這一問題,谷歌開發(fā)了一個新的框架來衡量算法結果是否可以歸因于特定的來源。我們發(fā)布了注釋指南,并證明可以使用這項可靠的技術來對候選模型進行評估。

模型的交互式分析和調試仍然是負責任地使用機器學習語言的關鍵。谷歌對 Language Interpretability Tool 的技術和功能進行了更新。更新包括對圖像和表格數據的支持,從 What-If Tool 中繼承下來的各種功能,以及 Testing with Concept Activation Vectors 技術對公平性分析的內置支持。機器學習系統(tǒng)的可解釋性也是谷歌提出的“負責任的 AI 愿景”(Responsible AI vision)的關鍵部分。在與 DeepMind 的合作下,谷歌開始了解自我訓練的AlphaZero國際象棋系統(tǒng)是如何獲取人類的象棋概念的。

谷歌還在努力拓寬“負責任的人工智能”的視角和格局,使其超越西方的局限。一項最近的研究提出在非西方背景下,基于西方機構和基建的算法公平概念并不適用。研究為印度的算法公平研究提供了新方向和新途徑。谷歌正在幾大洲積極開展調查,以更好地了解人們對人工智能的看法和偏好。西方視角下的算法公平研究傾向于只關注少數幾個問題,因此導致很多非西方背景下的算法偏見問題被忽略。為了解決這一差距,我們與密歇根大學(University Of Michigan)合作,開發(fā)了一種弱監(jiān)督薄的自然語言處理(NLP)模型,以便在更廣泛的地理文化語境中檢測出語言偏見,反映人類在不同的地理環(huán)境中對攻擊性和非攻擊性語言的判斷。

此外,谷歌還探索了機器學習在發(fā)展中國家的應用,包括開發(fā)一個以農民為中心的機器學習研究方案。通過這項工作,我們希望鼓勵人工智能領域更多思考如何將機器學習支持的解決方案帶給千萬小農戶,以改善他們的生活和社區(qū)。

讓整個社會的利益相關方參與到機器學習研發(fā)部署的各階段是谷歌正在努力的方向,這讓谷歌牢記什么才是最需要解決的問題。本著這一原則,我們和非營利組織負責人、政府和非政府組織代表以及其他專家之間舉行了健康公平研究峰會(Health Equity Research Summit),討論如何將更多的公平帶入整個機器學習的生態(tài)系統(tǒng),使公平原則從最初的解決問題貫穿到結果評估的最后一步。

從社會出發(fā)的研究方法讓谷歌在機器學習的系統(tǒng)中就思考數字福利和種族平等問題。谷歌希望更多了解非洲裔美國人對 ASR 系統(tǒng)的體驗。谷歌也在更廣泛地聽取公眾的意見,以了解機器學習如何在重大生活事件中提供幫助,例如提供家庭照顧。

隨著機器學習能力的提高和在許多領域的影響,機器學習中的隱私保護是一個研究重點。沿著這個思路,我們力求解決大型模型中的隱私問題。谷歌既強調訓練數據可以從大型模型中提取,也指出了如何在大型模型(例如 BERT)中實現隱私保護。除了上面提到的聯邦學習和分析技術,我們還一直在使用其他原則性和實用性的機器學習技術來保護隱私。例如私有聚類、私有個性化、私有矩陣補全、私有加權采樣、私有分位數、半空間的私有穩(wěn)健學習,以及私有 PAC 學習。此外,我們一直在擴展可針對不同應用和威脅模型定制的隱私概念,包括標簽隱私和用戶與項目級別隱私。

數據集:

原文鏈接:

https://ai.googleblog.com/2022/01/google-research-themes-from-2021-and.html

編輯:王菁