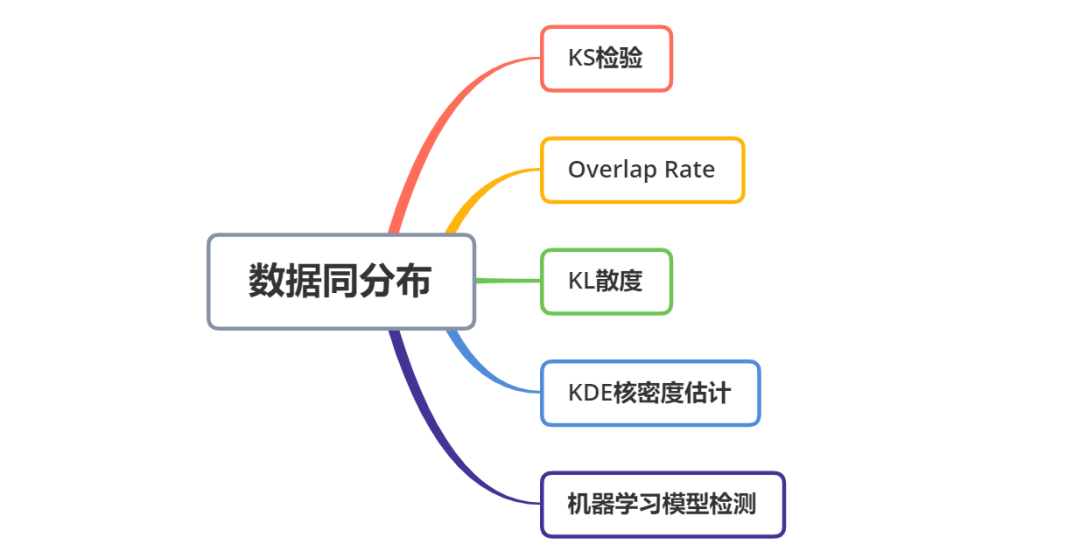

【機(jī)器學(xué)習(xí)基礎(chǔ)】5種數(shù)據(jù)同分布的檢測方法!

在數(shù)據(jù)挖掘比賽中,很重要的一個(gè)技巧就是要確定訓(xùn)練集與測試集特征是否同分布,這也是機(jī)器學(xué)習(xí)的一個(gè)很重要的假設(shè)。但很多時(shí)候我們知道這個(gè)道理,卻很難有方法來保證數(shù)據(jù)同分布,這篇文章就分享一下我所了解的同分布檢驗(yàn)方法。

一、KS檢驗(yàn)

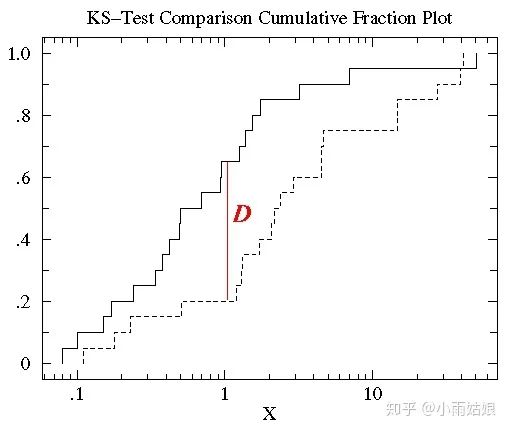

KS是一種非參數(shù)檢驗(yàn)方法,可以在不知道數(shù)據(jù)具體分布的情況下檢驗(yàn)兩個(gè)數(shù)據(jù)分布是否一致。當(dāng)然這樣方便的代價(jià)就是當(dāng)檢驗(yàn)的數(shù)據(jù)分布符合特定的分布事,KS檢驗(yàn)的靈敏度沒有相應(yīng)的檢驗(yàn)來的高。在樣本量比較小的時(shí)候,KS檢驗(yàn)作為非參數(shù)檢驗(yàn)在分析兩組數(shù)據(jù)之間是否不同時(shí)相當(dāng)常用。

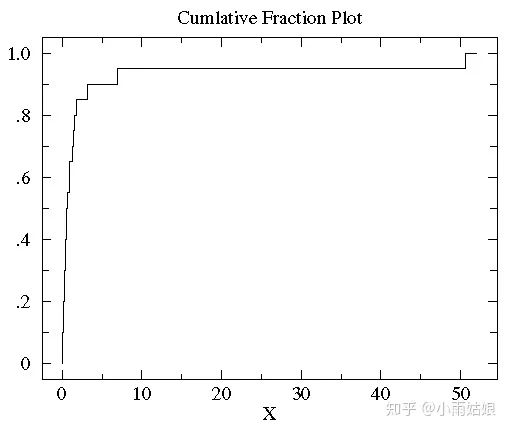

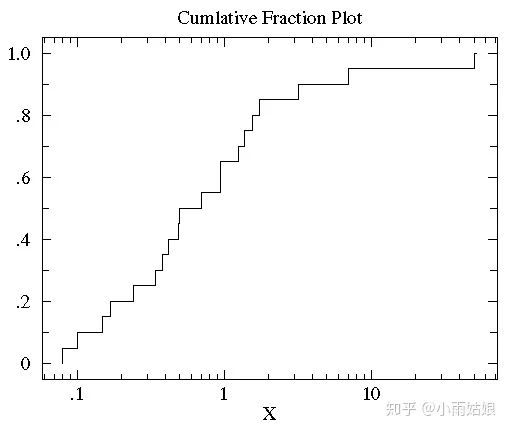

1. 畫出數(shù)據(jù)的累積分段圖

2. 對于累積分布圖取Log變換

3. 通過兩個(gè)數(shù)據(jù)的累積分布圖直接最大垂直距離描述兩數(shù)據(jù)的差異

實(shí)際操作中并不建議自己手寫,可以直接調(diào)用Python scipy庫中封裝好的函數(shù):

from scipy.stats import ks_2samp

ks_2samp(train[col],test[col]).pvalue

二、Overlap Rate

對于連續(xù)型變量我們可以使用KS檢驗(yàn)來檢測數(shù)據(jù)分布是否一致,對于類別型變量我們可以對其進(jìn)行編碼然后檢測,或者選擇通過特征重合率來進(jìn)行檢測,在高基數(shù)變量中此方法經(jīng)常被用到。

通過特征重合率檢測的思想是檢測訓(xùn)練集特征在測試集中出現(xiàn)的比率,舉個(gè)例子:

訓(xùn)練集特征:[貓,狗,狗,貓,狗,狗,狗,貓]

測試集特征:[貓,貓,魚,豬,魚,魚,豬,豬]

即使該特征在訓(xùn)練集表現(xiàn)很好,但在測試集上的用處并不大,因?yàn)橹睾下蕛H有1/4,反而會導(dǎo)致過擬合或者模型忽略到其他更有用的特征。

三、KL散度

雖然特征重合率可以篩掉一些不好的特征,但是在下面這種情況下,覆蓋率雖然是100%,但是特征的作用并不大:

訓(xùn)練集特征:[貓,貓,魚,豬,魚,魚,豬,豬]

測試集特征:[貓,狗,狗,狗,狗,狗,狗,狗]

該特征在訓(xùn)練集可能有很大的作用,但在測試集無法有效的劃分樣本,因?yàn)樵跍y試集大多是一樣的取值。在這種情況下,我第一個(gè)想法是在用Overlap Rate篩選過后,再計(jì)算測試集的信息熵(在決策樹中我們提到過,信息熵更大代表著可以更好的對樣本進(jìn)行劃分)。今天發(fā)現(xiàn)有個(gè)更好的end-to-end的方法,那就是KL散度。

KL 散度是一種衡量兩個(gè)概率分布的匹配程度的指標(biāo),兩個(gè)分布差異越大,KL散度越大。注意如果要查看測試集特征是否與訓(xùn)練集相同,P代表訓(xùn)練集,Q代表測試集,這個(gè)公式對于P和Q并不是對稱的。

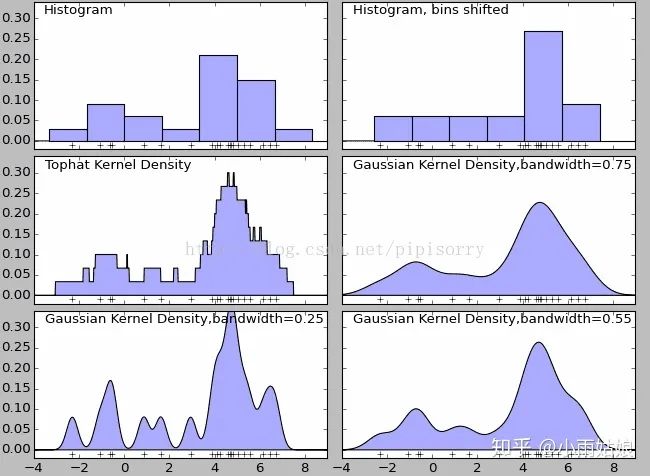

四、KDE 核密度估計(jì)

KDE核密度估計(jì),看起來好像是統(tǒng)計(jì)學(xué)里面一個(gè)高端的非參數(shù)估計(jì)方法。我簡單的理解下哈,大概就是通過一個(gè)核函數(shù)把一個(gè)頻率分布直方圖搞成平滑的了。具體核函數(shù)是啥,問就是不知道,我不是學(xué)統(tǒng)計(jì)的,自己看看叭。

我一般都是這么用的,從seaborn中找到KDE plot這個(gè)方法,然后把測試集和訓(xùn)練集的特征畫出來,看看圖像不像,不像的直接扔了就行/敷衍。

>>> import numpy as np; np.random.seed(10)

>>> import seaborn as sns; sns.set(color_codes=True)

>>> mean, cov = [0, 2], [(1, .5), (.5, 1)]

>>> x, y = np.random.multivariate_normal(mean, cov, size=50).T

>>> ax = sns.kdeplot(x)

五、機(jī)器學(xué)習(xí)模型檢測

然后就是這個(gè)月我從Kaggle了解的一個(gè)驚為天人的方法,聽完我就驚了,用機(jī)器學(xué)習(xí)模型檢測分布是否一致。

中心思想就是使用特征訓(xùn)練模型來分辨測試集與測試集,若模型效果好的話代表訓(xùn)練集和測試集存在較大差異,否則代表訓(xùn)練集和測試集分布比較相似。

具體做法是構(gòu)建一個(gè)二分類模型,對train-set打上0,測試集打上1,然后shuffle一下進(jìn)行訓(xùn)練,若分類效果好,代表訓(xùn)練集和測試集區(qū)分度很高,那么分布差異就較大。

我感覺它最大的價(jià)值是,針對不同的模型檢測分布會得到不同的效果,在實(shí)踐中由于選定了預(yù)測模型,它對于某個(gè)特定場景的適應(yīng)效果應(yīng)該比常規(guī)的檢測方法好很多。

由此延申出來,我們用訓(xùn)練好的二分類模型對訓(xùn)練集進(jìn)行預(yù)測,然后輸出預(yù)測概率,根據(jù)這個(gè)概率為訓(xùn)練集設(shè)置權(quán)重(概率越接近1代表訓(xùn)練集分布更接近測試集),這樣就可以強(qiáng)行過擬合到測試集上!對于非線上測試型的數(shù)據(jù)挖掘比賽應(yīng)該會有比較大的提升!

六、參考

為什么要同分布:https://zhuanlan.zhihu.com/p/52530189 KS檢驗(yàn):https://www.cnblogs.com/arkenstone/p/5496761.html Scipy KS檢驗(yàn):https://docs.scipy.org/doc/scipy-0.19.1/reference/generated/scipy.stats.ks_2samp.html 離散變量編碼:https://zhuanlan.zhihu.com/p/87203369 特征重合率: https://zhuanlan.zhihu.com/p/82435050 KDE:https://blog.csdn.net/pipisorry/article/details/53635895 KDE Drawer:http://seaborn.pydata.org/generated/seaborn.kdeplot.html Kaggle Adversarial validation: https://www.kaggle.com/kevinbonnes/adversarial-validation

往期精彩回顧

本站qq群704220115,加入微信群請掃碼: