多重共線性是如何影響回歸模型的

來(lái)源:DeepHub IMBA 作者:hqtquynhtram 本文約1000字,建議閱讀6分鐘? 特征如果存在多重共線性時(shí)為什么不能估計(jì)出最佳回歸系數(shù)?

在機(jī)器學(xué)習(xí)面試中經(jīng)常會(huì)被問到的一個(gè)問題是,特征如果存在多重共線性時(shí)為什么不能估計(jì)出最佳回歸系數(shù)?本篇文章可以算是這個(gè)問題的標(biāo)準(zhǔn)答案

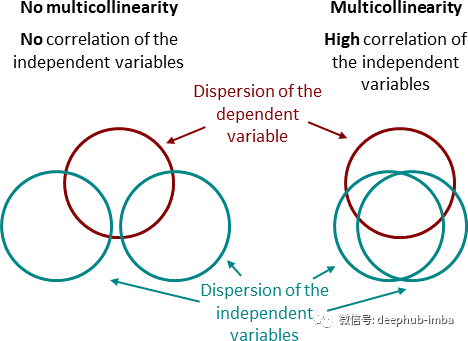

多重共線性是什么?

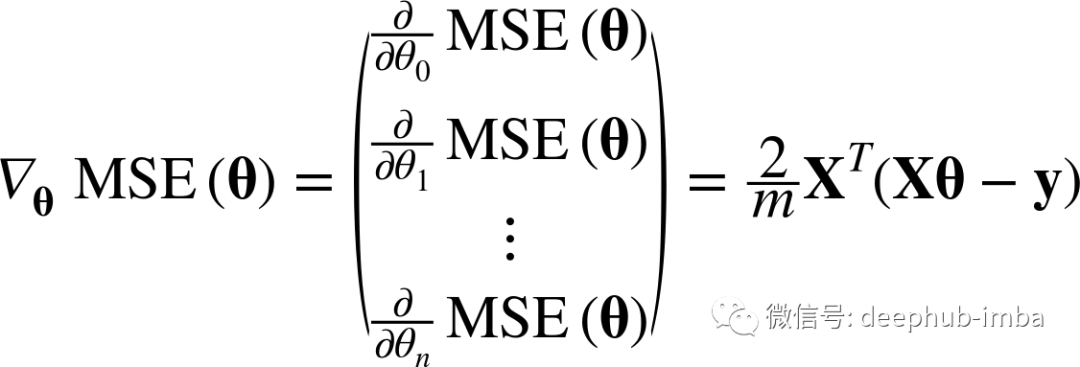

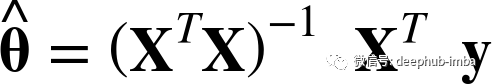

它對(duì)線性回歸模型有何影響?

theta_hat 是最小化損失函數(shù)的估計(jì)系數(shù) y 目標(biāo)值向量 X 是包含所有預(yù)測(cè)變量的設(shè)計(jì)矩陣(design matrix)

如何消除多重共線性?

保留一個(gè)變量并刪除與保留變量高度相關(guān)的其他變量 將相關(guān)變量線性組合在一起 使用對(duì)高度相關(guān)的特征進(jìn)行降維,例如PCA LASSO 或 Ridge 回歸是回歸分析的高級(jí)形式,可以處理多重共線性

評(píng)論

圖片

表情