19 種損失函數(shù)的 PyTorch 寫法!

“他山之石,可以攻玉”,站在巨人的肩膀才能看得更高,走得更遠(yuǎn)。在科研的道路上,更需借助東風(fēng)才能更快前行。為此,我們特別搜集整理了一些實(shí)用的代碼鏈接,數(shù)據(jù)集,軟件,編程技巧等,開辟“他山之石”專欄,助你乘風(fēng)破浪,一路奮勇向前,敬請(qǐng)關(guān)注。

01

criterion = LossCriterion() #構(gòu)造函數(shù)有自己的參數(shù)loss = criterion(x, y) #調(diào)用標(biāo)準(zhǔn)時(shí)也有參數(shù)

02

2-1 L1范數(shù)損失 L1Loss

計(jì)算 output 和 target 之差的絕對(duì)值。

torch.nn.L1Loss(reduction='mean')參數(shù):

reduction-三個(gè)值,none: 不使用約簡(jiǎn);mean:返回loss和的平均值;sum:返回loss的和。默認(rèn):mean。

2-2 均方誤差損失 MSELoss

計(jì)算 output 和 target 之差的均方差。

torch.nn.MSELoss(reduction='mean')參數(shù):

reduction-三個(gè)值,none: 不使用約簡(jiǎn);mean:返回loss和的平均值;sum:返回loss的和。默認(rèn):mean。

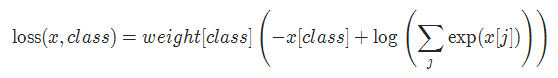

2-3 交叉熵?fù)p失 CrossEntropyLoss

當(dāng)訓(xùn)練有 C 個(gè)類別的分類問題時(shí)很有效. 可選參數(shù) weight 必須是一個(gè)1維 Tensor, 權(quán)重將被分配給各個(gè)類別. 對(duì)于不平衡的訓(xùn)練集非常有效。

在多分類任務(wù)中,經(jīng)常采用 softmax 激活函數(shù)+交叉熵?fù)p失函數(shù),因?yàn)榻徊骒孛枋隽藘蓚€(gè)概率分布的差異,然而神經(jīng)網(wǎng)絡(luò)輸出的是向量,并不是概率分布的形式。所以需要 softmax激活函數(shù)將一個(gè)向量進(jìn)行“歸一化”成概率分布的形式,再采用交叉熵?fù)p失函數(shù)計(jì)算 loss。

torch.nn.CrossEntropyLoss(weight=None, ignore_index=-100, reduction='mean')參數(shù):

weight (Tensor, optional) – 自定義的每個(gè)類別的權(quán)重. 必須是一個(gè)長(zhǎng)度為 C 的 Tensor

ignore_index (int, optional) – 設(shè)置一個(gè)目標(biāo)值, 該目標(biāo)值會(huì)被忽略, 從而不會(huì)影響到 輸入的梯度。

reduction-三個(gè)值,none: 不使用約簡(jiǎn);mean:返回loss和的平均值;sum:返回loss的和。默認(rèn):mean。

2-4 KL 散度損失 KLDivLoss

計(jì)算 input 和 target 之間的 KL 散度。KL 散度可用于衡量不同的連續(xù)分布之間的距離, 在連續(xù)的輸出分布的空間上(離散采樣)上進(jìn)行直接回歸時(shí)很有效.

torch.nn.KLDivLoss(reduction='mean')參數(shù):

reduction-三個(gè)值,none: 不使用約簡(jiǎn);mean:返回loss和的平均值;sum:返回loss的和。默認(rèn):mean。

2-5 二進(jìn)制交叉熵?fù)p失 BCELoss

二分類任務(wù)時(shí)的交叉熵計(jì)算函數(shù)。用于測(cè)量重構(gòu)的誤差, 例如自動(dòng)編碼機(jī). 注意目標(biāo)的值 t[i] 的范圍為0到1之間.

torch.nn.BCELoss(weight=None, reduction='mean')參數(shù):

weight (Tensor, optional) – 自定義的每個(gè) batch 元素的 loss 的權(quán)重. 必須是一個(gè)長(zhǎng)度為 “nbatch” 的 的 Tensor

pos_weight(Tensor, optional) – 自定義的每個(gè)正樣本的 loss 的權(quán)重. 必須是一個(gè)長(zhǎng)度 為 “classes” 的 Tensor

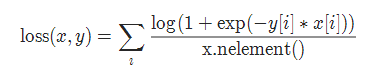

2-6 BCEWithLogitsLoss

BCEWithLogitsLoss損失函數(shù)把 Sigmoid 層集成到了 BCELoss 類中. 該版比用一個(gè)簡(jiǎn)單的 Sigmoid 層和 BCELoss 在數(shù)值上更穩(wěn)定, 因?yàn)榘堰@兩個(gè)操作合并為一個(gè)層之后, 可以利用 log-sum-exp 的 技巧來實(shí)現(xiàn)數(shù)值穩(wěn)定.

torch.nn.BCEWithLogitsLoss(weight=None, reduction='mean', pos_weight=None)參數(shù):

weight (Tensor, optional) – 自定義的每個(gè) batch 元素的 loss 的權(quán)重. 必須是一個(gè)長(zhǎng)度 為 “nbatch” 的 Tensor

pos_weight(Tensor, optional) – 自定義的每個(gè)正樣本的 loss 的權(quán)重. 必須是一個(gè)長(zhǎng)度 為 “classes” 的 Tensor

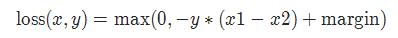

2-7 MarginRankingLoss

torch.nn.MarginRankingLoss(margin=0.0, reduction='mean')對(duì)于 mini-batch(小批量) 中每個(gè)實(shí)例的損失函數(shù)如下:

參數(shù):

margin:默認(rèn)值0

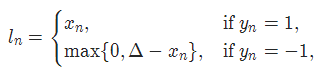

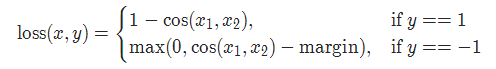

2-8 HingeEmbeddingLoss

torch.nn.HingeEmbeddingLoss(margin=1.0, reduction='mean')對(duì)于 mini-batch(小批量) 中每個(gè)實(shí)例的損失函數(shù)如下:

參數(shù):

margin:默認(rèn)值1

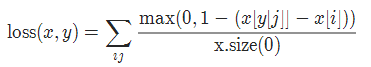

2-9 多標(biāo)簽分類損失 MultiLabelMarginLoss

torch.nn.MultiLabelMarginLoss(reduction='mean')對(duì)于mini-batch(小批量) 中的每個(gè)樣本按如下公式計(jì)算損失:

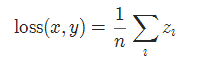

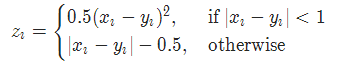

2-10 平滑版L1損失 SmoothL1Loss

也被稱為 Huber 損失函數(shù)。

torch.nn.SmoothL1Loss(reduction='mean')

其中

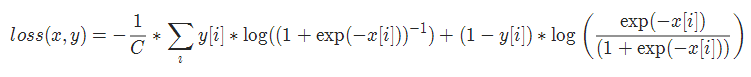

2-11 2分類的logistic損失 SoftMarginLoss

torch.nn.SoftMarginLoss(reduction='mean')

2-12 多標(biāo)簽 one-versus-all 損失 MultiLabelSoftMarginLoss

torch.nn.MultiLabelSoftMarginLoss(weight=None, reduction='mean')

2-13 cosine 損失 CosineEmbeddingLoss

torch.nn.CosineEmbeddingLoss(margin=0.0, reduction='mean')

參數(shù):

margin:默認(rèn)值0

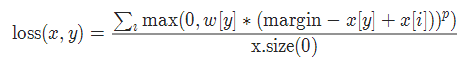

2-14 多類別分類的hinge損失 MultiMarginLoss

torch.nn.MultiMarginLoss(p=1, margin=1.0, weight=None, reduction='mean')

參數(shù):

p=1或者2 默認(rèn)值:1

margin:默認(rèn)值1

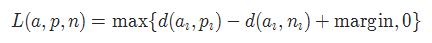

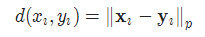

2-15 三元組損失 TripletMarginLoss

torch.nn.TripletMarginLoss(margin=1.0, p=2.0, eps=1e-06, swap=False, reduction='mean')

其中:

2-16 連接時(shí)序分類損失 CTCLoss

CTC連接時(shí)序分類損失,可以對(duì)沒有對(duì)齊的數(shù)據(jù)進(jìn)行自動(dòng)對(duì)齊,主要用在沒有事先對(duì)齊的序列化數(shù)據(jù)訓(xùn)練上。比如語音識(shí)別、ocr識(shí)別等等。

torch.nn.CTCLoss(blank=0, reduction='mean')參數(shù):

reduction-三個(gè)值,none: 不使用約簡(jiǎn);mean:返回loss和的平均值;sum:返回loss的和。默認(rèn):mean。

2-17 負(fù)對(duì)數(shù)似然損失 NLLLoss

負(fù)對(duì)數(shù)似然損失. 用于訓(xùn)練 C 個(gè)類別的分類問題.

torch.nn.NLLLoss(weight=None, ignore_index=-100, reduction='mean')參數(shù):

weight (Tensor, optional) – 自定義的每個(gè)類別的權(quán)重. 必須是一個(gè)長(zhǎng)度為 C 的 Tensor

ignore_index (int, optional) – 設(shè)置一個(gè)目標(biāo)值, 該目標(biāo)值會(huì)被忽略, 從而不會(huì)影響到 輸入的梯度.

2-18 NLLLoss2d

對(duì)于圖片輸入的負(fù)對(duì)數(shù)似然損失. 它計(jì)算每個(gè)像素的負(fù)對(duì)數(shù)似然損失.

torch.nn.NLLLoss2d(weight=None, ignore_index=-100, reduction='mean')參數(shù):

weight (Tensor, optional) – 自定義的每個(gè)類別的權(quán)重. 必須是一個(gè)長(zhǎng)度為 C 的 Tensor

reduction-三個(gè)值,none: 不使用約簡(jiǎn);mean:返回loss和的平均值;sum:返回loss的和。默認(rèn):mean。

2-19 PoissonNLLLoss

目標(biāo)值為泊松分布的負(fù)對(duì)數(shù)似然損失

torch.nn.PoissonNLLLoss(log_input=True, full=False, eps=1e-08, reduction='mean')參數(shù):

log_input (bool, optional) – 如果設(shè)置為 True , loss 將會(huì)按照公 式 exp(input) - target * input 來計(jì)算, 如果設(shè)置為 False , loss 將會(huì)按照 input - target * log(input+eps) 計(jì)算.

full (bool, optional) – 是否計(jì)算全部的 loss, i. e. 加上 Stirling 近似項(xiàng) target * log(target) - target + 0.5 * log(2 * pi * target).

eps (float, optional) – 默認(rèn)值: 1e-8

參考資料

http://www.voidcn.com/article/p-rtzqgqkz-bpg.html

本文目的在于學(xué)術(shù)交流,并不代表本公眾號(hào)贊同其觀點(diǎn)或?qū)ζ鋬?nèi)容真實(shí)性負(fù)責(zé),版權(quán)歸原作者所有,如有侵權(quán)請(qǐng)告知?jiǎng)h除。

往期精彩:

講解視頻來了!機(jī)器學(xué)習(xí) 公式推導(dǎo)與代碼實(shí)現(xiàn)開錄!

更新!《機(jī)器學(xué)習(xí):公式推導(dǎo)與代碼實(shí)現(xiàn)》1-16章PPT下載

《機(jī)器學(xué)習(xí) 公式推導(dǎo)與代碼實(shí)現(xiàn)》隨書PPT示例

時(shí)隔一年!深度學(xué)習(xí)語義分割理論與代碼實(shí)踐指南.pdf第二版來了!

新書首發(fā) | 《機(jī)器學(xué)習(xí) 公式推導(dǎo)與代碼實(shí)現(xiàn)》正式出版!

《機(jī)器學(xué)習(xí)公式推導(dǎo)與代碼實(shí)現(xiàn)》將會(huì)配套PPT和視頻講解!