Pytorch常見的坑匯總

來自 |?知乎? ?作者 |?郁振波

地址 |?https://zhuanlan.zhihu.com/p/7792356

本文僅作學(xué)術(shù)分享,如有侵權(quán),請聯(lián)系刪除最近剛開始用pytorch不久,陸陸續(xù)續(xù)踩了不少坑,記錄一下,個(gè)人感覺應(yīng)該都是一些很容易遇到的一些坑,也在此比較感謝幫我排坑的小伙伴,持續(xù)更新,也祝愿自己遇到的坑越來越少。首先作為tensorflow的骨灰級玩家+輕微強(qiáng)迫癥患者,一路打怪升級,從0.6版本用到1.2,再用到1.10,經(jīng)歷了tensorfow數(shù)個(gè)版本更迭,這里不得不說一下tf.data.dataset+tfrecord使用起來效率遠(yuǎn)比dataloader高的多。tensorflow有一個(gè)比較好用的隊(duì)列機(jī)制,tf.inputproducer + tfrecord, 但是inputproducer有一個(gè)bug,就是無法對每個(gè)epoch單獨(dú)shuffle,它只能整體shuffle,也就意味著我們無法進(jìn)行正常的訓(xùn)練流程(train幾個(gè)epoch,在validation上測一個(gè)epoch,最終選一個(gè)validation上的最好的結(jié)果,進(jìn)行test)。后來我當(dāng)時(shí)給官方提了一個(gè)issue,官方當(dāng)時(shí)的回答是,這個(gè)bug目前無法解決,但是他們在即將到來的tf1.2版本中, 推出的新型數(shù)據(jù)處理API tf.contrib.data.dataset(tf1.3版本將其合并到了tf.data.dataset)可以完美解決這個(gè)bug,并且將于tf2.0摒棄tf.input_producer。然后tf1.2版本剛出來以后,我就立馬升級并且開始tf.data.dataset踩坑,踩了大概2周多的坑,(這個(gè)新版的API其實(shí)功能并不是非常強(qiáng)大,有不少局限性,在此就不展開)。——————————————————————————好像扯遠(yuǎn)了,回歸pytorch,首先讓我比較尷尬的是pytorch并沒有一套屬于自己的數(shù)據(jù)結(jié)構(gòu)以及數(shù)據(jù)讀取算法,dataloader個(gè)人感覺其實(shí)就是類似于tf中的feed,并沒有任何速度以及性能上的提升。先總結(jié)一下遇到的坑:1. 沒有比較高效的數(shù)據(jù)存儲,tensorflow有tfrecord, caffe有l(wèi)mdb,cv.imread在網(wǎng)絡(luò)訓(xùn)練過程中實(shí)屬浪費(fèi)時(shí)間。這里感謝一下小智大神?@智天成?。解決方案:

當(dāng)時(shí)看到了一個(gè)還不錯的github鏈接,https://github.com/Lyken17/Efficient-PyTorch主要是講如何使用lmdb,h5py,pth,lmdb,n5等數(shù)據(jù)存儲方式皆可以。個(gè)人的感受是,h5在數(shù)據(jù)調(diào)用上比較快,但是如果要使用多線程讀寫,就盡量不要使用h5,因?yàn)閔5的多線程讀寫好像比較麻煩。http://docs.h5py.org/en/stable/mpi.html這里貼一下h5數(shù)據(jù)的讀寫代碼(主要需要注意的是字符串的讀寫需要encode,decode,最好用create_dataset,直接寫的話讀的時(shí)候會報(bào)錯):

寫:

imagenametotal_.append(os.path.join('images', imagenametotal).encode())

with h5py.File(outfile) as f:

f.create_dataset('imagename', data=imagenametotal_)

f['part'] = parts_

f['S'] = Ss_

f['image'] = cvimgs

讀:

with h5py.File(outfile) as f:

imagename = [x.decode() for x in f['imagename']]

kp2ds = np.array(f['part'])

kp3ds = np.array(f['S'])

cvimgs = np.array(f['image'])這里其實(shí)有2個(gè)注意點(diǎn),第一,測試的時(shí)候需要手動將gpu合并,代碼如下:from balanced_parallel import DataParallelModel, DataParallelCriterionmodel = DataParallelModel(model, device_ids=gpus).cuda()criterion = loss_fn().cuda()

第二,當(dāng)loss函數(shù)有多個(gè)組成的時(shí)候,比如 loss = loss1 + loss2 + loss3那么需要把這三個(gè)loss寫到一個(gè)class中,然后再forward里面將其加起來。其次,我們還可以用另外一個(gè)函數(shù)distributedDataParallel來解決gpu imbalance的問題.使用方法如下:(注:此方法好像無法和h5數(shù)據(jù)同時(shí)使用)from torch.nn.parallel.scatter_gather import gatherpreds = gather(preds, 0)

3.gpu利用率不高+gpu現(xiàn)存占用浪費(fèi)常用配置:1主函數(shù)前面加:(這個(gè)會犧牲一點(diǎn)點(diǎn)現(xiàn)存提高模型精度)from torch.utils.data.distributed import DistributedSamplerfrom torch.nn.parallel import DistributedDataParalleltorch.distributed.init_process_group(backend="nccl")# 配置每個(gè)進(jìn)程的gpulocal_rank = torch.distributed.get_rank()torch.cuda.set_device(local_rank)device = torch.device("cuda", local_rank)#封裝之前要把模型移到對應(yīng)的gpumodel.to(device)model = torch.nn.parallel.DistributedDataParallel(model,device_ids=[local_rank],output_device=local_rank)#原有的dataloader上面加一個(gè)數(shù)據(jù)sampletrain_loader = torch.utils.data.DataLoader(train_dataset,sampler=DistributedSampler(train_dataset))

2訓(xùn)練時(shí),epoch前面加:(定期清空模型,效果感覺不明顯)cudnn.benchmark = Truetorch.backends.cudnn.deterministic = Falsetorch.backends.cudnn.enabled = True

torch.cuda.empty_cache()del xxx(變量名)5dataloader的預(yù)加載設(shè)置:(會在模型訓(xùn)練的時(shí)候加載數(shù)據(jù),提高一點(diǎn)點(diǎn)gpu利用率)def __len__(self):return self.images.shape[0]

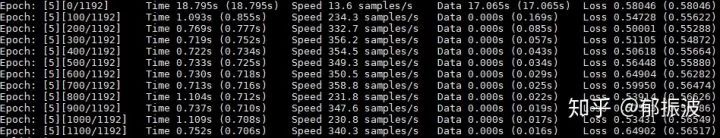

6網(wǎng)絡(luò)設(shè)計(jì)很重要,外加不要初始化任何用不到的變量,因?yàn)閜yroch的初始化和forward是分開的,他不會因?yàn)槟悴蝗ナ褂茫蝗コ跏蓟?/span>7最后放一張目前依舊困擾我的圖片:train_loader = torch.utils.data.DataLoader(train_dataset,pin_memory=True,)

可以看到,每個(gè)epoch剛開始訓(xùn)練數(shù)據(jù)的時(shí)候,第一個(gè)iteration時(shí)間會占用的非常多,pytorch這里就做的很糟糕,并不是一個(gè)動態(tài)分配的過程,我也看到了一個(gè)看上去比較靠譜的解決方案,解決方案如下?@風(fēng)車車:

可以看到,每個(gè)epoch剛開始訓(xùn)練數(shù)據(jù)的時(shí)候,第一個(gè)iteration時(shí)間會占用的非常多,pytorch這里就做的很糟糕,并不是一個(gè)動態(tài)分配的過程,我也看到了一個(gè)看上去比較靠譜的解決方案,解決方案如下?@風(fēng)車車:在深度學(xué)習(xí)中喂飽gpu

https://zhuanlan.zhihu.com/p/77633542

但是我看了下代碼,可能需要重構(gòu)dataloader,看了評論好像還有問題,有點(diǎn)懶,目前還沒有踩坑,準(zhǔn)備后面有時(shí)間踩一下。暫且更新到這里,后續(xù)遇到什么坑陸續(xù)補(bǔ)充,也歡迎大家給我補(bǔ)充,pytorch初學(xué)者小白一枚。更個(gè)新;順便吐槽一下上面的dali,局限性很大,比較trick的數(shù)據(jù)預(yù)處理很難搞定。8 apex混合單精度模型事實(shí)證明,apex并沒有官網(wǎng)說的那么玄乎,只能減低顯存,并不能提速(12G顯存大概可以降低到8G左右,效果還挺明顯的,但是,速度降低了大概1/3,好像有點(diǎn)得不償失)。編譯之后提速也很有限,再此留個(gè)坑,有小伙伴能解決的可以私信我哈,如果可以解決我會仔細(xì)羅列一遍。。

評論

圖片

表情