基于深度學(xué)習(xí)的疲勞駕駛檢測(cè)

向AI轉(zhuǎn)型的程序員都關(guān)注了這個(gè)號(hào)??????

1 課題背景

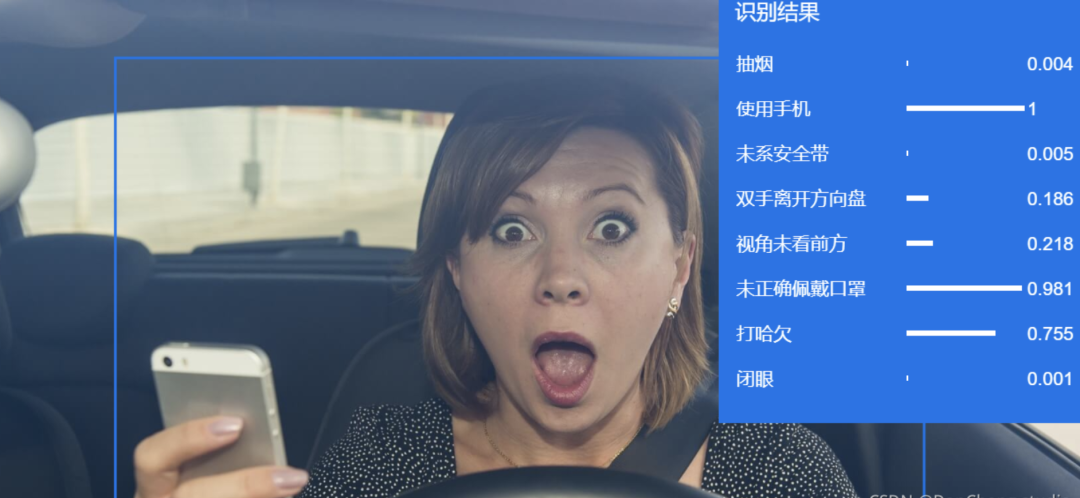

關(guān)于對(duì)疲勞駕駛的研究不在少數(shù), 不少學(xué)者從人物面部入手展開。人類的面部包含著許多不同的特征信息, 例如其中一些比較明顯的特征如打哈欠、 閉眼、 揉眼等表情特征可用來作為判斷駕駛員是否處于疲勞狀態(tài)的依據(jù)。隨著計(jì)算機(jī)技術(shù)的不斷發(fā)展, 尤其是在人工智能相關(guān)技術(shù)勃發(fā)的今天, 借助計(jì)算機(jī)可以快速有效的識(shí)別出圖片中人臉特征, 對(duì)處于當(dāng)前時(shí)刻駕駛員的精神狀態(tài)做出判斷, 并將疲勞預(yù)警信息傳達(dá)給司機(jī), 以保證交通的安全運(yùn)行, 減少傷亡事故的發(fā)生。

2 實(shí)現(xiàn)目標(biāo)

經(jīng)查閱相關(guān)文獻(xiàn),疲勞在人體面部表情中表現(xiàn)出大致三個(gè)類型:打哈欠(嘴巴張大且相對(duì)較長(zhǎng)時(shí)間保持這一狀態(tài))、眨眼(或眼睛微閉,此時(shí)眨眼次數(shù)增多,且眨眼速度變慢)、點(diǎn)頭(瞌睡點(diǎn)頭)。本實(shí)驗(yàn)從人臉朝向、位置、瞳孔朝向、眼睛開合度、眨眼頻率、瞳孔收縮率等數(shù)據(jù)入手,并通過這些數(shù)據(jù),實(shí)時(shí)地計(jì)算出駕駛員的注意力集中程度,分析駕駛員是否疲勞駕駛和及時(shí)作出安全提示。

3 當(dāng)前市面上疲勞駕駛檢測(cè)的方法

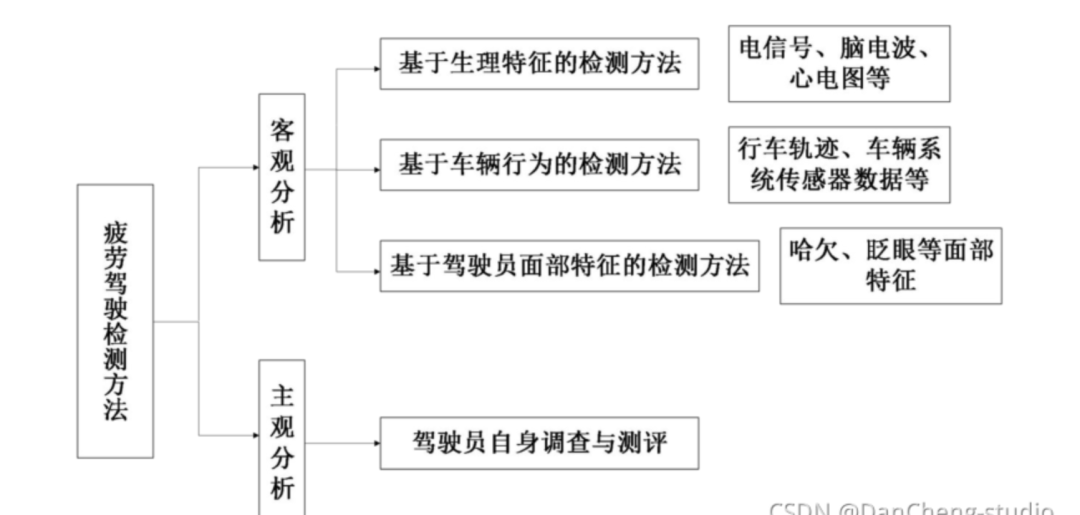

學(xué)長(zhǎng)通過對(duì)疲勞駕駛在不同方法下研究進(jìn)展的分析, 可以更清晰的認(rèn)識(shí)的到當(dāng)下對(duì)該問題較為有效的判定方法。根據(jù)研究對(duì)象的不同對(duì)檢測(cè)方法進(jìn)行分類, 具體分類方法如圖

基于駕駛員面部特征的檢測(cè)方法是根據(jù)人在疲勞時(shí)面部變化來分析此時(shí)的精神狀態(tài)。人在瞌睡、 疲勞時(shí)面部表情與清醒時(shí)有著明顯的區(qū)別。通過裝置在車輛中的攝像頭對(duì)駕駛員人臉圖片的采集, 利用計(jì)算機(jī)圖像處理和模式識(shí)別, 可以有效檢測(cè)駕駛員的疲

勞特征信息, 比較直觀的特征有:打哈欠, 眨眼, 低頭等。

4 相關(guān)數(shù)據(jù)集

學(xué)長(zhǎng)收集的疲勞檢測(cè)數(shù)據(jù)集

駕駛疲勞人臉數(shù)據(jù)庫(kù)圖片來源分為 3 部分, 每部分均包含疲勞、 輕度疲勞和非疲勞三種精神狀態(tài)類別。樣本數(shù)據(jù)庫(kù)共 4800 張圖像, 其中疲勞狀態(tài)有 1622 張數(shù)據(jù)樣本, 輕度疲勞有 1506 張數(shù)據(jù)樣本, 非疲勞狀態(tài)有 1618 張數(shù)據(jù)樣本。各部分?jǐn)?shù)據(jù)結(jié)構(gòu)如下:網(wǎng)絡(luò)采集部分疲勞包含 435 張樣本圖片, 輕度疲勞狀態(tài)包含 430 張樣本圖片, 非疲勞狀態(tài)包含 432 張樣本圖片, 共 1297 張樣本數(shù)據(jù)圖像;視頻數(shù)據(jù)庫(kù)采集部分疲勞狀態(tài)包含 1037張樣本圖像, 輕度疲勞狀態(tài)包含 1030 張樣本圖片, 非疲勞狀態(tài)包含 1036 張樣本圖片,共 3103 張樣本數(shù)據(jù)圖像;

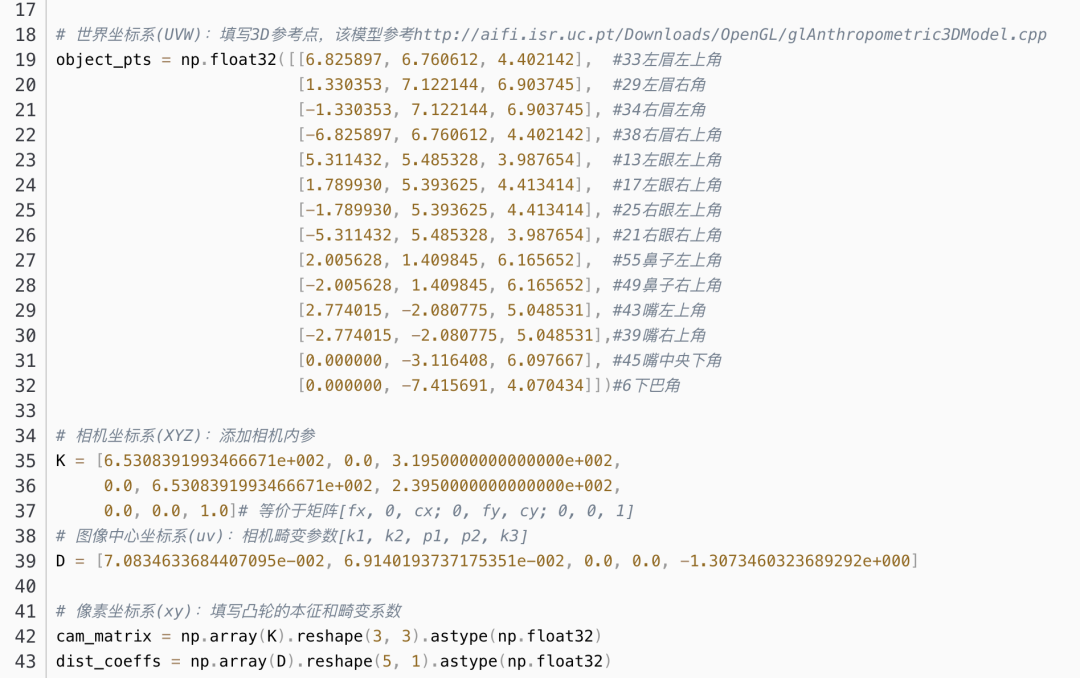

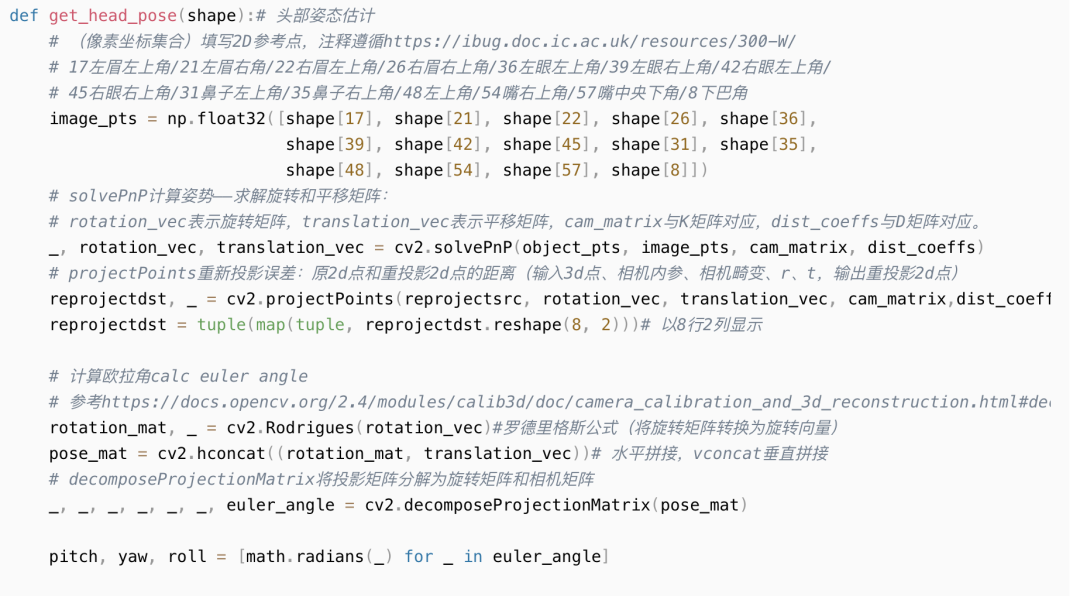

5 基于頭部姿態(tài)的駕駛疲勞檢測(cè)

5.1 如何確定疲勞狀態(tài)

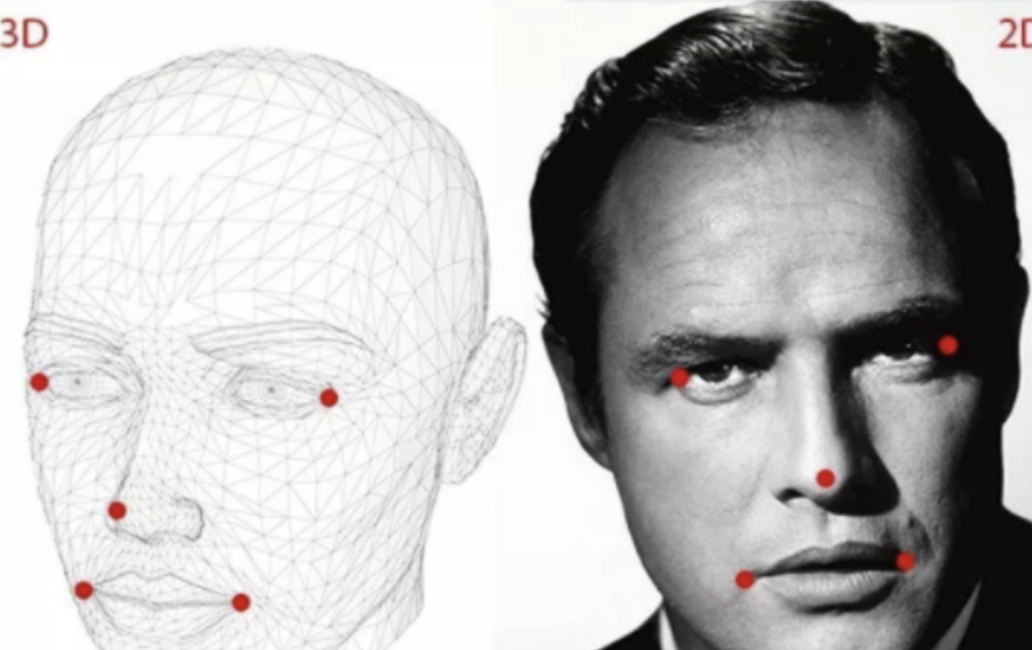

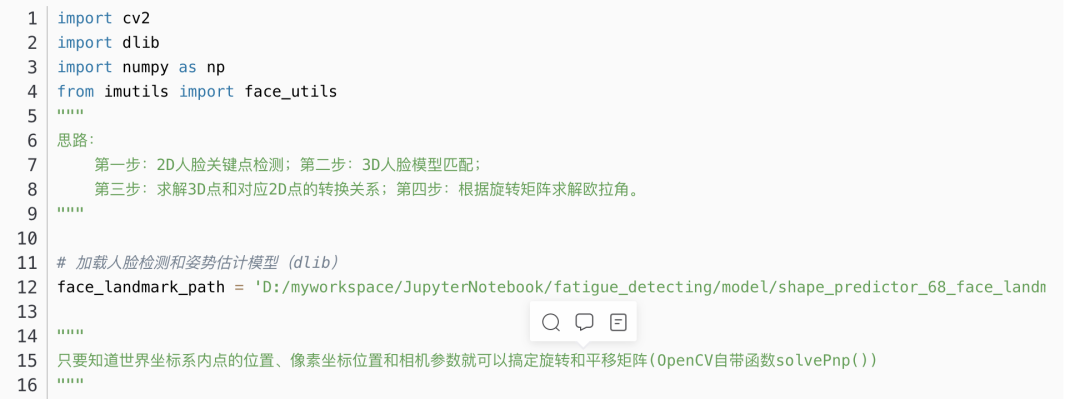

5.2 算法步驟

5.3 打瞌睡判斷

頭部姿態(tài)判斷打瞌睡得到實(shí)時(shí)頭部姿態(tài)的旋轉(zhuǎn)角度過后,為頭部旋轉(zhuǎn)角度的3個(gè)參數(shù)Yaw,Pitch和Roll的示意圖,駕駛員在打瞌睡時(shí),顯然頭部會(huì)做類似于點(diǎn)頭和傾斜的動(dòng)作.而根據(jù)一般人的打瞌睡時(shí)表現(xiàn)出來的頭部姿態(tài),顯然很少會(huì)在Yaw上有動(dòng)作,而主要集中在Pitch和Roll的行為.設(shè)定參數(shù)閾值為0.3,在一個(gè)時(shí)間段內(nèi)10 s內(nèi),當(dāng)I PitchI≥20°或者|Rolll≥20°的時(shí)間比例超過0.3時(shí),就認(rèn)為駕駛員處于打瞌睡的狀態(tài),發(fā)出預(yù)警。

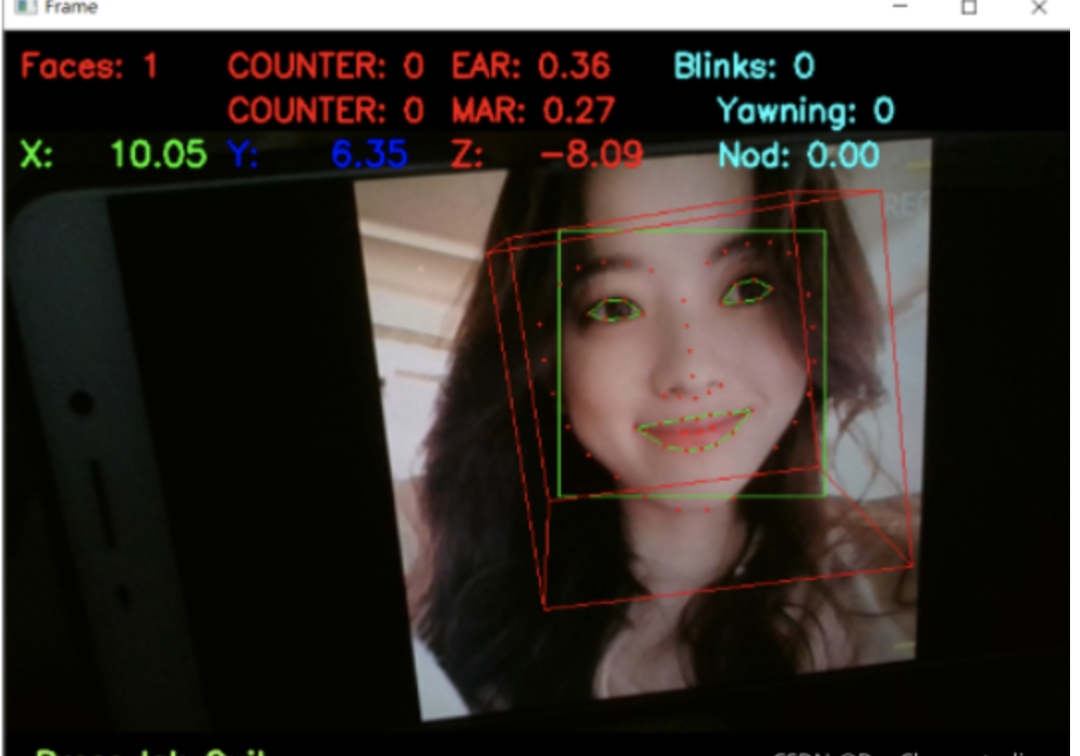

6 基于CNN與SVM的疲勞檢測(cè)方法

6.1 網(wǎng)絡(luò)結(jié)構(gòu)

學(xué)長(zhǎng)將卷積神經(jīng)網(wǎng)絡(luò)作為特征提取器, 支持向量機(jī)作為分類識(shí)別器并通過串聯(lián)將兩者結(jié)合 , 構(gòu)造理想的深度識(shí)別模型, 提高對(duì)駕駛員疲勞的識(shí)別準(zhǔn)確率。本次課題主要以實(shí)現(xiàn)提高識(shí)別精度為目的, 設(shè)計(jì)使用的特征提取網(wǎng)絡(luò)結(jié)構(gòu)中卷積層、 池化層以及全連接層個(gè)數(shù)均為兩層;在網(wǎng)絡(luò)的結(jié)尾處添加一層支持向量機(jī)作為識(shí)別分類器;

根據(jù)對(duì)卷積神經(jīng)網(wǎng)絡(luò)的描述, 這里設(shè)計(jì)使用的網(wǎng)絡(luò)結(jié)構(gòu)為:輸入層、 二層卷積層、 二層池化層、 二層全連接層以及 SVM 分類器組成的卷積神經(jīng)網(wǎng)絡(luò)對(duì)采集數(shù)據(jù)進(jìn)行實(shí)驗(yàn)。

可將網(wǎng)絡(luò)視為三個(gè)部分, 數(shù)據(jù)輸入部分即網(wǎng)絡(luò)輸入層, 為特征提取部分由卷積層和池化層構(gòu)成, SVM 為分類識(shí)別部分;三部分網(wǎng)絡(luò)串聯(lián)出整體識(shí)別框架, 且相互間約束不大, 為后續(xù)優(yōu)化工作提供了條件。

6.2 疲勞圖像分類訓(xùn)練

網(wǎng)絡(luò)的訓(xùn)練由于數(shù)據(jù)量較大進(jìn)行實(shí)驗(yàn)時(shí)將數(shù)據(jù)分為多個(gè)批次, 每個(gè)批次中含有 20張圖像, 經(jīng)過前向、 反向傳播后更新網(wǎng)絡(luò)參數(shù), 訓(xùn)練出誤差合適的網(wǎng)絡(luò)。測(cè)試時(shí), 圖像由網(wǎng)絡(luò)進(jìn)行識(shí)別, 根據(jù)得到的識(shí)別正確率來驗(yàn)證網(wǎng)絡(luò)的可行性。

疲勞駕駛檢測(cè)需對(duì)網(wǎng)絡(luò)進(jìn)行訓(xùn)練, 在保證網(wǎng)絡(luò)訓(xùn)練準(zhǔn)確率達(dá)到一定精度后即可對(duì)圖像進(jìn)行判別;疲勞駕駛網(wǎng)絡(luò)訓(xùn)練算法過程如下:

Step1:網(wǎng)絡(luò)初始化:初始化網(wǎng)絡(luò)學(xué)習(xí)率η, 在數(shù)值范圍[0, 1]中隨機(jī)初始化網(wǎng)絡(luò)參數(shù)權(quán)值及偏置值;設(shè)置網(wǎng)絡(luò)結(jié)構(gòu):卷積核大小為 5×5, 每批次樣本數(shù)量 20;

Step2:隨機(jī)選擇數(shù)據(jù)庫(kù)內(nèi)面部表情圖像并依次輸入網(wǎng)絡(luò), 網(wǎng)絡(luò)按照送入每一批次的圖像進(jìn)行訓(xùn)練;

Step3:網(wǎng)絡(luò)將訓(xùn)練得到的輸出值同圖像期望值進(jìn)行比較, 計(jì)算出輸出誤差;

Step4:根據(jù)反向傳播原理將誤差反向傳播計(jì)算, 并調(diào)整網(wǎng)絡(luò)參數(shù)權(quán)值和偏置值;

Step5:判斷迭代次數(shù), 達(dá)到期望的迭代步數(shù)后轉(zhuǎn)到 Step6, 否則轉(zhuǎn)到 Step3;

Step6:將 CNN 提取到的圖像特征傳入 SVM 中進(jìn)行訓(xùn)練;

Step7:結(jié)束。

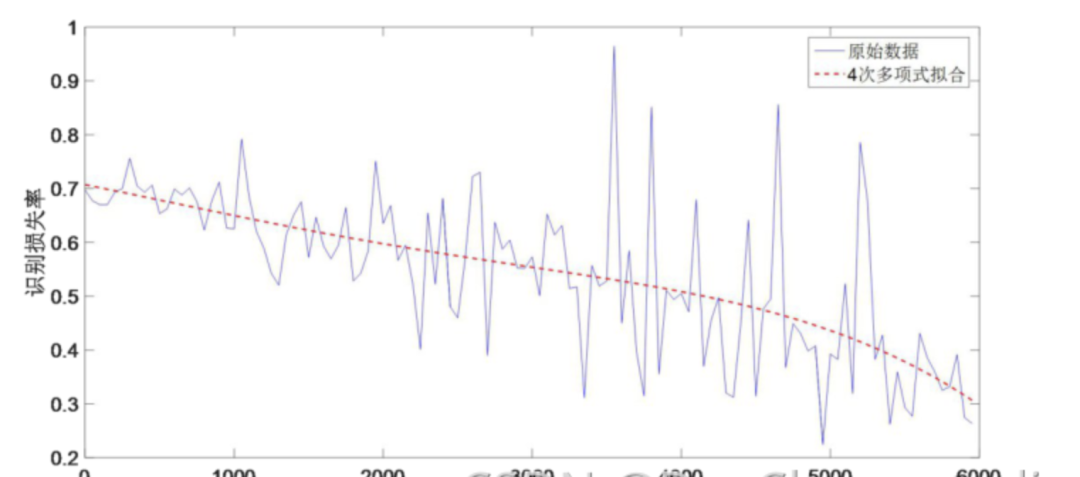

6.3 訓(xùn)練結(jié)果

學(xué)長(zhǎng)將對(duì)建立起的數(shù)據(jù)集進(jìn)行實(shí)驗(yàn), 實(shí)驗(yàn)中分別在每一批次下對(duì)識(shí)別正確和錯(cuò)誤個(gè)數(shù)進(jìn)行統(tǒng)計(jì), 然后同批次中圖片數(shù)量相比, 得出最終的準(zhǔn)確率和損失率(錯(cuò)誤率) 。

模型測(cè)試結(jié)果

原文地址 https://blog.csdn.net/HUXINY/article/details/121307646

機(jī)器學(xué)習(xí)算法AI大數(shù)據(jù)技術(shù)

搜索公眾號(hào)添加: datanlp

長(zhǎng)按圖片,識(shí)別二維碼

閱讀過本文的人還看了以下文章:

TensorFlow 2.0深度學(xué)習(xí)案例實(shí)戰(zhàn)

基于40萬表格數(shù)據(jù)集TableBank,用MaskRCNN做表格檢測(cè)

《基于深度學(xué)習(xí)的自然語(yǔ)言處理》中/英PDF

Deep Learning 中文版初版-周志華團(tuán)隊(duì)

【全套視頻課】最全的目標(biāo)檢測(cè)算法系列講解,通俗易懂!

《美團(tuán)機(jī)器學(xué)習(xí)實(shí)踐》_美團(tuán)算法團(tuán)隊(duì).pdf

《深度學(xué)習(xí)入門:基于Python的理論與實(shí)現(xiàn)》高清中文PDF+源碼

《深度學(xué)習(xí):基于Keras的Python實(shí)踐》PDF和代碼

python就業(yè)班學(xué)習(xí)視頻,從入門到實(shí)戰(zhàn)項(xiàng)目

2019最新《PyTorch自然語(yǔ)言處理》英、中文版PDF+源碼

《21個(gè)項(xiàng)目玩轉(zhuǎn)深度學(xué)習(xí):基于TensorFlow的實(shí)踐詳解》完整版PDF+附書代碼

《深度學(xué)習(xí)之pytorch》pdf+附書源碼

PyTorch深度學(xué)習(xí)快速實(shí)戰(zhàn)入門《pytorch-handbook》

【下載】豆瓣評(píng)分8.1,《機(jī)器學(xué)習(xí)實(shí)戰(zhàn):基于Scikit-Learn和TensorFlow》

《Python數(shù)據(jù)分析與挖掘?qū)崙?zhàn)》PDF+完整源碼

汽車行業(yè)完整知識(shí)圖譜項(xiàng)目實(shí)戰(zhàn)視頻(全23課)

李沐大神開源《動(dòng)手學(xué)深度學(xué)習(xí)》,加州伯克利深度學(xué)習(xí)(2019春)教材

筆記、代碼清晰易懂!李航《統(tǒng)計(jì)學(xué)習(xí)方法》最新資源全套!

《神經(jīng)網(wǎng)絡(luò)與深度學(xué)習(xí)》最新2018版中英PDF+源碼

將機(jī)器學(xué)習(xí)模型部署為REST API

FashionAI服裝屬性標(biāo)簽圖像識(shí)別Top1-5方案分享

重要開源!CNN-RNN-CTC 實(shí)現(xiàn)手寫漢字識(shí)別

同樣是機(jī)器學(xué)習(xí)算法工程師,你的面試為什么過不了?

前海征信大數(shù)據(jù)算法:風(fēng)險(xiǎn)概率預(yù)測(cè)

【Keras】完整實(shí)現(xiàn)‘交通標(biāo)志’分類、‘票據(jù)’分類兩個(gè)項(xiàng)目,讓你掌握深度學(xué)習(xí)圖像分類

VGG16遷移學(xué)習(xí),實(shí)現(xiàn)醫(yī)學(xué)圖像識(shí)別分類工程項(xiàng)目

特征工程(二) :文本數(shù)據(jù)的展開、過濾和分塊

如何利用全新的決策樹集成級(jí)聯(lián)結(jié)構(gòu)gcForest做特征工程并打分?

Machine Learning Yearning 中文翻譯稿

全球AI挑戰(zhàn)-場(chǎng)景分類的比賽源碼(多模型融合)

斯坦福CS230官方指南:CNN、RNN及使用技巧速查(打印收藏)

python+flask搭建CNN在線識(shí)別手寫中文網(wǎng)站

中科院Kaggle全球文本匹配競(jìng)賽華人第1名團(tuán)隊(duì)-深度學(xué)習(xí)與特征工程

不斷更新資源

深度學(xué)習(xí)、機(jī)器學(xué)習(xí)、數(shù)據(jù)分析、python

搜索公眾號(hào)添加: datayx