數(shù)據(jù)還是模型?人類知識(shí)在深度學(xué)習(xí)里還有用武之地嗎?

極市導(dǎo)讀

隨著模型規(guī)模越來(lái)越大,訓(xùn)練模型的數(shù)據(jù)越來(lái)越多,模型是否還需要人類的知識(shí)這一問(wèn)題也不斷被提起,不斷被爭(zhēng)論。后深度學(xué)習(xí)時(shí)代,模型真的還需要人類的“知識(shí)”嗎? >>加入極市CV技術(shù)交流群,走在計(jì)算機(jī)視覺(jué)的最前沿

近些年來(lái),隨著數(shù)據(jù)量越來(lái)越多,算力價(jià)格越來(lái)越便宜,根植于數(shù)據(jù)+算力的深度學(xué)習(xí)茁壯成長(zhǎng)。在這種背景下,作為一種強(qiáng)有力的表示學(xué)習(xí)方法的深度學(xué)習(xí)讓人們驚訝的發(fā)現(xiàn),只要投喂足夠多的數(shù)據(jù),DNN 模型即可展現(xiàn)出強(qiáng)大的威力。看上去,模型似乎不再需要由人去教它如何看數(shù)據(jù)了(特征工程)。

從這之后,各個(gè)領(lǐng)域、各個(gè)任務(wù)都相繼出現(xiàn)了不少大規(guī)模的預(yù)訓(xùn)練模型,它們從無(wú)監(jiān)督的數(shù)據(jù)中學(xué)習(xí)到一些東西,然后再使用小規(guī)模任務(wù)數(shù)據(jù)去精調(diào)模型,就可以讓模型擁有非常優(yōu)秀的表現(xiàn)。看上去,模型也不再需要由人去告訴它什么是正確的了,不需要準(zhǔn)備大量的數(shù)據(jù)去“教”它了,只靠模型自己就可以學(xué)到“知識(shí)”。

同時(shí),這期間也出現(xiàn)了 AlphaGo Zero ,可以完全不需要學(xué)習(xí)人類的棋譜,通過(guò)自己腦補(bǔ),自己訓(xùn)練,就可以下出世界第一的圍棋。看上去,模型甚至可以脫離人類的經(jīng)驗(yàn),自己去發(fā)現(xiàn)更好、更優(yōu)的“知識(shí)”。

所以自然而然,我們就會(huì)去反思,后深度學(xué)習(xí)時(shí)代,模型真的還需要人類的“知識(shí)”嗎?

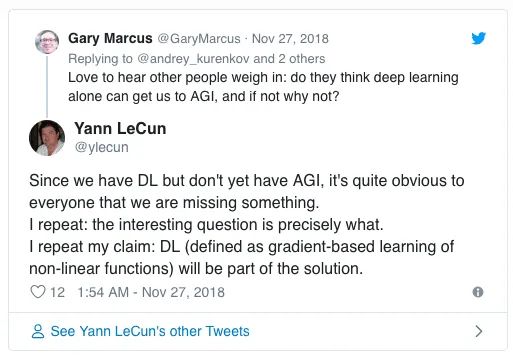

隨著模型規(guī)模越來(lái)越大,訓(xùn)練模型的數(shù)據(jù)越來(lái)越多,模型是否還需要人類的知識(shí)這一問(wèn)題也不斷被提起,不斷被爭(zhēng)論。就像 GPT-3 被發(fā)布時(shí),哪怕它已經(jīng)展現(xiàn)出了那么多“神奇”的能力,研究者們依然會(huì)去爭(zhēng)論,大模型是否真正學(xué)到了知識(shí)?是否還需要人類的知識(shí)去指導(dǎo)它?

而面對(duì)這一切,讓我們從 2019 年的一場(chǎng)爭(zhēng)論談起。

緣起

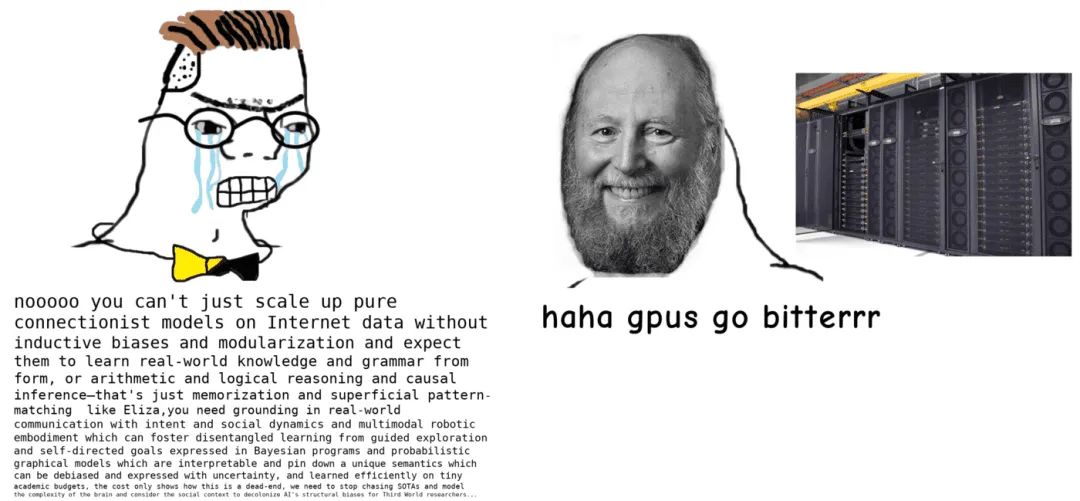

2019年3月,阿爾伯塔大學(xué)教授 Rich Sutton 在博客上發(fā)表了一篇文章 《 The Bitter Lesson 》 (慘痛的教訓(xùn))[1],開篇就說(shuō)道:“在70年的AI研究中可以得到的最大的教訓(xùn)是,利用計(jì)算能力的一般方法最終是最有效的方法,且是大幅度的領(lǐng)先。”他認(rèn)為,盡管在算力恒定的情況下,使用人類知識(shí)去提升性能可能是唯一的方法,但正如我們大家所看到的,這些年算力成本卻在持續(xù)地指數(shù)級(jí)下降,在取消算力恒定的約束后,人類知識(shí)的重要性也就變得可有可無(wú)了,也即是說(shuō),提升計(jì)算能力才是 AI 研究進(jìn)步的最一般且最有效的方法。

Sutton 教授舉出來(lái)的例子也非常實(shí)際,例如前文所提到的 AlphaGo Zero ,在其自學(xué)圍棋之后,又迅速擴(kuò)展到了所有棋類。在其他領(lǐng)域,人們使用各種五花八門的特征工程去訓(xùn)練模型,而依賴大量計(jì)算的 DNN 模型發(fā)揮其威力,又打敗了特征工程(如CNN vs SIFT,神經(jīng)機(jī)器翻譯 vs 傳統(tǒng)的對(duì)齊方法等)。

最后,Sutton 教授認(rèn)為,隨著算力的增強(qiáng)去提升“搜索”能力與“學(xué)習(xí)”能力是唯二的方法可以通用的提升所有 AI 模型與研究的性能和效果。

而心智是極其復(fù)雜的東西,應(yīng)停止試圖用簡(jiǎn)單的方法來(lái)進(jìn)行“思考”,已有的“心智”不應(yīng)該包含在 AI 之中,而是要讓 AI 獲得能夠得到“心智”的能力,AI應(yīng)當(dāng)自己去發(fā)現(xiàn),而不是去包含已經(jīng)發(fā)現(xiàn)的東西。

這篇博客自然在學(xué)界掀起了軒然大波,支持者們認(rèn)為,從近些年的工作來(lái)看,DNN 的確展現(xiàn)了強(qiáng)大的威力,尤其各大預(yù)訓(xùn)練模型橫空出世,在訓(xùn)練 DNN 的過(guò)程中,也的確在逐漸剝離人類的經(jīng)驗(yàn),未來(lái)可能真的僅靠算力就可以了。

反對(duì)者則認(rèn)為,的確看上去 DNN 模型的發(fā)展是一步步地在拋棄人類知識(shí),但是其展現(xiàn)威力的原因還是在于那些沒(méi)有被拋棄的知識(shí)。畢竟現(xiàn)在的 DNN 模型,還是無(wú)法避開卷積、LSTM、No-Linear 等人類知識(shí),正是因?yàn)槔昧艘恍┤祟愔R(shí),AI 才得以取得今天的成就。

而今天,筆者還是想借著阿姆斯特丹大學(xué)教授 Max Welling 于 2019 年 4 月寫的一篇回應(yīng)文章《Do we still need models or just more data and compute?》[2]淺談一下這個(gè)問(wèn)題。

模型 OR 數(shù)據(jù)+算力?

Welling 教授是部分認(rèn)同 Sutton 教授的第二點(diǎn)設(shè)想的,即讓模型自己去“發(fā)現(xiàn)”這個(gè)世界的一些“知識(shí)”——如物理學(xué)、心理學(xué)、社會(huì)學(xué)等規(guī)律。但是問(wèn)題在于,Sutton 的想法是完全理想化的,即數(shù)據(jù)是絕對(duì)充足的,在現(xiàn)實(shí)中,數(shù)據(jù)往往不是那么的充足,比如強(qiáng)化學(xué)習(xí)的確在圍棋上取得了非常大的成就,但我們不能忽略,圍棋是一個(gè)有強(qiáng)規(guī)則限制,且數(shù)據(jù)近乎無(wú)限(已有規(guī)則之內(nèi),可以任意生成對(duì)弈數(shù)據(jù))的任務(wù)。但是如果到了自動(dòng)駕駛的場(chǎng)景,每一個(gè)問(wèn)題則又變得長(zhǎng)尾。

在文章中,Welling 教授提出了自己的方法。數(shù)據(jù)不足其實(shí)是真實(shí)世界的常態(tài),所以使用大量的人類知識(shí)也是AI的常態(tài)。理想狀況下當(dāng)然是真實(shí)世界每一個(gè)問(wèn)題中,每一個(gè)領(lǐng)域中數(shù)據(jù)都是充足的,但這又顯然是不可能的。當(dāng)然,領(lǐng)域這么多,總會(huì)有那么若干個(gè)領(lǐng)域數(shù)據(jù)是足夠的,而在充足的數(shù)據(jù)中,也是可以訓(xùn)練出一個(gè)非常好的模型的。

但是問(wèn)題就在于,從足夠的數(shù)據(jù)中所訓(xùn)練出來(lái)的模型,只具備歸納能力(原文為 Discriminative methods,即判別模型),而我們又需要從模型中剝離原本數(shù)據(jù)的歸納偏置,只留下“知識(shí)”(原文為講判別模型反推成為一個(gè)生成模型,其實(shí)就是讓模型具備演繹能力),那么該模型就可以輕松地遷移到新的領(lǐng)域了。

例如,我們要訓(xùn)練一個(gè)語(yǔ)言模型,在訓(xùn)練好了之后,卻又讓模型忘掉訓(xùn)練數(shù)據(jù)中的“事實(shí)”(如劉德華的老婆是朱麗倩)而僅剩下知識(shí)(【男人】的老婆是【女人】),那么這個(gè)語(yǔ)言模型就可以去“想象”其他的文本,那它就適用于任何類似的文本了。

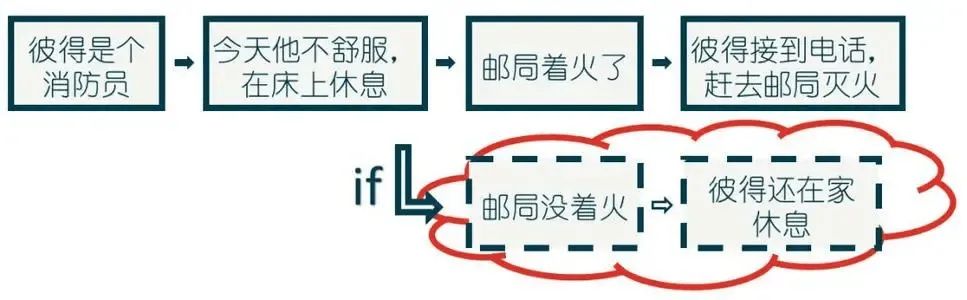

這正是人類自身具備的一個(gè)強(qiáng)大的能力——“反事實(shí)”的能力,即在腦中想象一個(gè)不存在的世界的能力,例如我如果做了某件事會(huì)發(fā)生什么,如果某件事沒(méi)有發(fā)生,現(xiàn)在會(huì)怎么樣。Welling 教授認(rèn)為,人具備這種能力的程度,恰恰又取決于他對(duì)這個(gè)世界知識(shí)的了解程度(如物理學(xué)、心理學(xué)知識(shí)等)。

當(dāng)然符號(hào) AI 就是以這種方式構(gòu)筑的,但它又受限于專家所寫的規(guī)則,無(wú)法應(yīng)對(duì)復(fù)雜的世界(Sutton 教授所秉持的觀點(diǎn))。

而如果有一個(gè) AI 具備了從數(shù)據(jù)中學(xué)習(xí)這種東西的能力( Welling 教授認(rèn)為是基于強(qiáng)化學(xué)習(xí)方法),的確,可以只使用一點(diǎn)點(diǎn)人類知識(shí),以及充足的算力,就可以訓(xùn)練出來(lái)一個(gè) AGI(通用人工智能) ,至于這個(gè)模型還是不是使用人類所設(shè)計(jì)的結(jié)構(gòu)(畢竟人類設(shè)計(jì)的模型結(jié)構(gòu)也是人類知識(shí)),那就不知道了。

筆者的一點(diǎn)想法

Welling 教授的想法和愿景,筆者是大部分同意的,或者說(shuō),筆者前幾年秉持的觀點(diǎn),在做的工作,其實(shí)就是想要訓(xùn)練出來(lái)一個(gè)“只有知識(shí),沒(méi)有事實(shí)”的語(yǔ)言模型。現(xiàn)在的想法,也是想在部分問(wèn)題上讓模型做到“知識(shí)化”(雖然部分是符號(hào)的做法),但關(guān)于現(xiàn)狀,筆者也想談?wù)勛约捍譁\的想法。

首先,Sutton 教授所舉的例子(本質(zhì)上是 DNN 表示學(xué)習(xí) vs 特征工程),實(shí)際上也是沒(méi)有脫離人類知識(shí)的。例如圍棋,游戲規(guī)則就是人類知識(shí),整個(gè)就是在游戲規(guī)則下走下去的。

而且包括下棋在內(nèi)的,所有的 DNN 模型,雖然人類不去指導(dǎo)模型去“怎么看數(shù)據(jù)”了,但人類還是在指導(dǎo)模型“應(yīng)該看什么,注意看哪些”。即上面所討論的所有關(guān)于模型結(jié)構(gòu)的部分,哪怕是可以從數(shù)學(xué)上證明,部分模型結(jié)構(gòu)雖然看上去差別挺大,但是從特征捕捉的角度來(lái)講是等價(jià)的,但仍舊沒(méi)有脫離它。

從最初的 MLP 到現(xiàn)在大流行的 Transformers ,我們就是不斷地在教模型怎么樣去看數(shù)據(jù),同時(shí),我們也在不斷地用數(shù)據(jù)分布試圖去描述這個(gè)模型所要面對(duì)的世界,預(yù)訓(xùn)練模型亦是如此。這么說(shuō)來(lái),只不過(guò)如 Welling 教授所說(shuō),我們用的知識(shí)變少了而已。

而 Welling 教授所講反事實(shí)部分,人類的確是擁有了一定的規(guī)則,甚至是規(guī)律之后,就會(huì)進(jìn)行“反事實(shí)”思考,但問(wèn)題卻不在判別模型與生成模型,而是現(xiàn)如今的統(tǒng)計(jì)模型,都難以做到。Welling 教授就判別模型的評(píng)價(jià)更像是對(duì)整個(gè)統(tǒng)計(jì)模型的評(píng)價(jià):統(tǒng)計(jì)模型只能進(jìn)行歸納,卻無(wú)法進(jìn)行演繹( Welling 教授對(duì)生成模型的描述更像是一種演繹能力),而如 《 The book of WHY 》 作者在書中所說(shuō):統(tǒng)計(jì)學(xué)習(xí)只能去尋找關(guān)聯(lián),而不能得到因果。所以或許 Welling 所提到的愿景,現(xiàn)如今也只能是愿景。

更簡(jiǎn)單地說(shuō),統(tǒng)計(jì)模型所學(xué)的一切,都只是“是什么”,而學(xué)不到“不是什么”,那么它其實(shí)就完全無(wú)法分辨真和假,這其實(shí)就直接導(dǎo)致它是無(wú)法將學(xué)到的東西應(yīng)用到完全未知的領(lǐng)域的。預(yù)訓(xùn)練模型起到作用,其實(shí)也是因?yàn)閿?shù)據(jù)足夠大,且足夠通用了,讓模型見過(guò)了絕大多數(shù)下游任務(wù)的數(shù)據(jù),學(xué)到了足夠的關(guān)聯(lián),而到了未知的專業(yè)領(lǐng)域,其同樣又會(huì)掣肘。

更玄幻一點(diǎn)兒,也是筆者會(huì)感到無(wú)力的地方,則是,人類現(xiàn)階段是不具備描述知識(shí)的能力的,自然也無(wú)法描述自己是怎么樣學(xué)到的知識(shí),以及學(xué)到了什么樣的知識(shí)。那么,如何去探尋模型怎樣擁有這樣的能力,或許還前路茫茫,但研究者們?nèi)砸圆煌姆绞教剿鳎蛟S有一日真的找到了,那我們也自然期待人工智能真正的大變革。

爭(zhēng)論與未來(lái)

Sutton 教授的博客中寫的內(nèi)容其實(shí)比較客觀合理,他并不是秉持算力與算法對(duì)立的極端觀點(diǎn),雖然其部分說(shuō)法像是試圖挑起這種對(duì)立。而這件事情在學(xué)術(shù)圈開始爭(zhēng)論的時(shí)候,卻又走向了算法 vs 算力的方向。

Welling 教授前面看上去反駁了 Sutton 教授的觀點(diǎn),強(qiáng)調(diào)了人類知識(shí)的作用,但后面他也還在部分認(rèn)同 Sutton 教授。Welling 教授所反駁的 Sutton 教授所闡述的數(shù)據(jù)規(guī)模的問(wèn)題、其他反對(duì)者所提到的模型結(jié)構(gòu)的問(wèn)題以及所謂的自己學(xué)習(xí)的模型是否利用了人類經(jīng)驗(yàn)的問(wèn)題等等,看上去似乎是“顯而易見”且沒(méi)必要爭(zhēng)論的,那么大佬們?yōu)槭裁匆破饋?lái)這場(chǎng)爭(zhēng)論呢?

首先我是相信大佬的智商和知識(shí)儲(chǔ)備的,就好像訓(xùn)練 GPT-3 的大佬們,我認(rèn)為他們是不可能不知道統(tǒng)計(jì)模型的局限的。但是在 PR 的時(shí)候又會(huì)說(shuō) GPT-3 的種種“智能”。那么當(dāng)大佬們?cè)诠拇颠@些看上去不切實(shí)際的言論的時(shí)候,他們到底想要干什么呢?

其實(shí)回顧人工智能幾十年的歷史,技術(shù)在發(fā)展的同時(shí),又往往免不了各個(gè)派系之間的爭(zhēng)辯,而每一次的爭(zhēng)辯,都不免會(huì)有一些看上去不切實(shí)際,甚至完全沒(méi)有邏輯支撐的構(gòu)想,或者產(chǎn)生一些完全斷章取義的攻擊,它們或是想要提出一個(gè)努力的目標(biāo),或是單純想打敗對(duì)面的立場(chǎng),或是僅僅就是想保持自己研究方向的討論熱度,畢竟討論趨勢(shì)到了,這個(gè)方向才能有各方面的支撐繼續(xù)發(fā)展下去。

而現(xiàn)如今,Twitter 的每一場(chǎng)論戰(zhàn),或許也是要去“欺騙”輿情系統(tǒng),讓這個(gè)領(lǐng)域繼續(xù)保持繁榮。而每一次這樣的爭(zhēng)論,哪怕是有這種目的,其碰撞的火花也能讓我們有一些新的思考,這是對(duì)我們受用無(wú)窮的。

參考文獻(xiàn)

[1].The Bitter Lesson http://incompleteideas.net/IncIdeas/BitterLesson.html

[2].Do we still need models or just more data and compute? https://staff.fnwi.uva.nl/m.welling/wp-content/uploads/Model-versus-Data-AI-1.pdf

如果覺(jué)得有用,就請(qǐng)分享到朋友圈吧!

公眾號(hào)后臺(tái)回復(fù)“CVPR21檢測(cè)”獲取CVPR2021目標(biāo)檢測(cè)論文下載~

# CV技術(shù)社群邀請(qǐng)函 #

備注:姓名-學(xué)校/公司-研究方向-城市(如:小極-北大-目標(biāo)檢測(cè)-深圳)

即可申請(qǐng)加入極市目標(biāo)檢測(cè)/圖像分割/工業(yè)檢測(cè)/人臉/醫(yī)學(xué)影像/3D/SLAM/自動(dòng)駕駛/超分辨率/姿態(tài)估計(jì)/ReID/GAN/圖像增強(qiáng)/OCR/視頻理解等技術(shù)交流群

每月大咖直播分享、真實(shí)項(xiàng)目需求對(duì)接、求職內(nèi)推、算法競(jìng)賽、干貨資訊匯總、與 10000+來(lái)自港科大、北大、清華、中科院、CMU、騰訊、百度等名校名企視覺(jué)開發(fā)者互動(dòng)交流~