機(jī)器學(xué)習(xí)高頻面試題:機(jī)器學(xué)習(xí)中的正則化代表什么?

文 | 七月在線

編 | 小七

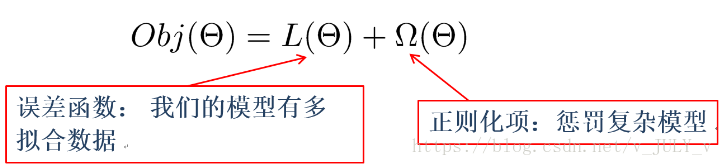

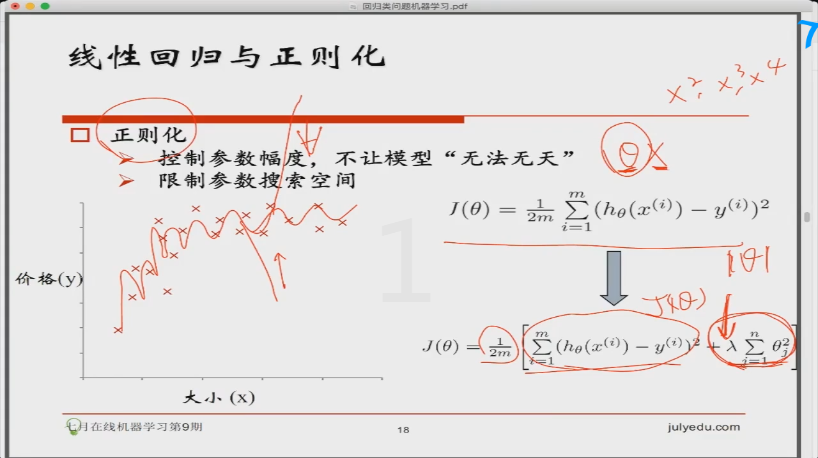

解析:經(jīng)常在各種文章或資料中看到正則化,比如說,一般的目標(biāo)函數(shù)都包含下面兩項(xiàng)其中,誤差/損失函數(shù)鼓勵我們的模型盡量去擬合訓(xùn)練數(shù)據(jù),使得最后的模型會有比較少的 bias。而正則化項(xiàng)則鼓勵更加簡單的模型。因?yàn)楫?dāng)模型簡單之后,有限數(shù)據(jù)擬合出來結(jié)果的隨機(jī)性比較小,不容易過擬合,使得最后模型的預(yù)測更加穩(wěn)定。但一直沒有一篇好的文章理清到底什么是正則化?

說到正則化,得先從過擬合問題開始談起。

1) The Problem of Overfitting(過擬合問題)

擬合問題舉例-線性回歸之房價(jià)問題:

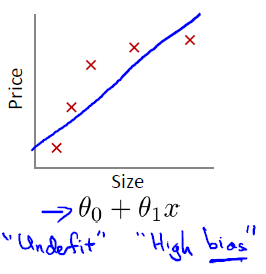

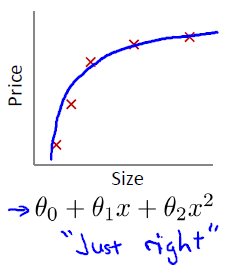

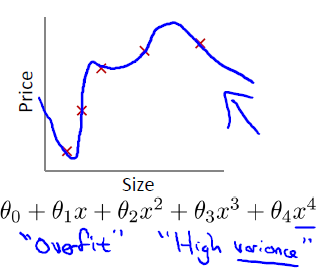

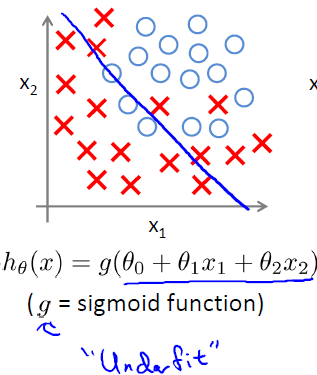

a) 欠擬合(underfit, 也稱High-bias,圖片來源:斯坦福大學(xué)機(jī)器學(xué)習(xí)第七課“正則化”)

b) 合適的擬合:

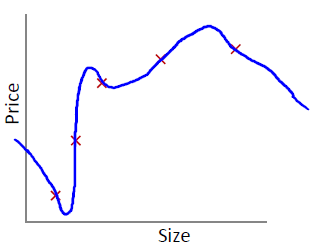

c) 過擬合(overfit,也稱High variance什么是過擬合(Overfitting):

如果我們有非常多的特征,那么所學(xué)的Hypothesis有可能對訓(xùn)練集擬合的非常好(),但是對于新數(shù)據(jù)預(yù)測的很差。

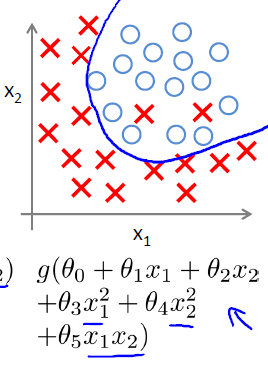

過擬合例子2-邏輯回歸:

與上一個例子相似,依次是欠擬合,合適的擬合以及過擬合:a) 欠擬合

b) 合適的擬合

c) 過擬合

如何解決過擬合問題:

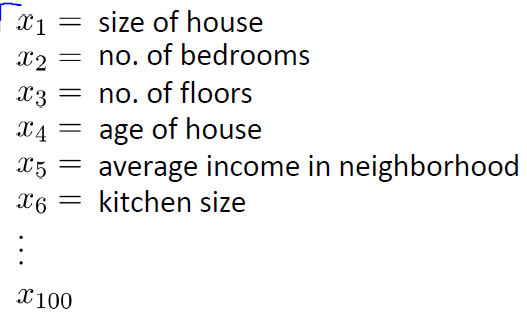

首先,過擬合問題往往源自過多的特征,例如房價(jià)問題,如果我們定義了如下的特征:那么對于訓(xùn)練集,擬合的會非常完美:所以針對過擬合問題,通常會考慮兩種途徑來解決:a) 減少特征的數(shù)量:

-人工的選擇保留哪些特征;

-模型選擇算法

b) 正則化

-保留所有的特征,但是降低參數(shù)的量/值;

-正則化的好處是當(dāng)特征很多時,每一個特征都會對預(yù)測y貢獻(xiàn)一份合適的力量;

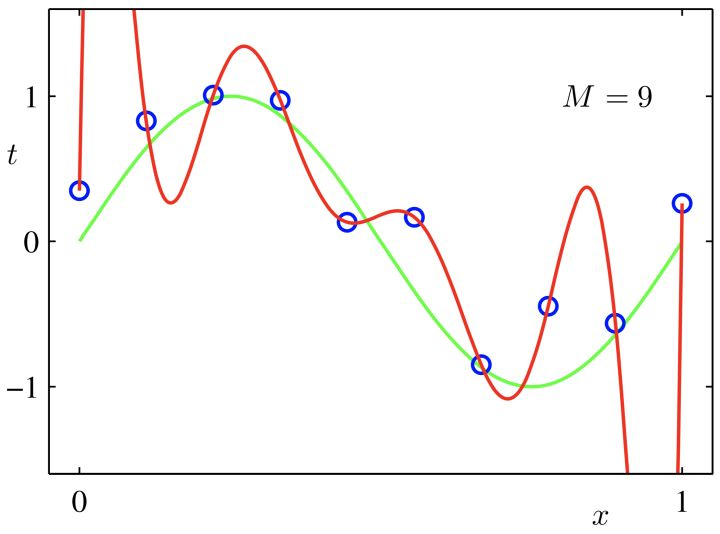

所以說,使用正則化的目的就是為了是為了防止過擬合。如上圖所示,紅色這條想象力過于豐富上下橫跳的曲線就是過擬合情形。結(jié)合上圖和正則化的英文,直譯應(yīng)該叫規(guī)則化。

什么是規(guī)則?比如明星再紅也不能違法,這就是規(guī)則,一個限制。同理,規(guī)劃化就是給需要訓(xùn)練的目標(biāo)函數(shù)加上一些規(guī)則(限制),讓它們不要自我膨脹,不要過于上下無規(guī)則的橫跳,不能無法無天。

L1正則化和L2正則化

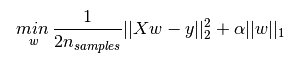

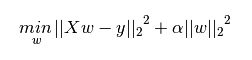

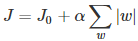

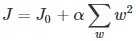

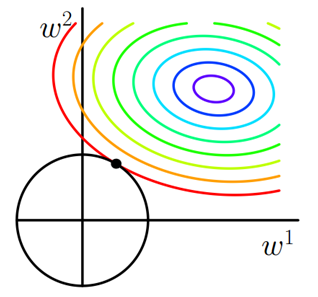

機(jī)器學(xué)習(xí)中幾乎都可以看到損失函數(shù)后面會添加一個額外項(xiàng),常用的額外項(xiàng)一般有兩種,一般英文稱作?1-norm和?2-norm,中文稱作L1正則化和L2正則化,或者L1范數(shù)和L2范數(shù)。L1正則化和L2正則化可以看做是損失函數(shù)的懲罰項(xiàng)。所謂『懲罰』是指對損失函數(shù)中的某些參數(shù)做一些限制。對于線性回歸模型,使用L1正則化的模型建叫做Lasso回歸,使用L2正則化的模型叫做Ridge回歸(嶺回歸)。下圖是Python中Lasso回歸的損失函數(shù),式中加號后面一項(xiàng)α||w||1即為L1正則化項(xiàng)。下圖是Python中Ridge回歸的損失函數(shù),式中加號后面一項(xiàng)即為L2正則化項(xiàng)。

一般回歸分析中回歸w表示特征的系數(shù),從上式可以看到正則化項(xiàng)是對系數(shù)做了處理(限制)。L1正則化和L2正則化的說明如下:L1正則化是指權(quán)值向量w中各個元素的絕對值之和,通常表示為

L2正則化是指權(quán)值向量w中各個元素的平方和然后再求平方根(可以看到Ridge回歸的L2正則化項(xiàng)有平方符號),通常表示為

一般都會在正則化項(xiàng)之前添加一個系數(shù),Python中用α表示,一些文章也用λ表示。這個系數(shù)需要用戶指定。

那添加L1和L2正則化有什么用?

L1正則化可以產(chǎn)生稀疏權(quán)值矩陣,即產(chǎn)生一個稀疏模型,可以用于特征選擇

L2正則化可以防止模型過擬合(overfitting)。當(dāng)然,一定程度上,L1也可以防止過擬合

稀疏模型與特征選擇

上面提到L1正則化有助于生成一個稀疏權(quán)值矩陣,進(jìn)而可以用于特征選擇。為什么要生成一個稀疏矩陣?

稀疏矩陣指的是很多元素為0,只有少數(shù)元素是非零值的矩陣,即得到的線性回歸模型的大部分系數(shù)都是0. 通常機(jī)器學(xué)習(xí)中特征數(shù)量很多,例如文本處理時,如果將一個詞組(term)作為一個特征,那么特征數(shù)量會達(dá)到上萬個(bigram)。在預(yù)測或分類時,那么多特征顯然難以選擇,但是如果代入這些特征得到的模型是一個稀疏模型,表示只有少數(shù)特征對這個模型有貢獻(xiàn),絕大部分特征是沒有貢獻(xiàn)的,或者貢獻(xiàn)微小(因?yàn)樗鼈兦懊娴南禂?shù)是0或者是很小的值,即使去掉對模型也沒有什么影響),此時我們就可以只關(guān)注系數(shù)是非零值的特征。這就是稀疏模型與特征選擇的關(guān)系。

L1正則化和特征選擇

假設(shè)有如下帶L1正則化的損失函數(shù):其中J0是原始的損失函數(shù),加號后面的一項(xiàng)是L1正則化項(xiàng),α是正則化系數(shù)。注意到L1正則化是權(quán)值的絕對值之和,J是帶有絕對值符號的函數(shù),因此J是不完全可微的。

機(jī)器學(xué)習(xí)的任務(wù)就是要通過一些方法(比如梯度下降)求出損失函數(shù)的最小值。當(dāng)我們在原始損失函數(shù)J0后添加L1正則化項(xiàng)時,相當(dāng)于對J0做了一個約束。令L=α∑w|w|,則J=J0+L,此時我們的任務(wù)變成在L約束下求出J0取最小值的解。

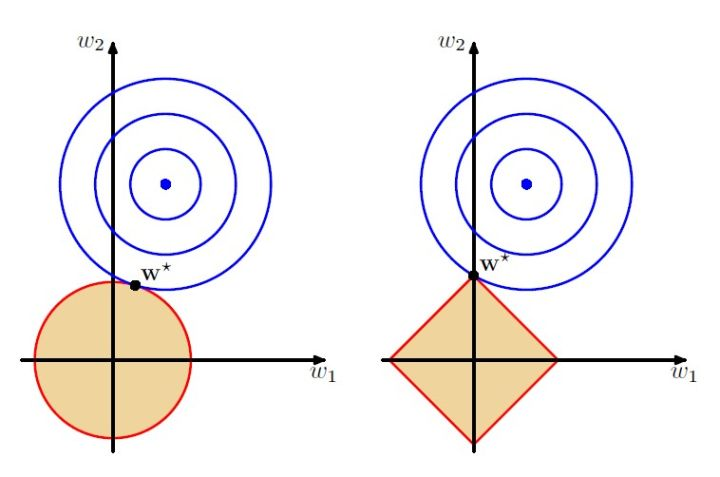

考慮二維的情況,即只有兩個權(quán)值w1和w2,此時L=|w1|+|w2|對于梯度下降法,求解J0的過程可以畫出等值線,同時L1正則化的函數(shù)L也可以在w1w2的二維平面上畫出來。如下圖:圖中等值線是J0的等值線,黑色方形是L函數(shù)的圖形。在圖中,當(dāng)J0等值線與LL圖形首次相交的地方就是最優(yōu)解。上圖中J0與L在L的一個頂點(diǎn)處相交,這個頂點(diǎn)就是最優(yōu)解。注意到這個頂點(diǎn)的值是(w1,w2)=(0,w)。可以直觀想象,因?yàn)長函數(shù)有很多『突出的角』(二維情況下四個,多維情況下更多),J0與這些角接觸的機(jī)率會遠(yuǎn)大于與L其它部位接觸的機(jī)率,而在這些角上,會有很多權(quán)值等于0,這就是為什么L1正則化可以產(chǎn)生稀疏模型,進(jìn)而可以用于特征選擇。

而正則化前面的系數(shù)α,可以控制L圖形的大小。α越小,L的圖形越大(上圖中的黑色方框);α越大,L的圖形就越小,可以小到黑色方框只超出原點(diǎn)范圍一點(diǎn)點(diǎn),這是最優(yōu)點(diǎn)的值(w1,w2)=(0,w)中的w可以取到很小的值。

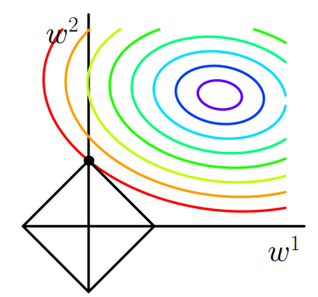

類似,假設(shè)有如下帶L2正則化的損失函數(shù):

同樣可以畫出他們在二維平面上的圖形,如下:二維平面下L2正則化的函數(shù)圖形是個圓,與方形相比,被磨去了棱角。因此J0與L相交時使得w1或w2等于零的機(jī)率小了許多,這就是為什么L2正則化不具有稀疏性的原因。

PRML一書對這兩個圖是這么解釋的

上圖中的模型是線性回歸,有兩個特征,要優(yōu)化的參數(shù)分別是w1和w2,左圖的正則化是L2,右圖是L1。藍(lán)色線就是優(yōu)化過程中遇到的等高線,一圈代表一個目標(biāo)函數(shù)值,圓心就是樣本觀測值(假設(shè)一個樣本),半徑就是誤差值,受限條件就是紅色邊界(就是正則化那部分),二者相交處,才是最優(yōu)參數(shù)。

可見右邊的最優(yōu)參數(shù)只可能在坐標(biāo)軸上,所以就會出現(xiàn)0權(quán)重參數(shù),使得模型稀疏。

L2正則化和過擬合

擬合過程中通常都傾向于讓權(quán)值盡可能小,最后構(gòu)造一個所有參數(shù)都比較小的模型。因?yàn)橐话阏J(rèn)為參數(shù)值小的模型比較簡單,能適應(yīng)不同的數(shù)據(jù)集,也在一定程度上避免了過擬合現(xiàn)象。

可以設(shè)想一下對于一個線性回歸方程,若參數(shù)很大,那么只要數(shù)據(jù)偏移一點(diǎn)點(diǎn),就會對結(jié)果造成很大的影響;但如果參數(shù)足夠小,數(shù)據(jù)偏移得多一點(diǎn)也不會對結(jié)果造成什么影響,專業(yè)一點(diǎn)的說法是『抗擾動能力強(qiáng)』。

那為什么L2正則化可以獲得值很小的參數(shù)?

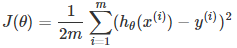

以線性回歸中的梯度下降法為例。假設(shè)要求的參數(shù)為θ,hθ(x)是我們的假設(shè)函數(shù),那么線性回歸的代價(jià)函數(shù)如下:

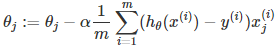

那么在梯度下降法中,最終用于迭代計(jì)算參數(shù)θ的迭代式為

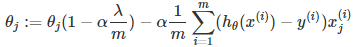

其中α是learning rate. 上式是沒有添加L2正則化項(xiàng)的迭代公式,如果在原始代價(jià)函數(shù)之后添加L2正則化,則迭代公式會變成下面的樣子:其中λ就是正則化參數(shù)。從上式可以看到,與未添加L2正則化的迭代公式相比,每一次迭代,θj都要先乘以一個小于1的因子,從而使得θj不斷減小,因此總得來看,θ是不斷減小的。

最開始也提到L1正則化一定程度上也可以防止過擬合。之前做了解釋,當(dāng)L1的正則化系數(shù)越大時,得到的最優(yōu)解會越小,可以達(dá)到和L2正則化類似的效果。

最后再補(bǔ)充一個角度:正則化其實(shí)就是對模型的參數(shù)設(shè)定一個先驗(yàn),這是貝葉斯學(xué)派的觀點(diǎn)。L1正則是laplace先驗(yàn),l2是高斯先驗(yàn),分別由參數(shù)sigma確定。在數(shù)據(jù)少的時候,先驗(yàn)知識可以防止過擬合。

舉兩個最簡單的例子。

1 拋硬幣,推斷正面朝上的概率。如果只能拋5次,很可能5次全正面朝上,這樣你就得出錯誤的結(jié)論:正面朝上的概率是1--------過擬合!如果你在模型里加正面朝上概率是0.5的先驗(yàn),結(jié)果就不會那么離譜。這其實(shí)就是正則。

2. 最小二乘回歸問題:加L2范數(shù)正則等價(jià)于加了高斯分布的先驗(yàn),加L1范數(shù)正則相當(dāng)于加拉普拉斯分布先驗(yàn)。本文素材來源于七月在線面試題,關(guān)注公號,獲取更多面試資料。本期特訓(xùn)課程

【特征工程與模型優(yōu)化】特訓(xùn)課程

兩大kaggle競賽實(shí)戰(zhàn)案例 + 免費(fèi)CPU云平臺 +共學(xué)社群答疑 + 全套課件代碼

限時1元秒殺!

評論

圖片

表情