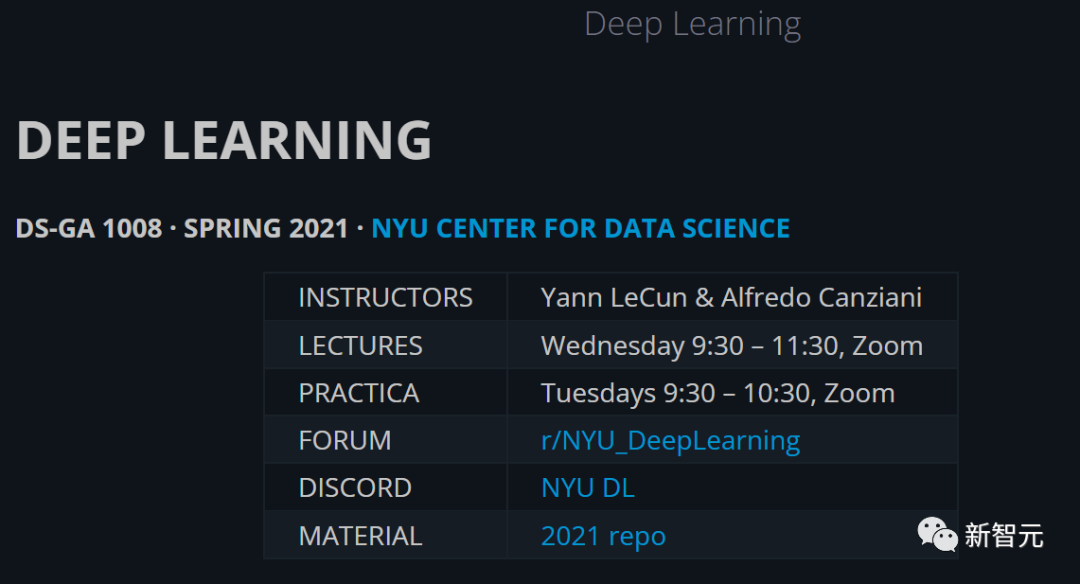

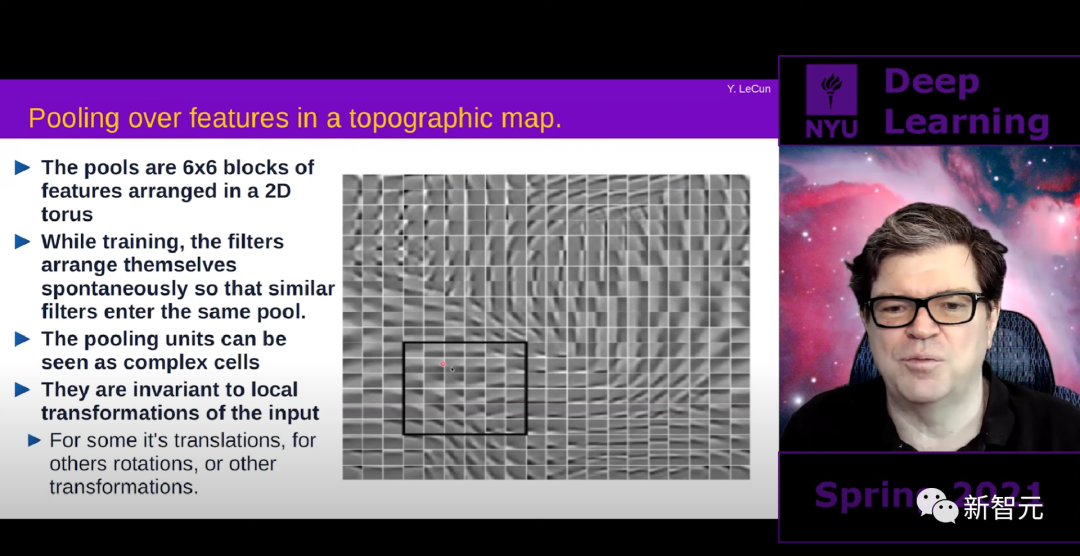

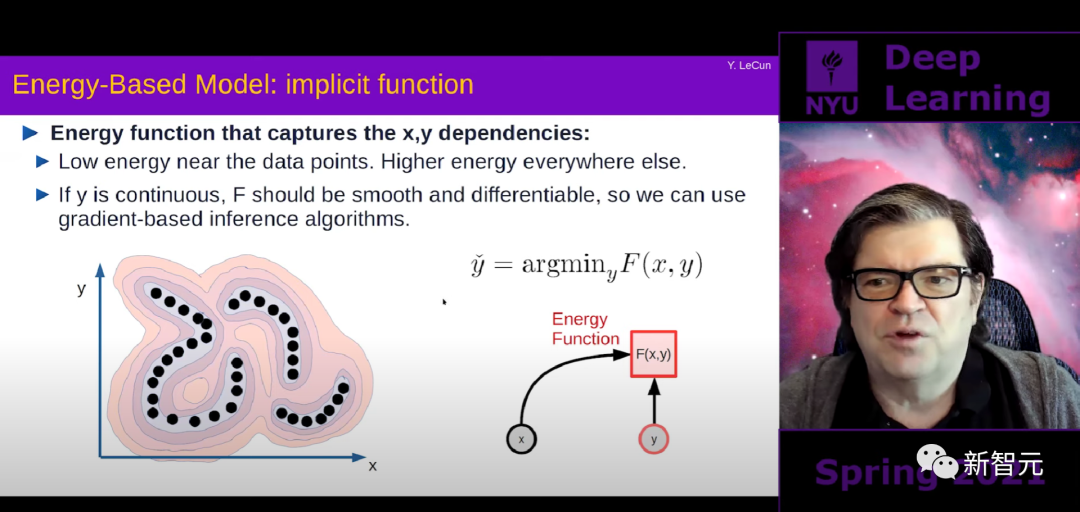

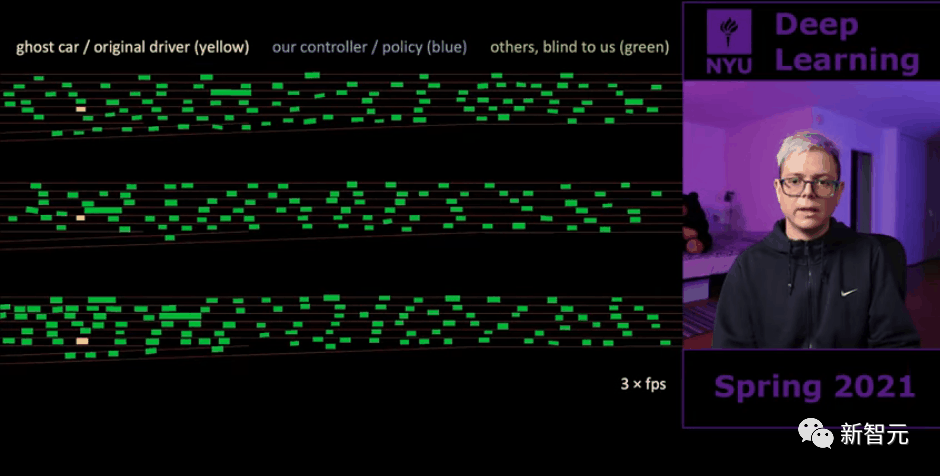

這里推薦圖靈獎得主、紐約大學教授Yann LeCun主講的在線課程。該課程最重要的優(yōu)點是,它集成了LeCun對深度學習的思考。通過這門課,學習者可以了解深度學習的現(xiàn)狀,特別是關于自監(jiān)督學習、挑戰(zhàn)、提議的解決方案和未來計劃。課程地址:https://www.youtube.com/playlist?list=PLLHTzKZzVU9e6xUfG10TkTWApKSZCzuBI可能就是LeCun的教學風格不像吳恩達那樣對學生友好,但過了一段時間,你就會漸漸習慣,而且回報遠遠大于成本。前一段時間開始,我一直在尋找一個好的在線深度學習課程,最終選出的三門課包括:紐約大學深度學習課程 SP21(Yann LeCun主講)斯坦福大學深度學習課程 CS231N(李飛飛主講)當然,這三門課都是無需多言的DL精品課程,主講人都是AI業(yè)界鼎鼎大名的計算機科學家,如果你有時間可以都學,但如果時間有限,就需要做出選擇。一個非常重要的原因就是,NYU的課程講了自監(jiān)督學習。上面這三門課,以及你在網(wǎng)上能找到的其他大部分課程,都包含了很多共同的內容,比如反向傳播、CNN、RNN、GAN、Transformer、分類實例和一些實用技巧等。無論什么課程,你都會聽到這些東西,只是可能教學風格偏好不同。不過在大多數(shù)課程中,一般主要是講是監(jiān)督學習。而紐約大學的課程更專注于自監(jiān)督學習,Yann LeCun認為,自監(jiān)督學習是AI未來的一個基本支柱。本課程有兩位導師,Yann LeCun本人和Alfredo Canziani分別專注于理論和實踐。Yann LeCun無需介紹,Alfredo是紐約大學的計算機科學的助理教授。該課程內容非常廣泛,涵蓋了很多東西,大部分時間的深度也足夠。課程時長大約50個小時,信息點密集。Alfredo為這門課開了個Github頁面,里面有很多資源,包括一些超級有用的jupyter notebook和可運行的代碼,并列出了為期15周的學習計劃。他甚至還對youtube視頻下的評論做了回應。還有來自FAIR實驗室(Facebook人工智能研究實驗室)的客座講師,介紹他們在CV和NLP方面的最新工作。課程的主題之一是處理不確定性的方法。LeCun的觀點是,智能體的一個基本組成部分,是其做出良好預測的能力。這需要一個世界模型,一個能夠接收世界狀態(tài)和行動的模塊,并能預測世界的一些未來狀態(tài)。不過,建立這些模型的一個主要挑戰(zhàn)是,世界是隨機的,包含很多不確定性。一個典型的例子是墜落的鉛筆。如果把一支鉛筆直立在桌子上,讓它掉下來,無法預測它到底會落在哪里。現(xiàn)在我們對世界的狀態(tài)沒有完整的了解,所以無法做一個確定性的決定。在這些情況下,一個輸入有許多貌似合理的輸出。在世界的某個狀態(tài)之下,下一步可能跟著幾個可信的未來狀態(tài)之一。那么,我們怎樣才能在深度學習中處理這個問題呢?這就是基于能量的模型所要解決的問題。處理不確定性。更確切地說,學習在不確定性下做良好的預測。而同樣重要的是,智能體應該能夠主要通過觀察來學習這個世界模型,就像動物所做的那樣,使用無標簽的數(shù)據(jù)。這就是為什么自監(jiān)督學習如此重要的原因。標簽來自于觀察。你預測下一個狀態(tài),等待,下一個狀態(tài)出現(xiàn),你就有了你的標簽。或者你隱藏了一個句子的部分內容,然后試圖預測作為標簽的缺失單詞。根據(jù)LeCun的說法,要處理不確定性,預測世界模型的最佳途徑,是用非反常的正則化方法訓練的聯(lián)合嵌入架構。如果你上了LeCun的這門課,就會理解為什么、怎么訓練。這是2018年的一個項目。在這個項目中,智能體在像素空間中進行預測,這要求對世界的學習表征必須包含很多細節(jié),以便能夠預測一個完整的視頻幀。相反,使用一個在表征空間中預測的世界模型會更好,因為表征空間的維度更低,所以不必學習預測所有不相關的細節(jié)。另一個在課程中沒有提到的,是分層的JEPA模型(聯(lián)合嵌入預測架構),這是LeCun提出的用于創(chuàng)建自主智能體的新建議。

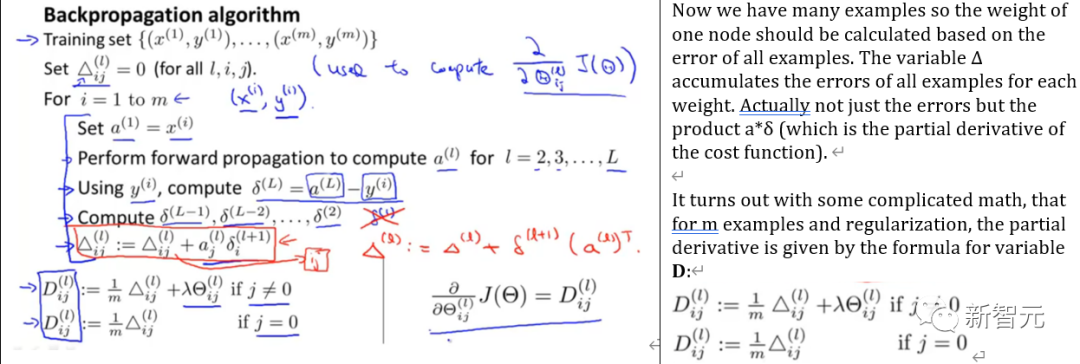

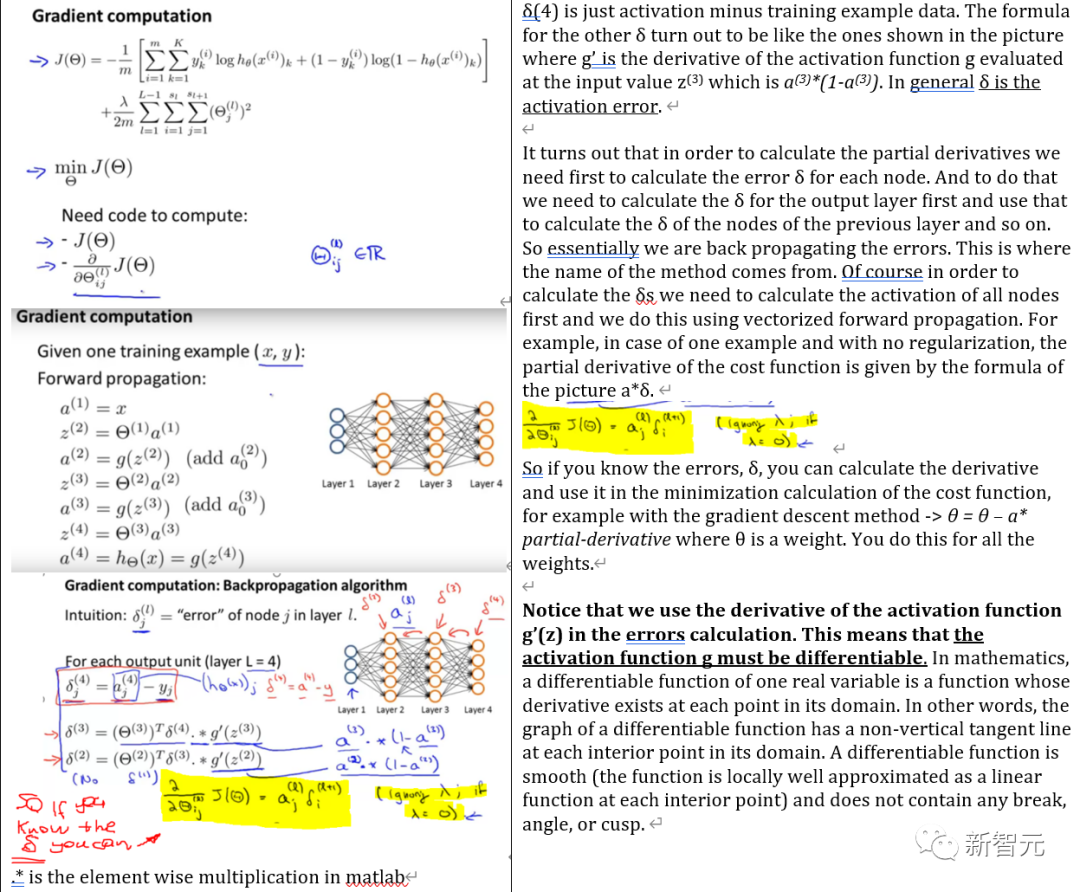

新的智能體在表示空間中進行預測,可以制定分層的行動計劃,面向未來有更長的計劃。但截至目前,這個方法(截至2022年),有很多挑戰(zhàn)。LeCun試圖通過他的基于能量的框架來解釋事情,這可能有點令人困惑,至少在一開始。也有一些部分,他非常抽象地解釋事物,在一個正式的框架內進行定義,你必須耐心地跟上他的思路。在有一些講里,他為深度學習中的一些基本概念提供了數(shù)學證明。你可能喜歡,也可能不喜歡,取決于你對數(shù)學的興趣和能力。50個小時很長,很難一口氣看完。有時不得不暫停,思考,做筆記,很多地方需要再重新看,才覺得足夠舒服。本課程至少要了解機器學習和線性代數(shù)的基礎知識。這方面的優(yōu)秀課程也不少,如吳恩達的機器學習課程和3Blue1Brown的線性代數(shù)課程。麻省理工學院的Gilbert Strang的簡明課程也是對線性代數(shù)的一個很好的高水平概述。另外,如果對反向傳播的工作原理有一些基本的了解,對于也是很有幫助的。3Blue1Brown也有一個關于反向傳播的簡短說明,他以非常直觀的方式解釋了整個過程。最后放上學習筆記。(包含大量的圖片,所以docx文件相當大...),筆記比較長,無法在線查看。筆記里邊有聽課時對授課內容的一些理解和推導。比如:

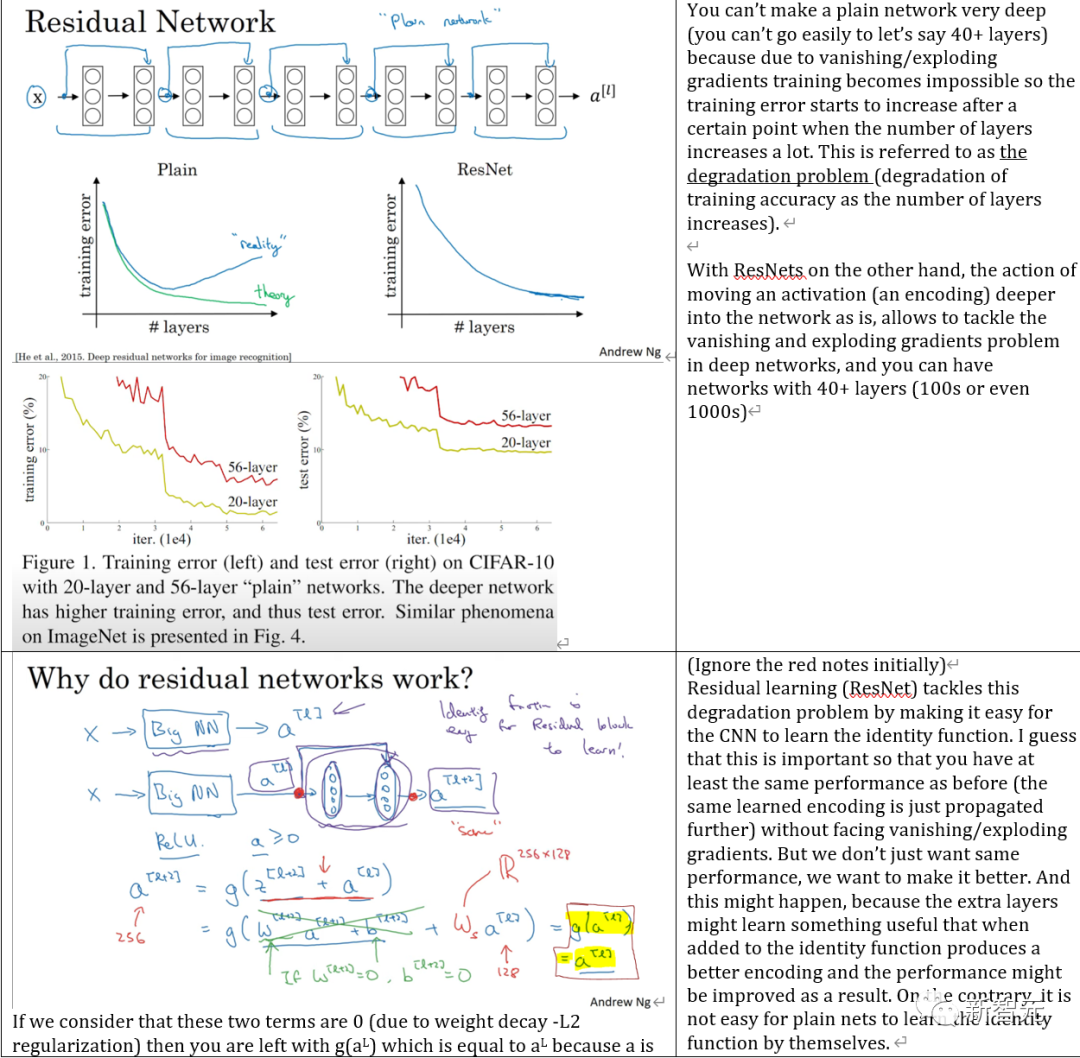

什么是殘差網(wǎng)絡,殘差網(wǎng)絡為什么這么好用:

https://drive.google.com/file/d/1F2MtqLlLFmxYcpXRRd-kSz8Csi2VSgmZ/view

- 機器學習交流qq群955171419,加入微信群請掃碼(讀博請說明)