點擊下方“AI算法與圖像處理”,一起進步!

重磅干貨,第一時間送達

新框架優(yōu)于基于單模型的方法,并且以一小部分計算成本與基于多模型的方法相媲美!

論文:Active Learning for Deep Object Detection via Probabilistic Modeling

鏈接:https://arxiv.org/abs/2103.16130

主動學習旨在通過僅選擇數(shù)據(jù)集上信息量最大的樣本來降低標記成本。現(xiàn)有的工作很少涉及對象檢測的主動學習。這些方法中的大多數(shù)基于多個模型或者是分類方法的直接擴展,因此僅使用分類頭來估計圖像的信息量。

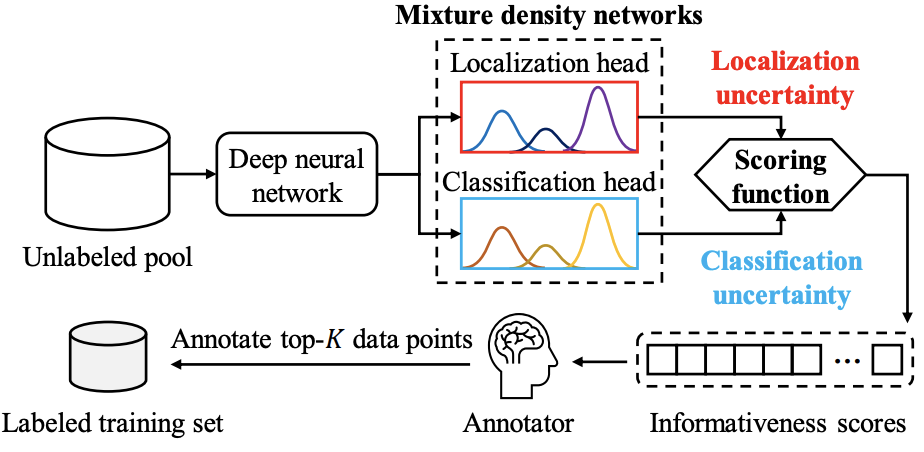

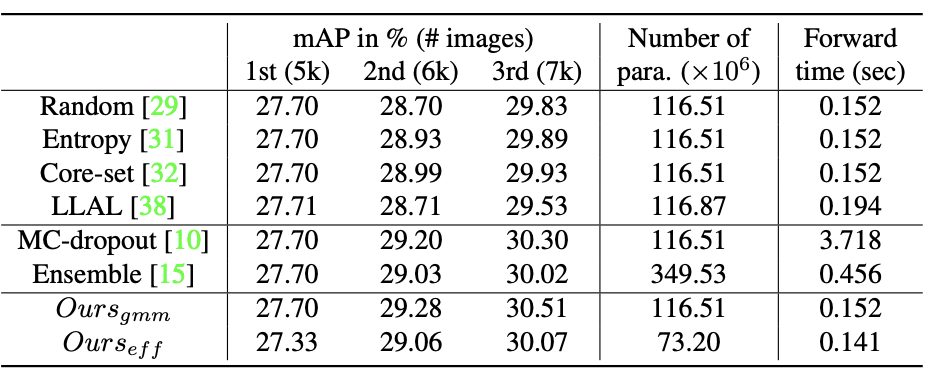

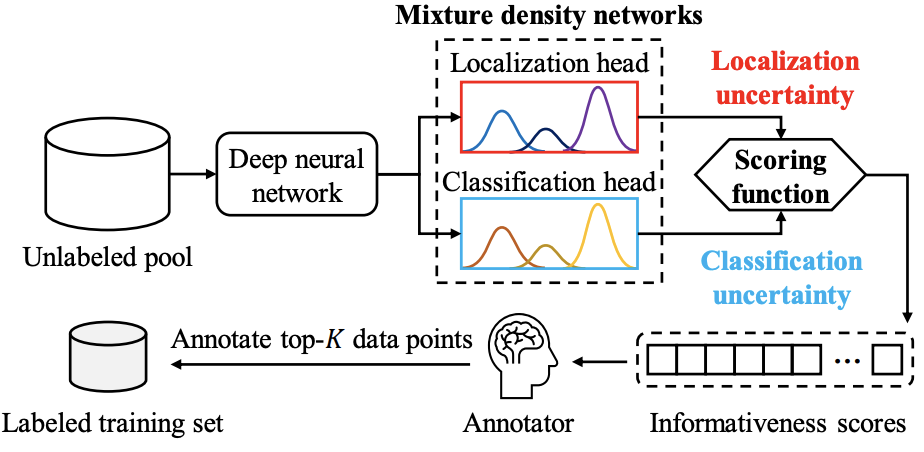

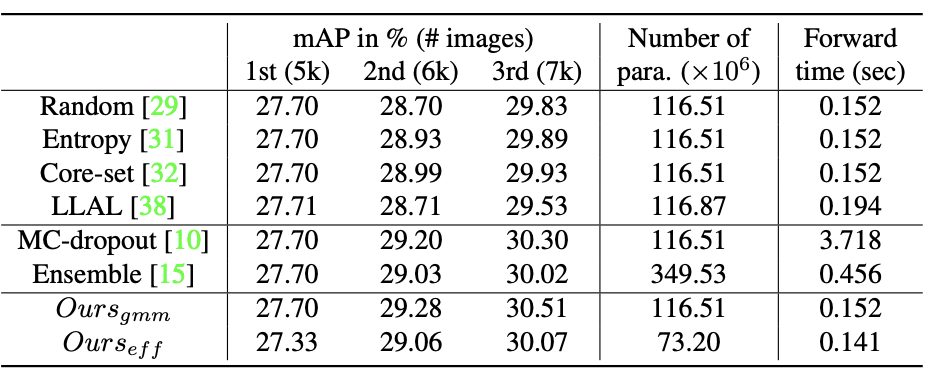

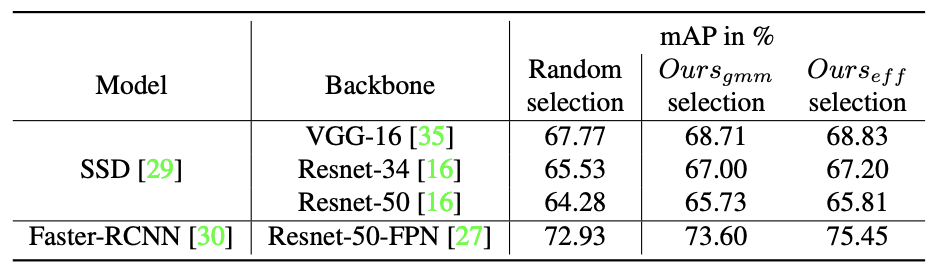

在今天分享中,研究者提出了一種用于目標檢測的新型深度主動學習方法。新提出的方法依賴于混合密度網(wǎng)絡,該網(wǎng)絡估計每個定位和分類頭輸出的概率分布。研究者在單個模型的單個前向傳遞中明確地估計了任意和認知的不確定性。新方法使用一個評分函數(shù)來聚合兩個頭部的這兩種不確定性,以獲得每張圖像的信息量分數(shù)。最后證明了新提出的方法在PASCAL VOC和MSCOCO數(shù)據(jù)集中的有效性。新方法優(yōu)于基于單模型的方法,并且以一小部分計算成本與基于多模型的方法相媲美。

新方法在單個模型的單個前向傳遞中預測定位和分類頭的任意和認知不確定性。提出了一個評分函數(shù),將來自兩個頭部的認知和任意不確定性聚合為單個值。然后,那些具有前K個分數(shù)的數(shù)據(jù)點被發(fā)送以進行標記。

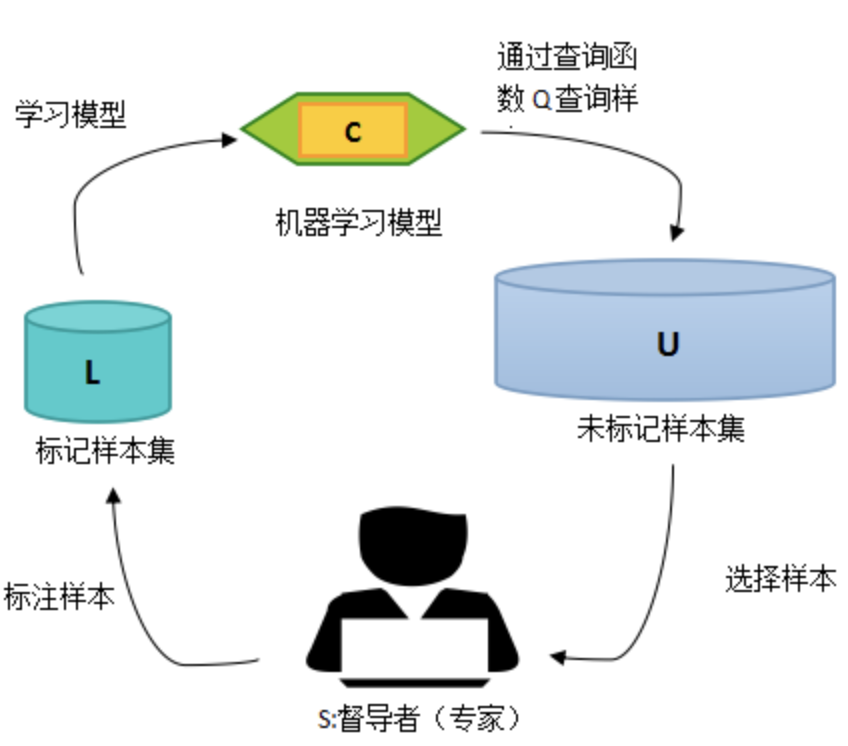

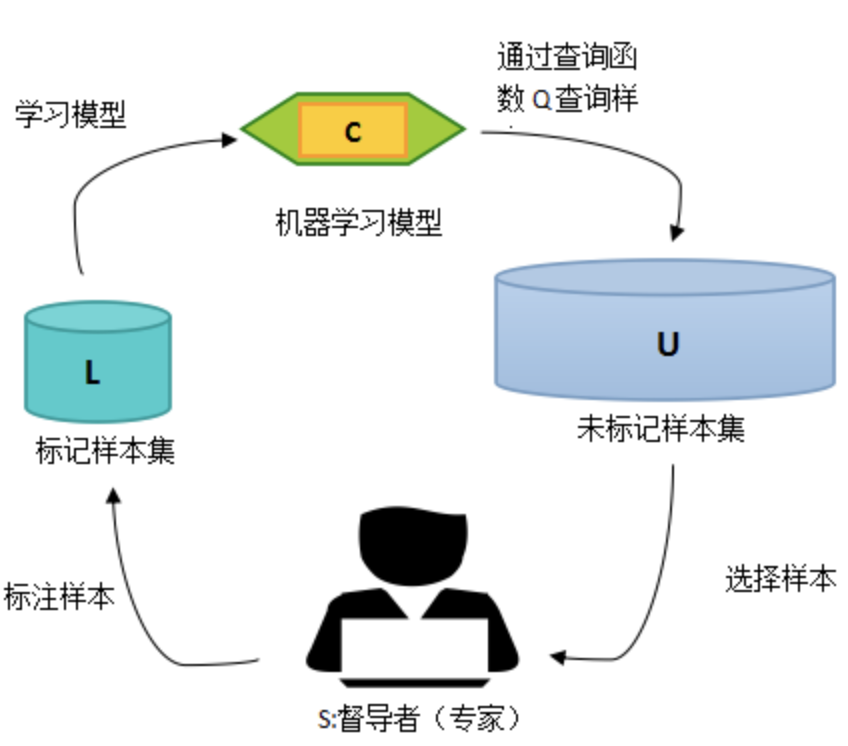

主動的學習(Active learning or query learning)作為機器學習的一個分支其主要是針對數(shù)據(jù)標簽較少或打標簽“代價”較高這一場景而設計的,在統(tǒng)計學中主動學習又被稱為最優(yōu)實驗設計(optimal experimetal design)。其主要方式是模型通過與用戶或專家進行交互,拋出"query"(unlabel data)讓專家確定數(shù)據(jù)的標簽,如此反復,以期讓模型利用較少的標記數(shù)據(jù)獲得較好“性能”。一般情況下,模型拋出的未標注數(shù)據(jù)為“hard sample”(對于“hard sample”的不同定義可以衍生出一大堆的方法,如可以是ambiguous sample,即模型最難區(qū)分的樣本;可以是對模型提升(改變)最大的樣本,如梯度提升最大;可以是方差減小等等),相比與有監(jiān)督學習,主動學習通過讓模型更多的關注或學習“hard sample”,以期在較少的訓練樣本下獲得較好的模型。如下所示:

可以看出active learning與passive learning最大的不同是passive learning或supervised learning其首先就需要大量的專家標注樣本訓練模型,而active learning則是利用少量標注樣本,大量未標注樣本訓練模型,然后由learner選擇樣本返回給Oracle打標簽,進而不斷迭代以獲得較好的模型,該過程必須要有專家的參與,這也是active learning區(qū)別于semi-supervised learning的不同之處。用于目標檢測的深度主動學習最近引起了人們的興趣。 [Scalable active learning for object detection]的工作訓練神經(jīng)網(wǎng)絡的集合,然后選擇由某個獲取函數(shù)定義的具有最高分數(shù)的樣本,即熵或互信息。并發(fā)工作探索了類似的方向,但通過 MC-dropout來近似不確定性。[Active learning for deep detection neural networks]的工作提出了一種計算像素分數(shù)并使用它們來選擇信息樣本的方法。另一種方法[Deep active learning for object detection]提出了通過committee paradigm的查詢來選擇要查詢的圖像集。[Active learning for convolutional neural networks: A core-set approach]的工作使用特征空間來選擇數(shù)據(jù)集中的代表性樣本,在目標檢測中達到了良好的性能。[Localization-aware active learning for object detection]給出了不同的解決方案,其中作者定義了兩個不同的分數(shù):定位緊密度,即區(qū)域候選和最終預測之間的重疊比;當輸入圖像被噪聲破壞時,基于預測目標位置的變化的定位穩(wěn)定性。在所有情況下,選擇得分最高的圖像進行標記。[Learning loss for active learning]的最先進方法提供了一種啟發(fā)式但優(yōu)雅的解決方案,同時優(yōu)于其他基于單一模型的方法。在訓練期間,該方法學習預測每個樣本的目標損失。在主動學習階段,它選擇標記具有最高預測損失的樣本。

上述大多數(shù)方法需要多個模型或多個前向傳遞來計算圖像的信息量分數(shù),導致計算成本很高。此外,所有這些研究,盡管專注于目標檢測的主動學習,要么依賴啟發(fā)式方法來估計定位不確定性,要么根本無法估計。因此 ,雖然給出了有希望的方向,但它們在準確性和計算成本方面并不令人滿意。與這些方法相比,今天分享的方法估計并利用定位和分類的不確定性來達到高精度,同時使用單個模型的單次前向傳遞,顯著降低了計算成本。

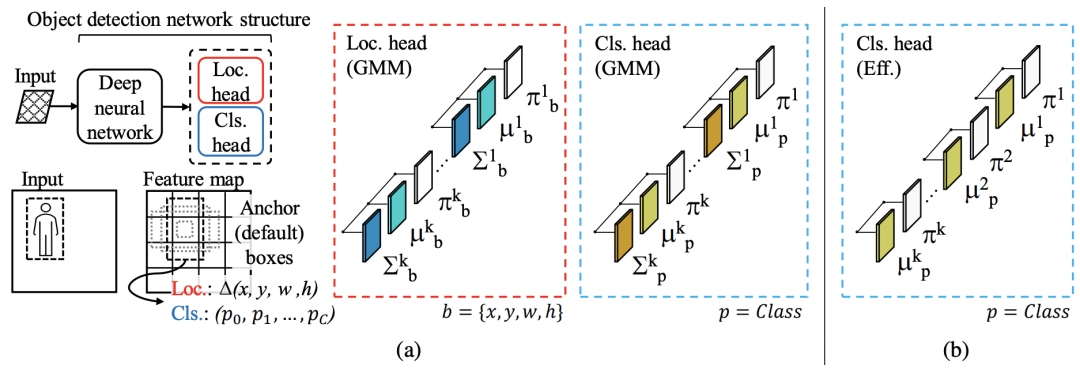

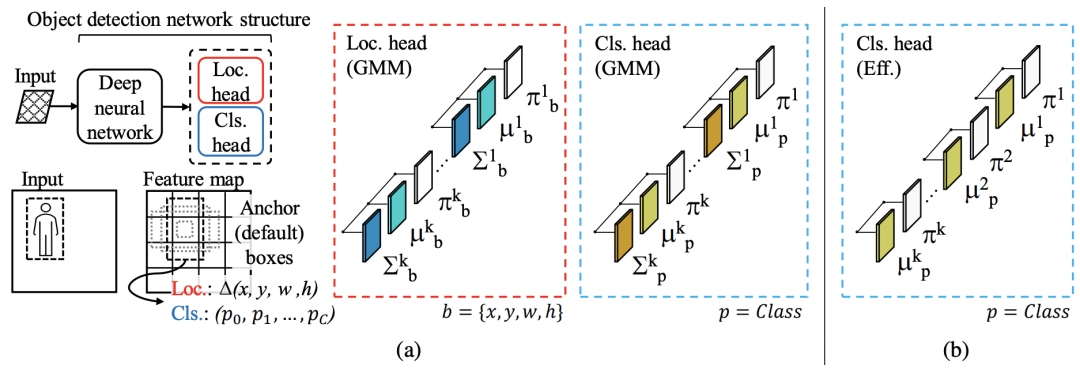

新提出的方法的關鍵新穎之處在于設計神經(jīng)網(wǎng)絡的輸出層來預測概率分布,而不是預測網(wǎng)絡的每個輸出的單個值(見上圖a)。為此,建議使用混合密度網(wǎng)絡,其中網(wǎng)絡的輸出由GMM的參數(shù)組成。為了預測輸出值的概率分布,新方法涉及修改網(wǎng)絡的最后一層,因此導致參數(shù)數(shù)量增加,尤其是在分類頭中。研究者專注于通過減少分類頭中的參數(shù)數(shù)量來提高算法的效率,如上圖b。

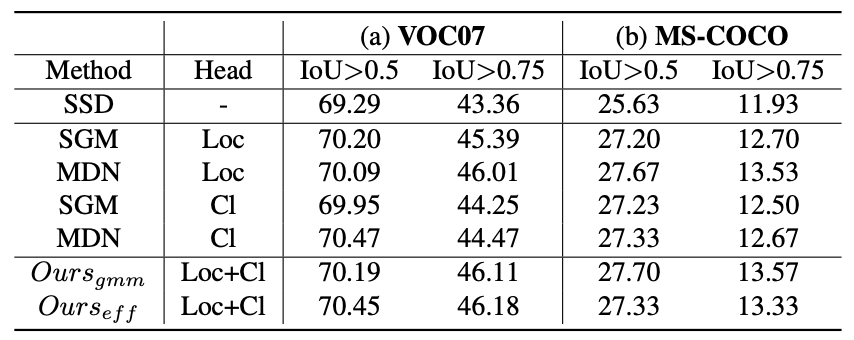

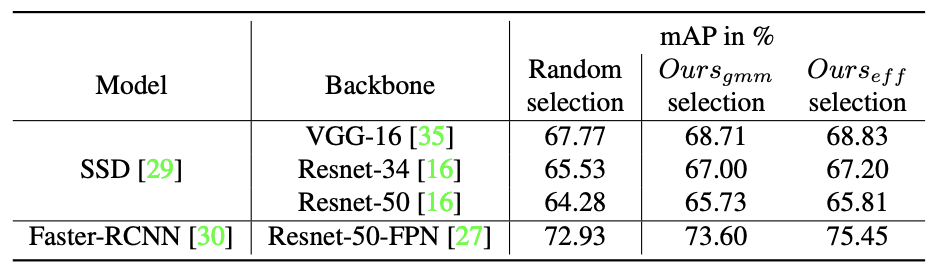

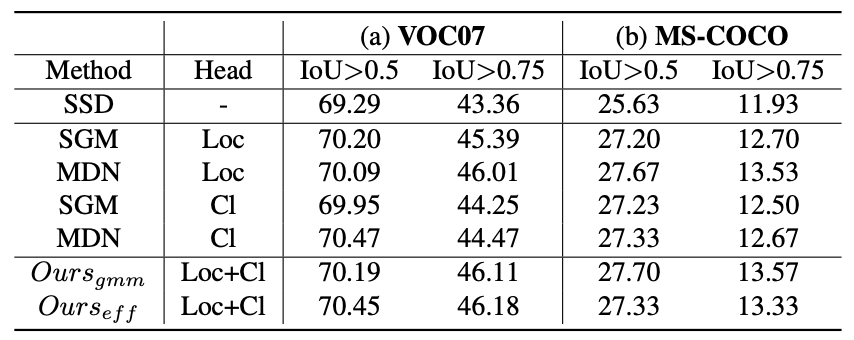

與原始SSD網(wǎng)絡相比,新方法的不同實例的mAP(以%為單位)。SGM和MDN是指單個和多個高斯模型,將它們應用于定位(Loc)、分類(Cl)及其組合(Loc+Cl)。

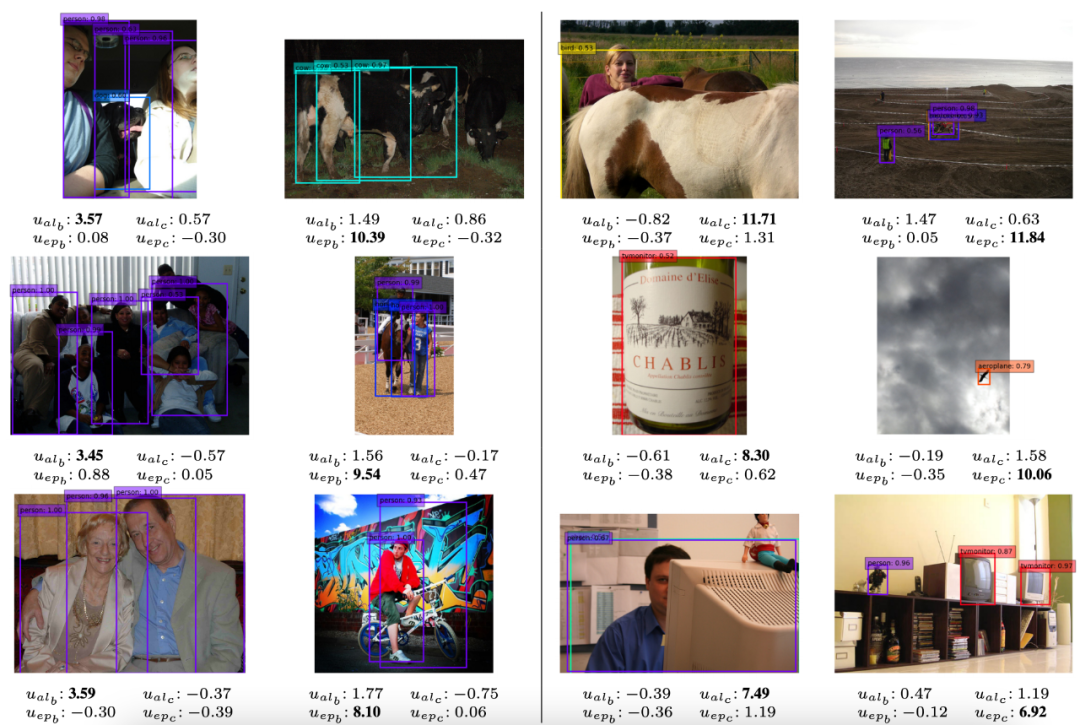

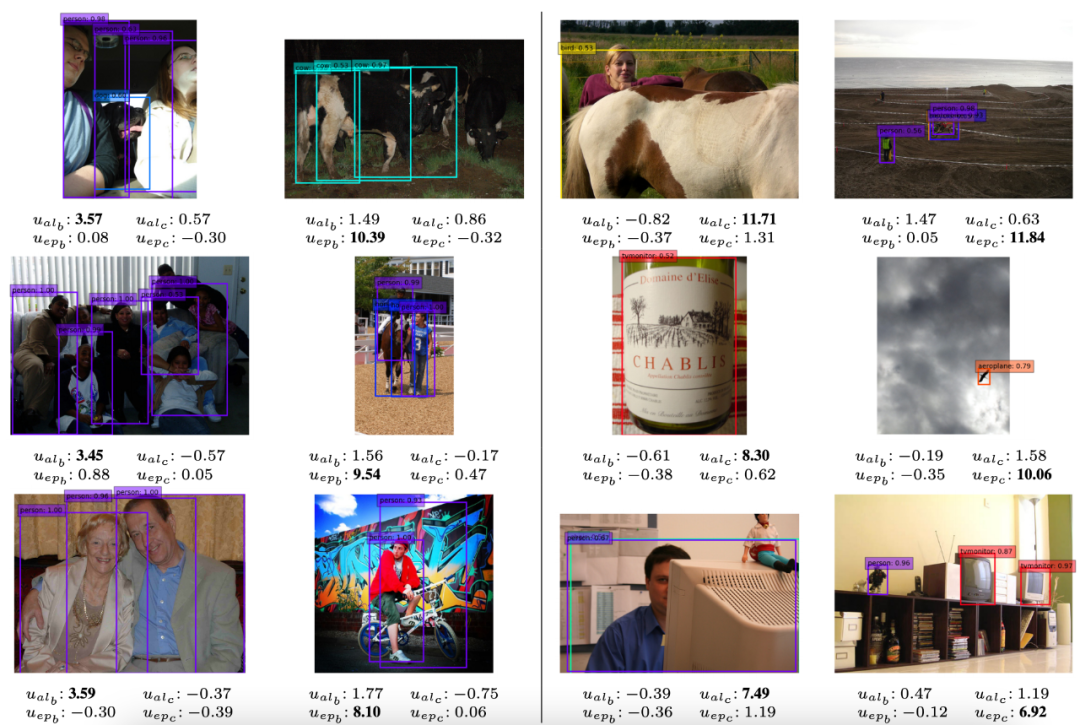

不準確檢測和認知不確定性示例。從左上角開始,順時針方向:Person是誤報;人物邊界框不正確;一只羊被錯誤地歸類為一只鳥;一只羊被錯誤地歸類為一頭牛。

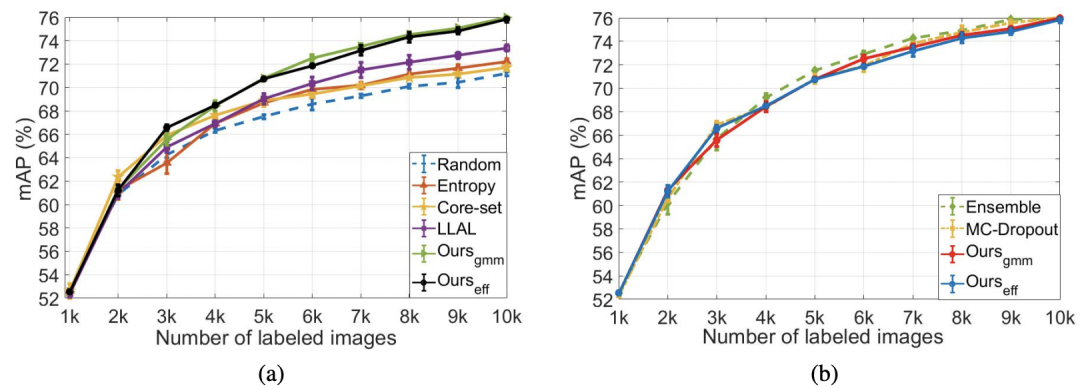

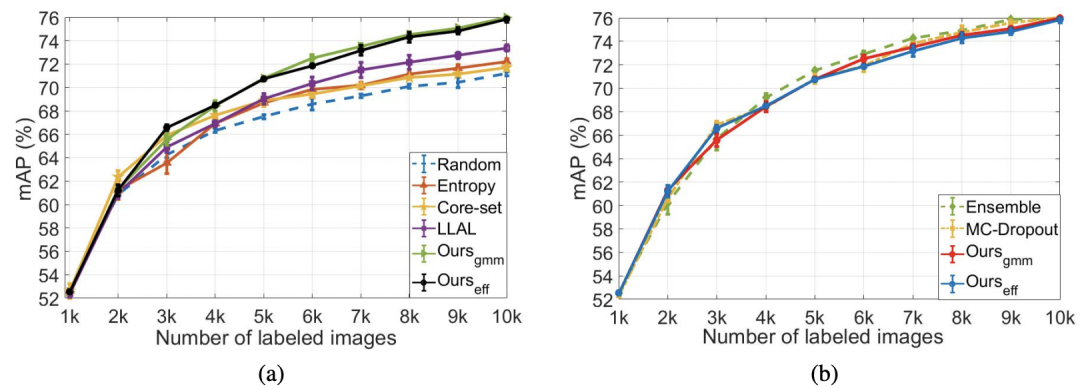

a) 與使用單一評分模型的已發(fā)表作品進行比較;b) 與多種基于模型的方法、集成和MC-dropout的比較。

努力分享優(yōu)質的計算機視覺相關內容,歡迎關注:交流群

歡迎加入公眾號讀者群一起和同行交流,目前有美顏、三維視覺、計算攝影、檢測、分割、識別、醫(yī)學影像、GAN、算法競賽等微信群

請注明:地區(qū)+學校/企業(yè)+研究方向+昵稱

下載1:何愷明頂會分享

在「AI算法與圖像處理」公眾號后臺回復:何愷明,即可下載。總共有6份PDF,涉及 ResNet、Mask RCNN等經(jīng)典工作的總結分析

下載2:終身受益的編程指南:Google編程風格指南

在「AI算法與圖像處理」公眾號后臺回復:c++,即可下載。歷經(jīng)十年考驗,最權威的編程規(guī)范!

在「AI算法與圖像處理」公眾號后臺回復:CVPR,即可下載1467篇CVPR?2020論文 和 CVPR 2021 最新論文