【機器學習基礎】Python數(shù)據(jù)預處理:徹底理解標準化和歸一化

數(shù)據(jù)預處理

數(shù)據(jù)中不同特征的量綱可能不一致,數(shù)值間的差別可能很大,不進行處理可能會影響到數(shù)據(jù)分析的結果,因此,需要對數(shù)據(jù)按照一定比例進行縮放,使之落在一個特定的區(qū)域,便于進行綜合分析。

常用的方法有兩種:

最大 - 最小規(guī)范化:對原始數(shù)據(jù)進行線性變換,將數(shù)據(jù)映射到[0,1]區(qū)間

Z-Score標準化:將原始數(shù)據(jù)映射到均值為0、標準差為1的分布上

為什么要標準化/歸一化?

提升模型精度:標準化/歸一化后,不同維度之間的特征在數(shù)值上有一定比較性,可以大大提高分類器的準確性。

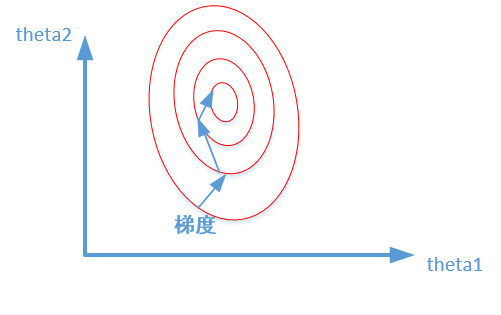

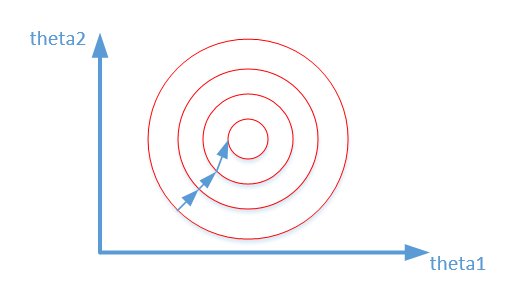

加速模型收斂:標準化/歸一化后,最優(yōu)解的尋優(yōu)過程明顯會變得平緩,更容易正確的收斂到最優(yōu)解。

如下圖所示:

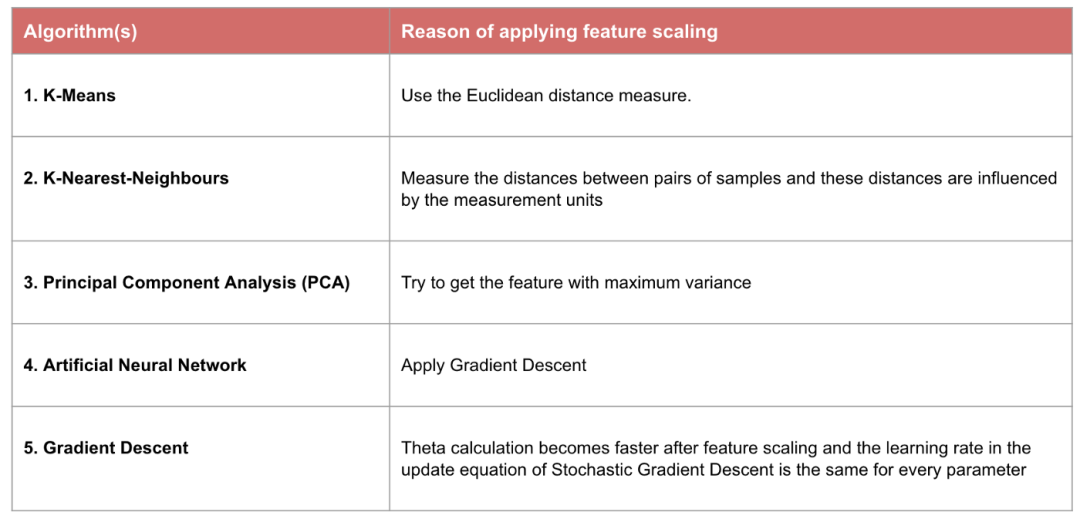

哪些機器學習算法需要標準化和歸一化

1)需要使用梯度下降和計算距離的模型要做歸一化,因為不做歸一化會使收斂的路徑程z字型下降,導致收斂路徑太慢,而且不容易找到最優(yōu)解,歸一化之后加快了梯度下降求最優(yōu)解的速度,并有可能提高精度。比如說線性回歸、邏輯回歸、adaboost、xgboost、GBDT、SVM、NeuralNetwork等。需要計算距離的模型需要做歸一化,比如說KNN、KMeans等。

2)概率模型、樹形結構模型不需要歸一化,因為它們不關心變量的值,而是關心變量的分布和變量之間的條件概率,如決策樹、隨機森林。

徹底理解標準化和歸一化

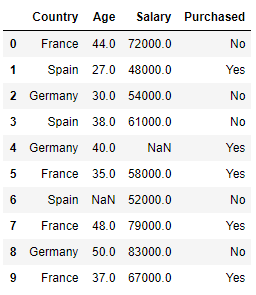

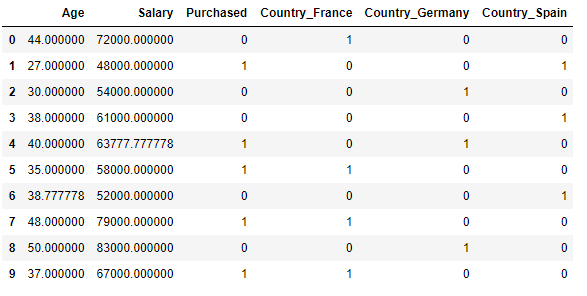

示例數(shù)據(jù)集包含一個自變量(已購買)和三個因變量(國家,年齡和薪水),可以看出用薪水范圍比年齡寬的多,如果直接將數(shù)據(jù)用于機器學習模型(比如KNN、KMeans),模型將完全有薪水主導。

示例數(shù)據(jù)集包含一個自變量(已購買)和三個因變量(國家,年齡和薪水),可以看出用薪水范圍比年齡寬的多,如果直接將數(shù)據(jù)用于機器學習模型(比如KNN、KMeans),模型將完全有薪水主導。

#導入數(shù)據(jù)

import?numpy?as?np

import?matplotlib.pyplot?as?plt

import?pandas?as?pd

df?=?pd.read_csv('Data.csv')

缺失值均值填充,處理字符型變量

df['Salary'].fillna((df['Salary'].mean()),?inplace=?True)

df['Age'].fillna((df['Age'].mean()),?inplace=?True)

df['Purchased']?=?df['Purchased'].apply(lambda?x:?0?if?x=='No'?else?1)

df=pd.get_dummies(data=df,?columns=['Country'])

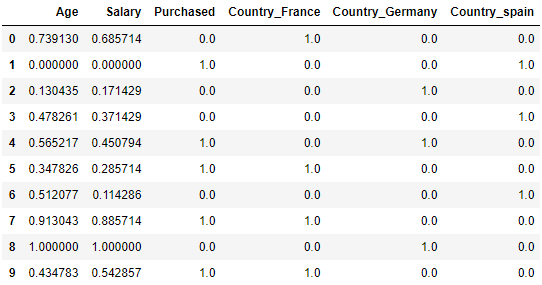

最大 - 最小規(guī)范化

最大 - 最小規(guī)范化

from?sklearn.preprocessing?import?MinMaxScaler

scaler?=?MinMaxScaler()

scaler.fit(df)

scaled_features?=?scaler.transform(df)

df_MinMax?=?pd.DataFrame(data=scaled_features,?columns=["Age",?"Salary","Purchased","Country_France","Country_Germany",?"Country_spain"])

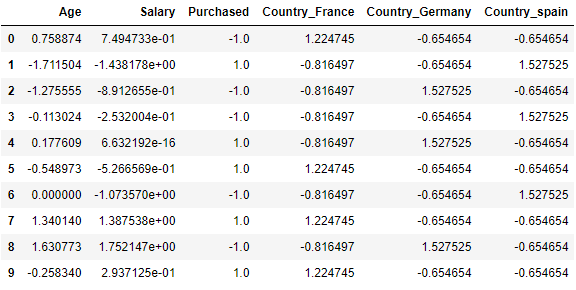

Z-Score標準化

from?sklearn.preprocessing?import?StandardScaler

sc_X?=?StandardScaler()

sc_X?=?sc_X.fit_transform(df)

sc_X?=?pd.DataFrame(data=sc_X,?columns=["Age",?"Salary","Purchased","Country_France","Country_Germany",?"Country_spain"])

import?seaborn?as?sns

import?matplotlib.pyplot?as?plt

import?statistics

plt.rcParams['font.sans-serif']?=?['Microsoft?YaHei']

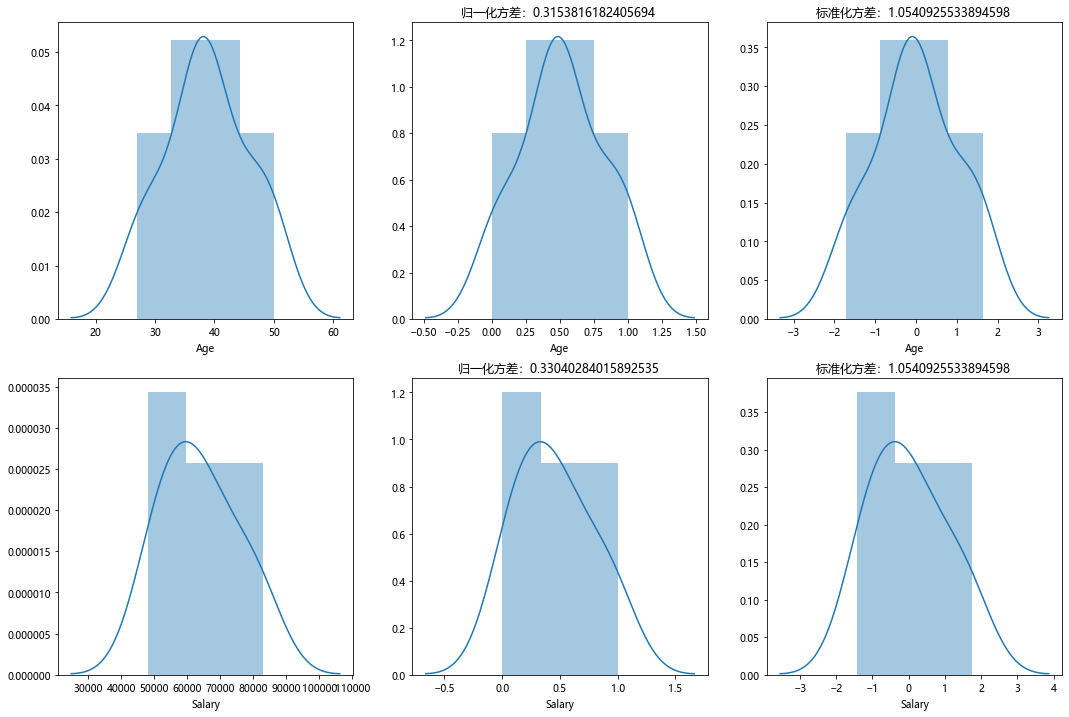

fig,axes=plt.subplots(2,3,figsize=(18,12))?

sns.distplot(df['Age'],?ax=axes[0,?0])

sns.distplot(df_MinMax['Age'],?ax=axes[0,?1])

axes[0,?1].set_title('歸一化方差:% s '%?(statistics.stdev(df_MinMax['Age'])))

sns.distplot(sc_X['Age'],?ax=axes[0,?2])

axes[0,?2].set_title('標準化方差:% s '%?(statistics.stdev(sc_X['Age'])))

sns.distplot(df['Salary'],?ax=axes[1,?0])

sns.distplot(df_MinMax['Salary'],?ax=axes[1,?1])

axes[1,?1].set_title('MinMax:Salary')

axes[1,?1].set_title('歸一化方差:% s '%?(statistics.stdev(df_MinMax['Salary'])))

sns.distplot(sc_X['Salary'],?ax=axes[1,?2])

axes[1,?2].set_title('StandardScaler:Salary')

axes[1,?2].set_title('標準化方差:% s '%?(statistics.stdev(sc_X['Salary'])))

可以看出歸一化比標準化方法產生的標準差小,使用歸一化來縮放數(shù)據(jù),則數(shù)據(jù)將更集中在均值附近。這是由于歸一化的縮放是“拍扁”統(tǒng)一到區(qū)間(僅由極值決定),而標準化的縮放是更加“彈性”和“動態(tài)”的,和整體樣本的分布有很大的關系。所以歸一化不能很好地處理離群值,而標準化對異常值的魯棒性強,在許多情況下,它優(yōu)于歸一化。

參考:https://towardsdatascience.com/data-transformation-standardisation-vs-normalisation-a47b2f38cec2

往期精彩回顧

獲取一折本站知識星球優(yōu)惠券,復制鏈接直接打開:

https://t.zsxq.com/yFQV7am

本站qq群1003271085。

加入微信群請掃碼進群: