DeepMind最新發(fā)現(xiàn)!神經(jīng)網(wǎng)絡(luò)的性能竟然優(yōu)于神經(jīng)符號模型

??新智元報道??

??新智元報道??

編輯:keyu

【新智元導(dǎo)讀】DeepMind最新的研究結(jié)果再一次打破了傳統(tǒng)認(rèn)知——根據(jù)研究人員的最新發(fā)現(xiàn),神經(jīng)網(wǎng)絡(luò)對數(shù)據(jù)的要求,居然比神經(jīng)符號模型還要低!不僅如此,實(shí)驗(yàn)結(jié)果證實(shí),神經(jīng)網(wǎng)絡(luò)的在關(guān)鍵任務(wù)上的效果還要更好。不需要預(yù)先訓(xùn)練,完全無監(jiān)督,居然這么神奇?

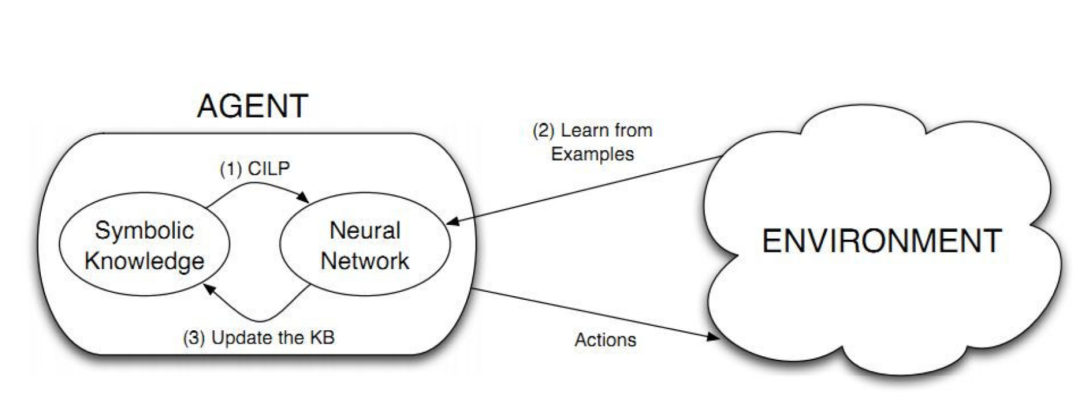

按照之前的常識,結(jié)合了算法和符號推理技術(shù)的神經(jīng)符號模型(Neurosymbolic Models),會比神經(jīng)網(wǎng)絡(luò)更適合于預(yù)測和解釋任務(wù),此外,神經(jīng)符號模型在反事實(shí)方面表現(xiàn)更好。

?

而Neural-Symbolic,本質(zhì)上其實(shí)是將現(xiàn)代數(shù)學(xué)中的分析學(xué)和代數(shù)學(xué)結(jié)合的產(chǎn)物。

?

分析學(xué)擅長處理數(shù)值、函數(shù)、逼近等問題, 代數(shù)學(xué)擅長處理推演、抽象、結(jié)構(gòu)等問題,如果能適當(dāng)將兩者結(jié)合,會有很可觀的效果。

然而,近日,DeepMind的研究人員聲稱,在正確的測試條件下,神經(jīng)網(wǎng)絡(luò)的性能會優(yōu)于神經(jīng)符號模型。

?

與之前的研究結(jié)論相反,研究人員認(rèn)為,對于可以衡量高級認(rèn)知功能并基于視覺的任務(wù)來說,基于分布式表示的神經(jīng)網(wǎng)絡(luò)模型確實(shí)表現(xiàn)良好,并已經(jīng)明顯勝過了現(xiàn)有的神經(jīng)符號模型。

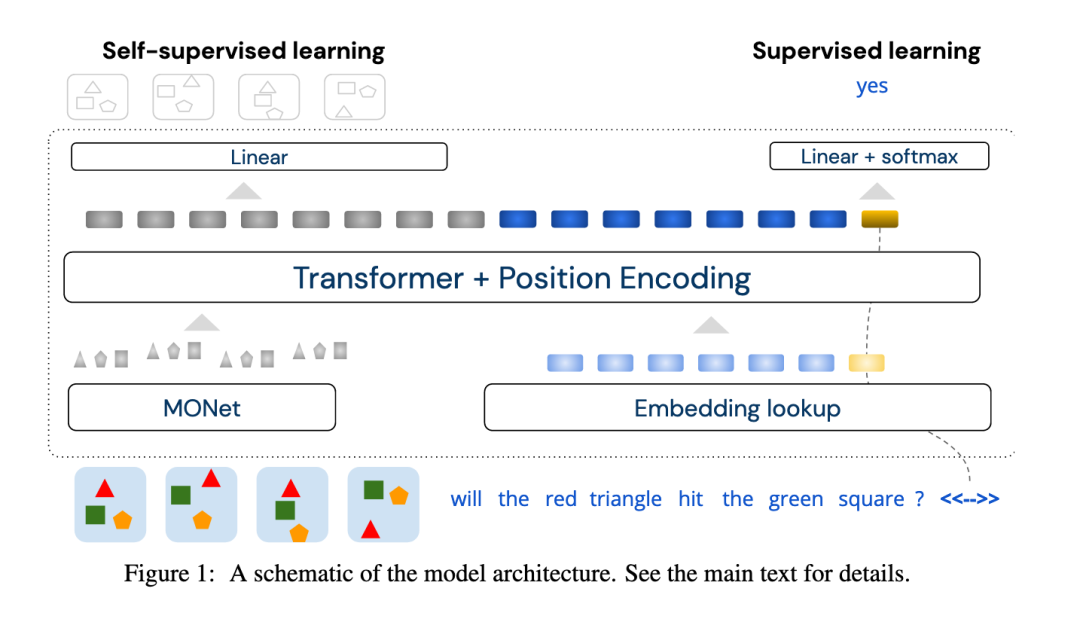

在論文中,作者描述了一種關(guān)于視頻的時空推理的體系結(jié)構(gòu),此結(jié)構(gòu)可以學(xué)習(xí)到視頻中的所有成分,并且所有中間的表示都貫穿分布在整個神經(jīng)網(wǎng)絡(luò)層中。

?

論文地址:https://arxiv.org/pdf/2012.08508.pdf

?

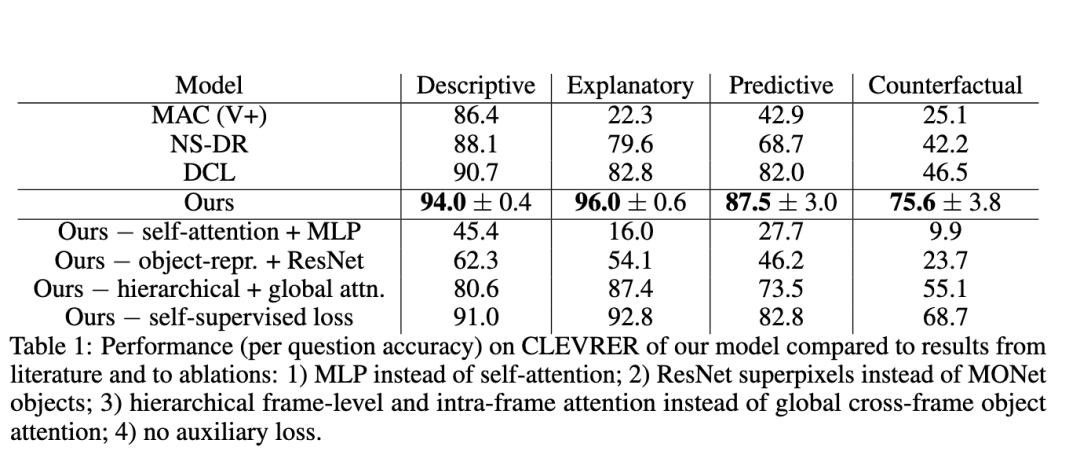

該團(tuán)隊表示,該體系結(jié)構(gòu)在一個流行的數(shù)據(jù)集上的所有任務(wù)的表現(xiàn),都超過了神經(jīng)符號模型,并在反事實(shí)問題上優(yōu)勢最明顯。

這一研究成果,可能會非常有助于設(shè)計和開發(fā)具有推斷作用的機(jī)器。

?

該文章提出的神經(jīng)網(wǎng)絡(luò)架構(gòu),主要利用注意力機(jī)制,來實(shí)現(xiàn)對集成信息的高效提取。

有人可能要問了,什么是注意力機(jī)制呢?

?

注意力(attention)其實(shí)是一個非常常見,但是又會被忽略的事實(shí)。比如天空一只鳥飛過去的時候,往往你的注意力會追隨著鳥兒,天空在你的視覺系統(tǒng)中,自然成為了一個背景(background)信息。

?

計算機(jī)視覺中的注意力機(jī)制(attention)的基本思想,就是想讓系統(tǒng)學(xué)會注意力——能夠忽略無關(guān)信息而關(guān)注重點(diǎn)信息。

?

總的來說,注意力機(jī)制就是一種一次只專注于一個元素或幾個元素的算法機(jī)制。

?

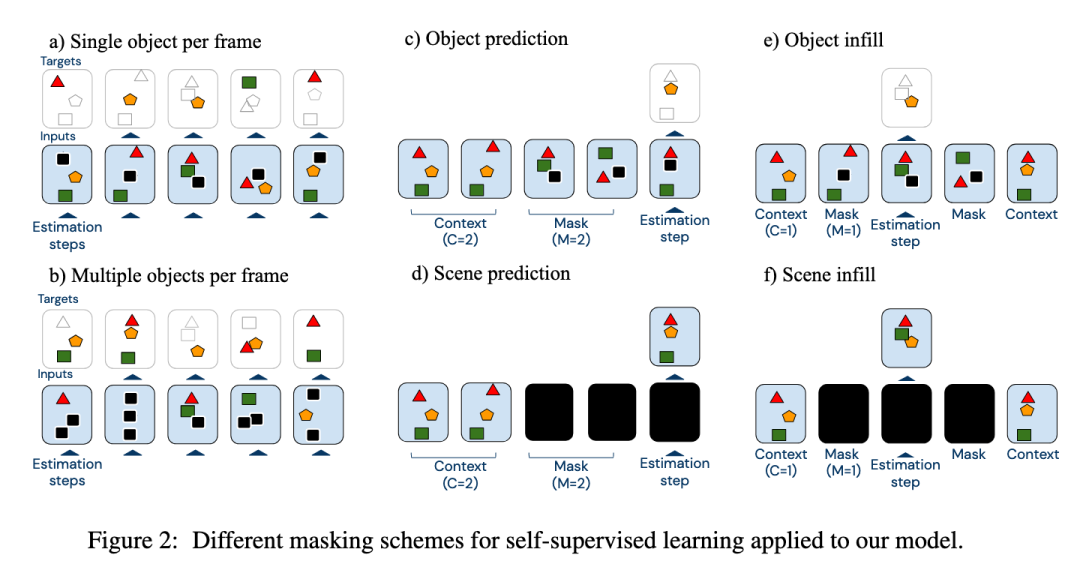

對于DeepMind這一研究來說,整個訓(xùn)練過程都是自我監(jiān)督的,這意味著該模型必須使用底層的動態(tài)機(jī)制,來推斷視頻中被掩蓋的對象,以便提取更多信息。?

?

而且該架構(gòu)可以確保視頻中的視覺元素與物理對象相對應(yīng),論文作者認(rèn)為,這一步驟對于更高層次的推理至關(guān)重要。

?

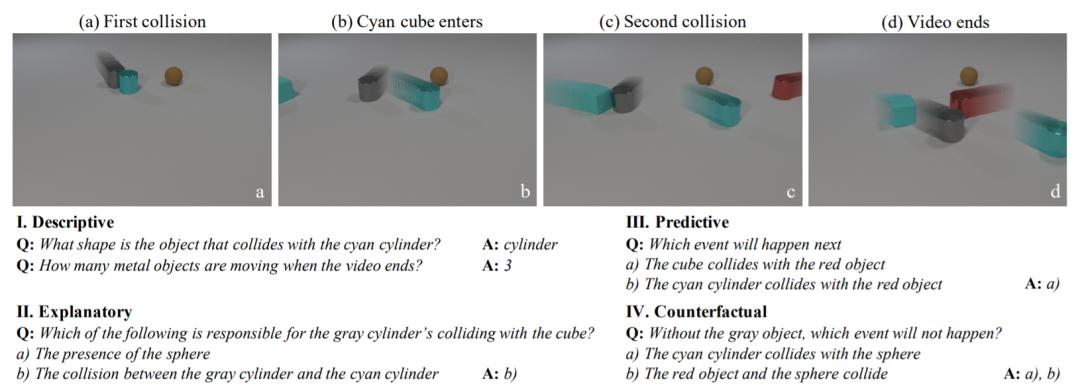

在實(shí)驗(yàn)部分,研究人員將他們的神經(jīng)網(wǎng)絡(luò)與視頻表示和推理的CoLlision事件(也就是CLEVRER數(shù)據(jù)集)進(jìn)行了基準(zhǔn)比較。

?

其中,CLEVRER數(shù)據(jù)集包含由機(jī)器生成的20,000多個5秒鐘的物體碰撞視頻(這幾種物體是三種形狀,擁有八種顏色的兩種材料),以及300,000多個問題和答案。

這些問答都聚焦于邏輯推理的四個要素:描述性(例如,“什么顏色” ),說明性(“造成的原因”),預(yù)測性(“接下來會發(fā)生什么”)和反事實(shí)(“如果某種情況出現(xiàn),會發(fā)生什么”)。

在這里小編附上CLEVRER資源鏈接:

?

論文鏈接:https://arxiv.org/abs/1910.01442

項目鏈接:http://clevrer.csail.mit.edu/

?

實(shí)驗(yàn)結(jié)果表明,在沒有預(yù)先訓(xùn)練,沒有標(biāo)記數(shù)據(jù),且訓(xùn)練數(shù)據(jù)少40%的情況下,他們的神經(jīng)網(wǎng)絡(luò)和最佳神經(jīng)符號模型性能相當(dāng),這無疑挑戰(zhàn)了神經(jīng)網(wǎng)絡(luò)比神經(jīng)符號模型更需要數(shù)據(jù)這一觀點(diǎn)。

此外,它在最困難的反事實(shí)問題上的得分為59.8%(這一得分比機(jī)會模型和所有其他模型都好)。

?

同時,此模型還可以可以推廣到其他任務(wù),包括CATER(旨在預(yù)測目標(biāo)對象在視頻最后一幀中的位置的對象跟蹤視頻數(shù)據(jù)集)。

研究人員在論文中寫道:“我們的研究結(jié)果證明了在得益于分布式表示的靈活性和表現(xiàn)力的同時,深層網(wǎng)絡(luò)可以復(fù)制人類認(rèn)知和推理的許多特性。”?

?

“神經(jīng)模型在數(shù)學(xué)上也取得了一些成功,從直覺上講,該領(lǐng)域需要執(zhí)行嚴(yán)格的規(guī)則,需要操縱各種各樣的復(fù)雜符號。但是,令人驚訝的是,大型神經(jīng)語言模型其實(shí)并不需要需進(jìn)行目標(biāo)任務(wù)的明確訓(xùn)練,也可獲得算術(shù)推理和類推的能力。

?

這表明,在擴(kuò)展到更多數(shù)據(jù),并使用更大,更高效的體系結(jié)構(gòu)時,當(dāng)前的神經(jīng)網(wǎng)絡(luò)局限性得到了改善。”

?

?

參考鏈接:

https://blog.csdn.net/hanss2/article/details/90345517

https://venturebeat.com/2020/12/21/deepmind-researchers-claim-neural-networks-can-outperform-neurosymbolic-models-on-visual-tasks/

推薦閱讀:

「2020中國AI算力報告」重磅出爐:中國怎么解決GPT-3的算力難題?