基于手機(jī)系統(tǒng)的實(shí)時(shí)目標(biāo)檢測

點(diǎn)擊下方“AI算法與圖像處理”,一起進(jìn)步!

重磅干貨,第一時(shí)間送達(dá)

在具有有限計(jì)算能力和存儲(chǔ)器資源的移動(dòng)設(shè)備上運(yùn)行卷積神經(jīng)網(wǎng)絡(luò)(CNN)模型的日益增長的需求促進(jìn)了對(duì)有效模型設(shè)計(jì)的研究

關(guān)注并星標(biāo)

從此不迷路

1

前言

在具有有限計(jì)算能力和存儲(chǔ)器資源的移動(dòng)設(shè)備上運(yùn)行卷積神經(jīng)網(wǎng)絡(luò)(CNN)模型的日益增長的需求促進(jìn)了對(duì)有效模型設(shè)計(jì)的研究。近年來已經(jīng)提出了許多有效的架構(gòu),例如:MobileNet,ShuffleNet和NASNet-A。

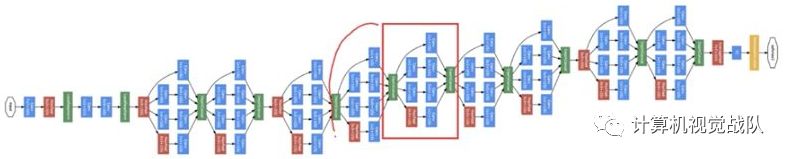

然而,所有這些模型都嚴(yán)重依賴于深度可分的卷積,這在大多數(shù)深度學(xué)習(xí)框架中缺乏有效的實(shí)現(xiàn)。在這項(xiàng)研究中,提出了一個(gè)“PeleeNet”的高效架構(gòu),采用傳統(tǒng)的卷積方式架構(gòu)。在ImageNet ILSVRC 2012數(shù)據(jù)集上,提出的PeleeNet比最先進(jìn)的高效架構(gòu)MobileNet的精度提高了0.6%(71.3%對(duì)70.7%),計(jì)算成本降低了11%。

同時(shí),PeleeNet僅占MobileNet模型大小的66%。然后,提出了一種實(shí)時(shí)物體檢測系統(tǒng),它將PeleeNet與Single Shot MultiBox Detector(SSD)方法相結(jié)合,并優(yōu)化架構(gòu)以實(shí)現(xiàn)快速速度。

提出的檢測系統(tǒng)名為Pelee,在PASCAL VOC2007上達(dá)到76.4%mAP(平均精度),在MSCOCO數(shù)據(jù)集上達(dá)到22.4% mAP,iPhone 6s上的速度為17.1 FPS,iPhone 8上的速度為23.6 FPS,COCO的結(jié)果優(yōu)于YOLOv2,考慮更高的精度,13.6倍的計(jì)算成本和11.3倍的模型尺寸。

PeleeNet 關(guān)鍵特征

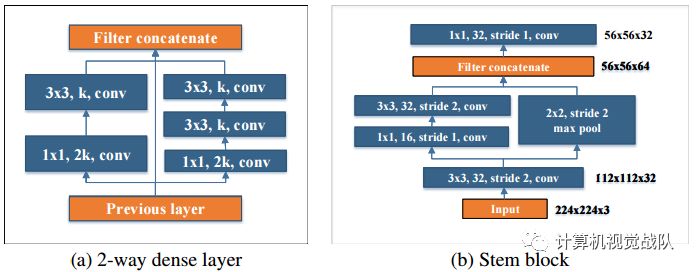

Two-Way Dense Layer:

Dynamic Number of Channels in Bottleneck Layer

另一個(gè)亮點(diǎn)就是Bottleneck Layer通道數(shù)目會(huì)隨著輸入維度的變化而變化,保證輸出通道的數(shù)目不會(huì)超過輸出通道。

與原始的 DenseNet 結(jié)構(gòu)相比,實(shí)驗(yàn)表明這種方法在節(jié)省 28.5% 的計(jì)算資源的同時(shí)僅僅會(huì)對(duì)準(zhǔn)確率有很小的影響。

Transition Layer without Compression

實(shí)驗(yàn)表明,DenseNet 提出的壓縮因子會(huì)損壞特征表達(dá),PeleeNet在轉(zhuǎn)換層中也維持了與輸入通道相同的輸出通道數(shù)目。

Composite Function

為提升實(shí)際的速度,采用conventional wisdom of post-activation(Convolution-Batch Normalization (Ioffe & Szegedy (2015))- Relu))作為我們的復(fù)合函數(shù),而不是DenseNet中所用的預(yù)激活。對(duì)于post-activation而言,所有的批正則化層可以在推理階段與卷積層相結(jié)合,這可以很好的加快速度。

為了補(bǔ)償這種變化給準(zhǔn)確率帶來的不良影響,研究者使用一個(gè)淺層的、較寬的網(wǎng)絡(luò)結(jié)構(gòu)。在最后一個(gè)密集塊之后還增加了一個(gè)1×1的卷積層,以得到更強(qiáng)的表征能力。

主要增強(qiáng)&改進(jìn)

優(yōu)化了Single Shot MultiBox Detector (SSD) 的網(wǎng)絡(luò)結(jié)構(gòu),以加速并將其與 PeleeNet相結(jié)合。

在PASCAL VOC(Everingham et al. (2010))2007數(shù)據(jù)集上達(dá)到了 76.4%的準(zhǔn)確率,在COCO數(shù)據(jù)集上達(dá)到了22.4%的準(zhǔn)確率。

在準(zhǔn)確率、速度和模型大小方面,Pelee系統(tǒng)都優(yōu)于YOLOv2(Redmon & Farhadi (2016))。主要措施如下:

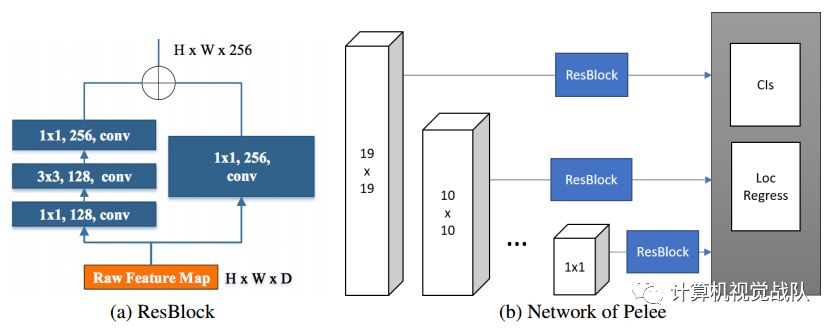

Feature Map Selection

以不同于原始SSD的方式構(gòu)建目標(biāo)檢測網(wǎng)絡(luò),為了減少計(jì)算成本,沒使用38×38 的特征圖。

Residual Prediction Block

Lee 等人提出的設(shè)計(jì)思想(2017),即:使特征沿著特征提取網(wǎng)絡(luò)傳遞。對(duì)于每一個(gè)用于檢測的特征圖,在實(shí)施預(yù)測之前構(gòu)建了一個(gè)殘差(He et al. 2016)塊,ResBlock 的結(jié)構(gòu)如下圖所示:

2

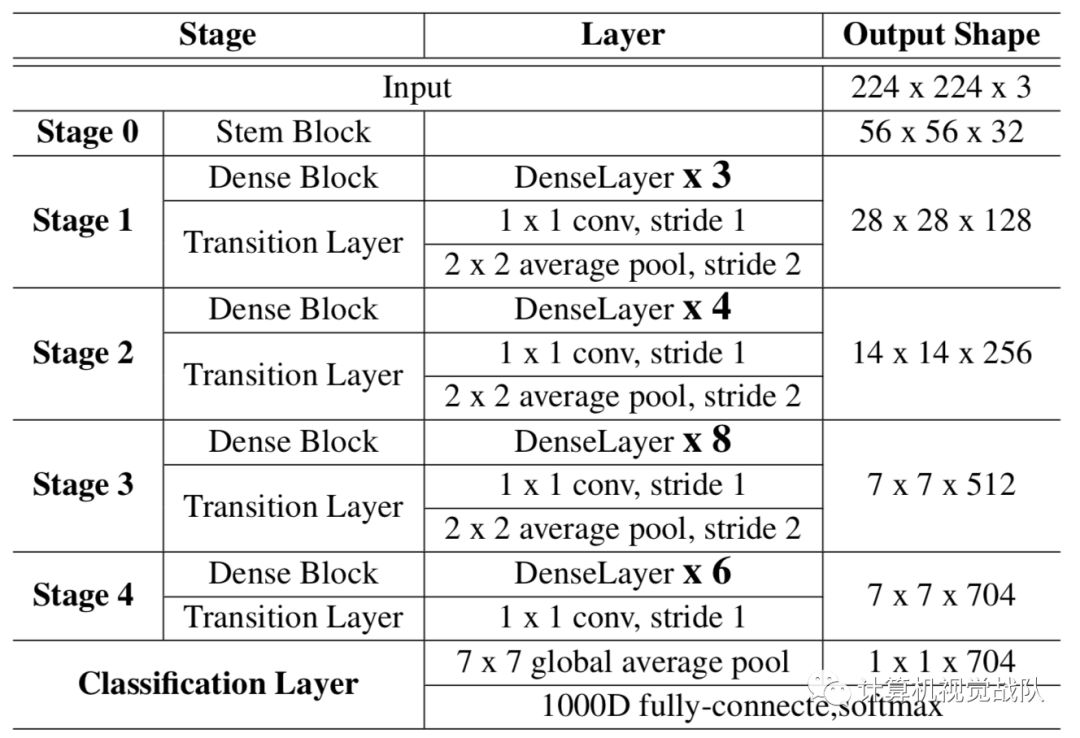

PeleeNet架構(gòu)

3

實(shí)驗(yàn)

表1 PeleeNet整體架構(gòu)

表2 不同設(shè)計(jì)選擇和部件對(duì)性能的影響

表3 在Stanford Dogs數(shù)據(jù)集上的結(jié)果

表4 在ImageNet ILSVRC 2012數(shù)據(jù)集上的結(jié)果

表5 不同設(shè)計(jì)選擇對(duì)性能的影響

表6 在VOC 2007數(shù)據(jù)集上的結(jié)果

表7 在不同硬件上的結(jié)果

PeleeNet 在手機(jī)上實(shí)驗(yàn)效果圖

PeleeNet 出處

文章:Pelee: A Real-Time Object Detection System on Mobile Devices ICLR 2018 workshop track 下載地址:https://arxiv.org/abs/1804.06882 代碼:https://github.com/GZQ0723/PeleeNet

個(gè)人微信(如果沒有備注不拉群!) 請(qǐng)注明:地區(qū)+學(xué)校/企業(yè)+研究方向+昵稱

下載1:何愷明頂會(huì)分享

在「AI算法與圖像處理」公眾號(hào)后臺(tái)回復(fù):何愷明,即可下載。總共有6份PDF,涉及 ResNet、Mask RCNN等經(jīng)典工作的總結(jié)分析

下載2:終身受益的編程指南:Google編程風(fēng)格指南

在「AI算法與圖像處理」公眾號(hào)后臺(tái)回復(fù):c++,即可下載。歷經(jīng)十年考驗(yàn),最權(quán)威的編程規(guī)范!

下載3 CVPR2021 在「AI算法與圖像處理」公眾號(hào)后臺(tái)回復(fù):CVPR,即可下載1467篇CVPR 2020論文 和 CVPR 2021 最新論文