基于激光雷達(dá)的高效語義SLAM

點(diǎn)擊上方“小白學(xué)視覺”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時(shí)間送達(dá)

推薦閱讀

本文來源:智駕最前沿,編輯:智車科技

/?導(dǎo)讀?/

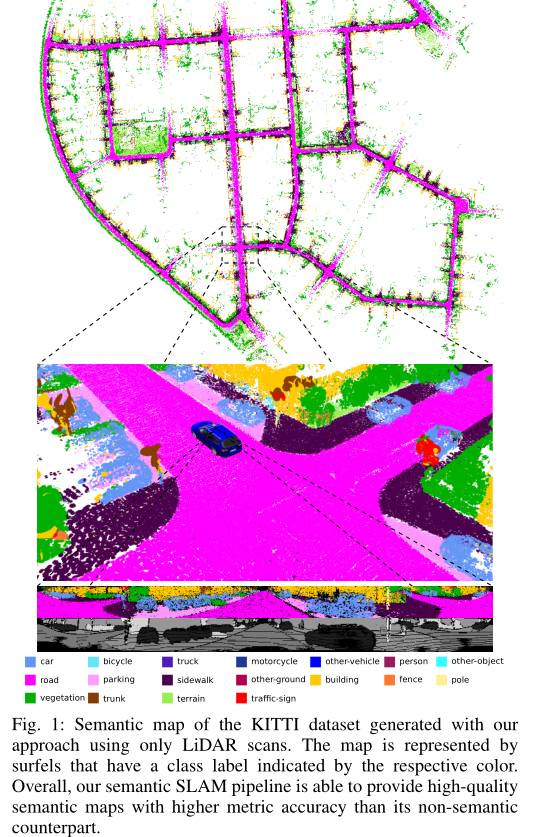

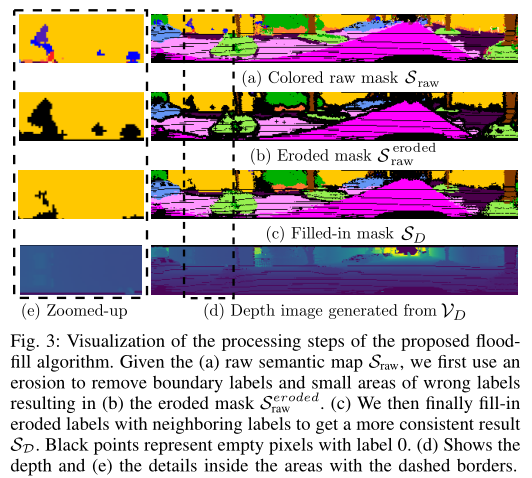

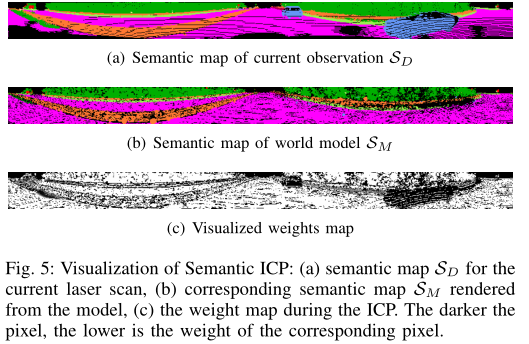

可靠、準(zhǔn)確的定位和建圖是大多數(shù)自動(dòng)駕駛系統(tǒng)的關(guān)鍵組件.除了關(guān)于環(huán)境的幾何信息之外,語義對(duì)于實(shí)現(xiàn)智能導(dǎo)航行為也起著重要的作用.在大多數(shù)現(xiàn)實(shí)環(huán)境中,由于移動(dòng)對(duì)象引起的動(dòng)態(tài)變化,這一任務(wù)特別復(fù)雜,這可能會(huì)破壞定位.我們提出一種新的基于語義信息的激光雷達(dá)SLAM系統(tǒng)來更好地解決真實(shí)環(huán)境中的定位與建圖問題.通過集成語義信息來促進(jìn)建圖過程,從而利用三維激光距離掃描.語義信息由全卷積神經(jīng)網(wǎng)絡(luò)有效提取,并呈現(xiàn)在激光測(cè)距數(shù)據(jù)的球面投影上.這種計(jì)算的語義分割導(dǎo)致整個(gè)掃描的點(diǎn)狀標(biāo)記,允許我們用標(biāo)記的表面構(gòu)建語義豐富的地圖.這種語義圖使我們能夠可靠地過濾移動(dòng)對(duì)象,但也通過語義約束改善投影掃描匹配.我們對(duì)極少數(shù)靜態(tài)結(jié)構(gòu)和大量移動(dòng)車輛的KITTI數(shù)據(jù)集進(jìn)行的具有挑戰(zhàn)性的公路序列的實(shí)驗(yàn)評(píng)估表明,與純幾何的、最先進(jìn)的方法相比,我們的語義SLAM方法具有優(yōu)勢(shì).

對(duì)大多數(shù)自動(dòng)駕駛車輛來說,精確定位和對(duì)未知環(huán)境的可靠測(cè)繪是基礎(chǔ).此類系統(tǒng)通常在高度動(dòng)態(tài)的環(huán)境中運(yùn)行,這使得生成一致的地圖更加困難.此外需要關(guān)于建圖區(qū)域的語義信息來實(shí)現(xiàn)智能導(dǎo)航行為.例如自動(dòng)駕駛汽車必須能夠可靠地找到合法停車的位置,或者在乘客可能安全離開的地方靠邊停車——即使是在從來沒有看到過的地方,因此以前沒有準(zhǔn)確地圖.

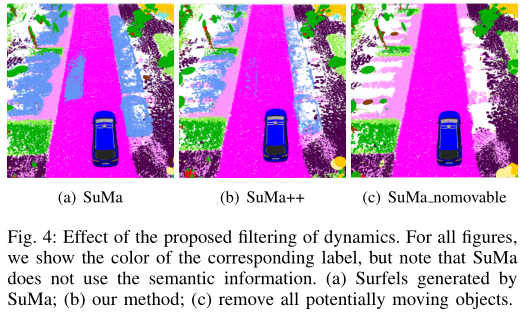

本文的主要貢獻(xiàn)是將語義集成到基于表面的地圖表示中的方法,以及利用這些語義標(biāo)簽過濾動(dòng)態(tài)對(duì)象的方法。總之,我們聲稱我們能夠準(zhǔn)確地繪制環(huán)境地圖,尤其是在有大量移動(dòng)對(duì)象的情況下,并且我們能夠?qū)崿F(xiàn)比相同的建圖系統(tǒng)更好的性能,簡單地移除一般環(huán)境中可能移動(dòng)的對(duì)象,包括城市、農(nóng)村和高速公路場(chǎng)景.我們?cè)贙ITTI的挑戰(zhàn)序列上實(shí)驗(yàn)性地評(píng)估了我們的方法,并顯示了與純粹基于幾何表面的建圖和基于類標(biāo)簽移除所有潛在移動(dòng)對(duì)象的建圖相比,我們的語義表面建圖方法SuMa++的優(yōu)越性能.

實(shí)驗(yàn)評(píng)估

我們使用來自KITTI的數(shù)據(jù)評(píng)估我們的方法,其中我們使用由Velodyne HDL-64E S2以10Hz的速率記錄生成的提供的點(diǎn)云.為了評(píng)估里程計(jì)的性能,數(shù)據(jù)集建議計(jì)算在不同位姿之間的不同距離上平均的平移和旋轉(zhuǎn)的相對(duì)誤差,并對(duì)其進(jìn)行平均.地面真實(shí)位姿是使用來自慣性導(dǎo)航系統(tǒng)的姿態(tài)信息生成的.

在下文中,我們將我們提出的方法(由SuMa++表示)與原始的基于surfel的建圖(由SuMa表示)進(jìn)行比較,并將SuMa與刪除語義分割(由SuMa nomovable表示)給出的所有可移動(dòng)類(汽車、公共汽車、卡車、自行車、摩托車、其他車輛、人、騎自行車的人、摩托車手)的簡單方法進(jìn)行比較.

語義分割的RangeNet++是使用逐點(diǎn)注釋[1]使用KITTI里程計(jì)基準(zhǔn)的所有訓(xùn)練序列進(jìn)行訓(xùn)練的,這些標(biāo)記可用于訓(xùn)練目的。這包括序列00至10,但序列08除外,該序列未進(jìn)行驗(yàn)證。

RangeNet++平均需要75毫秒來為每次掃描生成逐點(diǎn)標(biāo)簽,surfer-mapping平均需要48毫秒,但在某些情況下,我們最多需要190毫秒來集成循環(huán)閉包(在具有多個(gè)閉環(huán)的訓(xùn)練集序列00上).

1、KITTI Road Sequences

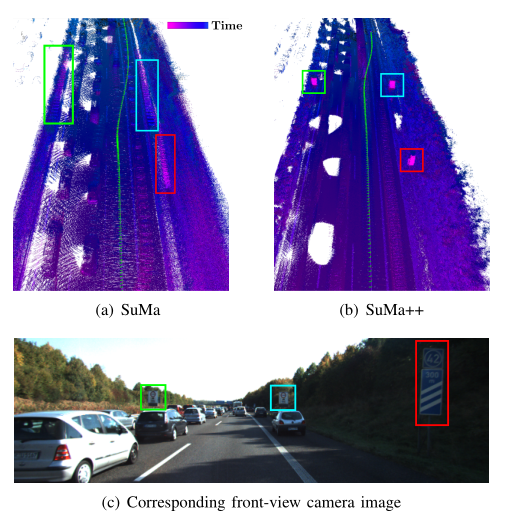

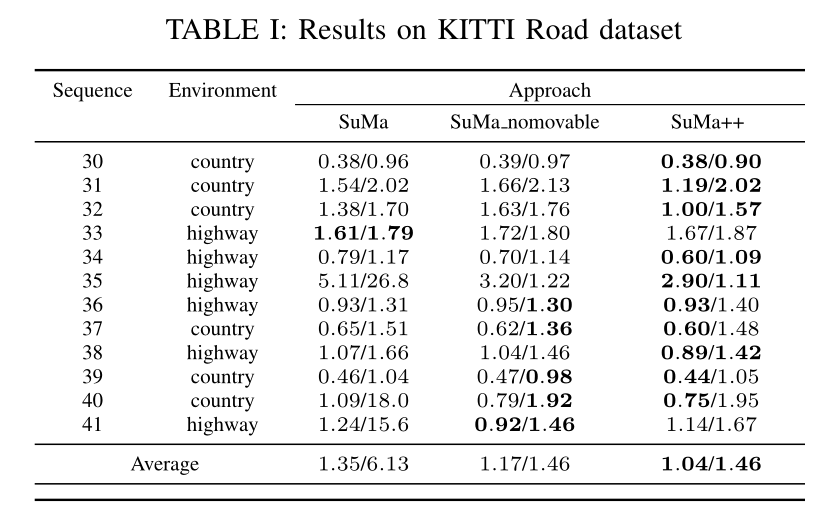

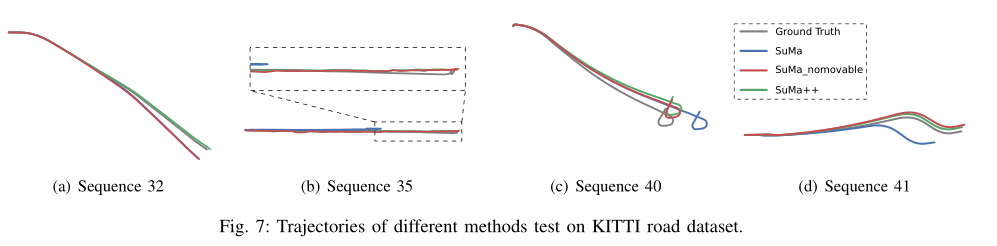

第一個(gè)實(shí)驗(yàn)旨在展示我們的方法能夠生成一致的地圖,即使在有許多移動(dòng)對(duì)象的情況下.我們顯示了KITTI的原始數(shù)據(jù)道路類別的序列結(jié)果.請(qǐng)注意,這些序列不是里程計(jì)基準(zhǔn)的一部分,因此沒有提供標(biāo)簽對(duì)于語義分割,這意味著我們的網(wǎng)絡(luò)學(xué)會(huì)了推斷道路駕駛場(chǎng)景的語義類別,而不是簡單的記憶.這些序列,尤其是高速公路序列,對(duì)SLAM方法來說是具有挑戰(zhàn)性的,因?yàn)檫@里大多數(shù)物體都是移動(dòng)的汽車.此外路邊只有稀疏的明顯特征,如交通標(biāo)志或電線桿.建筑角或其他更有特色的特征不可用于指導(dǎo)注冊(cè)過程.在這種情況下,在不斷移動(dòng)的異常值上的錯(cuò)誤對(duì)應(yīng)(如交通堵塞中的汽車)通常會(huì)導(dǎo)致錯(cuò)誤估計(jì)的姿態(tài)變化,因此生成的地圖不一致.

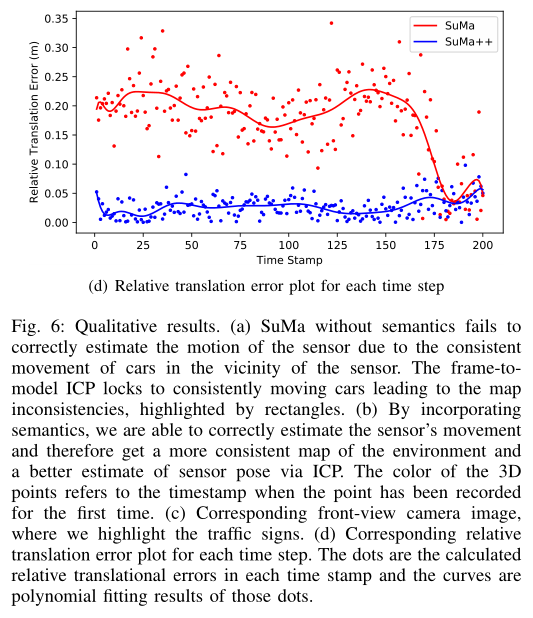

圖6顯示了用SuMa和提出的SuMa++生成的示例.在純幾何方法的情況下,我們清楚地看到姿態(tài)無法正確估計(jì),因?yàn)橥怀鲲@示的交通標(biāo)志出現(xiàn)在不同的位置,導(dǎo)致很大的不一致.在我們提出的方法中,我們能夠正確地過濾移動(dòng)的汽車,相反,我們生成一致的地圖,如突出顯示的交通標(biāo)志.在這個(gè)例子中,我們還繪制了SuMa和SuMa++的里程計(jì)結(jié)果的相對(duì)平移誤差.圓點(diǎn)代表每個(gè)時(shí)間戳中的相對(duì)平移誤差,曲線是給定圓點(diǎn)的多項(xiàng)式擬合結(jié)果.它表明SuMa++在這樣一個(gè)具有挑戰(zhàn)性的環(huán)境中實(shí)現(xiàn)了更準(zhǔn)確的姿態(tài)估計(jì),其中許多異常值是由移動(dòng)對(duì)象引起的.

表1顯示了相對(duì)平移和相對(duì)旋轉(zhuǎn)誤差,圖7顯示了在數(shù)據(jù)集的這一部分測(cè)試的不同方法的相應(yīng)軌跡.一般來說,我們看到我們提出的方法SuMa++生成了更一致的軌跡,并且在大多數(shù)情況下實(shí)現(xiàn)了比SuMa更低的平移誤差.與僅僅移除所有可能移動(dòng)的對(duì)象的基線相比,SuMa是不可移動(dòng)的,與SuMa++相比,我們看到非常相似的性能.這證實(shí)了SuMa在這種情況下性能更差的主要原因是由實(shí)際移動(dòng)的對(duì)象引起的不一致.然而我們將在接下來的實(shí)驗(yàn)中表明,移除所有潛在的移動(dòng)對(duì)象也會(huì)對(duì)城市環(huán)境中的姿態(tài)估計(jì)性能產(chǎn)生負(fù)面影響.

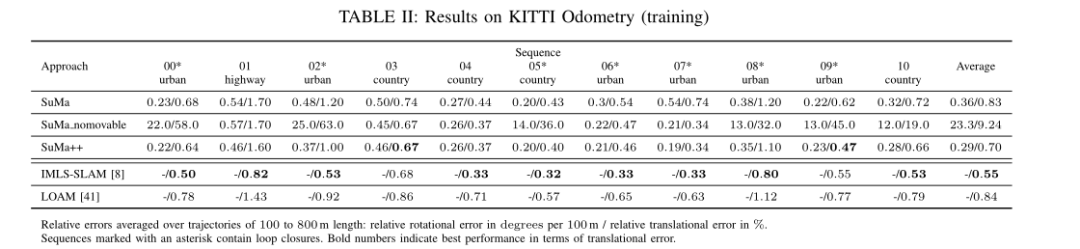

2、KITTI Odometry Benchmark

第二個(gè)實(shí)驗(yàn)旨在表明,與簡單地從觀察中移除某些語義類相比,我們的方法表現(xiàn)更好。該評(píng)估在KITTI里程計(jì)基準(zhǔn)上進(jìn)行

表2表示相對(duì)平移和相對(duì)旋轉(zhuǎn)誤差。IMLS-SLAM和Loam是基于激光雷達(dá)的最先進(jìn)的SLAM方法。在大多數(shù)序列中,我們可以看到SuMa++的性能與最先進(jìn)的。更有趣的是,基線方法有不可解決的分歧,尤其是在城市場(chǎng)景中.

這可能是反直覺的,因?yàn)檫@些環(huán)境包含大量的人造結(jié)構(gòu)和其他更有特色的特征。但是,有兩個(gè)原因?qū)е铝诉@種糟糕的性能,當(dāng)人們查看結(jié)果和發(fā)生映射錯(cuò)誤的場(chǎng)景的配置時(shí),就會(huì)明白這一點(diǎn)。首先,即使我們?cè)噲D改善語義分割的結(jié)果,也有錯(cuò)誤的預(yù)測(cè)導(dǎo)致地圖中實(shí)際上是靜態(tài)的表面元素被移除。第二,移除停放的汽車是個(gè)問題,因?yàn)檫@些是對(duì)齊掃描的好的和獨(dú)特的特征。這兩種效果都有助于使表面貼圖更稀疏。這一點(diǎn)更為關(guān)鍵,因?yàn)橥7诺钠囀俏ㄒ慌c眾不同或可靠的特征。總之,簡單地刪除某些類至少在我們的情況下是次優(yōu)的,并且會(huì)導(dǎo)致更差的性能.

為了評(píng)估我們的方法在未知軌跡上的性能,我們上傳了未知KITTI測(cè)試序列的服務(wù)器端評(píng)估結(jié)果,因此測(cè)試集上的參數(shù)調(diào)整是不可能的。因此,這可以很好地代表我們方法的實(shí)際性能。在測(cè)試組中,我們獲得了0.0032度/米的平均旋轉(zhuǎn)誤差和1.06%的平均平移誤差,與原始SuMa的0.0032度/米和1.39%相比,這是平移誤差方面的改進(jìn).

結(jié)論

在本文中,我們提出了一種新的方法來建立語義地圖,使基于激光的語義分割點(diǎn)云不需要任何相機(jī)數(shù)據(jù). 我們利用這一信息來提高姿態(tài)估計(jì)的準(zhǔn)確性,特別是我們的方法利用掃描和地圖之間的語義一致性來過濾掉動(dòng)態(tài)對(duì)象,并在比較方案過程中提供更高級(jí)別的約束.這使得我們能夠僅基于三維激光距離掃描成功地組合語義和幾何信息,以實(shí)現(xiàn)比純幾何方法更好的姿態(tài)估計(jì)精度.我們?cè)贙ITTI Vision基準(zhǔn)數(shù)據(jù)集上評(píng)估了我們的方法,顯示了我們的方法與純幾何方法相比的優(yōu)勢(shì)。

交流群

歡迎加入公眾號(hào)讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動(dòng)駕駛、計(jì)算攝影、檢測(cè)、分割、識(shí)別、醫(yī)學(xué)影像、GAN、算法競(jìng)賽等微信群(以后會(huì)逐漸細(xì)分),請(qǐng)掃描下面微信號(hào)加群,備注:”昵稱+學(xué)校/公司+研究方向“,例如:”張三?+?上海交大?+?視覺SLAM“。請(qǐng)按照格式備注,否則不予通過。添加成功后會(huì)根據(jù)研究方向邀請(qǐng)進(jìn)入相關(guān)微信群。請(qǐng)勿在群內(nèi)發(fā)送廣告,否則會(huì)請(qǐng)出群,謝謝理解~