CNN網(wǎng)絡結(jié)構(gòu)的發(fā)展(最全整理)

極市導讀

?本文介紹了十五種經(jīng)典的CNN網(wǎng)絡結(jié)構(gòu)。?>>加入極市CV技術交流群,走在計算機視覺的最前沿

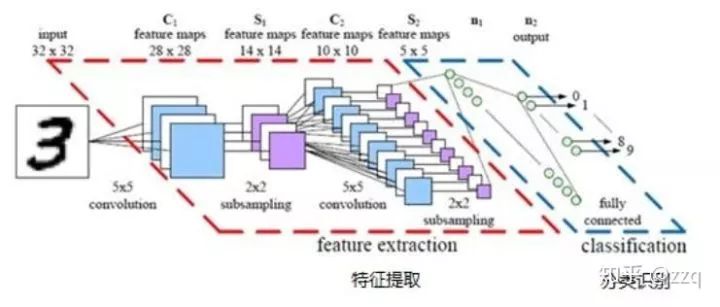

CNN基本部件介紹

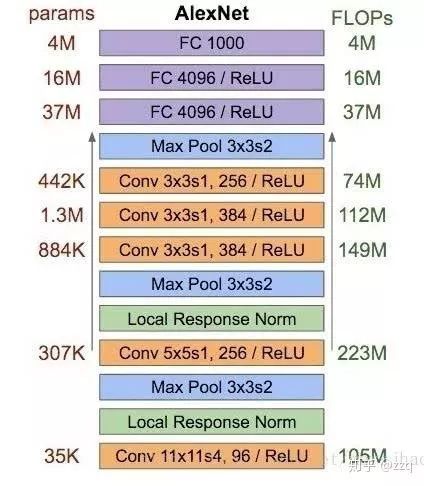

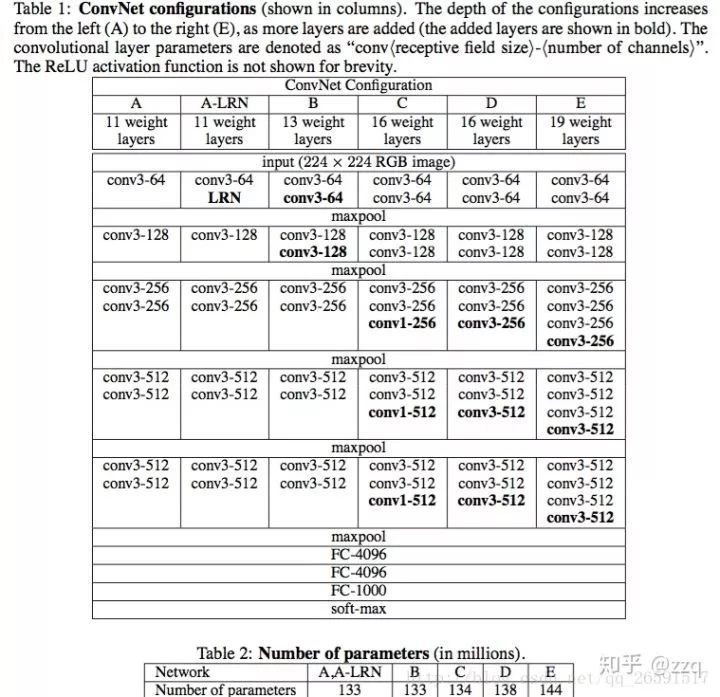

經(jīng)典網(wǎng)絡結(jié)構(gòu)

#?CV技術社群邀請函?#

備注:姓名-學校/公司-研究方向-城市(如:小極-北大-目標檢測-深圳)

即可申請加入極市目標檢測/圖像分割/工業(yè)檢測/人臉/醫(yī)學影像/3D/SLAM/自動駕駛/超分辨率/姿態(tài)估計/ReID/GAN/圖像增強/OCR/視頻理解等技術交流群

每月大咖直播分享、真實項目需求對接、求職內(nèi)推、算法競賽、干貨資訊匯總、與?10000+來自港科大、北大、清華、中科院、CMU、騰訊、百度等名校名企視覺開發(fā)者互動交流~

評論

圖片

表情