收藏 | 一文遍覽CNN網(wǎng)絡(luò)結(jié)構(gòu)的發(fā)展

來(lái)源:人工智能AI技術(shù) 本文約2600字,建議閱讀8分鐘?

本文介紹了十五種經(jīng)典的CNN網(wǎng)絡(luò)結(jié)構(gòu)。?

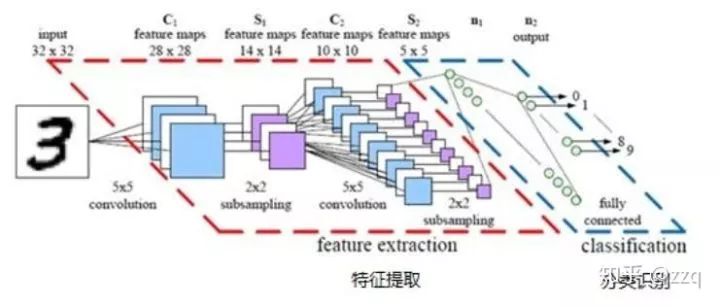

CNN基本部件介紹

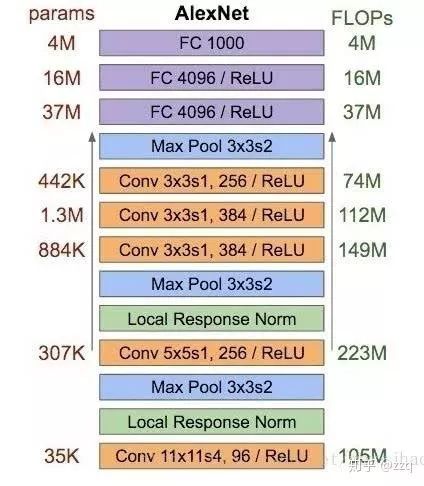

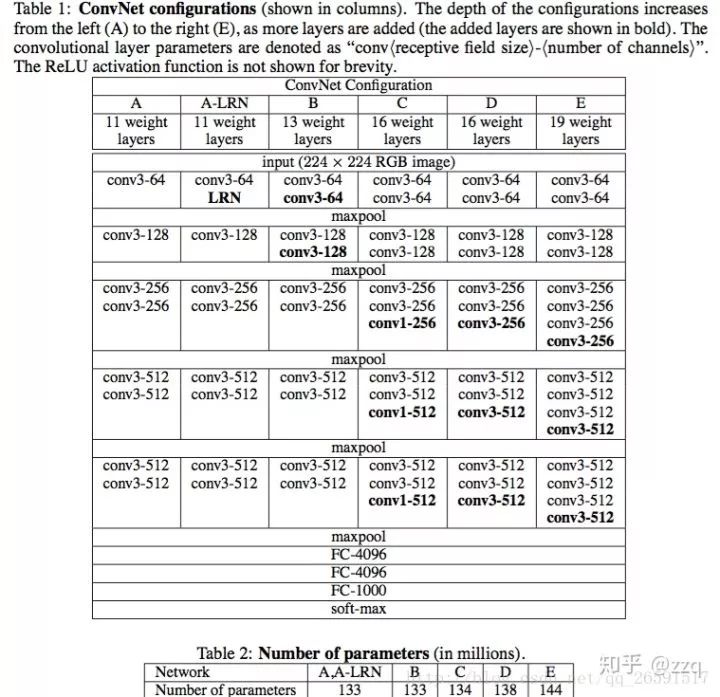

經(jīng)典網(wǎng)絡(luò)結(jié)構(gòu)

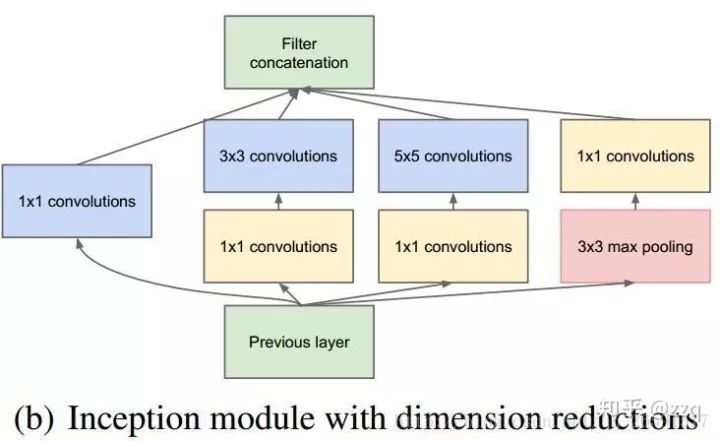

Inception v1

Inception-v2

Inception-v3

Inception-v4

V1

V2

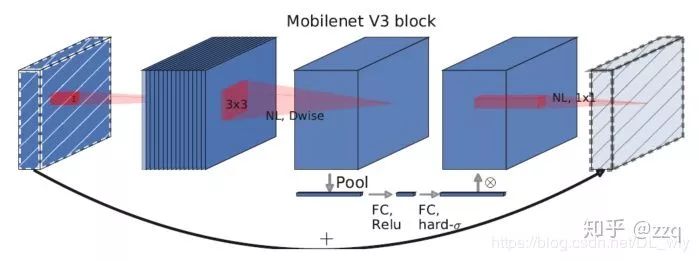

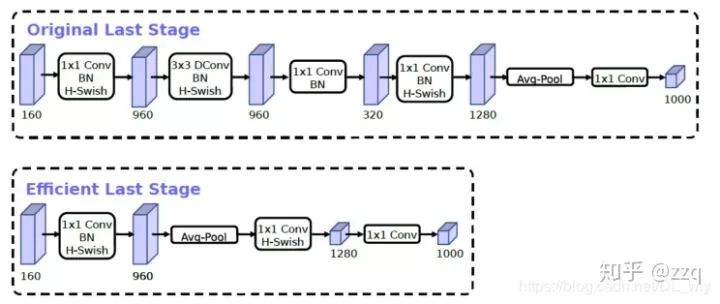

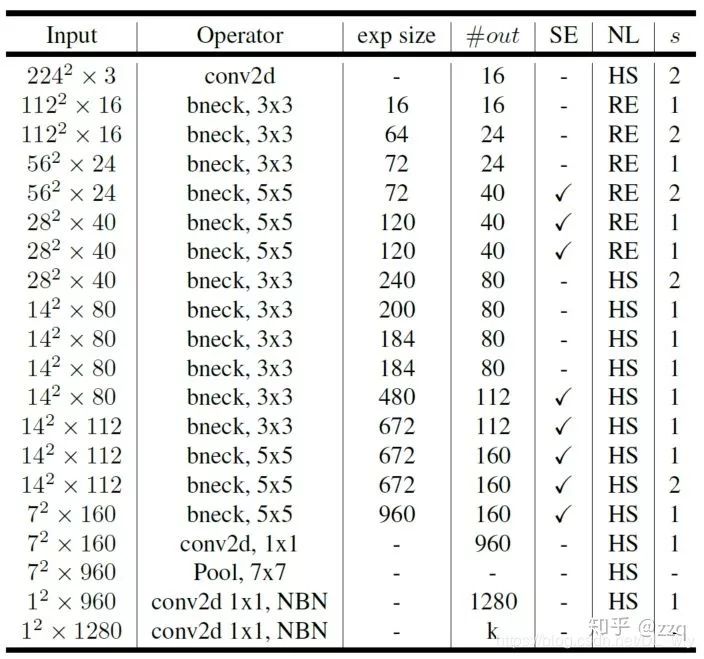

V3

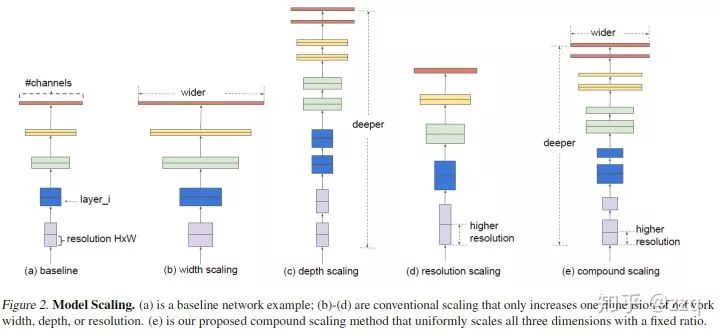

增加網(wǎng)絡(luò)深度,如從AlexNet到ResNet,但是實(shí)驗(yàn)結(jié)果表明由網(wǎng)絡(luò)深度帶來(lái)的提升越來(lái)越小;

增加網(wǎng)絡(luò)模塊的寬度,但是寬度的增加必然帶來(lái)指數(shù)級(jí)的參數(shù)規(guī)模提升,也非主流CNN設(shè)計(jì);

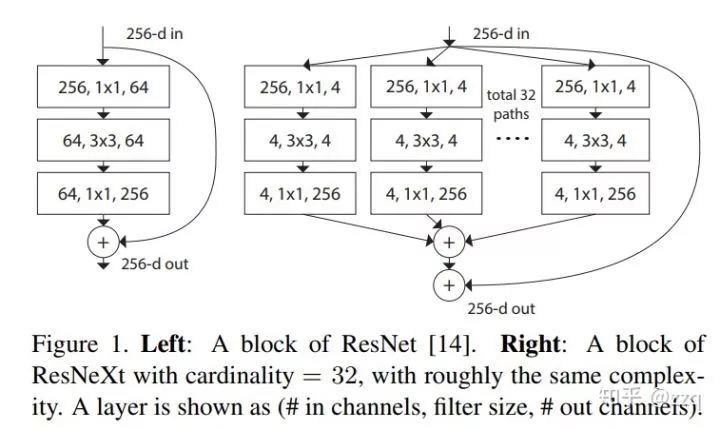

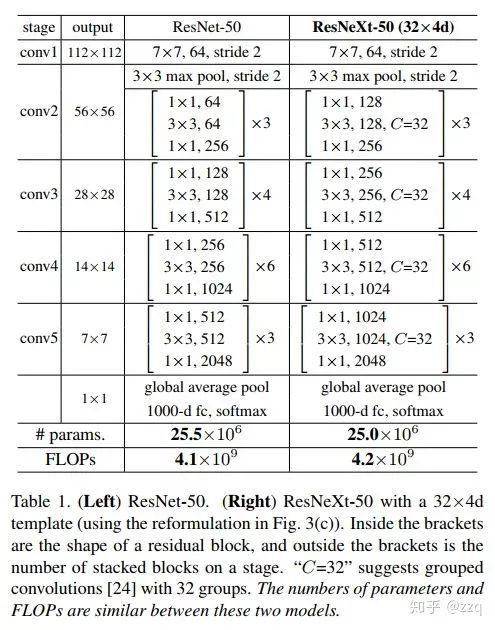

改善CNN網(wǎng)絡(luò)結(jié)構(gòu)設(shè)計(jì),如Inception系列和ResNeXt等。

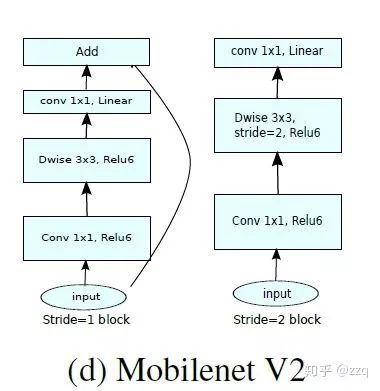

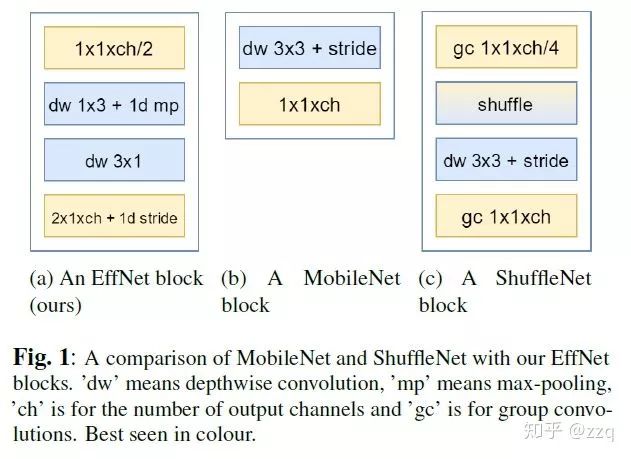

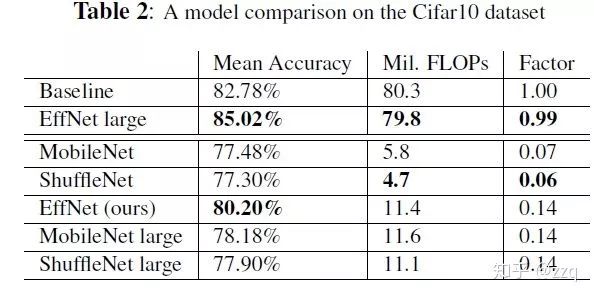

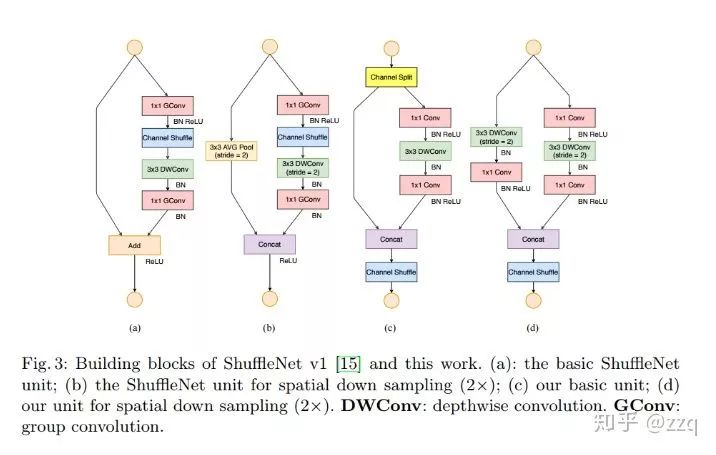

V1

V2

輸入通道數(shù)與輸出通道數(shù)保持相等可以最小化內(nèi)存訪問成本;

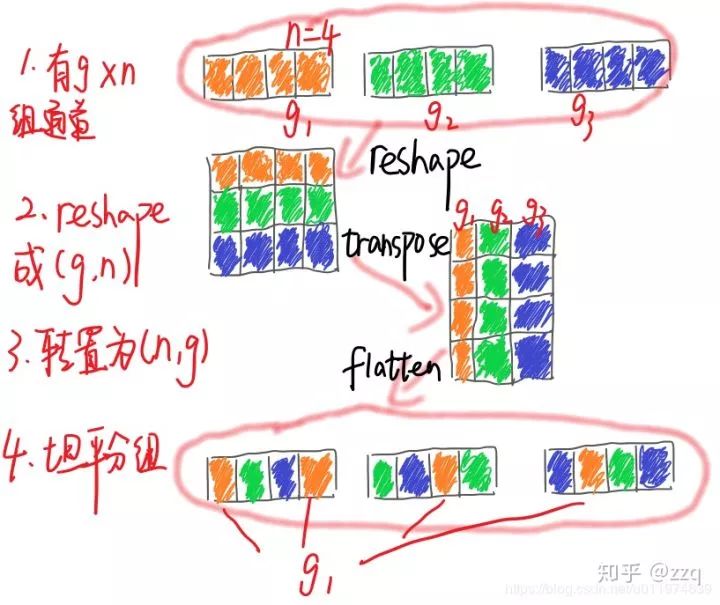

分組卷積中使用過多的分組會(huì)增加內(nèi)存訪問成本;

網(wǎng)絡(luò)結(jié)構(gòu)太復(fù)雜(分支和基本單元過多)會(huì)降低網(wǎng)絡(luò)的并行程度;

element-wise的操作消耗也不可忽略。

評(píng)論

圖片

表情