【科普】3D視覺技術(shù)在機(jī)器人抓取作業(yè)中的應(yīng)用

點(diǎn)擊上方“小白學(xué)視覺”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時(shí)間送達(dá)

隨著經(jīng)濟(jì)的發(fā)展與科技的進(jìn)步,人們越來越多地將 自動(dòng)化技術(shù)應(yīng)用到生產(chǎn)與生活中,與此同時(shí),也對自動(dòng) 化技術(shù)提出了更高的要求。近十年來,工業(yè)機(jī)器人的普 及使得機(jī)器人自動(dòng)化得到了更廣泛的應(yīng)用和關(guān)注。很多 機(jī)器人系統(tǒng)已經(jīng)集成了視覺系統(tǒng),利用機(jī)器視覺技術(shù)實(shí) 現(xiàn)檢測、識(shí)別、定位等功能,為后續(xù)的機(jī)器人運(yùn)動(dòng)提供必要的信息。?

在許多自動(dòng)化應(yīng)用場合中,如自動(dòng)化分揀、裝配、拆垛、碼垛、上料等過程中,工業(yè)機(jī)器人經(jīng)常被用來進(jìn) 行抓取作業(yè)。要完成抓取操作,機(jī)器人系統(tǒng)可能需要完 成目標(biāo)感知、運(yùn)動(dòng)規(guī)劃、抓取規(guī)劃等一系列任務(wù)[1]。視 覺系統(tǒng)在機(jī)器人抓取作業(yè)中的作用就是識(shí)別、定位目標(biāo) 物體,為機(jī)器人提供目標(biāo)物體的類型與位姿信息。其 中,位姿估計(jì)的精度關(guān)系到抓取的成功率與精度,是非 常重要的技術(shù)參數(shù)。

3D視覺技術(shù)作為新興的技術(shù)領(lǐng)域還存在很多亟待 解決的問題,但2D視覺已不能滿足空間抓取的應(yīng)用要 求。與2D視覺相比,3D視覺技術(shù)的優(yōu)點(diǎn)有:

(1)3D視覺可以提供目標(biāo)物體6DOF的位姿數(shù) 據(jù),而2D視覺僅能提供平面內(nèi)3DOF的位姿數(shù)據(jù);

(2)3D視覺能給出目標(biāo)物體的深度信息或物體表 面的點(diǎn)云信息。

但與此同時(shí),3D視覺技術(shù)在機(jī)器人抓取應(yīng)用中仍然面臨許多挑戰(zhàn)[2]:

(1)點(diǎn)云空洞:用3D相機(jī)捕捉反光、透明、網(wǎng)狀 物體表面的點(diǎn)云信息,經(jīng)常會(huì)出現(xiàn)數(shù)據(jù)的丟失,丟失的 點(diǎn)云數(shù)據(jù)形成了點(diǎn)云空洞;

(2)點(diǎn)云粘連:多個(gè)物體雜亂堆放或者兩個(gè)物體 表面靠近擺放時(shí),不同物體表面的點(diǎn)云會(huì)粘連在一起, 這就涉及到如何穩(wěn)定、準(zhǔn)確地進(jìn)行點(diǎn)云分割;

(3)點(diǎn)云密度不一致:物體表面與3D相機(jī)之間的 相對位姿、物體表面的顏色均會(huì)影響點(diǎn)云的密度,使得 目標(biāo)場景的點(diǎn)云密度不一致,這在一定程度上給點(diǎn)云處 理算法帶來了困難;

(4)視野局限:有限的相機(jī)視角、遮擋和陰影效 果,都會(huì)阻礙3D相機(jī)獲得抓取目標(biāo)的表面全貌,進(jìn)而 阻礙對抓取目標(biāo)的識(shí)別;

(5)速度:3D視覺的原理要求其處理的數(shù)據(jù)量較 大。3D相機(jī)的分辨率越高,所采集的點(diǎn)云質(zhì)量越好, 越能表征物體表面更細(xì)微的幾何特征,但相應(yīng)地帶來的 數(shù)據(jù)量就越大。為了適應(yīng)實(shí)際應(yīng)用需要,如何提高3D 相機(jī)獲取目標(biāo)場景點(diǎn)云的速度、點(diǎn)云處理算法的速度仍 是需要研究的課題。

此外,相機(jī)傳感器的噪聲,點(diǎn)云分割噪聲,光照

條件的變化,物體的顏色等諸多因素都是3D視覺技術(shù)

所面臨的問題。

本文主要研究3D視覺技術(shù)在機(jī)器人抓取作業(yè)中的應(yīng)用。文章第二部分介紹抓取作業(yè)機(jī)器人3D視覺系統(tǒng) 的設(shè)計(jì),包括視覺設(shè)備的選擇、與機(jī)械設(shè)計(jì)的關(guān)系;第 三部分介紹幾種3D表面成像技術(shù);第四部分介紹3D視 覺處理算法,包括點(diǎn)云分割、3D匹配等;第五部分給 出一個(gè)實(shí)際應(yīng)用案例:工業(yè)機(jī)器人結(jié)合3D視覺分揀白 色抽屜紙盒;第六部分為總結(jié)。

?

2.1 3D相機(jī)的選擇

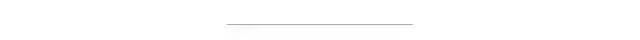

圖1?3D相機(jī)的選擇

選擇3D相機(jī)時(shí)需要考慮相機(jī)與目標(biāo)場景之間的距 離以及目標(biāo)場景的尺寸。目標(biāo)場景最好位于相機(jī)的中間 視場附近,不超出近視場和遠(yuǎn)視場的邊界,即目標(biāo)場景 的高度不超出測量范圍。

3D相機(jī)的成像精度需要滿足應(yīng)用場景的抓取精度 要求。通常,工作距離越大,3D相機(jī)的視場越大,但成 像的精度越低。此外,相機(jī)的分辨率、點(diǎn)云的獲取速度 也是評價(jià)3D成像系統(tǒng)的重要指標(biāo)。其中,相決定了點(diǎn)云數(shù)據(jù)量的大小及其對物體細(xì)節(jié)的表征程度, 關(guān)系到點(diǎn)云處理算法的設(shè)計(jì)。點(diǎn)云的獲取時(shí)間加上點(diǎn)云 處理算法的執(zhí)行時(shí)間必須滿足抓取應(yīng)用的節(jié)拍要求。

此外,相機(jī)的性價(jià)比、系統(tǒng)的可靠性也是選擇相 機(jī)時(shí)需要考量的因素。

2.2 光源、遮光板的選擇

為了避免外界環(huán)境光對視覺系統(tǒng)的影響、保證視 覺系統(tǒng)的穩(wěn)定性,有時(shí)需要外加光源和遮光板。外加的 光源不能影響3D相機(jī)成像。

2.3 視覺系統(tǒng)對機(jī)械設(shè)計(jì)的要求

當(dāng)相機(jī)固定安裝時(shí),機(jī)器人需要手持標(biāo)定板做手 眼標(biāo)定。為了方便進(jìn)行手眼標(biāo)定,可設(shè)計(jì)專門的Tool抓 持標(biāo)定板,留出足夠的空間以標(biāo)定板在手眼標(biāo)定過 程中不會(huì)與機(jī)器人發(fā)生干涉。相機(jī)固定安裝的優(yōu)點(diǎn)是, 對Tool位姿進(jìn)行變更后,無需再做機(jī)器人手眼標(biāo)定。

當(dāng)機(jī)器人手持相機(jī)拍照時(shí),一般要求抓取作業(yè) Tool(夾具、吸盤)不遮擋相機(jī)的視野。

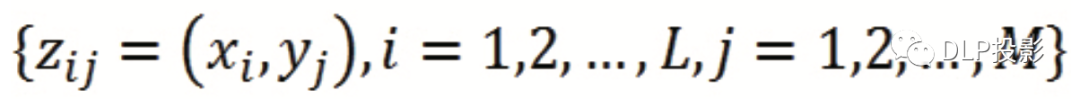

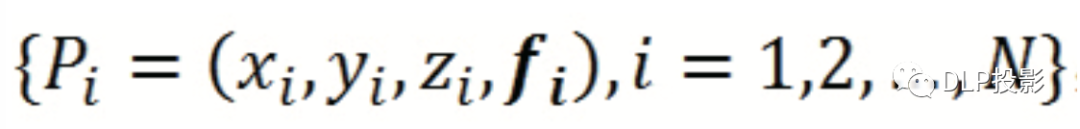

3D表面成像/重構(gòu)/測量技術(shù),可用于測量物體 表面上點(diǎn)的(x,y,z)坐標(biāo),測量結(jié)果可表示為深度圖

除了測量三維坐標(biāo),3D表面成像系統(tǒng)也可輸出物體表面空間點(diǎn)的其他

光學(xué)特征值,如反射率、顏色等。這時(shí)的點(diǎn)云測量結(jié)果可一般表示為 ,其中,f i為一向量,代表第i個(gè)點(diǎn)的光學(xué)特征值。如

常見的RGB-D(紅綠藍(lán)-深度)測量數(shù)據(jù)可表示為

,其中,f i為一向量,代表第i個(gè)點(diǎn)的光學(xué)特征值。如

常見的RGB-D(紅綠藍(lán)-深度)測量數(shù)據(jù)可表示為

[3]。目前,常見的3D表面成像技術(shù)有:雙目立體視 覺(binocular stereo vision)[4],多目立體視覺 (multi-view stereo vision),線結(jié)構(gòu)光三角測量 (laser triangulation with sheet of ligt)[5],編碼結(jié)構(gòu) 光三角測量(encoded structured light)[3],飛行時(shí) 間深度測量(time of flight),聚焦深度測量(depth from focus)[6],光度立體視覺(photometric stereo vision)[7]。

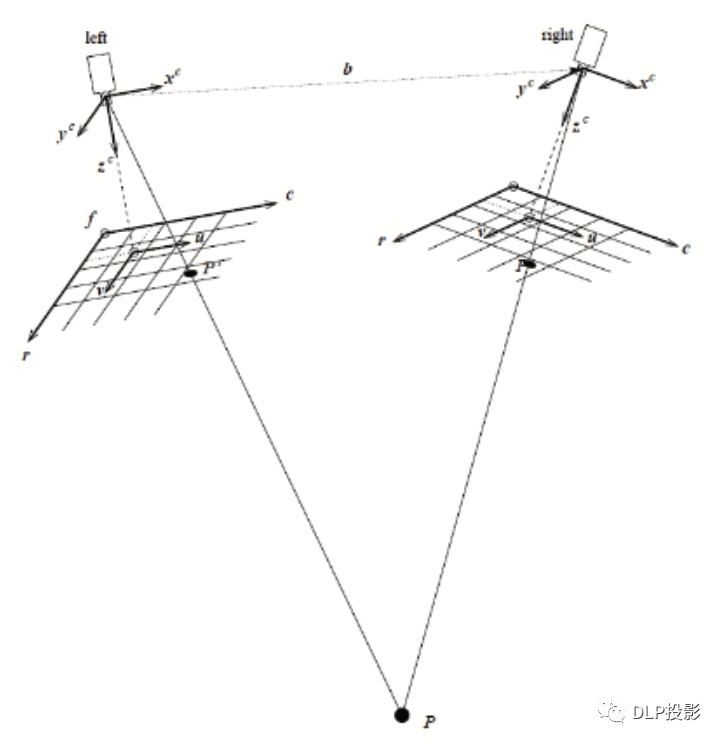

3.1 雙目立體視覺(binocular stereo vision)

使用兩個(gè)相機(jī)拍攝同一個(gè)目標(biāo)場景,通過匹配場 景內(nèi)同一物理目標(biāo)點(diǎn)投影到兩幅圖像中的像點(diǎn)(同源點(diǎn)),測量得到該點(diǎn)的空間三維坐標(biāo)。雙目立體視覺的 主要任務(wù)是雙目系統(tǒng)的標(biāo)定和同源點(diǎn)的匹配。其中,同 源點(diǎn)的匹配(立體匹配,stereo matching)方法有相 關(guān)法[8]、多重網(wǎng)格法和多掃描線法。這些方法都依賴于 目標(biāo)場景的紋理、結(jié)構(gòu)等特征,因此若能主動(dòng)制造特 征,如投射隨機(jī)分布的散斑圖案、編碼結(jié)構(gòu)光等圖案, 則能變被動(dòng)為主動(dòng),通過增強(qiáng)匹配的魯棒性,使方法具 有普適性。

圖2 雙目立體視覺原理示意圖

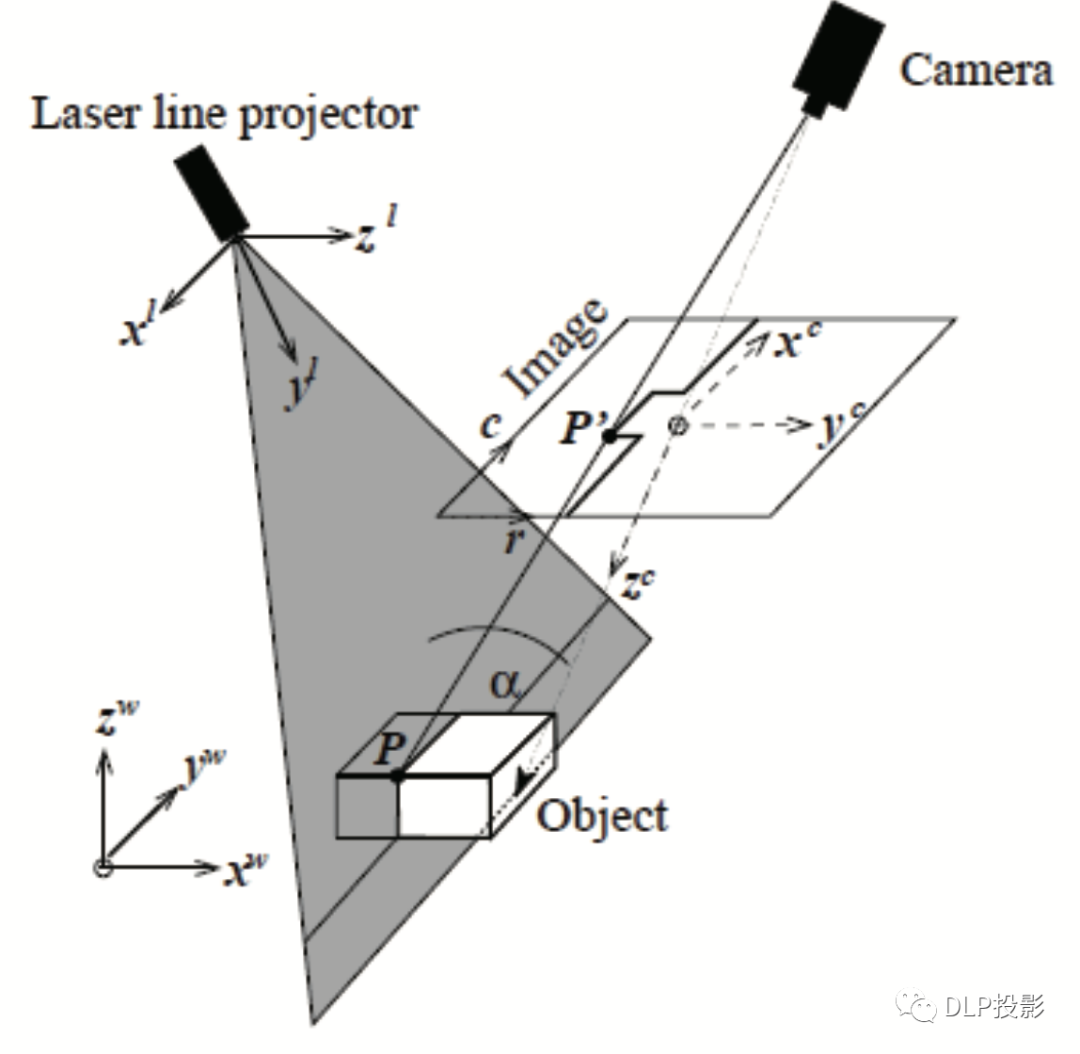

3.2 線結(jié)構(gòu)光三角測量(laser triangulation with sheet of ligt)

線激光器投射出的光平面照射到物體表面上會(huì)形 成表征其輪廓的亮線,這些窄亮的細(xì)線通常被稱為光 條。線結(jié)構(gòu)光三角測量的基本思想是:通過相機(jī)拍攝線 結(jié)構(gòu)光發(fā)射器所照射的目標(biāo)物體,得到物體表面上光條 中心位置的一系列3D坐標(biāo)。因此,目標(biāo)物體與線結(jié)構(gòu) 光成像系統(tǒng)之間做相對運(yùn)動(dòng)并在多個(gè)不同位置進(jìn)行拍照 測量,才能獲得目標(biāo)物體完整的3D表面輪廓。

線結(jié)構(gòu)光三角測量的主要任務(wù)是:標(biāo)定相機(jī)及其

與光平面之間的相對位姿,標(biāo)定目標(biāo)物體與成像系統(tǒng)之

間的相對運(yùn)動(dòng),提取光條的中心點(diǎn)。

圖3 線結(jié)構(gòu)光三角測量原理示意圖

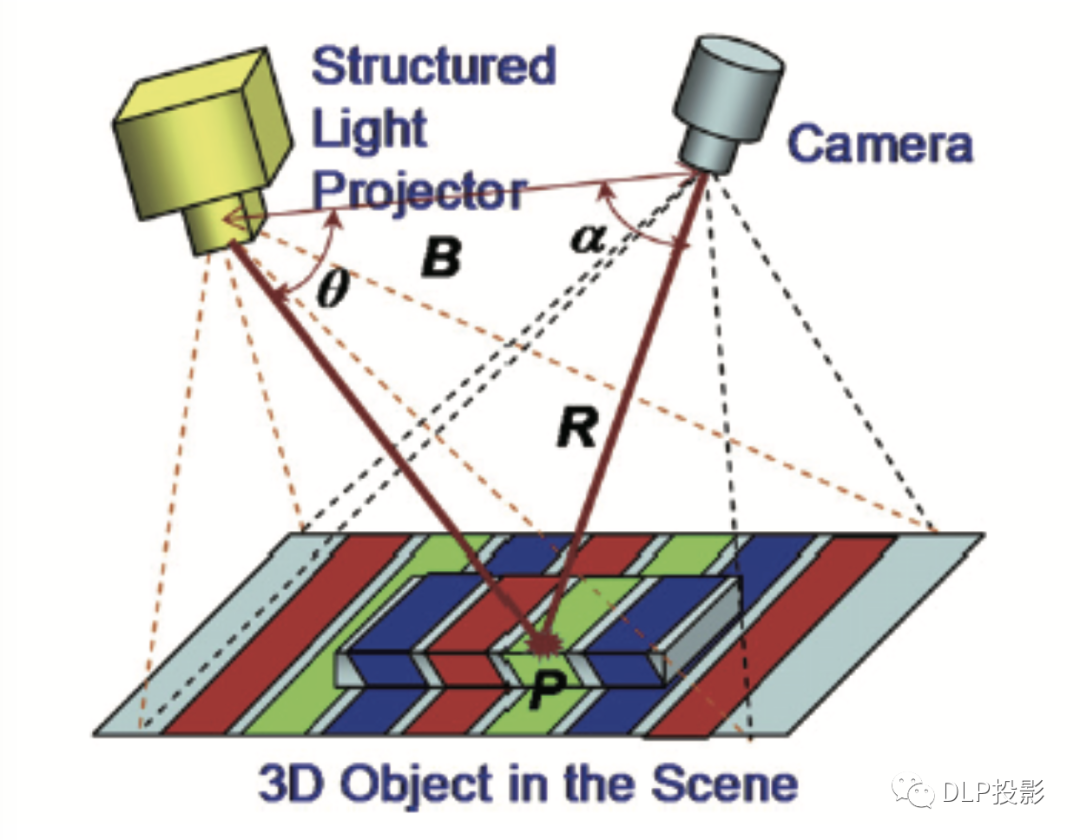

3.3 編碼結(jié)構(gòu)光三角測量(encoded structured light)

編碼結(jié)構(gòu)光激光器向目標(biāo)物體投射經(jīng)過特殊設(shè)計(jì) 的編碼圖案,基于不同的圖案編碼方法,相機(jī)可能需要 拍攝一幅或多幅被激光器照射的目標(biāo)物體表面圖像,通 過對比圖像上經(jīng)過物體表面調(diào)制的編碼光圖案與未調(diào)制 的編碼光圖案可以測量獲得目標(biāo)表面的3D形貌[3]。與線 結(jié)構(gòu)光三角測量相比,只要編碼光能夠照射到整個(gè)物體 表面,物體與成像系統(tǒng)之間無需做相對運(yùn)動(dòng)即可獲取物 體表面的幾何全貌。

圖4 編碼結(jié)構(gòu)光原理示意圖

3.4 飛行時(shí)間深度測量(time of flight)

傳感器向目標(biāo)物體發(fā)射經(jīng)過調(diào)制的近紅外光脈 沖,然后再接收從物體表面反射回來的光脈沖,通過計(jì) 算返回脈沖與發(fā)射脈沖之間的相位差即可測出目標(biāo)物體的深度。

3.5 聚焦深度測量(depth from focus)

由于相機(jī)的景深有限,在某物距下,目標(biāo)物體表

面上只有一部分點(diǎn)能夠在成像平面上清晰成像。聚焦深

度測量利用這一原理,通過拍攝不同物距下同一物體的

多幅圖像,提取圖像上清晰成像的像點(diǎn)位置,計(jì)算得到

物體表面上各點(diǎn)的深度坐標(biāo)。聚焦深度測量技術(shù)的精度

一般高于雙目立體視覺和線結(jié)構(gòu)光三角測量,但因其需

要配合遠(yuǎn)心鏡頭或顯微鏡頭使用,只適于對小尺寸物體

進(jìn)行測量。

3.6 光度立體視覺(photometric stereo vision)

物體表面反射光量的多少取決于該表面與光源和

觀察者之間的相對姿態(tài)。采用不同的角度對靜止目標(biāo)物

體進(jìn)行照明,在每個(gè)照明角度下,使用同一臺(tái)相機(jī)在同

一個(gè)固定視角下拍攝一幅圖像,光度立體視覺技術(shù)使用

這組圖像估計(jì)出目標(biāo)物體表面的法向量。

目前,機(jī)器人抓取應(yīng)用中使用的3D相機(jī)主要采用 3.1~3.4中的成像原理。

?

按照不同的功能,3D視覺處理算法可分為:

4.1 點(diǎn)云濾波

點(diǎn)云的濾波(filter)算法主要用于點(diǎn)云數(shù)據(jù)的預(yù) 處理,可實(shí)現(xiàn)去噪、平滑、采樣、特征提取等功能。濾 波方法有:雙邊濾波、高斯濾波、條件濾波、隨機(jī)采樣 一致性濾波等。

4.2 點(diǎn)云特征估計(jì)

4.2.1 點(diǎn)云局部特征估計(jì)

點(diǎn)云的局部特征(local feature)估計(jì)算法用 于估計(jì)點(diǎn)云中一點(diǎn)或一點(diǎn)周圍數(shù)個(gè)鄰近點(diǎn)的特征值。這些特征包括法向量、曲率、邊界、點(diǎn)特征直方圖 (PFH)、快速點(diǎn)特征直方圖(FPFH)、視角特征 直方圖(VFH)、NARF描述子、旋轉(zhuǎn)投影統(tǒng)計(jì)特征 (Rotational Projection Statistics)等。

4.2.2 點(diǎn)云整體特征估計(jì)

點(diǎn)云的整體特征(global feature)估計(jì)算法用于 估計(jì)某個(gè)點(diǎn)云集合的特征,如點(diǎn)云的表面積、最小外接 盒、最大直徑、截面曲線等。

4.3 點(diǎn)云關(guān)鍵點(diǎn)提取

關(guān)鍵點(diǎn)(key point),也稱為興趣點(diǎn),因?yàn)榫?有某種特點(diǎn),可依照預(yù)先定義的標(biāo)準(zhǔn)被穩(wěn)定地識(shí)別出

來。點(diǎn)云關(guān)鍵點(diǎn)的提取算法有:Harris3D、ISS3D、

NARF、SIFT、SUSAN、Trajkovic3D。

4.4 點(diǎn)云配準(zhǔn)

由于遮擋等原因,為了獲得完整的目標(biāo)表面3D點(diǎn) 云,常常需要從不同的視角對同一目標(biāo)物體進(jìn)行掃描。點(diǎn)云配準(zhǔn)(registration)[9]技術(shù)是將這些點(diǎn)云數(shù)據(jù)兩 兩進(jìn)行匹配,計(jì)算它們之間互相重疊的部分,將它們拼 接在一起,獲得更全面的目標(biāo)物體表面點(diǎn)云。點(diǎn)云配準(zhǔn) 算法有最近點(diǎn)迭代法(ICP)。

4.5 點(diǎn)云分割

點(diǎn)云分割(segmentation)算法用于將點(diǎn)云數(shù)據(jù)分

割成不同的子集。依據(jù)應(yīng)用需求,可采用不同的分割方

法,如平面分割、柱面分割、歐幾里得聚類提取、超體聚

類分割、區(qū)域生長分割、基于最小割的點(diǎn)云分割、基于法

向量差的點(diǎn)云分割等。除了上述的3D點(diǎn)云分割方法,點(diǎn)

云的分割也可結(jié)合2D圖像進(jìn)行。先在2D圖像上應(yīng)用邊緣提取、深度學(xué)習(xí)等算法,然后再對點(diǎn)云進(jìn)行分割。

4.6 三維匹配

三維匹配(3D matching)[10]算法的功能是在搜

索數(shù)據(jù)中找到目標(biāo)物體并確定它的3D位姿,其中,搜

索數(shù)據(jù)可以是3D點(diǎn)云或2D圖像。三維匹配算法可分為

基于形狀的3D匹配、基于表面的3D匹配和可變形表面

的3D匹配[11]。

4.7 點(diǎn)云擬合

如果某個(gè)點(diǎn)云子集為已知的幾何形狀,如平面、

柱面、球面,可利用點(diǎn)云擬合算法進(jìn)行擬合求出相應(yīng)的

位姿和幾何參數(shù)信息。

此外,點(diǎn)云處理算法還包括k維樹、八叉樹等方法。

在機(jī)器人抓取作業(yè)中,視覺的重要任務(wù)之一是目 標(biāo)物體位姿的估計(jì)。要估計(jì)位姿,正確地分割點(diǎn)云是前 提。通常,綜合利用4.1~4.4中的方法,然后再對點(diǎn)云 進(jìn)行分割,最后利用三維匹配或點(diǎn)云擬合估計(jì)出目標(biāo)物 體的位姿。

?

5.1 白色抽屜紙盒機(jī)器人3D視覺分揀

任務(wù)描述:料框內(nèi)雜亂堆放著不同型號的白色抽

屜紙盒,并且這些紙盒的各個(gè)表面的長寬尺寸各不相

同。3D視覺系統(tǒng)通過識(shí)別紙盒表面的尺寸將不同型號

的紙盒區(qū)分開來,再由機(jī)器人將它們分別分揀到不同的

料框中。

5.1.1 視覺系統(tǒng)設(shè)計(jì)

長方形鐵質(zhì)料框的尺寸為500×385×180mm,壁 厚為1.5mm,為避免反光并增加視覺對比度,在料框 表面噴涂啞光黑漆。3D相機(jī)采用固定安裝,在長方形 料框的正上方進(jìn)行拍攝。考慮到ABB 2600機(jī)器人的工 作范圍,3D相機(jī)距離料框底部的高度需大于1000mm 并盡可能取小值。

綜合考慮各種因素,這里選用Ensenso N20-1202- 16-BL相機(jī),該相機(jī)的工作原理是投射散斑紋理的雙目 立體視覺技術(shù),其分辨率為1280×1024像素,最小、 最大和最佳工作距離分別為1100mm、2200mm、 1400mm。料框底部距離相機(jī)的距離設(shè)計(jì)為1400mm, 在該距離下3D相機(jī)的Z向分辨率為1.037mm,能夠滿足 四個(gè)真空吸盤的抓取精度要求;紙盒的最大堆疊高度不超過230mm,Ensenso N20-1202-16-BL在1150mm工 作距離下的視野范圍為572.90×497.96mm,能夠滿足 視野要求。為避免環(huán)境光的影響,在相機(jī)頂部上方安裝 遮光板,在相機(jī)旁邊加設(shè)白色光源。

圖5 白色抽屜盒分揀場景示意圖

5.1.2 視覺方法描述

為了識(shí)別紙盒表面的長寬尺寸、估計(jì)紙盒表面的位

姿,就需要對紙盒表面的3D點(diǎn)云進(jìn)行正確分割。這里將

2D圖像處理技術(shù)與3D點(diǎn)云處理技術(shù)相結(jié)合:首先,相

機(jī)接收到觸發(fā)信號,打開散斑投影儀拍攝一幅3D點(diǎn)云圖

像;然后,關(guān)閉散斑投影儀,拍攝一幅左相機(jī)矯正灰度

圖像。Ensenso通過計(jì)算左相機(jī)矯正圖像上各像素點(diǎn)的

空間3D坐標(biāo),生成一幅3D點(diǎn)云圖像。因而,Ensenso

所拍攝的3D點(diǎn)云圖像(有三個(gè)通道,其像素值分別代表

X,Y,Z坐標(biāo))上各點(diǎn)的像素值與左相機(jī)矯正圖像上同一

位置的像素值是一一對應(yīng)的,可通過分割左相機(jī)矯正圖

像來實(shí)現(xiàn)紙盒表面3D點(diǎn)云的分割。

視覺程序設(shè)計(jì)思路:

首先,利用邊緣提取、邊緣連接、腐蝕、膨脹等算 法在左相機(jī)矯正圖像上分割出不同的紙盒表面區(qū)域;

然后,取每個(gè)區(qū)域所對應(yīng)的3D點(diǎn)云,估計(jì)這片點(diǎn) 云的厚度,若厚度小于閾值t,則認(rèn)為這片點(diǎn)云代表了 一個(gè)紙盒表面的幾何形貌,計(jì)算這片點(diǎn)云的3D最小外接 盒區(qū)域,即可估算得到紙盒表面的長寬尺寸、中心位置 與姿態(tài);若厚度大于閾值t,則認(rèn)為2D圖像分割失敗, 這片點(diǎn)云至少代表兩個(gè)紙盒表面的幾何形貌,這時(shí)先根 據(jù)點(diǎn)云的法向量、曲率等特征對其進(jìn)行3D分割,然后再 進(jìn)入上述的厚度判斷與尺寸、位姿的計(jì)算程序。為了縮 短程序執(zhí)行時(shí)間,對點(diǎn)云做3D分割之前,預(yù)先對其進(jìn)行 采樣以減少數(shù)據(jù)量。

檢查紙盒表面上方是否有遮擋,過濾掉上方有遮擋 的結(jié)果,防止抓取過程中發(fā)生碰撞或損壞。

最后,將處理結(jié)果按照表面中心高度、姿態(tài)方向 和表面尺寸進(jìn)行綜合排序,輸出到機(jī)器人抓取路徑規(guī)劃 程序當(dāng)中。路徑規(guī)劃程序根據(jù)視覺輸出的結(jié)果引導(dǎo)機(jī)器 人運(yùn)動(dòng)并控制夾具動(dòng)作。

5.1.3 視覺算法處理結(jié)果

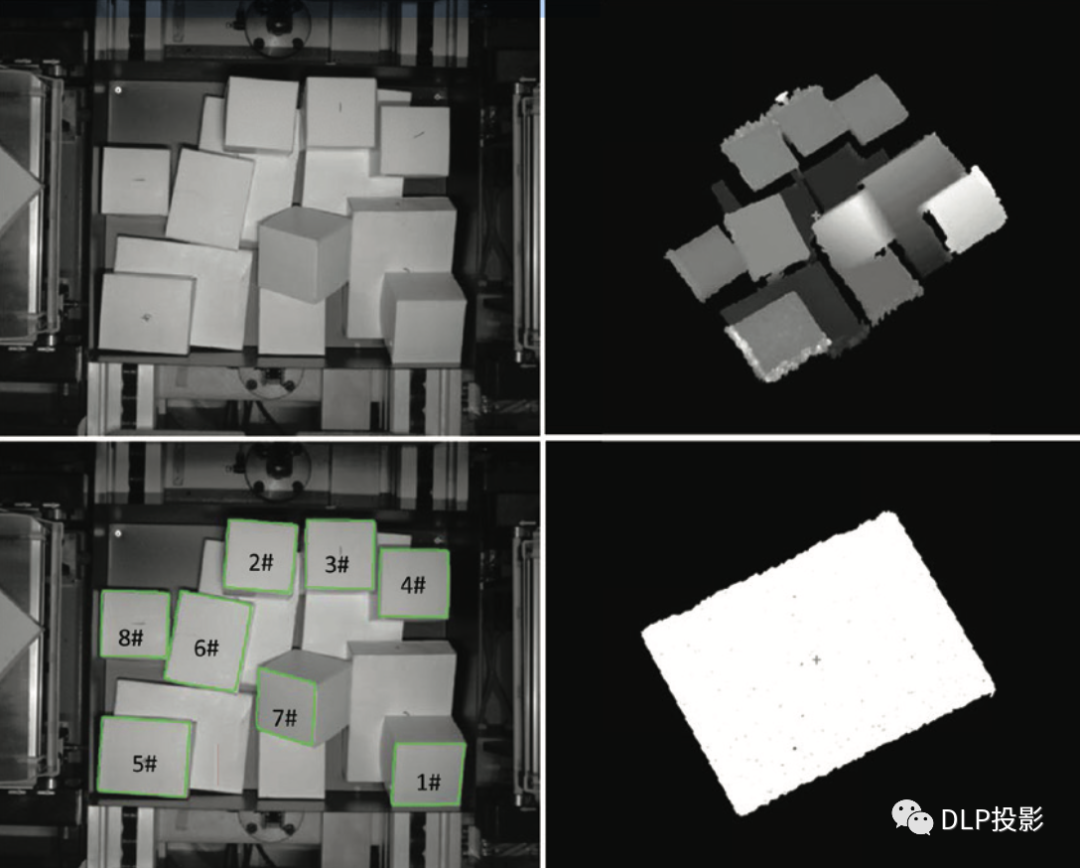

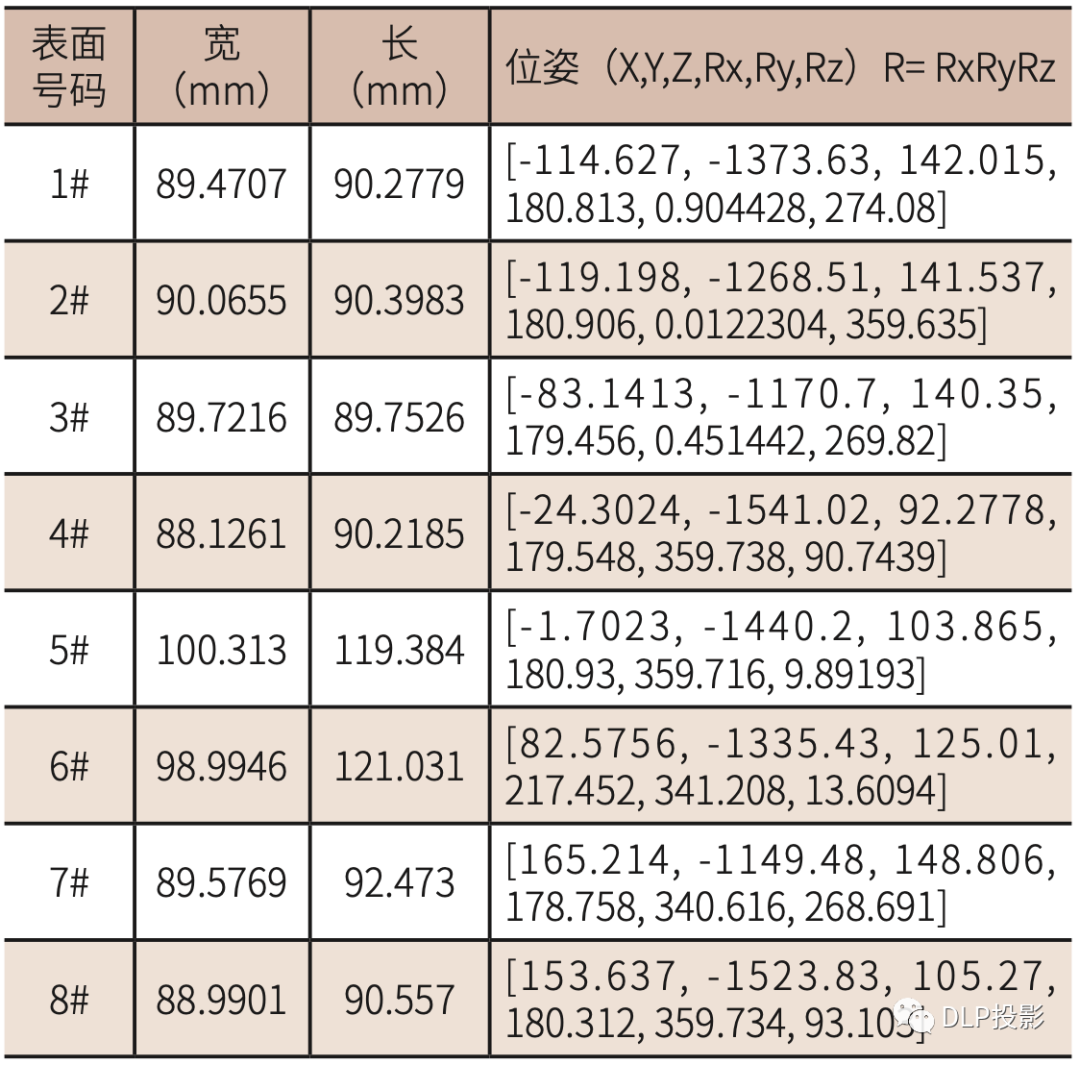

如圖6(左上)所示,料框中散亂堆放著三種型號 的白色抽屜紙盒,由視覺程序輸出的紙盒表面尺寸與位 姿的排序結(jié)果如表1所示。可以看出,視覺程序沒有給 出被遮擋紙盒表面的計(jì)算結(jié)果。

左上:Ensenso左相機(jī)矯正灰度圖;右上:3D點(diǎn)云渲 染效果圖;左下:排序輸出結(jié)果;右下:5#紙盒表面點(diǎn)云圖

表1 白抽屜盒視覺算法輸出結(jié)果

經(jīng)過測試,在該視覺系統(tǒng)下,紙盒表面尺寸的測 量誤差小于5mm,表面中心定位誤差小于2mm,表面

姿態(tài)估計(jì)誤差小于5度。使用intel i7-6820HQ CPU、 主頻2.7GHz的LenovoP50筆記本計(jì)算機(jī),視覺處理時(shí) 間為3~5s。

本文主要研究3D視覺技術(shù)在機(jī)器人抓取作業(yè)中的 應(yīng)用,歸納了3D視覺技術(shù)在機(jī)器人抓取作業(yè)中面臨的 挑戰(zhàn),對機(jī)器人抓取視覺系統(tǒng)的設(shè)計(jì)方法進(jìn)行了總結(jié),搜集了當(dāng)前主要的3D成像技術(shù)及3D視覺算法,最后給 出了應(yīng)用案例。

作者簡介: 李 剛(1963-),男,上海人,上海工業(yè)大學(xué)機(jī)器人

工程學(xué)碩士學(xué)位和中歐國際商學(xué)院高級工商管理碩士 學(xué)位,現(xiàn)就職于上海ABB工程有限公司。

楊笑叢本文主要研究3D視覺技術(shù)在機(jī)器人抓取作業(yè)中的 應(yīng)用,歸納了3D視覺技術(shù)在機(jī)器人抓取作業(yè)中面臨的 挑戰(zhàn),對機(jī)器人抓取視覺系統(tǒng)的設(shè)計(jì)方法進(jìn)行了總結(jié),搜集了當(dāng)前主要的3D成像技術(shù)及3D視覺算法,最后給 出了應(yīng)用案例。(1989-),女,湖北人,吉林大學(xué)機(jī)械設(shè)計(jì)及 理論碩士學(xué)位,現(xiàn)就職于上海ABB工程有限公司。

■專欄 智慧機(jī)器人

?

[1] Peter, R, Wurman, and, Joseph, M, Romano. The Amazon Picking Challenge 2015[J]. ROBOTICS & AUTOMATION MAGAZINE, 2015, 1 (1) : 10 - 12.

[2] Zeng A, Yu K T, Song S, et al. Multi-view Self-supervised Deep Learning for 6D Pose Estimation in the Amazon Picking Challenge[J]. 2016 : 1386 - 1383.

[3] Geng J. Structured-light 3D surface imaging: a tutorial[J]. Advances in Optics & Photonics, 2011, 3 (2) : 128 - 160.

[4] Scharstein D, Szeliski R. A Taxonomy and Evaluation of Dense Two-Frame Stereo Correspondence Algorithms[J]. International

Journal of Computer Vision, 2002, 47 (1 - 3 ) : 7 - 42.

[5] MVTec, Software, GmbH. Solution Guide III-C 3D Vision[Z]. Germany: MVTec Software GmbH, 2016.

[6]

Ens J, Lawrence P. An investigation of methods for determining depth

from focus[J]. Pattern Analysis & Machine Intelligence IEEE

Transactions on, 1990, 15 (2) : 97 - 108.

[7] Herbort S, Wo?hler C.

An introduction to image-based 3D surface reconstruction and a survey of

photometric stereo methods[J]. 3d

Research, 2011, 2 (3) : 1 - 17.

[8] Weng J, Ahuja N, Huang T S.

Matching Two Perspective Views[J]. Pattern Analysis & Machine

Intelligence IEEE Transactions on, 1992,

14 (8) : 806 - 825.

[9] Besl P J, Mckay N D. A method for

registration of 3-D shapes[J]. IEEE Transactions on Pattern Analysis

& Machine Intelligence, 1992,

14 (2) : 239 - 256.

[10] Zeng A, Song S, Niebner M, et al. 3DMatch:

Learning Local Geometric Descriptors from RGB-D Reconstructions[J]. 2017

: 199 - 208.

[11] MVTec, Software, GmbH. Solution Guide I Basics[Z]. Germany: MVTec

Software GmbH, 2016.

小白團(tuán)隊(duì)出品:零基礎(chǔ)精通語義分割↓↓↓

交流群

歡迎加入公眾號讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動(dòng)駕駛、計(jì)算攝影、檢測、分割、識(shí)別、醫(yī)學(xué)影像、GAN、算法競賽等微信群(以后會(huì)逐漸細(xì)分),請掃描下面微信號加群,備注:”昵稱+學(xué)校/公司+研究方向“,例如:”張三?+?上海交大?+?視覺SLAM“。請按照格式備注,否則不予通過。添加成功后會(huì)根據(jù)研究方向邀請進(jìn)入相關(guān)微信群。請勿在群內(nèi)發(fā)送廣告,否則會(huì)請出群,謝謝理解~