訓(xùn)練深度學(xué)習(xí)模型,46頁ppt

↑↑↑點(diǎn)擊上方藍(lán)字,回復(fù)資料,10個(gè)G的驚喜

僅做學(xué)術(shù)分享,如有侵權(quán),聯(lián)系刪除 轉(zhuǎn)載于 :專知

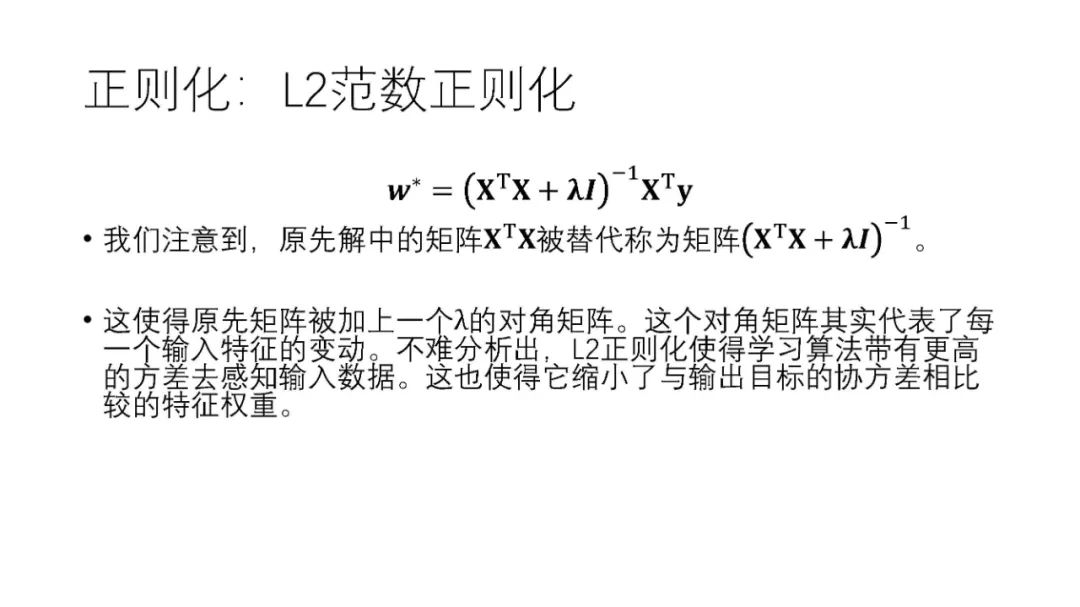

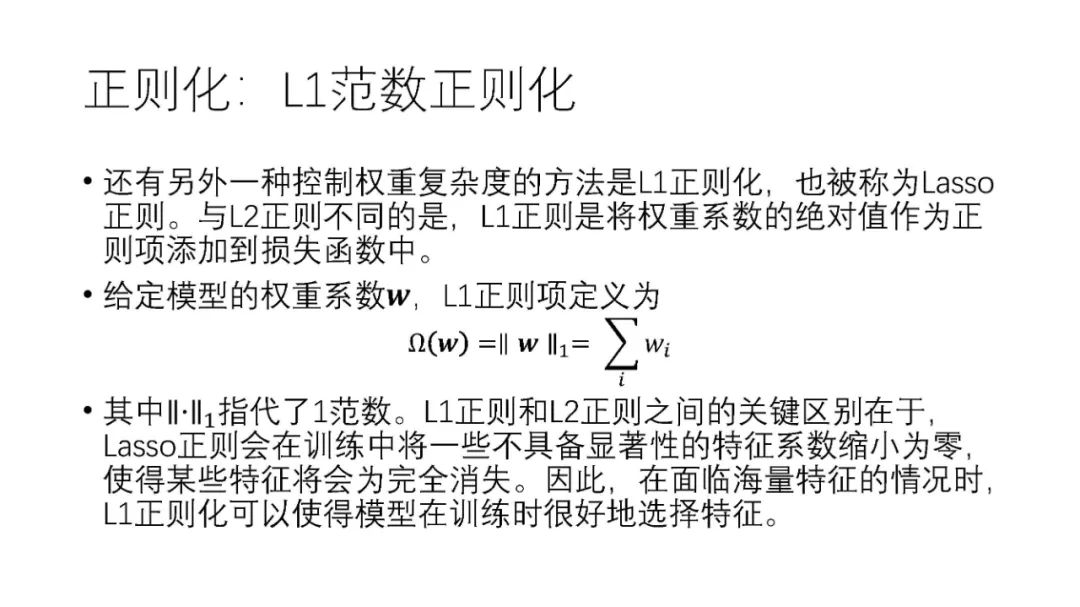

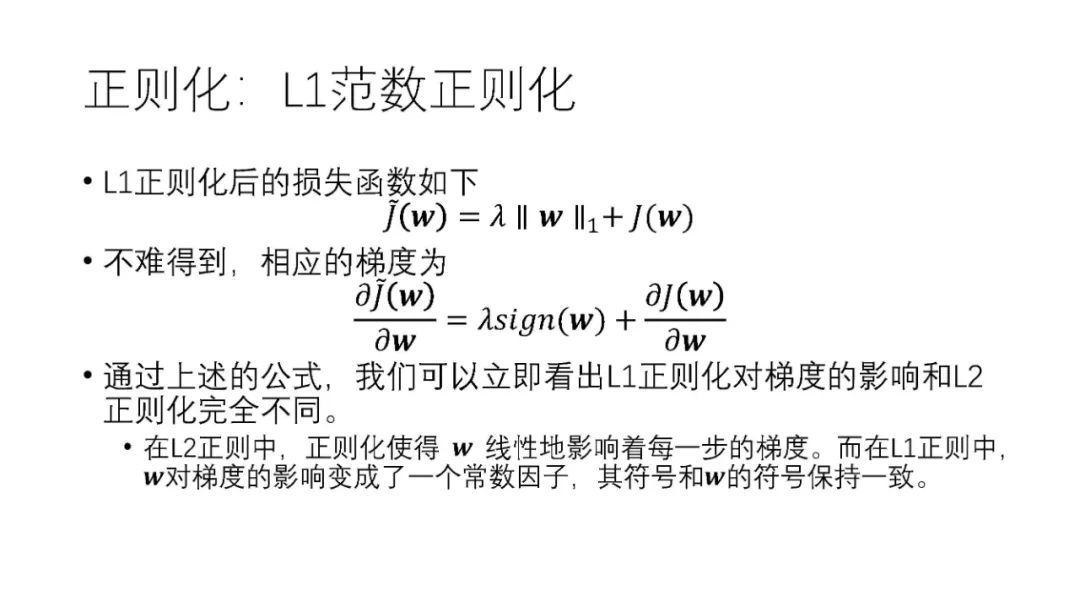

1. 正則化旨在通過對(duì)學(xué)習(xí)算法進(jìn)行修改來減少模型的泛化誤差。? 正則化正是解決深度學(xué)習(xí)中的過擬合和欠擬合問題的一個(gè)途徑。? 正則化往往會(huì)增加模型的訓(xùn)練誤差。

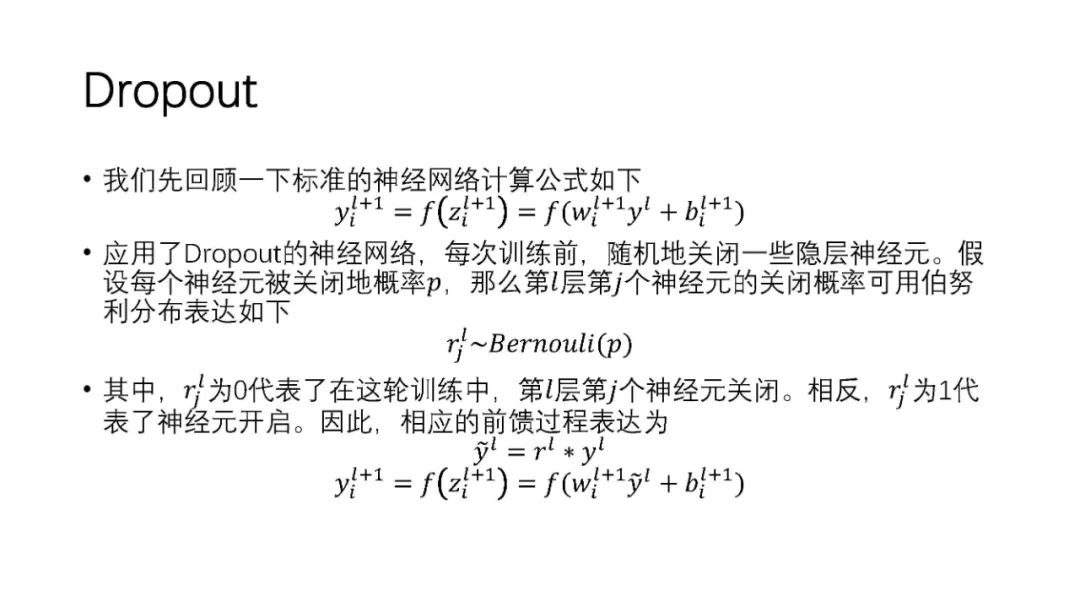

2. Dropout的大體思想就是,在標(biāo)準(zhǔn)神經(jīng)網(wǎng)絡(luò)進(jìn)行前向傳播時(shí),讓某些神經(jīng)元的激活值以一定的概率 停止工作。由于這樣做會(huì)減少模型對(duì)局部特征的依賴,使得模型泛化能力提升,從而緩解過擬合問 題。

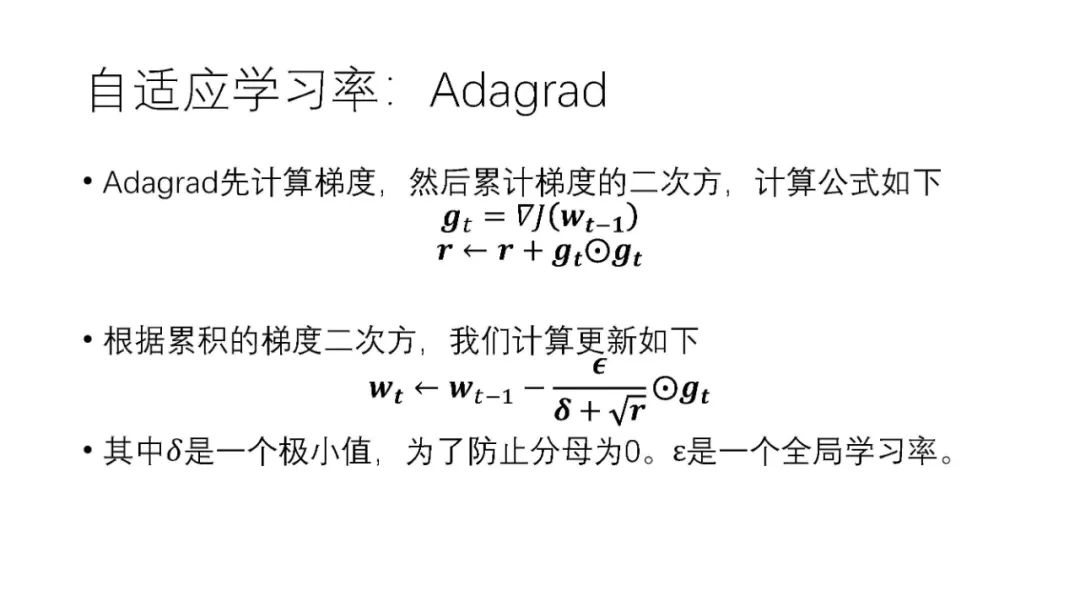

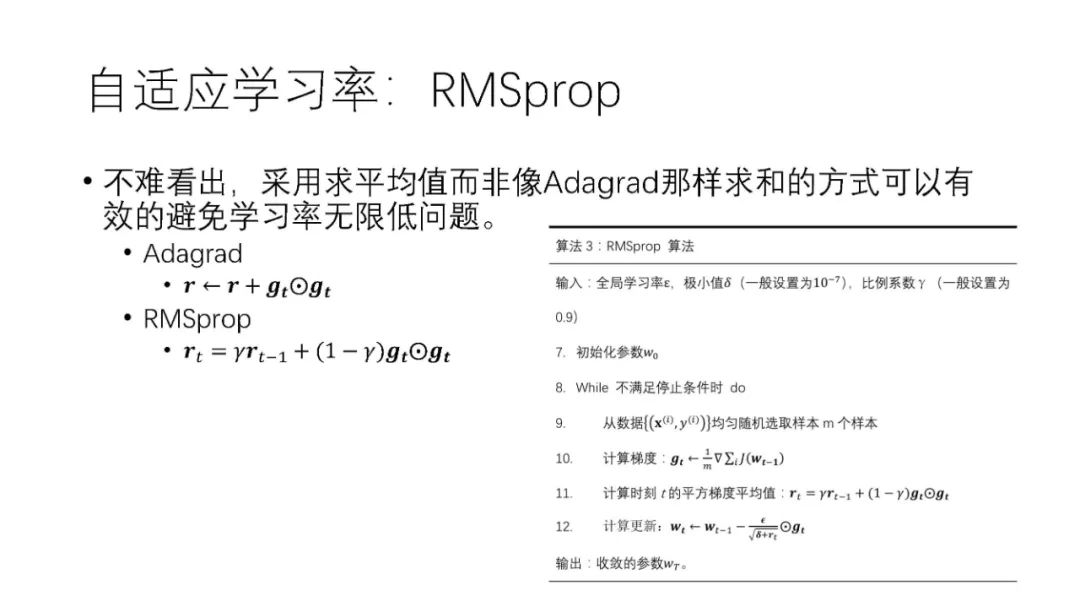

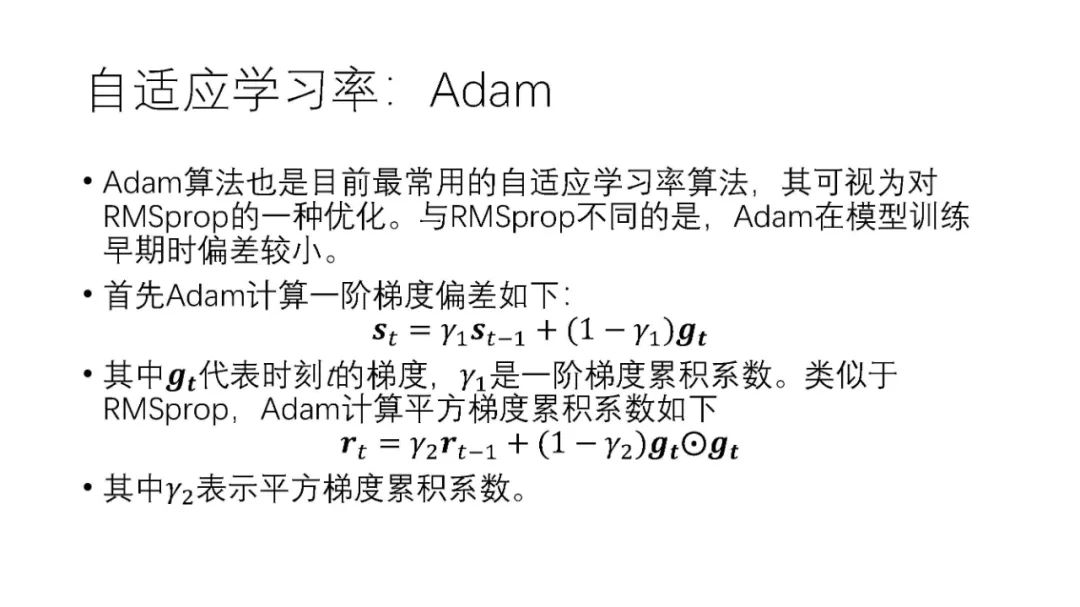

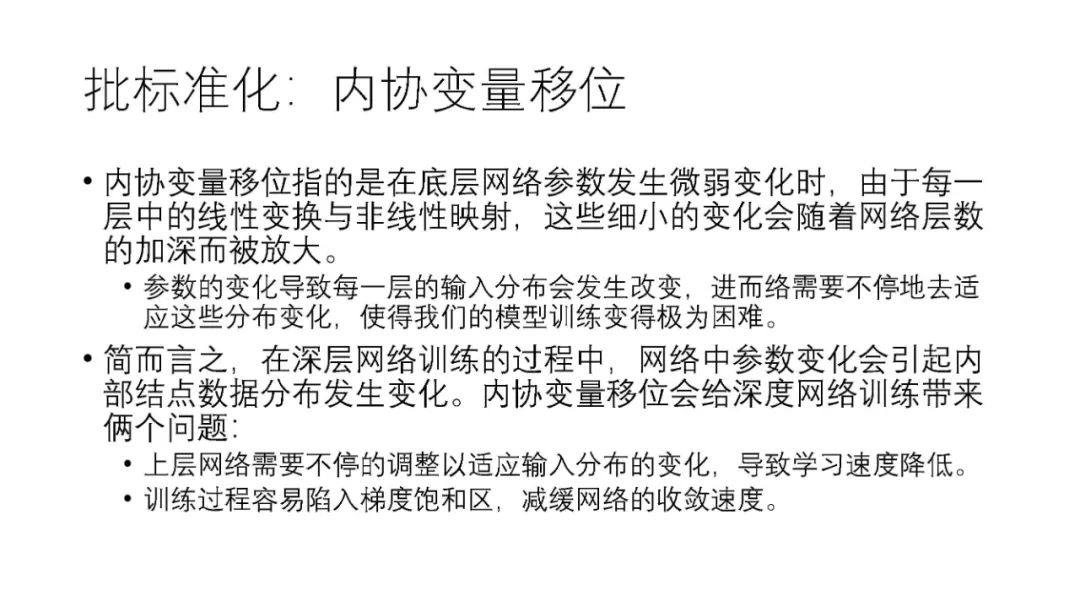

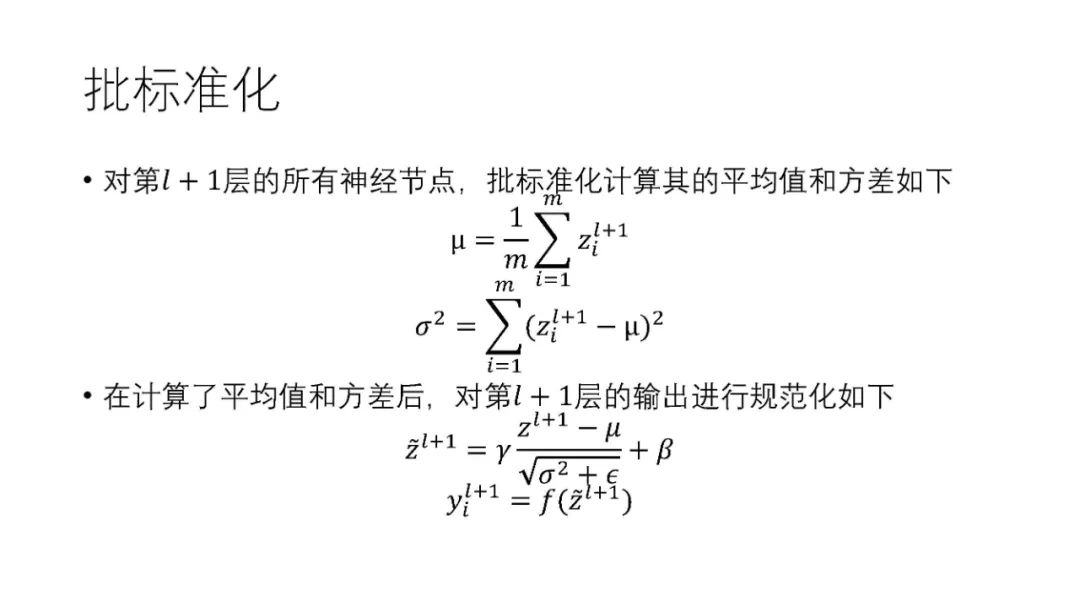

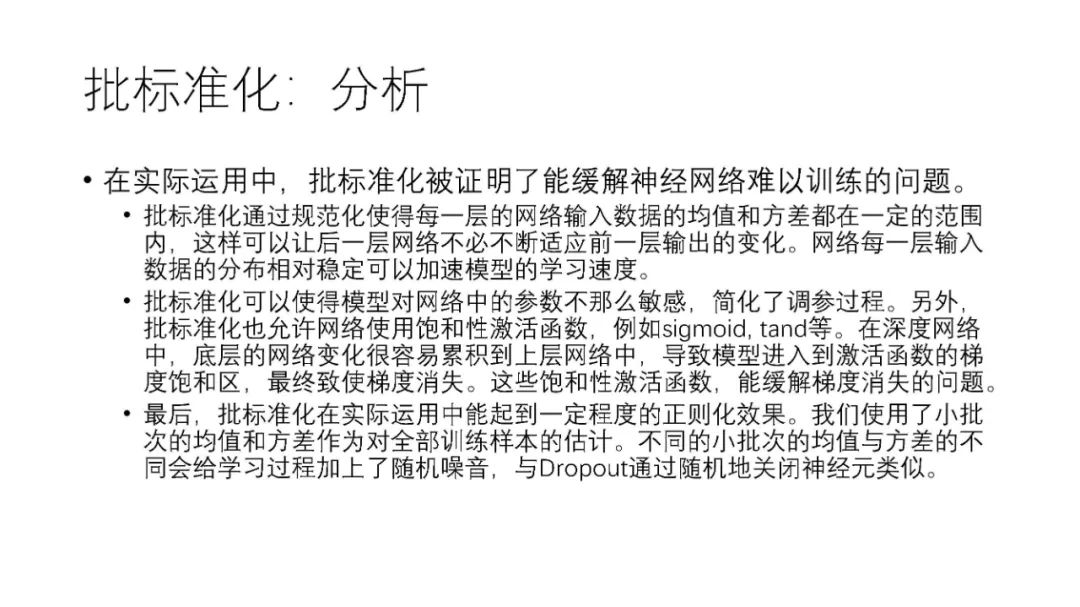

3. 自適應(yīng)學(xué)習(xí)率 指的是在訓(xùn)練過程中學(xué)習(xí)率可變,那么模型收斂速度會(huì)明顯提升。三種常 用的自適應(yīng)學(xué)習(xí)率算法:? Adagrad ? RMSprop ? Adam 4. 批標(biāo)準(zhǔn)化是一種簡化計(jì)算并又能保證數(shù)據(jù)原始的表達(dá)能力的解決內(nèi)協(xié)變量移位問題的方法

也可以加一下老胡的微信 圍觀朋友圈~~~

推薦閱讀

(點(diǎn)擊標(biāo)題可跳轉(zhuǎn)閱讀)

深度學(xué)習(xí)的四個(gè)學(xué)習(xí)階段!

2021年,機(jī)器學(xué)習(xí)研究風(fēng)向要變了?

【機(jī)器學(xué)習(xí)】隨機(jī)森林是我最喜歡的模型

Python之父:Python 4.0可能不會(huì)來了

【2021版】機(jī)器學(xué)習(xí)、深度學(xué)習(xí)調(diào)參手冊

老鐵,三連支持一下,好嗎?↓↓↓