論文推薦:基于GE-MRI的多任務學習

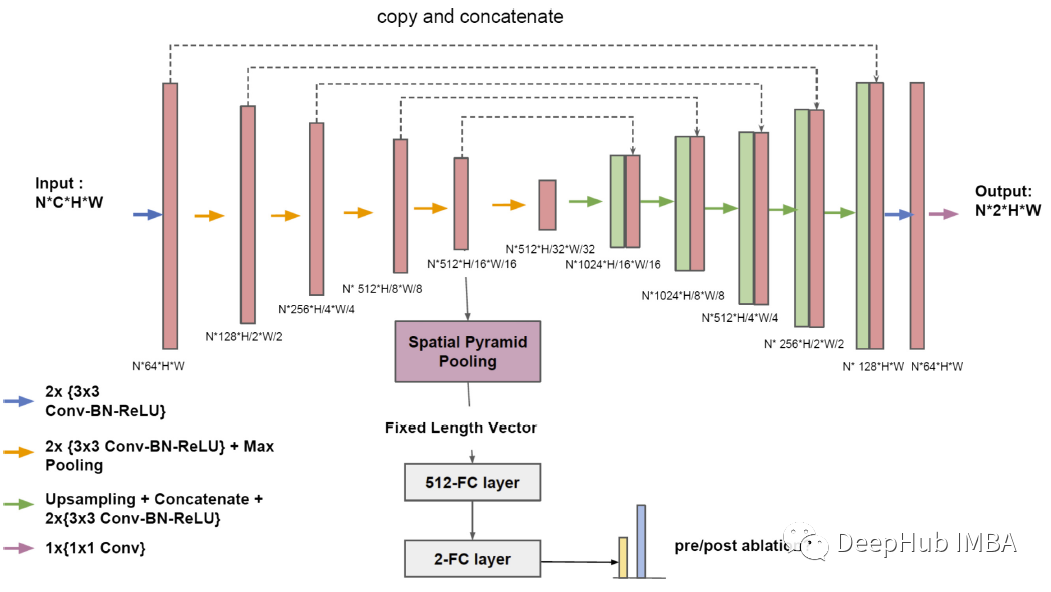

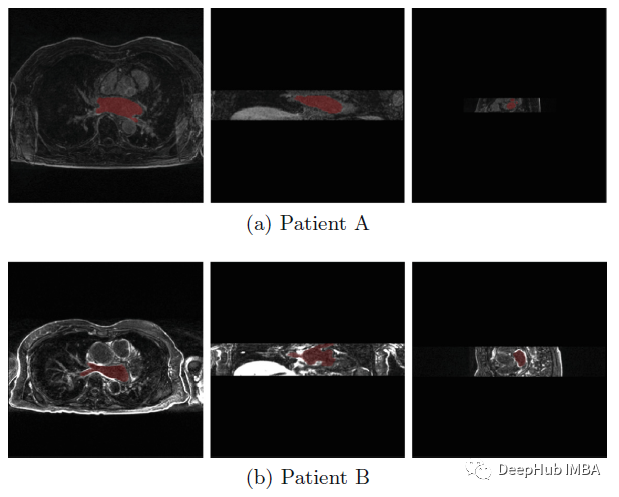

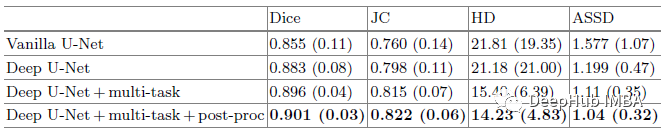

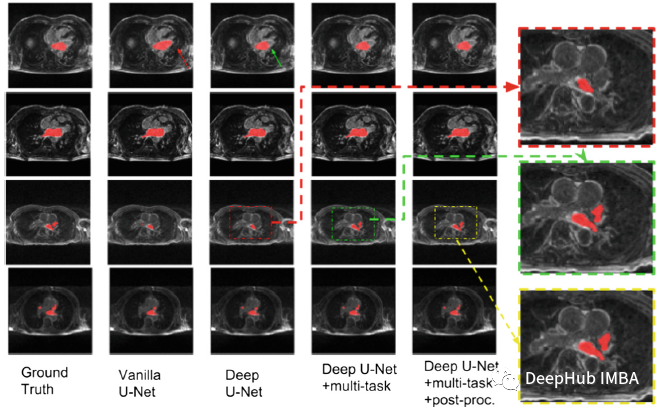

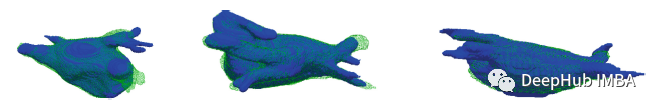

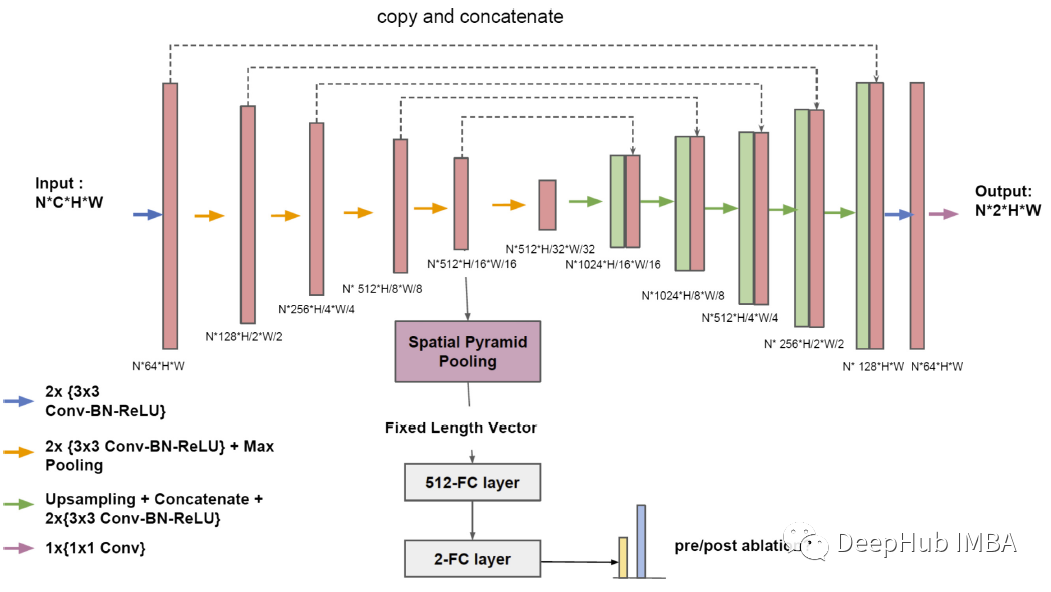

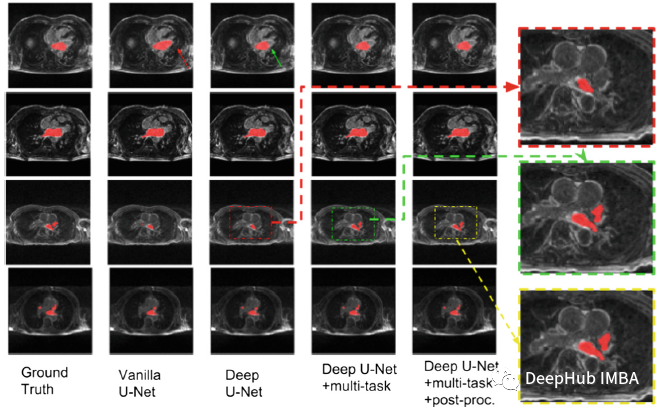

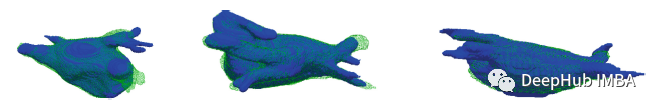

來源:Deephub Imba 本文約1100字,建議閱讀6分鐘 本文提出了一種基于Deep U-Net的多任務學習框架,用于GE-MRI左心房分割,該框架同時執(zhí)行心房分割和消融前后分類。

多任務U-Net

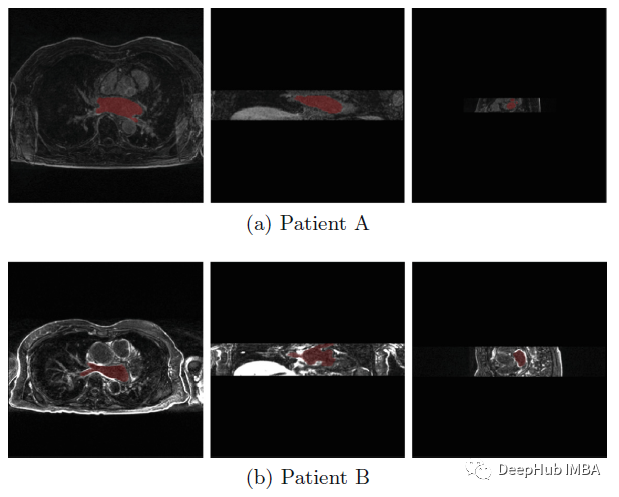

數(shù)據(jù)

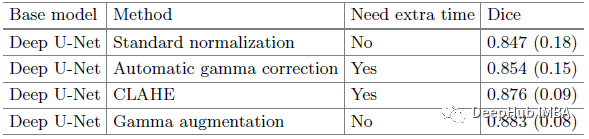

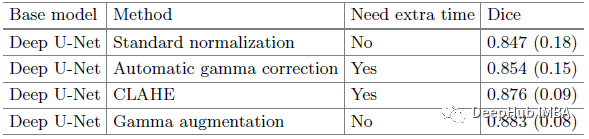

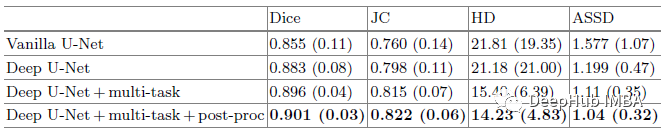

結果

評論

圖片

表情

<b id="afajh"><abbr id="afajh"></abbr></b>

下載APP

下載APP

來源:Deephub Imba 本文約1100字,建議閱讀6分鐘 本文提出了一種基于Deep U-Net的多任務學習框架,用于GE-MRI左心房分割,該框架同時執(zhí)行心房分割和消融前后分類。

<b id="afajh"><abbr id="afajh"></abbr></b>