CVPR | 讓合成圖像更真實(shí),上交大提出基于域驗(yàn)證的圖像和諧化

點(diǎn)擊上方“小白學(xué)視覺”,選擇加"星標(biāo)"或“置頂”

重磅干貨,第一時(shí)間送達(dá)

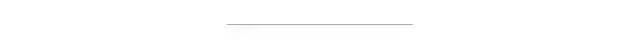

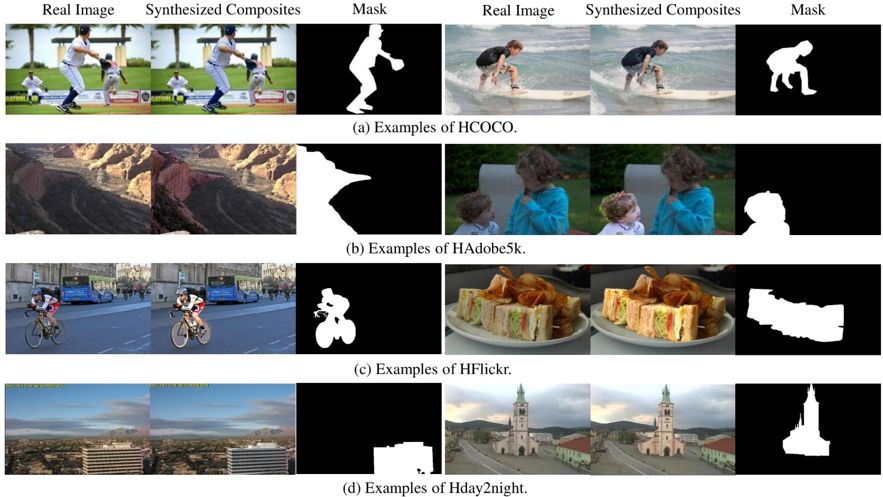

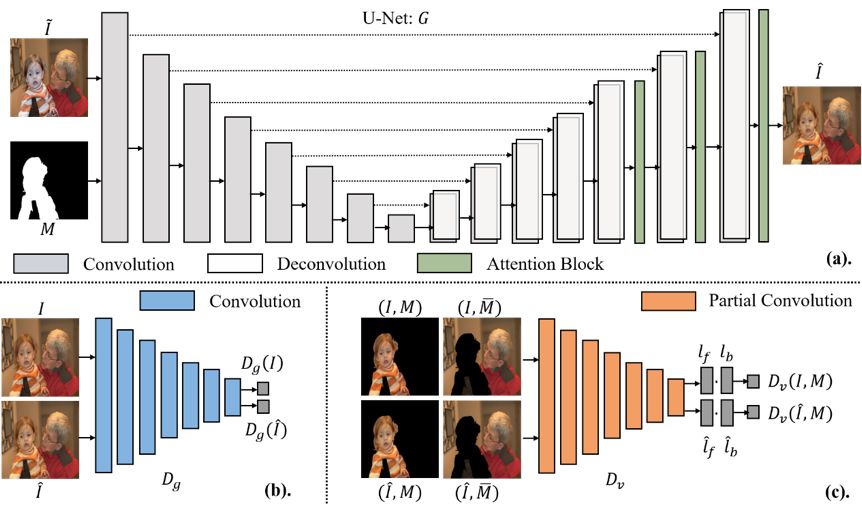

近日,計(jì)算機(jī)視覺頂會(huì) CVPR 2020 接收論文結(jié)果公布,從 6656 篇有效投稿中錄取了 1470 篇論文,錄取率約為 22%。本文介紹了上海交通大學(xué)被此頂會(huì)接收的一篇論文《Deep Image Harmonization via Domain Verification》。

數(shù)據(jù)庫和代碼已公布:?

https://github.com/bcmi/Image_Harmonization_Datasets

論文地址:?https://arxiv.org/abs/1911.13239

交流群

歡迎加入公眾號(hào)讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動(dòng)駕駛、計(jì)算攝影、檢測(cè)、分割、識(shí)別、醫(yī)學(xué)影像、GAN、算法競(jìng)賽等微信群(以后會(huì)逐漸細(xì)分),請(qǐng)掃描下面微信號(hào)加群,備注:”昵稱+學(xué)校/公司+研究方向“,例如:”張三?+?上海交大?+?視覺SLAM“。請(qǐng)按照格式備注,否則不予通過。添加成功后會(huì)根據(jù)研究方向邀請(qǐng)進(jìn)入相關(guān)微信群。請(qǐng)勿在群內(nèi)發(fā)送廣告,否則會(huì)請(qǐng)出群,謝謝理解~

評(píng)論

圖片

表情