改進(jìn)的YOLOv5:AF-FPN替換金字塔模塊提升目標(biāo)檢測精度

重磅干貨,第一時間送達(dá)

計(jì)算機(jī)視覺研究院專欄

作者:Edison_G

隨著世界邁向第四次工業(yè)革命,電動車越來越普遍,但是路上的交通標(biāo)志也五花八門,如果利用計(jì)算機(jī)視覺技術(shù)可以全部檢測識別,那也是一大進(jìn)步!

交通標(biāo)志識別系統(tǒng)化是自動駕駛中最重要的一部分,怎樣去提升交通標(biāo)志檢測和識別技術(shù)的精度和實(shí)時性能,這個也是現(xiàn)在當(dāng)技術(shù)實(shí)際落地時需要解決的重要問題。傳統(tǒng)的CNN通常需要大量的參數(shù)和浮點(diǎn)運(yùn)算 (FLOP) 以達(dá)到準(zhǔn)確性令人滿意的效果,例如ResNet-50有大約2560萬個參數(shù)和需要4.1B FLOPs來處理大小為224×224的圖像。然而,移動設(shè)備(例如智能手機(jī)和自動駕駛汽車)有限的內(nèi)存和計(jì)算資源不能用于大型網(wǎng)絡(luò)的部署和推理。作為一個one-stage檢測器,使用YOLOv5是由于具有計(jì)算量小、速度快的優(yōu)點(diǎn)。

三、新框架詳細(xì)分析

The improved YOLOv5s network framework

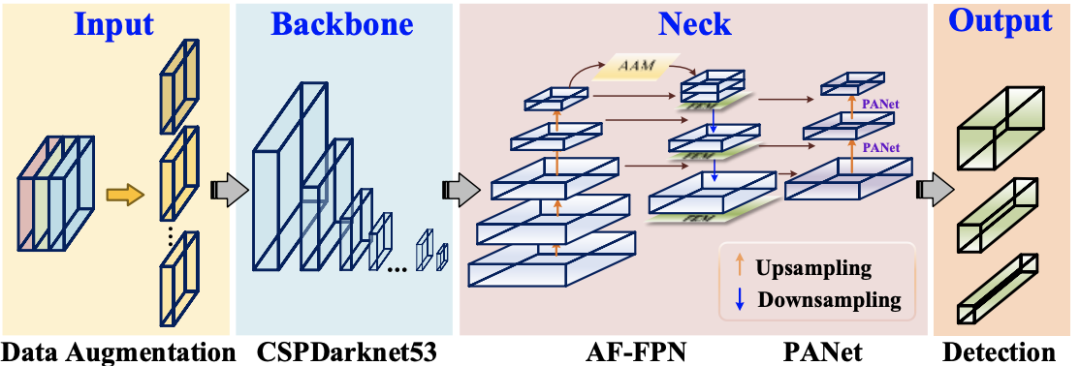

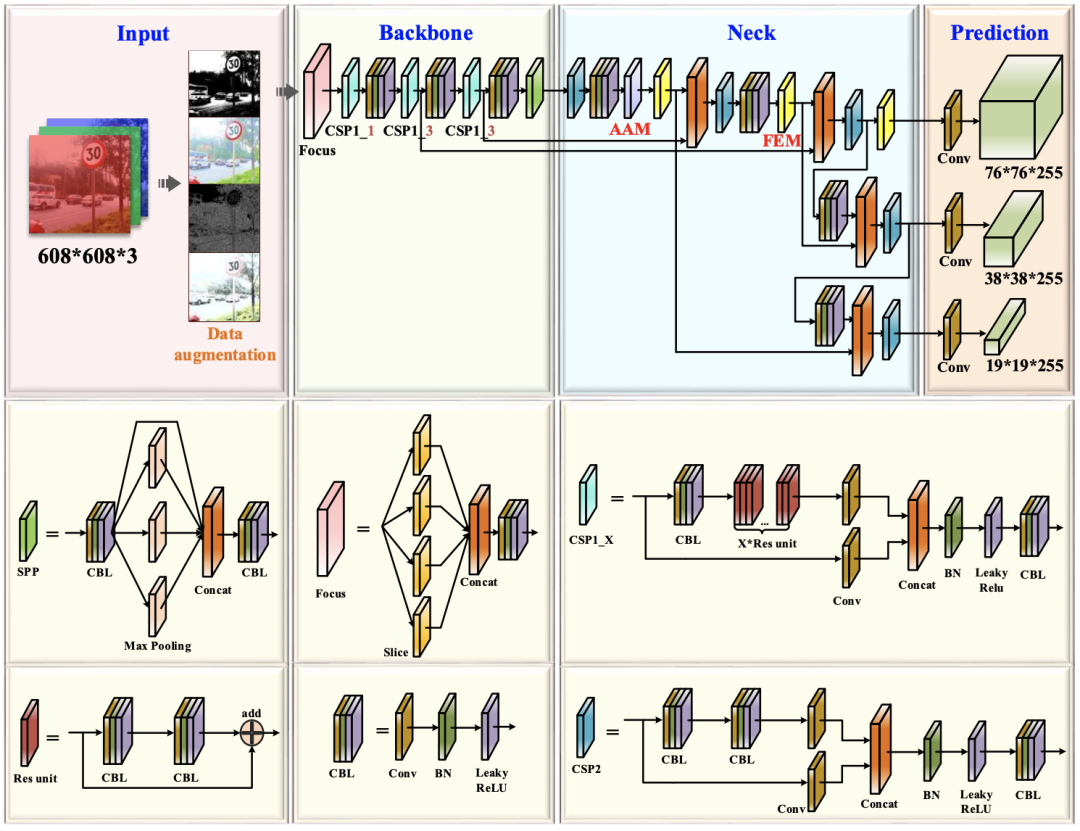

作為當(dāng)前YOLO系列中的最新框架,卓越的YOLOv5其靈活性使其便于快速在車輛硬件方面進(jìn)行部署。YOLOv5包含四個模型,分別是YOLOv5s、YOLOv5m、YOLOv5l和YOLOv5x。YOLOv5s是YOLO系列最小的模型,更適合部署在車載移動硬件平臺,由于其內(nèi)存大小為14.10M,但識別精度達(dá)不到準(zhǔn)確、高效識別的要求,尤其是用于識別小規(guī)模目標(biāo)。YOLOv5的基本框架可以分為四個部分:input、backbone、neck和prediction。Input部分通過數(shù)據(jù)增強(qiáng)來豐富數(shù)據(jù)集,它具有對硬件設(shè)備要求低,計(jì)算量成本低。但是它會導(dǎo)致數(shù)據(jù)集中原來的小目標(biāo)變小,從而導(dǎo)致數(shù)據(jù)集的惡化,降低模型的泛化性能。Backbone部分主要由CSP模塊組成,它們通過CSPDarknet53執(zhí)行特征提取。FPN和PANet用于聚合Neck現(xiàn)階段的圖像特征。最后,網(wǎng)絡(luò)通過Prediction進(jìn)行目標(biāo)預(yù)測和輸出。

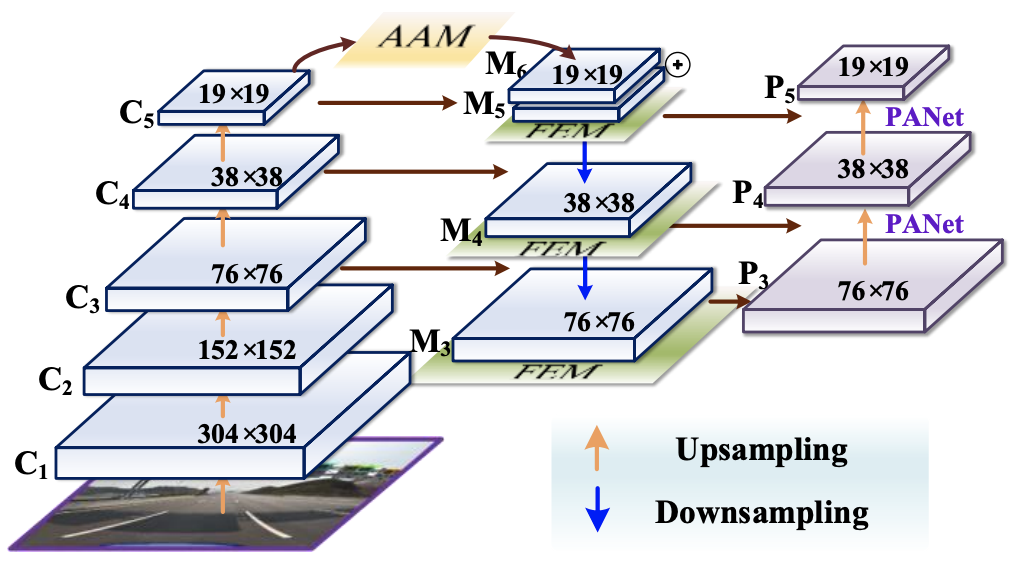

研究者引入AF-FPN和自動學(xué)習(xí)數(shù)據(jù)增強(qiáng)來解決模型大小和識別精度不兼容的問題,進(jìn)一步提高模型的識別性能。將原有的FPN結(jié)構(gòu)替換為AF-FPN,以提高識別多尺度目標(biāo)的能力,并在識別速度和準(zhǔn)確率之間做出有效的權(quán)衡。

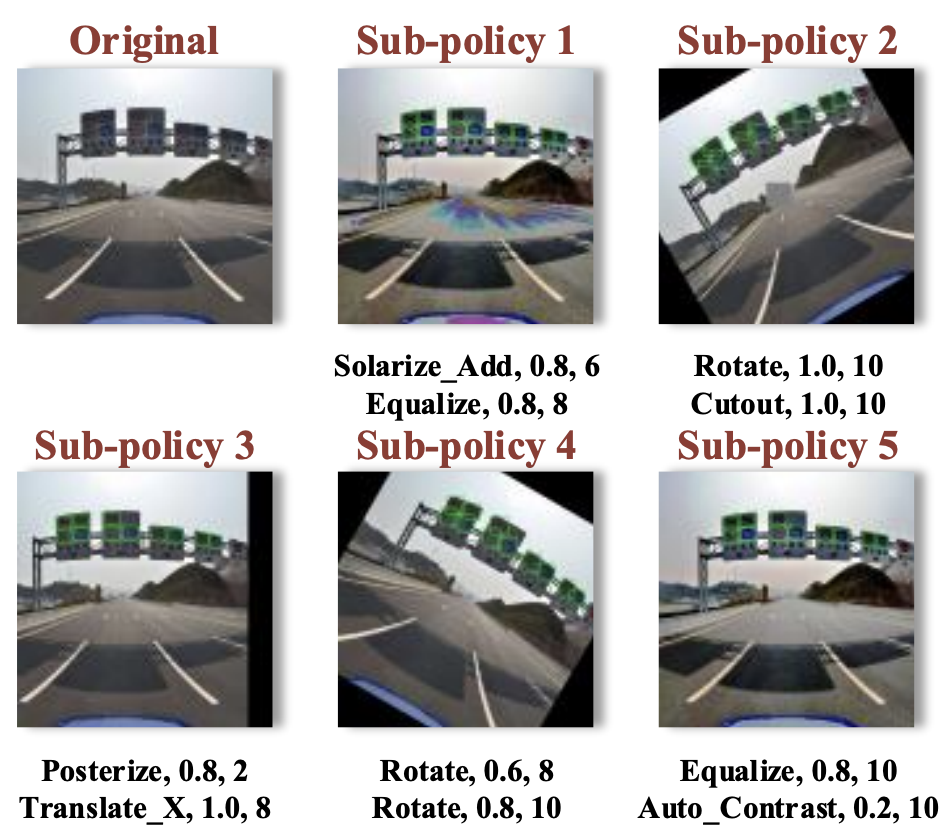

此外,研究者去除原始網(wǎng)絡(luò)中的mosaic augmentation,并根據(jù)自動學(xué)習(xí)數(shù)據(jù)增強(qiáng)策略使用最佳數(shù)據(jù)增強(qiáng)方法來豐富數(shù)據(jù)集并提高訓(xùn)練效果。改進(jìn)后的YOLOv5s網(wǎng)絡(luò)結(jié)構(gòu)如下圖所示。

AF-FPN structure

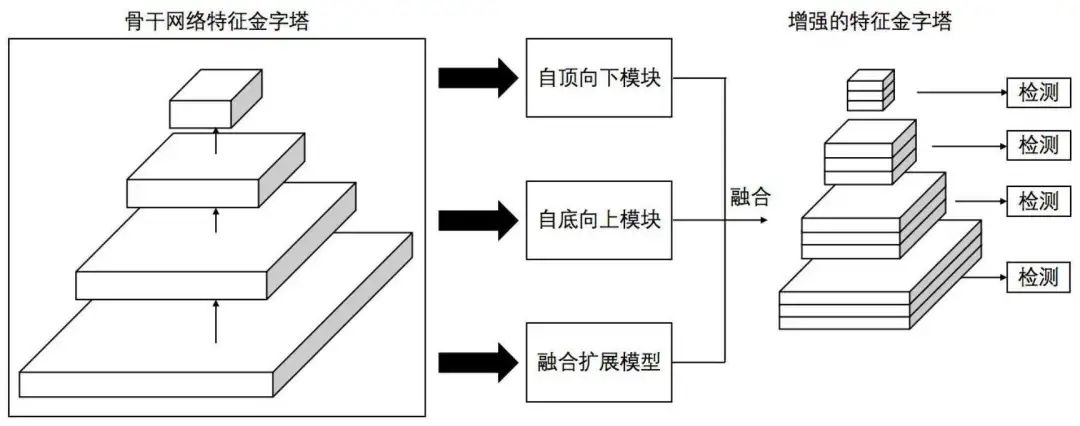

AF-FPN在傳統(tǒng)特征金字塔網(wǎng)絡(luò)的基礎(chǔ)上,增加了自適應(yīng)注意力模塊(AAM)和特征增強(qiáng)模塊(FEM)。前一部分由于減少了特征通道,減少了在高層特征圖中上下文信息的丟失;后一部分增強(qiáng)了特征金字塔的表示并加快了推理速度,同時實(shí)現(xiàn)了最先進(jìn)的性能。AF-FPN的結(jié)構(gòu)如下圖所示。

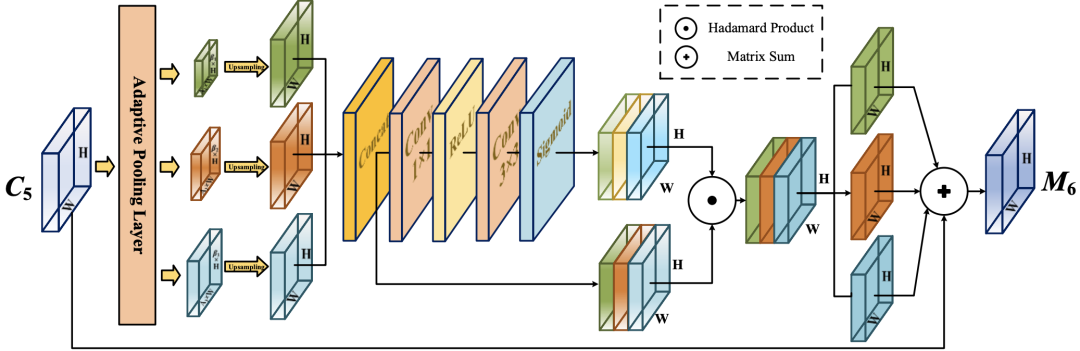

AAM的具體結(jié)構(gòu)如下圖所示,作為自適應(yīng)注意力模塊的輸入,C5的大小為S=h×w。它首先通過自適應(yīng)池化層獲得不同尺度(β1×S,β2×S,β3×S)的上下文特征。然后每個上下文特征經(jīng)過1×1卷積,得到相同的通道維度256。使用雙線性插值將它們上采樣到S的尺度,用于后續(xù)融合。

空間注意力機(jī)制通過一個Concat層將三個上下文特征的通道合并,然后特征圖依次通過1×1卷積層、ReLU激活層、3×3卷積層和sigmoid激活層生成對應(yīng)的空間權(quán)重。生成的權(quán)重圖和合并通道后的特征圖進(jìn)行Hadamard乘積運(yùn)算,分離后加入到輸入特征圖M5中,將上下文特征聚合到M6中。最終的特征圖具有豐富的多尺度上下文信息,在一定程度上緩解了由于通道數(shù)減少而造成的信息丟失。

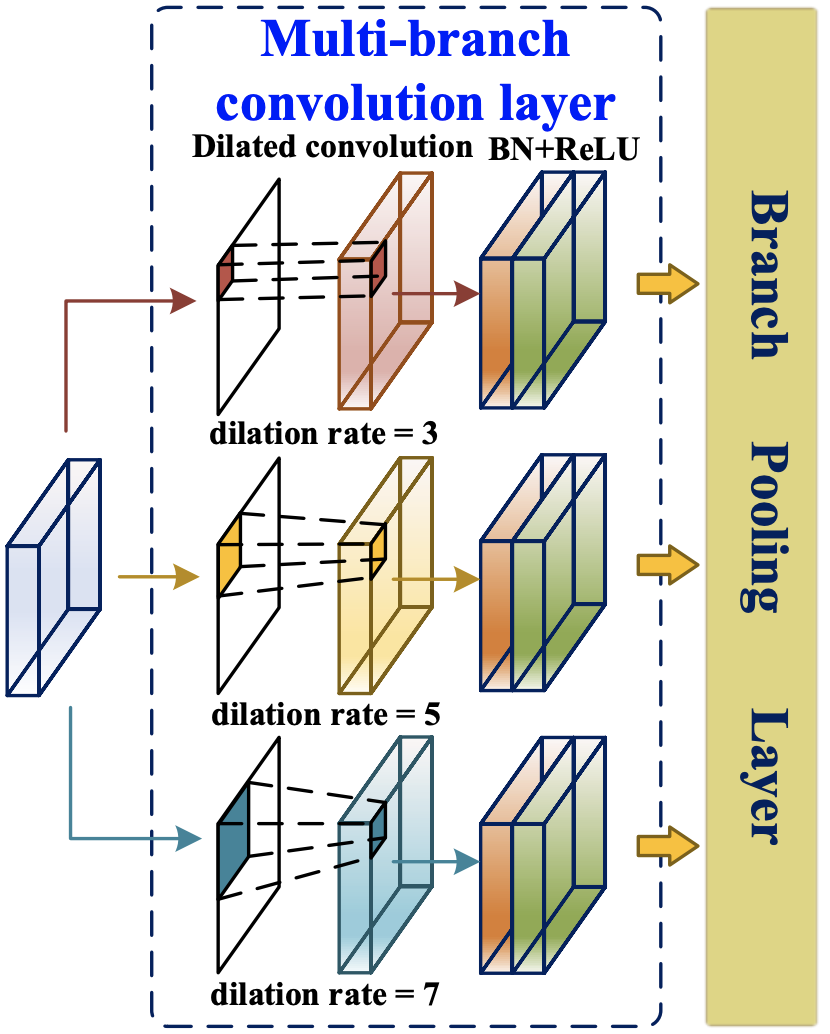

FEM主要利用空洞卷積根據(jù)檢測到的交通標(biāo)志的不同尺度自適應(yīng)學(xué)習(xí)每個特征圖中不同的感受野,從而提高多尺度目標(biāo)檢測和識別的準(zhǔn)確性。如上圖所示,它可以分為兩個部分:多分支卷積層和多分支池化層。多分支卷積層用于通過空洞卷積為輸入特征圖提供不同大小的感受野。并且平均池化層用于融合來自三個分支感受野的交通信息,以提高多尺度預(yù)測的準(zhǔn)確性。

Data Augmentation

數(shù)據(jù)增強(qiáng)我就簡單描述下,具體如下示例:

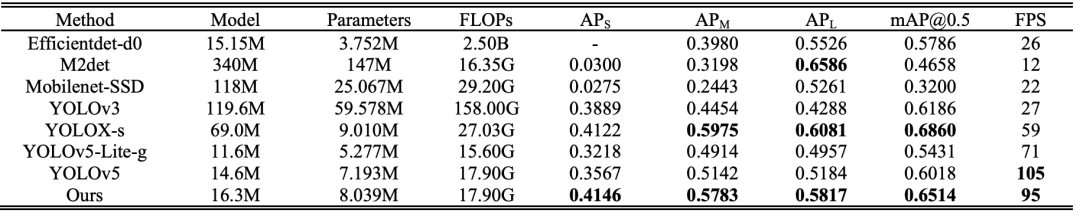

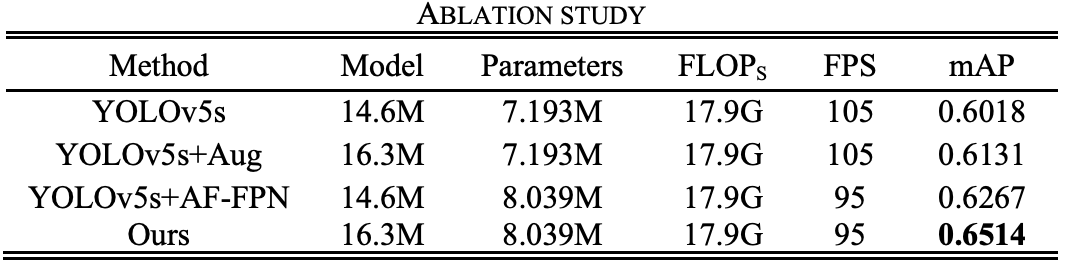

四、實(shí)驗(yàn)結(jié)果及可視化

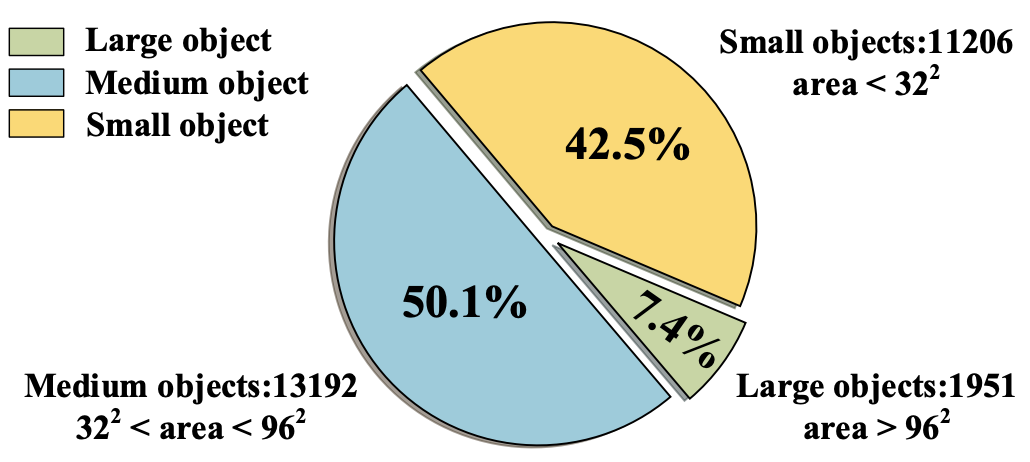

Size distribution of sign instances from the TT100K

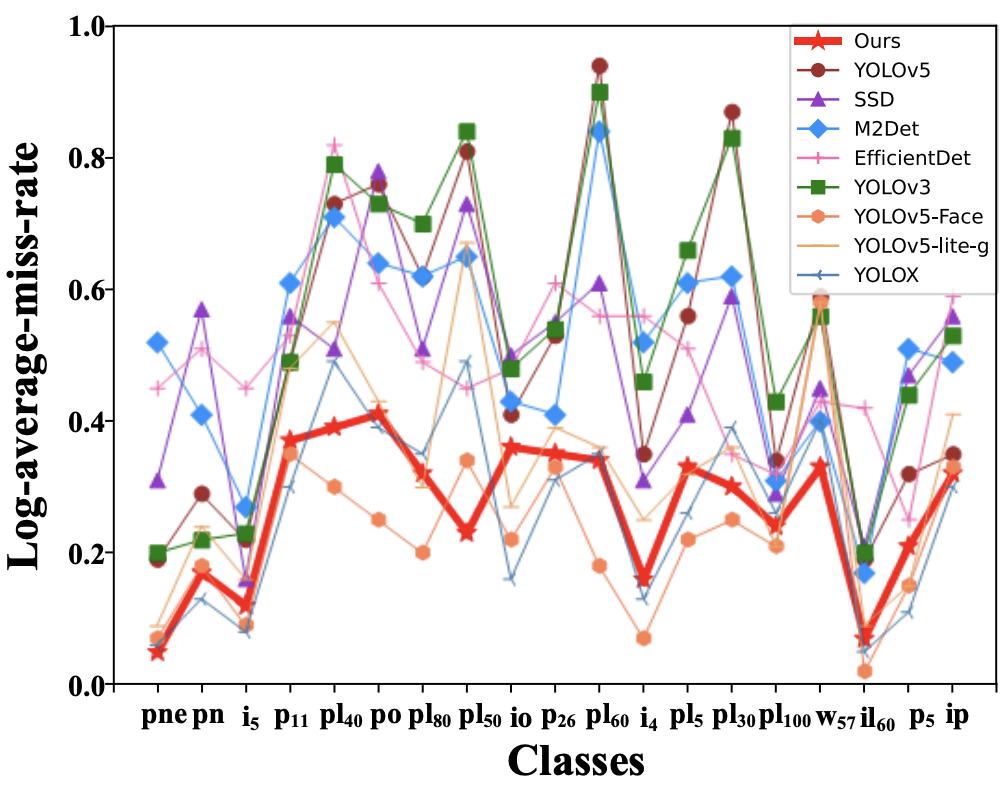

每種方法對19種交通標(biāo)志的漏檢率比較

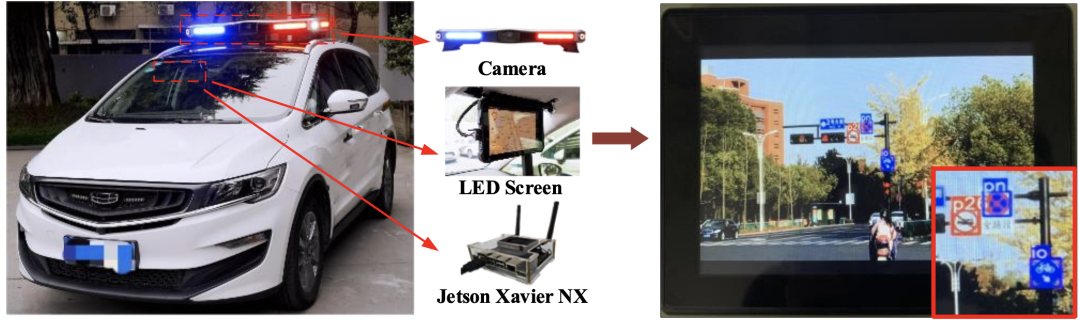

移動設(shè)備部署及通過攝像頭拍攝的檢測實(shí)例

交流群

歡迎加入公眾號讀者群一起和同行交流,目前有美顏、三維視覺、計(jì)算攝影、檢測、分割、識別、醫(yī)學(xué)影像、GAN、算法競賽等微信群

個人微信(如果沒有備注不拉群!) 請注明:地區(qū)+學(xué)校/企業(yè)+研究方向+昵稱

下載1:何愷明頂會分享

在「AI算法與圖像處理」公眾號后臺回復(fù):何愷明,即可下載。總共有6份PDF,涉及 ResNet、Mask RCNN等經(jīng)典工作的總結(jié)分析

下載2:終身受益的編程指南:Google編程風(fēng)格指南

在「AI算法與圖像處理」公眾號后臺回復(fù):c++,即可下載。歷經(jīng)十年考驗(yàn),最權(quán)威的編程規(guī)范!

下載3 CVPR2021 在「AI算法與圖像處理」公眾號后臺回復(fù):CVPR,即可下載1467篇CVPR?2020論文 和 CVPR 2021 最新論文