一、簡介

從2010年開始,深度學習方法為語音識別,圖像識別和自然語言處理領域帶來了巨大的變革。這些領域中的任務都只涉及單模態(tài)的輸入,但是最近更多的應用都需要涉及到多種模態(tài)的智慧。多模態(tài)深度學習主要包含三個方面:多模態(tài)學習表征,多模態(tài)信號融合以及多模態(tài)應用,而本文主要關注計算機視覺和自然語言處理的相關融合方法,包括網(wǎng)絡結構設計和模態(tài)融合方法(對于特定任務而言)。

二、多模態(tài)融合辦法

多模態(tài)融合是多模態(tài)研究中非常關鍵的研究點,它將抽取自不同模態(tài)的信息整合成一個穩(wěn)定的多模態(tài)表征。多模態(tài)融合和表征有著明顯的聯(lián)系,如果一個過程是專注于使用某種架構來整合不同單模態(tài)的表征,那么就被歸類于fusion類。而fusion方法又可以根據(jù)他們出現(xiàn)的不同位置而分為late和early fusion。因為早期和晚期融合會抑制模內(nèi)或者模間的交互作用,所以現(xiàn)在的研究主要集中于intermediate的融合方法,讓這些fusion操作可以放置于深度學習模型的多個層之中。而融合文本和圖像的方法主要有三種:基于簡單操作的,基于注意力的,基于張量的方法。

a) 簡單操作融合辦法

來自不同的模態(tài)的特征向量可以通過簡單地操作來實現(xiàn)整合,比如拼接和加權求和。這樣的簡單操作使得參數(shù)之間的聯(lián)系幾乎沒有,但是后續(xù)的網(wǎng)絡層會自動對這種操作進行自適應。

l Concatenation拼接操作可以用來把低層的輸入特征[1][2][3]或者高層的特征(通過預訓練模型提取出來的特征)[3][4][5]之間相互結合起來。

l Weighted sum 對于權重為標量的加權求和方法,這種迭代的辦法要求預訓練模型產(chǎn)生的向量要有確定的維度,并且要按一定順序排列并適合element-wise 加法[6]。為了滿足這種要求可以使用全連接層來控制維度和對每一維度進行重新排序。

最近的一項研究[7]采用漸進探索的神經(jīng)結構搜索[8][9][10]來為fusion找到合適的設置。根據(jù)要融合的層以及是使用連接還是加權和作為融合操作來配置每個融合功能。

b) 基于注意力機制的融合辦法

很多的注意力機制已經(jīng)被應用于融合操作了。注意力機制通常指的是一組“注意”模型在每個時間步動態(tài)生成的一組標量權重向量的加權和[11][12]。這組注意力的多個輸出頭可以動態(tài)產(chǎn)生求和時候要用到的權重,因此最終在拼接時候可以保存額外的權重信息。在將注意機制應用于圖像時,對不同區(qū)域的圖像特征向量進行不同的加權,得到一個最終整體的圖像向量。

圖注意力機制

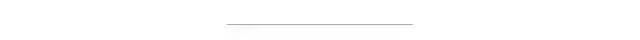

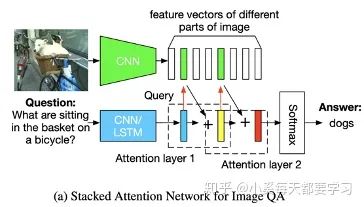

擴展了用于文本問題處理的LSTM模型,加入了基于先前LSTM隱藏狀態(tài)的圖像注意模型,輸入為當前嵌入的單詞和參與的圖像特征的拼接[13]。最終LSTM的隱藏狀態(tài)就被用于一種多模態(tài)的融合的表征,從而被應用于VQA問題之中。這種基于RNN的encoder-decoder模型被用來給圖像特征分配權重從而做image caption任務[14]。此外,對于VQA視覺問答任務,attention模型還能通過文本query來找到圖像對應得位置[15]。同樣,堆疊注意力網(wǎng)絡(SANs)也被提出使用多層注意力模型對圖像進行多次查詢,逐步推斷出答案,模擬了一個多步驟的推理過程[16]。通過多次迭代實現(xiàn)圖像區(qū)域的Attention。首先根據(jù)圖像特征和文本特征生成一個特征注意分布,根據(jù)這個分布得到圖像每個區(qū)域權重和Vi,根據(jù)u=Vi+Vq得到一個refine query向量。將這個過程

多次迭代最終注意到問題相關區(qū)域。當然和san很像的還有[17]。

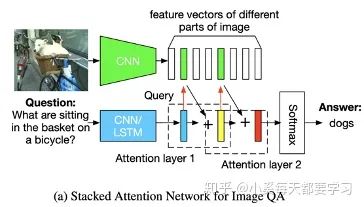

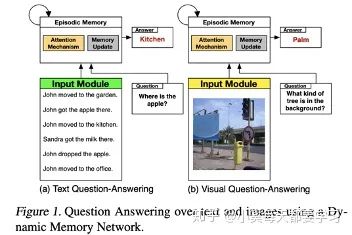

一種動態(tài)記憶網(wǎng)絡也被升級了并用來分別編碼問題和圖像。這種網(wǎng)絡則使用了基于attention的GRUs來更新情景記憶和檢索所需信息[18]。

自底向上和自頂向下的注意方法(Up-Down),顧名思義,通過結合兩種視覺注意機制來模擬人類的視覺系統(tǒng)[19].自下而上的注意力機制是通過使用目標檢測算法(如faster rcnn)來首先挑選出一些列的圖像候選區(qū)域,而自上而下的注意力機制則是要把視覺信息和語義特征拼接從而生成一個帶有注意力的圖像特征向量,最終服務于圖像描述和VQA任務。同時,帶有注意力的圖像特征向量還可以和文本向量進行點乘。來自不同模型(resnet和faster rcnn)的互補圖像特征也可以被用于多種圖像注意力機制[20]。更進一步,圖像注意力機制的逆反應用,可以從輸入的圖像+文本來生成文本特征,還可以用于文本生成圖像的任務[21]。

圖和文本的對稱注意力機制

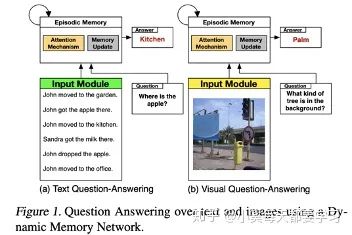

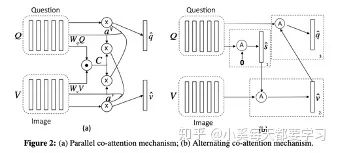

與上述圖像注意機制不同,共注意機制使用對稱注意力結構生成attended圖像特征向量和attended語言向量[22]。平行共注意力機制采用聯(lián)合表示的方法模擬推導出圖像和語言的注意分布。交替共同注意力機制具有級聯(lián)結構,首先使用語言特征生成含有注意力的圖像向量,然后使用含有注意力的圖像向量生成出含注意力的語言向量。

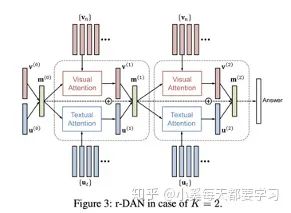

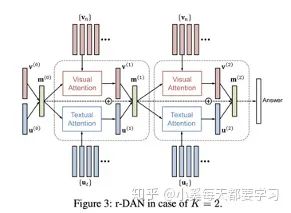

和平行共注意力機制類似,雙注意力網(wǎng)絡(DAN)同時估計圖像和文本的注意力分布從而獲得最后的注意力特征向量[23]。這種注意模型以特征和與相關模式相關的記憶向量為條件。與共同注意相比,這是一個關鍵的區(qū)別,因為記憶向量可以使用重復的DAN結構在每個推理步驟中迭代更新。

堆疊的latent attention (SLA)改進了SAN,它把圖像的原始特征和網(wǎng)絡淺層的向量連接,以保存中間推理階段的潛在信息[24]。當然還包括一種類似雙流的并行共注意結構,用于同時注意圖像和語言特征,這便于使用多個SLA層進行迭代推理。雙遞歸注意單元利用文本和圖像的LSTM模型實現(xiàn)了一個并行的共注意結構,在使用CNN層堆棧卷積圖像特征得到的表示中為每個輸入位置分配注意權值[25]。為了模擬兩種數(shù)據(jù)模式之間的高階交互作用,可以將兩種數(shù)據(jù)模式之間的高階相關性作為兩種特征向量的內(nèi)積來計算,從而得到兩種模式的交互的注意力特征向量[26]。

雙模的transformer的注意力機制

這部分主要是基于BERT的變體,采用雙流輸入embedding方法,然后再后續(xù)的共注意力層中進行交互。

其他類似注意力的機制

門控多模態(tài)單元是一種基于門控的方法,可以看作是為圖像和文本分配注意權重[27]。該方法是基于門控機制動態(tài)生成的維度特定標量權重,計算視覺特征向量和文本特征向量的加權和。類似的,向量按位乘法可以用于融合視覺和文本表達。然后將這些融合的表示方法用于構建基于深度殘差學習的多模態(tài)殘差網(wǎng)絡[27]。還有就是動態(tài)參數(shù)預測網(wǎng)絡,它采用動態(tài)權值矩陣來變換視覺特征向量,其參數(shù)由文本特征向量哈希動態(tài)生成[28]。

c) 基于雙線性池化的融合辦法

雙線性池化主要用于融合視覺特征向量和文本特征向量來獲得一個聯(lián)合表征空間,方法是計算他們倆的外積,這種辦法可以利用這倆向量元素的所有的交互作用,也被稱作second-order pooling[30]。和簡單地向量組合操作(假設每個模態(tài)的特征向量有n個元素)不一樣的是,簡單操作(如加權求和,按位操作,拼接)都會生成一個n或者2n維度的表征向量,而雙線性池化則會產(chǎn)生一個n平方維度的表征。通過將外積生成的矩陣線性化成一個向量表示,這意味著這種方法更有表現(xiàn)力。雙線性表示方法常常通過一個二維權重矩陣來轉(zhuǎn)化為相應的輸出向量,也等價于使用一個三維的tensor來融合兩個輸入向量。在計算外積時,每個特征向量可以加一個1,以在雙線性表示中保持單模態(tài)輸入特征[32]。然而,基于它的高維數(shù)(通常是幾十萬到幾百萬維的數(shù)量級),雙線性池通常需要對權值張量進行分解,才可以適當和有效地訓練相關的模型。

雙線性池化的因式分解

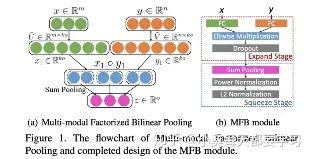

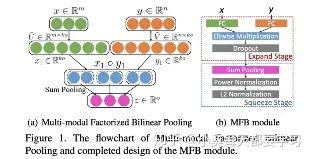

由于雙線性出來的表征與多項式核密切相關,因此可以利用各種低維近似來獲得緊的雙線性表示[32]。Count sketch和卷積能夠用來近似多項式核[33][34],從而催生出了多模態(tài)緊湊雙線性池化multimodal compact bilinear pooling MCB[35]。或者,通過對權值張量施加低秩控制,多模態(tài)低秩雙線性池(MLB)將雙線性池的三維權值張量分解為三個二維權值矩陣[36]。具體的來說,視覺和文字特征向量通過兩個輸入因子矩陣線性投影到低維矩陣上。然后使用按元素的乘法將這些因子融合,然后使用第三個矩陣對輸出因子進行線性投影。多模態(tài)因子分解雙線性池化Multimodal factorized bilinear pooling (MFB)對MLB進行了修改,通過對每個非重疊的一維窗口內(nèi)的值求和,將元素間的乘法結果集合在一起[37]。多個MFB模型可以級聯(lián)來建模輸入特性之間的高階交互,這被稱為多模態(tài)因數(shù)化高階池(MFH)[38]。

MUTAN是一種基于多模態(tài)張量的Tucker decomposition方法,使用Tucker分解[39]將原始的三維權量張量算子分解為低維核心張量和MLB使用的三個二維權量矩陣[40]。核心張量對不同形式的相互作用進行建模。MCB可以看作是一個具有固定對角輸入因子矩陣和稀疏固定核張量的MUTAN, MLB可以看作是一個核張量為單位張量的MUTAN。

而最新的AAAI2019提出了BLOCK,是一個基于塊的超對角陣的融合框架[41],是為了塊項的消解和合成[42]。BLOCK將MUTAN泛化為多個MUTAN模型的總和,為模式之間的交互提供更豐富的建模。此外,雙線性池化可以推廣到兩種以上的modality,例如使用外積來建模視頻、音頻和語言表示之間的交互[43]。

雙線性池化和注意力機制

雙線性池化和注意力機制也可以進行結合。MCB/MLB融合的雙模態(tài)表示可以作為注意力模型的輸入特征,得到含有注意力的圖像特征向量,然后再使用MCB/MLB與文本特征向量融合,形成最終的聯(lián)合表示[44][45]。MFB/MFH可用于交替的共同注意學習聯(lián)合表示[46][47]。

雙線性注意網(wǎng)絡(BAN)利用MLB融合圖像和文本,生成表示注意力分布的雙線性注意圖,并將其作為權重張量進行雙線性pooling,再次融合圖像和文本特征[48]。

三、總結

近年來最主要的多模態(tài)融合辦法就是基于attention的和基于雙線性池化的方法。其中雙線性池化的數(shù)學有效性方面還可以有很大的提升空間。

Zhang, C., Yang, Z., He, X., & Deng, L. (2020). Multimodal intelligence: Representation learning, information fusion, and applications.IEEE Journal of Selected Topics in Signal Processing.

參考文獻:

[1] B. Nojavanasghari, D. Gopinath, J. Koushik, B. T., and L.-P. Morency, “Deep multimodal fusion for persuasiveness prediction,” in Proc. ICMI, 2016[2] H. Wang, A. Meghawat, L.-P. Morency, and E. Xing, “Select-additive learning: Improving generalization in multimodal sentiment analysis,” in Proc. ICME, 2017.[3] A. Anastasopoulos, S. Kumar, and H. Liao, “Neural language modeling with visual features,” in arXiv:1903.02930, 2019.[4] V. Vielzeuf, A. Lechervy, S. Pateux, and F. Jurie, “CentralNet: A multilayer approach for multimodal fusion,” in Proc. ECCV, 2018.[5] B. Zhou, Y. Tian, S. Sukhbaatar, A. Szlam, and R. Fergus, “Simple baseline for visual question answering,” in arXiv:1512.02167, 2015.[6] J.-M. Pe ?rez-Ru ?a, V. Vielzeuf, S. Pateux, M. Baccouche, and F. Jurie, “MFAS: Multimodal fusion architecture search,” in Proc. CVPR, 2019.[7] B. Zoph and Q. Le, “Neural architecture search with reinforcement learning,” in Proc. ICLR, 2017.[8] C. Liu, B. Zoph, M. Neumann, J. Shlens, W. Hua, L.-J. Li, F.-F. Li, A. Yuille, J. Huang, and K. Murphy, “Progressive neural architecture search,” in Proc. ECCV, 2018.[9] J.-M. Pe ?rez-Ru ?a, M. Baccouche, and S. Pateux, “Efficient progressive neural architecture search,” in Proc. BMVC, 2019.[10] X. Yang, P. Molchanov, and J. Kautz, “Multilayer and multimodal fusion of deep neural networks for video classification,” in Proc. ACM MM, 2016.[11] D. Bahdanau, K. Cho, and Y. Bengio, “Neural machine translation by jointly learning to align and translate,” in Proc. ICLR, 2015.[12] A. Graves, G. Wayne, and I. Danihelka, “Neural turing machines,” in arXiv:1410.5401, 2014.[13] Y. Zhu, O. Groth, M. Bernstein, and F.-F. Li, “Visual7W: Grounded question answering in images,” in Proc. CVPR, 2016.[14] K. Xu, J. Ba, R. Kiros, K. Cho, A. Courville, R. Salakhutdinov, R. Zemel, and Y. Bengio, “Show, attend and tell: Neural image caption generation with visual attention,” in Proc. ICML, 2015.[15] K. Shih, S. Singh, and D. Hoiem, “Where to look: Focus regions for visual question answering,” in Proc. CVPR, 2016.[16] Z. Yang, X. He, J. Gao, L. Deng, and A. Smola, “Stacked attention networks for image question answering,” in Proc. CVPR, 2016.[17] H. Xu and K. Saenko, “Ask, attend and answer: Exploring question-guided spatial attention for visual question answering,” in Proc. ECCV, 2016.[18] C. Xiong, S. Merity, and R. Socher, “Dynamic memory networks for visual and textual question answering,” in Proc. ICML, 2016.[19] P. Anderson, X. He, C. Buehler, D. Teney, M. Johnson, S. Gould, and L. Zhang, “Bottom-up and top-down attention for image captioning and visual question answering,” in Proc. CVPR, 2018.[20] P. Lu, H. Li, W. Zhang, J. Wang, and X. Wang, “Co-attending free- form regions and detections with multi-modal multiplicative feature embedding for visual question answering,” in Proc. AAAI, 2018.[21] W. Li, P. Zhang, L. Zhang, Q. Huang, X. He, S. Lyu, and J. Gao, “Object-driven text-to-image synthesis via adversarial training,” in Proc. CVPR, 2019.[22] J. Lu, J. Yang, D. Batra, and D. Parikh, “Hierarchical question-image co-attention for visual question answering,” in Proc. NIPS, 2016.[23] H. Nam, J.-W. Ha, and J. Kim, “Dual attention networks for multimodal reasoning and matching,” in Proc. CVPR, 2017.[24] H. Fan and J. Zhou, “Stacked latent attention for multimodal reasoning,” in Proc. CVPR, 2018.[25] A. Osman and W. Samek, “DRAU: Dual recurrent attention units for visual question answering,” Computer Vision and Image Understanding, vol. 185, pp. 24–30, 2019.[26] I. Schwartz, A. Schwing, and T. Hazan, “High-order attention models for visual question answering,” in Proc. NIPS, 2017.[27] J. Arevalo, T. Solorio, M. Montes-y Go ?mez, and F. Gonza ?lez, “Gated multimodal units for information fusion,” in Proc. ICLR, 2017.[28] J.-H. Kim, S.-W. Lee, D.-H. Kwak, M.-O. Heo, J. Kim, J.-W. Ha, and B.-T. Zhang, “Multimodal residual learning for visual QA,” in Proc. NIPS, 2016.[29] H. Noh, P. Seo, and B. Han, “Image question answering using convolutional neural network with dynamic parameter prediction,” in Proc. CVPR, 2016.[30] J. Tenenbaum and W. Freeman, “Separating style and content with bilinear models,” Neural Computing, vol. 12, pp. 1247–1283, 2000.[31] A. Zadeh, M. Chen, S. Poria, E. Cambria, and L.-P. Morency, “Tensor fusion network for multimodal sentiment analysis,” in Proc. EMNLP, 2017.[32] Y. Gao, O. Beijbom, N. Zhang, and T. Darrell, “Compact bilinear pooling,” in Proc. CVPR, 2016.[33] M. Charikar, K. Chen, and M. Farach-Colton, “Finding frequent items in data streams,” in Proc. ICALP, 2012.[34] N. Pham and R. Pagh, “Fast and scalable polynomial kernels via explicit feature maps,” in Proc. SIGKDD, 2013.[35] A. Fukui, D. Park, D. Yang, A. Rohrbach, T. Darrell, and M. Rohrbach, “Multimodal compact bilinear pooling for visual question answering and visual grounding,” in Proc. EMNLP, 2016.[36] J.-H. Kim, K.-W. On, W. Lim, J. Kim, J.-W. Ha, and B.-T. Zhang, “Hadamard product for low-rank bilinear pooling,” in Proc. ICLR, 2017.[37] Z. Yu, J. Yu, J. Fan, and D. Tao, “Multi-modal factorized bilinear pooling with co-attention learning for visual question answering,” in Proc. ICCV, 2017.[38] Z. Yu, J. Yu, C. Xiang, J. Fan, and D. Tao, “Beyond bilinear: Generalized multimodal factorized high-order pooling for visual question answering,” IEEE Transactions on Neural Networks and Learning Systems, vol. 29, pp. 5947–5959, 2018.[39] L. Tucker, “Some mathematical notes on three-mode factor analy,” Psychometrika, vol. 31, pp. 279–311, 1966.[40] H. Ben-younes, R. Cadene, M. Cord, and N. Thome, “MUTAN: Multimodal tucker fusion for visual question answering,” in Proc. ICCV, 2017.[41] L. Lathauwer, “Decompositions of a higher-order tensor in block termspart II: Definitions and uniqueness,” SIAM Journal on Matrix Analysis and Applications, vol. 30, pp. 1033–1066, 2008.[42] H. Ben-younes, R. Cadene, N. Thome, and M. Cord, “BLOCK: Bilinear superdiagonal fusion for visual question answering and visual relationship detection,” in Proc. AAAI, 2019.[43] Z. Liu, Y. Shen, V. Lakshminarasimhan, P. Liang, A. Zadeh, and L.-P. Morency, “Efficient low-rank multimodal fusion with modality-specific factors,” in Proc. ACL, 2018.[44] A. Fukui, D. Park, D. Yang, A. Rohrbach, T. Darrell, and M. Rohrbach, “Multimodal compact bilinear pooling for visual question answering and visual grounding,” in Proc. EMNLP, 2016.[45] J.-H. Kim, K.-W. On, W. Lim, J. Kim, J.-W. Ha, and B.-T. Zhang, “Hadamard product for low-rank bilinear pooling,” in Proc. ICLR, 2017.[46] Z. Yu, J. Yu, J. Fan, and D. Tao, “Multi-modal factorized bilinear pooling with co-attention learning for visual question answering,” in Proc. ICCV, 2017.[47] L. Tucker, “Some mathematical notes on three-mode factor analy,” Psychometrika, vol. 31, pp. 279–311, 1966.[48] J.-H. Kim, J. Jun, and B.-T. Zhang, “Bilinear attention networks,” in Proc. NeurIPS, 2018.好消息!

小白學視覺知識星球

開始面向外開放啦??????

下載1:OpenCV-Contrib擴展模塊中文版教程

在「小白學視覺」公眾號后臺回復:擴展模塊中文教程,即可下載全網(wǎng)第一份OpenCV擴展模塊教程中文版,涵蓋擴展模塊安裝、SFM算法、立體視覺、目標跟蹤、生物視覺、超分辨率處理等二十多章內(nèi)容。下載2:Python視覺實戰(zhàn)項目52講在「小白學視覺」公眾號后臺回復:Python視覺實戰(zhàn)項目,即可下載包括圖像分割、口罩檢測、車道線檢測、車輛計數(shù)、添加眼線、車牌識別、字符識別、情緒檢測、文本內(nèi)容提取、面部識別等31個視覺實戰(zhàn)項目,助力快速學校計算機視覺。在「小白學視覺」公眾號后臺回復:OpenCV實戰(zhàn)項目20講,即可下載含有20個基于OpenCV實現(xiàn)20個實戰(zhàn)項目,實現(xiàn)OpenCV學習進階。交流群

歡迎加入公眾號讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動駕駛、計算攝影、檢測、分割、識別、醫(yī)學影像、GAN、算法競賽等微信群(以后會逐漸細分),請掃描下面微信號加群,備注:”昵稱+學校/公司+研究方向“,例如:”張三 + 上海交大 + 視覺SLAM“。請按照格式備注,否則不予通過。添加成功后會根據(jù)研究方向邀請進入相關微信群。請勿在群內(nèi)發(fā)送廣告,否則會請出群,謝謝理解~