3D人體姿態(tài)估計(jì)筆記

本文轉(zhuǎn)自|3D視覺(jué)工坊

姿態(tài)估計(jì)

RGB or RGBD 圖像 or 視頻 單目 or 多視角 單人 or 多人 2D or 3D 3D姿態(tài) or 3D形態(tài)

任務(wù)

單人姿態(tài)估計(jì) Benchmark: MPII (2014) 代表作: CPM (CVPR 2016), Hourglass (ECCV 2016) 多人姿態(tài)估計(jì) Benchmark: COCO (2016), CrowdPose (2018) 自底向上: OpenPose (CVPR 2017), Associative Embedding (NIPS 2017) 自頂向下: CPN (CVPR 2018), MSPN (Arxiv 2018), HRNet (CVPR 2019) 人體姿態(tài)跟蹤 Benchmark: PoseTrack (2017) 代表作: Simple Baselines (ECCV 2018)

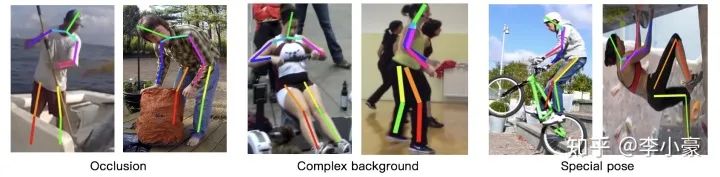

挑戰(zhàn)

遮擋 復(fù)雜背景 特殊姿態(tài)

3D姿態(tài)估計(jì)

問(wèn)題

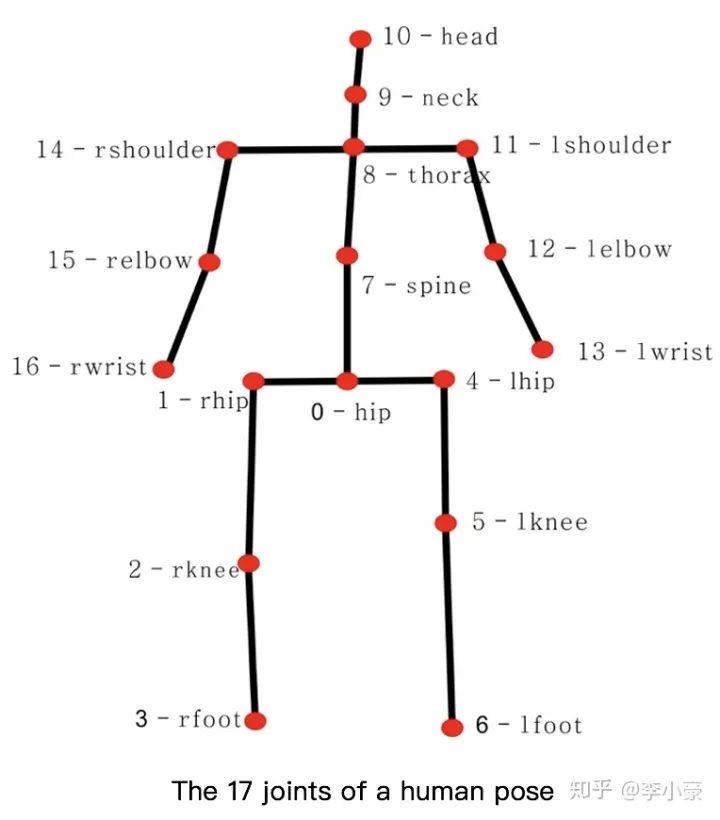

輸入: 包含人體的圖片 輸出: N×3個(gè)人體關(guān)節(jié)點(diǎn)

巨大的3D姿態(tài)空間、自遮擋 單視角2D到3D的映射中固有的深度模糊性、不適定性(一個(gè)2D骨架可以對(duì)應(yīng)多個(gè)3D骨架) 缺少大型的室外數(shù)據(jù)集(主要瓶頸) 缺少特殊姿態(tài)的數(shù)據(jù)集(如摔倒,打滾等) 由于數(shù)據(jù)集是在實(shí)驗(yàn)室環(huán)境下建立的,模型的泛化能力較差 3D姿態(tài)數(shù)據(jù)集是依靠適合室內(nèi)環(huán)境的動(dòng)作捕捉(MOCAP)系統(tǒng)構(gòu)建的。MOCAP系統(tǒng)需要帶有多個(gè)傳感器和緊身衣褲的復(fù)雜裝置,在室外環(huán)境使用是不切實(shí)際的

應(yīng)用

動(dòng)畫(huà),游戲 運(yùn)動(dòng)捕捉系統(tǒng) 行為理解 姿態(tài)估計(jì)可以做為其他算法的輔助環(huán)節(jié)(行人重識(shí)別) 人體姿態(tài)估計(jì)跟人體相關(guān)的其他任務(wù)一起聯(lián)合學(xué)習(xí)(人體解析)

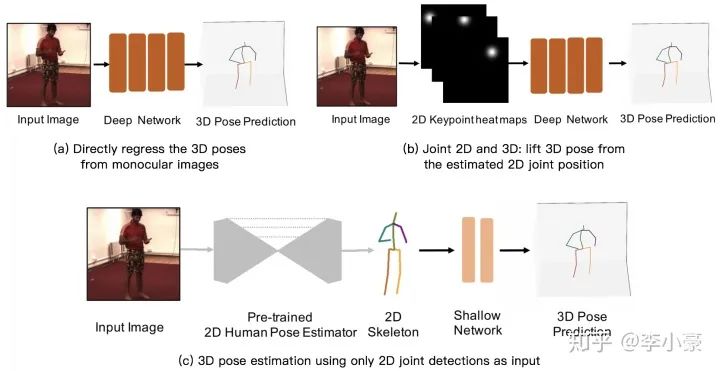

方法

從2D圖片直接暴力回歸得到3D坐標(biāo) 3D Human Pose Estimation from Monocular Images with Deep Convolutional Neural Network (ACCV 2014) Coarse-to-Fine Volumetric Prediction for Single-Image 3D Human Pose (CVPR 2017) 通過(guò)深度學(xué)習(xí)模型建立單目RGB圖像到3D坐標(biāo)的端到端映射,但是對(duì)于單一模型來(lái)說(shuō)需要學(xué)習(xí)的特征太過(guò)復(fù)雜。 先獲取2D信息,然后再“提升”到3D姿態(tài) 聯(lián)合2D,3D共同訓(xùn)練(2D信息通常以heatmap來(lái)表示) Towards 3D Human Pose Estimation in the Wild (ICCV 2017) 3D Hand Shape and Pose Estimation from a Single RGB Image (CVPR 2019) 需要復(fù)雜的網(wǎng)絡(luò)架構(gòu)和充足的訓(xùn)練樣本。 直接用預(yù)訓(xùn)練好的2D姿態(tài)網(wǎng)絡(luò),將得到的2D坐標(biāo)輸入到3D姿態(tài)估計(jì)網(wǎng)絡(luò)中(得益于2D姿態(tài)估計(jì)較為成熟) Simple Yet Effective Baseline (ICCV 2017) 3D human pose estimation in video with temporal convolutions (CVPR 2019) 2D姿態(tài)網(wǎng)絡(luò): Hourglass (ECCV 2016), CPN (CVPR 2018) 優(yōu)點(diǎn) 減少了模型在2D姿態(tài)估計(jì)上的學(xué)習(xí)壓力 網(wǎng)絡(luò)結(jié)構(gòu)簡(jiǎn)單,輕量級(jí) 實(shí)時(shí)性,快速 訓(xùn)練快,占用顯存少 缺點(diǎn) 缺少原始圖像輸入,可能會(huì)丟失一些空間信息 2D姿態(tài)估計(jì)的誤差會(huì)在3D估計(jì)中放大 為什么要先進(jìn)行2D估計(jì)再進(jìn)行3D估計(jì)? 因?yàn)榛跈z測(cè)的模型在2D的關(guān)節(jié)點(diǎn)檢測(cè)中表現(xiàn)更好,而在3D空間下,由于非線(xiàn)性程度高,輸出空間大,所以基于回歸的模型比較流行。

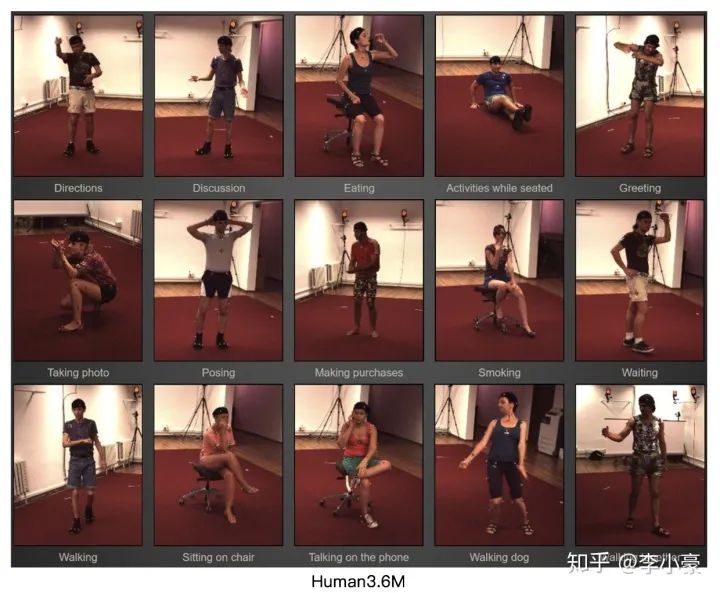

數(shù)據(jù)集

Human3.6M (2014) 3D姿態(tài)估計(jì)最大、最廣泛使用的數(shù)據(jù)集 360萬(wàn)張圖像,4個(gè)不同的視角 (原數(shù)據(jù)集提供的是視頻,50fps) 15個(gè)動(dòng)作: directions, discussion, eating, greeting, phoning, posing, purchases, sitting, sitting down, smoking, taking photo, waiting, walking, walking dog, walking together 11 個(gè)人,但只有7個(gè)人包含3D姿態(tài)標(biāo)簽 訓(xùn)練: S1, S5, S6, S7, S8 (1559752張圖像) 測(cè)試: S9, S11 (550644張圖像) 備注:實(shí)際使用的時(shí)候只用了7個(gè)人的數(shù)據(jù),總共210萬(wàn)張圖像,所以我感覺(jué)應(yīng)該稱(chēng)為Human2.1M。而且從原數(shù)據(jù)的視頻中提取出圖片的時(shí)候,提取出的圖片數(shù)會(huì)比標(biāo)簽要多,提取出來(lái)有2137070張圖像,而標(biāo)簽只有2110396個(gè)。在使用這個(gè)數(shù)據(jù)集的時(shí)候?qū)⒚總€(gè)視頻舍棄尾部幾幀多出來(lái)的圖像使得與標(biāo)簽一一對(duì)應(yīng)。 HumanEva (2010) MPI-INF-3DHP (2017)

評(píng)價(jià)指標(biāo)

Mean Per Joint Position Error (MPJPE): Protocol 1,關(guān)節(jié)點(diǎn)坐標(biāo)誤差的平均值 網(wǎng)絡(luò)輸出的關(guān)節(jié)點(diǎn)坐標(biāo)與ground truth的平均歐式距離(通常轉(zhuǎn)換到相機(jī)坐標(biāo)) Procrustes analysis MPJPE (P-MPJPE): Protocol 2,基于Procrustes分析的MPJPE 先對(duì)網(wǎng)絡(luò)輸出進(jìn)行剛性變換(平移,旋轉(zhuǎn)和縮放)向ground truth對(duì)齊后,再計(jì)算MPJPE Percentage of Correct Key-points (PCK),正確關(guān)鍵點(diǎn)的百分比 如果預(yù)測(cè)關(guān)節(jié)與ground truth之間的距離在特定閾值內(nèi),則檢測(cè)到的關(guān)節(jié)被認(rèn)為是正確的 Percentage of Correct Parts (PCP),正確部件的百分比 如果兩個(gè)預(yù)測(cè)的關(guān)節(jié)位置與ground truth之間的距離小于肢體長(zhǎng)度的一半,則認(rèn)為肢體被檢測(cè)到 備注:做3D的問(wèn)題,需要掌握各個(gè)坐標(biāo)系間的轉(zhuǎn)換,如世界坐標(biāo)、相機(jī)坐標(biāo)、圖像坐標(biāo)等。可參考以下兩篇博文 計(jì)算機(jī)視覺(jué):相機(jī)成像原理:世界坐標(biāo)系、相機(jī)坐標(biāo)系、圖像坐標(biāo)系、像素坐標(biāo)系之間的轉(zhuǎn)換 相機(jī)成像模型——建立過(guò)程(世界坐標(biāo)系,相機(jī)坐標(biāo)系,圖像坐標(biāo)系,圖像像素坐標(biāo)系,四者之間的關(guān)系

監(jiān)督方法

弱監(jiān)督: 不直接用標(biāo)簽,而用其他信息計(jì)算Loss 深度圖、點(diǎn)云、網(wǎng)格、GAN、3D投影到2D 半監(jiān)督 3D投影到2D 自監(jiān)督 全監(jiān)督

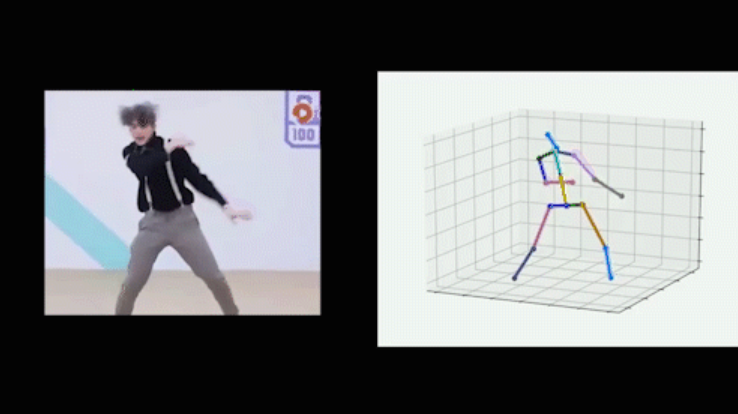

視頻序列的優(yōu)點(diǎn)

當(dāng)前幀有遮擋的時(shí)候,可利用相鄰幀的完整性解決這個(gè)問(wèn)題 由于單獨(dú)預(yù)測(cè)每個(gè)幀的3D姿態(tài)時(shí),每個(gè)幀中的結(jié)果與其他幀無(wú)關(guān),會(huì)導(dǎo)致輸出不連貫,帶有視頻抖動(dòng) 單張圖片包含的深度信息是有限的,網(wǎng)絡(luò)可以從序列中挖掘到更豐富的深度信息 一張2D圖片可以對(duì)應(yīng)無(wú)窮多個(gè)3D姿態(tài),讓模型“多看”同個(gè)視角不同時(shí)間人的圖片,可以減少深度模糊性,縮小3D姿態(tài)的空間范圍

3D形態(tài)估計(jì)

問(wèn)題

3D形態(tài)的表示

網(wǎng)格: 由三角形組成的多邊形網(wǎng)格 深度圖: 每個(gè)像素值代表的是物體到相機(jī)xy平面的距離 體素: 三維空間中的一個(gè)有大小的點(diǎn),一個(gè)小方塊,相當(dāng)于是三維空間中的像素 點(diǎn)云: 某個(gè)坐標(biāo)系下的點(diǎn)的數(shù)據(jù)集。點(diǎn)包含了豐富的信息,包括三維坐標(biāo)xyz、顏色、分類(lèi)值、強(qiáng)度值、時(shí)間等

SMPL(A Skinned Multi-Person Linear Model)

3D Mesh: SMPL 輸入 (82): Shape  + Pose

+ Pose

各個(gè)參數(shù)代表人體哪個(gè)部分?可參考“SMPL模型Shape和Pose參數(shù)” 輸出: Mesh

優(yōu)點(diǎn): 只需要估計(jì)少量的參數(shù)便可得到包含6890個(gè)頂點(diǎn)的高質(zhì)量的人體3D Mesh 3D Pose 可從3D Mesh中回歸得到,其中  為預(yù)先訓(xùn)練好的線(xiàn)性回歸器

為預(yù)先訓(xùn)練好的線(xiàn)性回歸器

2D Pose 可從3D Pose中使用相機(jī)內(nèi)參計(jì)算得到

Reference

人體姿態(tài)估計(jì)的過(guò)去,現(xiàn)在,未來(lái) 重新思考人體姿態(tài)估計(jì) 人體姿態(tài)估計(jì)(Human Pose Estimation)經(jīng)典方法整理 A 2019 guide to Human Pose Estimation with Deep Learning 從DeepNet到HRNet,這有一份深度學(xué)習(xí)“人體姿勢(shì)估計(jì)”全指南 A 2019 guide to 3D Human Pose Estimation Human Pose Estimation 101 3D人體姿態(tài)估計(jì)最新研究2019 3D姿態(tài)估計(jì):語(yǔ)義圖卷積SematicGCN與GAN-RepNet 談?wù)勅S形態(tài)估計(jì) 人體3D姿態(tài)重建與估計(jì) 基于深度學(xué)習(xí)的視覺(jué)三維重建研究總結(jié)

End

End

聲明:部分內(nèi)容來(lái)源于網(wǎng)絡(luò),僅供讀者學(xué)術(shù)交流之目的。文章版權(quán)歸原作者所有。如有不妥,請(qǐng)聯(lián)系刪除。

評(píng)論

圖片

表情