ACCV2020國(guó)際細(xì)粒度網(wǎng)絡(luò)圖像識(shí)別亞軍方案總結(jié)

極市導(dǎo)讀

?作者為ACCV2020細(xì)粒度圖像分類分析競(jìng)賽第二名,本文分享了比賽各階段的準(zhǔn)備以及需要注意的要點(diǎn)和經(jīng)驗(yàn),分享給大家作為參考。?>>加入極市CV技術(shù)交流群,走在計(jì)算機(jī)視覺(jué)的最前沿

細(xì)粒度圖像分類競(jìng)賽分析總結(jié)

大賽官網(wǎng):https://www.cvmart.net/race/9917/base

背景介紹

ACCV大會(huì)(Asian Conference on Computer Vision)是由亞洲計(jì)算機(jī)視覺(jué)聯(lián)合會(huì)舉辦的兩年一次的計(jì)算機(jī)視覺(jué)領(lǐng)域國(guó)際重要會(huì)議。該會(huì)議為研究者、開(kāi)發(fā)者以及參與者提供了一個(gè)重要的論壇,以展示和討論計(jì)算機(jī)視覺(jué)及相關(guān)領(lǐng)域的新問(wèn)題、新方法和新技術(shù)。

ACCV 2020 國(guó)際細(xì)粒度網(wǎng)絡(luò)圖像識(shí)別競(jìng)賽,是由南京理工大學(xué)、英國(guó)愛(ài)丁堡大學(xué)、南京大學(xué)、阿德萊德大學(xué)、日本早稻田大學(xué)等研究機(jī)構(gòu)主辦,極市平臺(tái)提供技術(shù)支持的國(guó)際性賽事。該賽事主要關(guān)注網(wǎng)絡(luò)圖像監(jiān)督條件下的細(xì)粒度級(jí)別圖像識(shí)別問(wèn)題。

官方提供的訓(xùn)練數(shù)據(jù)是55W+的網(wǎng)絡(luò)數(shù)據(jù),其中存在大量的噪聲樣本。對(duì)于計(jì)算資源以及人工成本要求都很高。

成績(jī)

數(shù)據(jù)分析

在競(jìng)賽剛開(kāi)始的時(shí)候,我們對(duì)訓(xùn)練數(shù)據(jù)進(jìn)行了詳細(xì)的分析。我們發(fā)現(xiàn):

訓(xùn)練數(shù)據(jù)集中存在大量噪聲樣本,比如地圖,表格,文本,人物特寫等(noisetype1)。

測(cè)試數(shù)據(jù)集比訓(xùn)練數(shù)據(jù)集干凈很多。

很多動(dòng)物類別的圖片中都會(huì)包含植物,但是絕大多數(shù)的植物類別的圖片中都不包含動(dòng)物。

small animal problem,一些動(dòng)物在圖片中的占比非常小。

這些結(jié)論對(duì)本次競(jìng)賽起到了很大的作用。

比賽中也有通過(guò)數(shù)據(jù)分析一招制勝的例子:[1]?

作者發(fā)現(xiàn)數(shù)據(jù)中存在二義性圖片,比賽數(shù)據(jù)量很小,這些圖對(duì)模型效果影響很大,最后通過(guò)knowledge distillation方式對(duì)數(shù)據(jù)進(jìn)行soft label 處理。個(gè)人理解這種二義性圖片還是能夠給模型提供有用信息的,通過(guò)軟標(biāo)簽的方式能夠減弱他們對(duì)模型訓(xùn)練的影響,讓模型能夠去學(xué)習(xí)更有用的信息。這種方法在大數(shù)據(jù)集上操作起來(lái)時(shí)間成本很高,但是相對(duì)于刪除這些數(shù)據(jù)而言,我理解保留不處理可能更好一些。另外這個(gè)比賽也是大型B榜翻車現(xiàn)場(chǎng),刺激又酸爽。

數(shù)據(jù)清洗

在數(shù)據(jù)處理階段,我們通過(guò)主動(dòng)學(xué)習(xí)的方法刪除了約5000張左右的噪聲數(shù)據(jù)。具體的,我們把測(cè)試集作為正樣本,訓(xùn)練集中的噪聲數(shù)據(jù)作為負(fù)樣本,訓(xùn)練一個(gè)efficientnet-b2二分類網(wǎng)絡(luò),然后在訓(xùn)練集全量數(shù)據(jù)打分。在分?jǐn)?shù)低的圖片中人工挑選噪聲數(shù)據(jù),迭代三次。清洗數(shù)據(jù)真的是枯燥無(wú)味而又非常有效,是對(duì)人的體力耐力的考驗(yàn)。

另外一個(gè)版本的數(shù)據(jù)我們刪除了50000左右的圖片,不過(guò)沒(méi)有人工校驗(yàn),可能包含一部分正確的樣本。這里主要是想制作一個(gè)與google landmark recognization(GLR) 比賽一樣的數(shù)據(jù)環(huán)境,先在clean數(shù)據(jù)訓(xùn)再全量數(shù)據(jù)訓(xùn)練。GLR top solution中有的隊(duì)伍在全量數(shù)據(jù)訓(xùn)練得到了更好的結(jié)果。由于時(shí)間原因我們不可能在兩組數(shù)據(jù)中完成模型的訓(xùn)練,最終選擇相信更多的數(shù)據(jù),沒(méi)有針對(duì)這份數(shù)據(jù)進(jìn)行實(shí)驗(yàn)。

模型

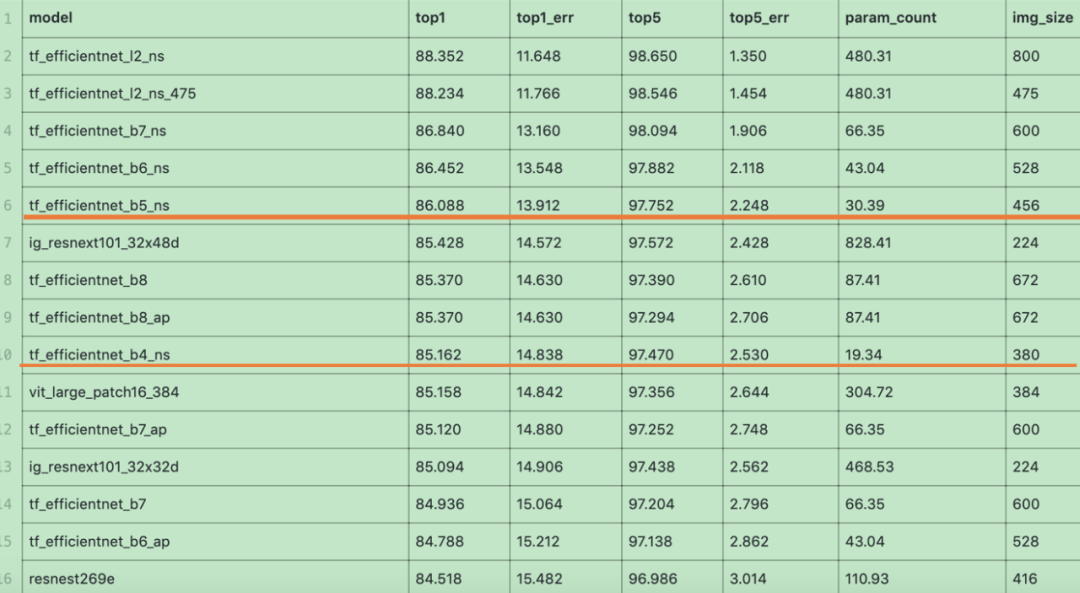

在本次競(jìng)賽中,我們選擇了efficientnet-b4/b5 with noise student pretrained model 作為我們base model, 細(xì)粒度比賽中有人提出ns的預(yù)訓(xùn)練參數(shù)更好[2][3]

timm模型庫(kù)efficient-ns經(jīng)常出現(xiàn)在各大比賽的top solution中,在選模型的時(shí)候直接用的ns weights。另外timm 作者還有一個(gè)關(guān)于efficientdet-pytorch的復(fù)現(xiàn)工作,性能非常給力。

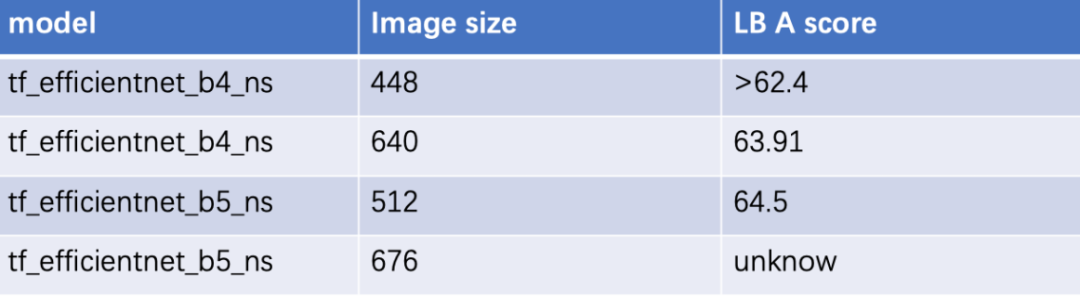

由于訓(xùn)練數(shù)據(jù)和測(cè)試數(shù)據(jù)差異巨大以及對(duì)計(jì)算資源的自信,我們是不可能訓(xùn)練多個(gè)fold的。所以沒(méi)有在本地劃分驗(yàn)證集,使用全部數(shù)據(jù)進(jìn)行模型訓(xùn)練,并通過(guò)A榜 來(lái)判斷模型效果。訓(xùn)練過(guò)程中,我們使用了cut-mix,auto-augment等數(shù)據(jù)增強(qiáng)方式,label smooth在我訓(xùn)過(guò)的大部分?jǐn)?shù)據(jù)上不會(huì)變差,默認(rèn)配置。以及大幅度借鑒imagenet模型訓(xùn)練技巧。我們使用了 very large image-size 來(lái)解決small animal problem。其實(shí)我們也嘗試過(guò)B7,訓(xùn)得太慢兩天后放棄了。關(guān)于focal loss,從來(lái)沒(méi)有在分類模型中提分成功過(guò),而且訓(xùn)練數(shù)據(jù)噪聲那么大,沒(méi)試也沒(méi)在todolist。

其實(shí)圖像尺寸在分類問(wèn)題中很多是越大越好的[2][4],增加分辨率帶來(lái)的性能收益比很多技巧來(lái)的更實(shí)在。但是在公開(kāi)的解決方案中關(guān)于圖像尺寸的說(shuō)明都不是很明確。

我們最優(yōu)的efficientnet-b4 在leadboard A 上取得了63.91%的成績(jī)。在整個(gè)比賽期間,我們沒(méi)有發(fā)現(xiàn)任何的過(guò)擬合現(xiàn)象 before 100 epochs,larger image size,more complex model and more training epochs always get better result。繼續(xù)往后訓(xùn)可能還有提升。

在該賽題中,模型融合帶來(lái)的性能提升非常明顯(細(xì)粒度分類問(wèn)題的特色?)。在融合了4個(gè)模型后,我們?cè)趌eadboard A獲得了67.275的分?jǐn)?shù)。

TopK Strategy

我們發(fā)現(xiàn)測(cè)試集每個(gè)類別的樣本數(shù)量基本相同。至于怎么發(fā)現(xiàn)的也不難。一般來(lái)說(shuō)測(cè)試集分布是均勻的要么和訓(xùn)練集差不多,但是這個(gè)賽題是均勻分布的概率更大,再加上100000/5000=20基本就知道了,最后在老測(cè)試集驗(yàn)證確實(shí)是這樣。

知道了這條規(guī)律后,我們統(tǒng)計(jì)模型預(yù)測(cè)到各個(gè)類別的圖片數(shù)量,并用top1分?jǐn)?shù)排序。從圖片數(shù)量最多的類別(該類別圖片數(shù)要超過(guò)20的),這個(gè)類別top1分?jǐn)?shù)最低的圖片(排在20之后的)開(kāi)始,將它移到top2的類別,如果top2類別圖像數(shù)量已經(jīng)超過(guò)20張,那么就移到top3... 這里我也做了不少的實(shí)驗(yàn),包括這個(gè)20改成一個(gè)大一點(diǎn)的數(shù),包括每個(gè)類別從所有的圖片中抽20張。但是都沒(méi)有與直接一次簡(jiǎn)單的移動(dòng)比顯著提分。

其實(shí)類似的想法在很多其他的比賽中都有用到。[3][5]

Plabel

大多數(shù)情況下偽標(biāo)簽是穩(wěn)定上分的,有些solution 會(huì)采取多輪偽標(biāo)簽上分。[6][7]

長(zhǎng)尾分布

我沒(méi)有試過(guò)bbn,但是常見(jiàn)的處理訓(xùn)練數(shù)據(jù)長(zhǎng)尾分布的方法是2stage 訓(xùn)練[3][4],我們覺(jué)得這次比賽的數(shù)據(jù)分布還算好,沒(méi)有進(jìn)行額外處理。

END

以上是我認(rèn)為比較有用的東西。最后,我只是個(gè)小菜雞,但是很多時(shí)候自己動(dòng)手可能學(xué)到的更多,再說(shuō)別人寫的東西也不一定對(duì)。如果不敢用'年'做單位去學(xué)習(xí)長(zhǎng)進(jìn),我們又憑什么去祈求回報(bào)。

[1]https://www.kaggle.com/c/plant-pathology-2020-fgvc7/discussion/154056

[2] https://www.kaggle.com/c/plant-pathology-2020-fgvc7/discussion/154045

[3] https://www.kaggle.com/c/herbarium-2020-fgvc7/discussion/154351

[4] https://www.kaggle.com/c/landmark-recognition-2020/discussion/187757

[5] https://www.kaggle.com/c/herbarium-2020-fgvc7/discussion/154186

[6] https://www.kaggle.com/c/plant-pathology-2020-fgvc7/discussion/155929

[7] https://www.kaggle.com/c/global-wheat-detection/discussion/172418

推薦閱讀