注意力機制

點擊上方“小白學(xué)視覺”,選擇加"星標"或“置頂”

重磅干貨,第一時間送達

注意力機制潛在的是一個很有用的方法,本期我們來了解一下注意力機制背后的原理的和方法吧。

原文是英文來自于 https://blog.heuritech.com/2016/01/20/attention-mechanism/

隨著深度學(xué)習(xí)和人工智能的發(fā)展,許多研究人員對神經(jīng)網(wǎng)絡(luò)中的“注意力機制”感興趣。本文旨在對深度學(xué)習(xí)注意力機制的內(nèi)容進行高層次的解釋,并且詳細說明計算注意力的一些技術(shù)步驟。如果您需要更多的技術(shù)細節(jié),請參考英文,特別是Cho等人最近的綜述[3]。不幸的是,這些模型并不總是直接就能憑借自己實現(xiàn),而且到目前為止只有一些開源代碼發(fā)布了出來。

神經(jīng)科學(xué)和計算神經(jīng)科學(xué)[1,2]已經(jīng)廣泛研究了涉及注意力的神經(jīng)過程[1,2]。特別是視覺注意力機制:許多動物關(guān)注其視覺輸入的特定部分以計算適當?shù)姆磻?yīng)。這個原則對神經(jīng)計算有很大的影響,因為我們需要選擇最相關(guān)的信息,而不是使用所有可用的信息。在輸入中,很大一部分與計算神經(jīng)反應(yīng)無關(guān)。

類似的想法 :“專注于輸入的特定部分 ” 已經(jīng)應(yīng)用于深度學(xué)習(xí)中,用于語音識別,翻譯,推理和對象的視覺識別。

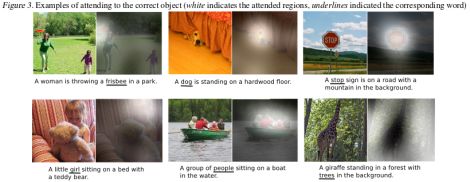

讓我們舉一個例子來解釋注意機制。我們想要實現(xiàn)的任務(wù)是圖像標注:我們想要為給定圖像生成字幕。

“經(jīng)典”圖像字幕系統(tǒng)將使用預(yù)先訓(xùn)練的卷積神經(jīng)網(wǎng)絡(luò)對圖像進行編碼,該網(wǎng)絡(luò)將產(chǎn)生隱藏狀態(tài)h。然后,它將通過使用遞歸神經(jīng)網(wǎng)絡(luò)(RNN)解碼該隱藏狀態(tài),并遞歸地生成字幕的每個字。這種方法已經(jīng)被幾個小組應(yīng)用,包括[11](見下圖):

這種方法的問題在于,當模型試圖生成標題的下一個單詞時,該單詞通常只描述圖像的一部分。使用圖像h的整個表示來調(diào)節(jié)每個單詞的生成不能有效地為圖像的不同部分產(chǎn)生不同的單詞。這正是注意機制有用的地方。

利用注意力機制,圖像首先被分成n個部分,并且我們使用每個部分h_1,...,h_n的卷積神經(jīng)網(wǎng)絡(luò)(CNN)表示來計算。當RNN生成新單詞時,注意力機制關(guān)注于圖像的相關(guān)部分,因此解碼器僅使用圖像的特定部分。

在下圖(上排)中,我們可以看到標題的每個單詞用于生成圖像的哪個部分(白色)。

我們現(xiàn)在將在解釋注意力模型的一般工作原理。對注意力模型應(yīng)用的綜述文章[3] 詳述了基于注意力的編碼器 - 解碼器網(wǎng)絡(luò)的實現(xiàn),需要更多細節(jié)知識的可以參考。

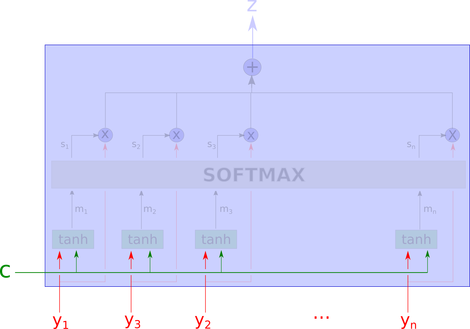

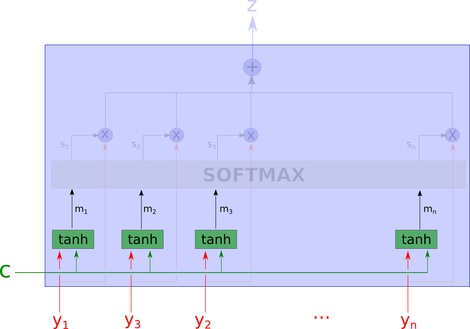

注意力機制的細致解釋:注意力模型是一種采用n個參數(shù)y_1,...,y_n(在前面的例子中,y_i將是h_i)和上下文c的方法。它返回一個矢量z,它應(yīng)該是y_i的“摘要”,側(cè)重于與上下文c相關(guān)的信息。更正式地,它返回y_i的加權(quán)算術(shù)平均值,并且根據(jù)給定上下文c的每個y_i的相關(guān)性來選擇權(quán)重。

在前面給出的例子中,上下文是生成句子的開頭,y_i是圖像部分的表示(h_i),輸出是過濾圖像的表示,過濾器放置了焦點。當前生成的單詞的有趣部分。

注意力模型的一個有趣特征是算術(shù)平均值的權(quán)重是可訪問的并且可以繪制。這正是我們之前顯示的數(shù)字,如果此圖像的重量很高,則像素更白。

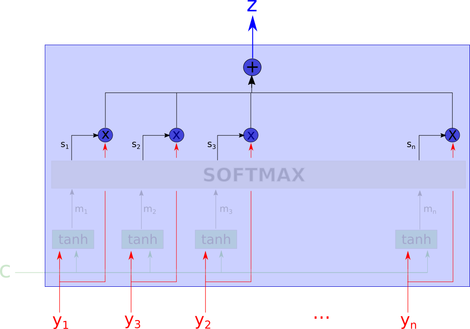

但這個黑匣子到底在做什么呢?整個注意力模型的數(shù)字將是這樣的:

這個網(wǎng)絡(luò)似乎很復(fù)雜,但我們將逐步解釋它。

首先,我們認識到輸入。c是上下文,y_i是我們正在查看的“數(shù)據(jù)的一部分”。

在下一步,網(wǎng)絡(luò)使用tanh層計算m_1,... m_n。這意味著我們計算y_i和c的值的“聚合”。這里一個重要的注意事項是,每個m_i的計算都沒有查看j 不等于 i的其他y_j。它們是獨立計算的。

然后我們將m_1, m_2,..m_n 傳遞到后面一層,計算softmax, softmax通常用于分類器的最后一層設(shè)置。

這里,s_i是在學(xué)習(xí)方向上投影的m_i的softmax。因此,根據(jù)上下文,softmax可以被認為是變量的“相關(guān)性”的最大值。

輸出z是所有y_i的加權(quán)算術(shù)平均值,其中權(quán)重表示根據(jù)上下文c的每個變量的相關(guān)性。

請注意以上我們實現(xiàn)的是“soft-attention”, 它是一種完全可區(qū)分的確定性機制,可插入現(xiàn)有系統(tǒng),并且梯度通過注意機制傳播,同時它們通過網(wǎng)絡(luò)的其余部分傳播。

回到圖像標注:我們可以識別出用于圖像字幕的“經(jīng)典”模型的圖形,但是有了一層新的注意力模型。當我們想要預(yù)測標題的新單詞時會發(fā)生什么?如果我們預(yù)測了i個單詞,LSTM的隱藏狀態(tài)是h_i。我們使用h_i作為上下文選擇圖像的“相關(guān)”部分。然后,注意模型z_i的輸出被用作LSTM的輸入,該輸出是被過濾的圖像的表示,其僅保留圖像的相關(guān)部分。然后,LSTM預(yù)測一個新單詞,并返回一個新的隱藏狀態(tài)h_ {i + 1}。

沒有RNN的Attention:到目前為止,我們僅在編碼器 - 解碼器框架(即具有RNN)中描述了注意力模型。但是,當輸入順序無關(guān)緊要時,可以考慮獨立的隱藏狀態(tài)h_j。例如在Raffel等[10]中就是這種情況,其中注意力模型是完全前饋的。

交流群

歡迎加入公眾號讀者群一起和同行交流,目前有SLAM、三維視覺、傳感器、自動駕駛、計算攝影、檢測、分割、識別、醫(yī)學(xué)影像、GAN、算法競賽等微信群(以后會逐漸細分),請掃描下面微信號加群,備注:”昵稱+學(xué)校/公司+研究方向“,例如:”張三 + 上海交大 + 視覺SLAM“。請按照格式備注,否則不予通過。添加成功后會根據(jù)研究方向邀請進入相關(guān)微信群。請勿在群內(nèi)發(fā)送廣告,否則會請出群,謝謝理解~