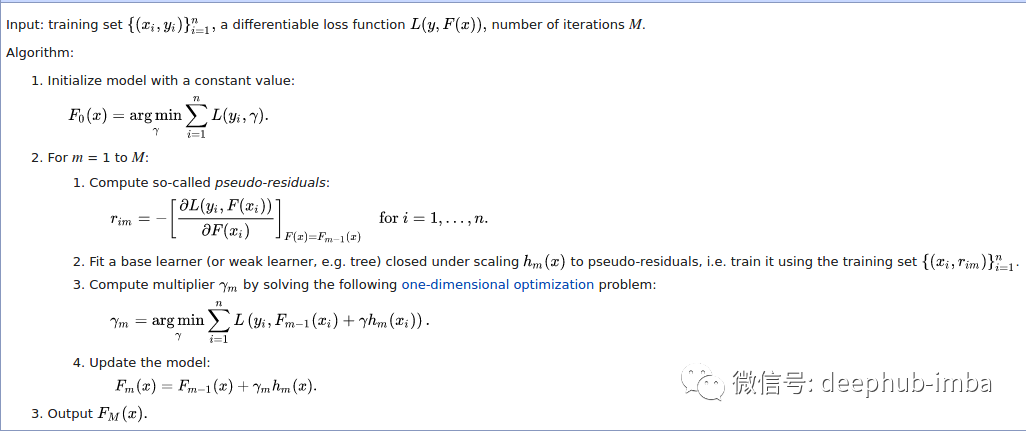

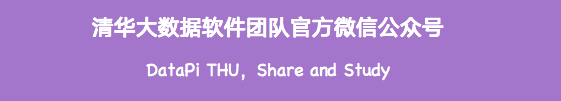

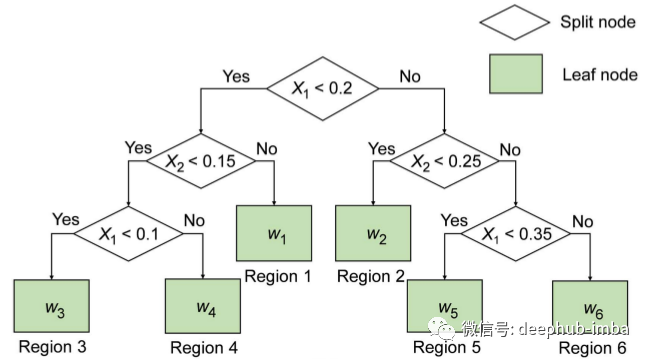

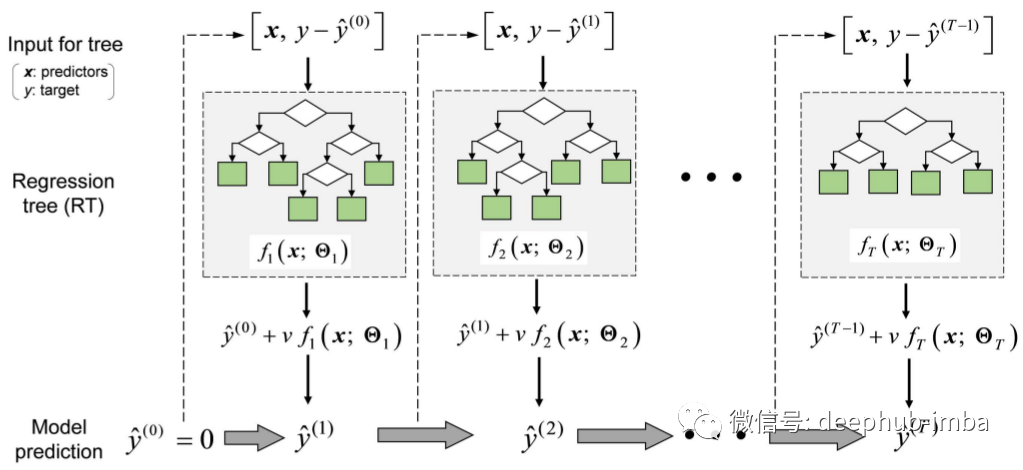

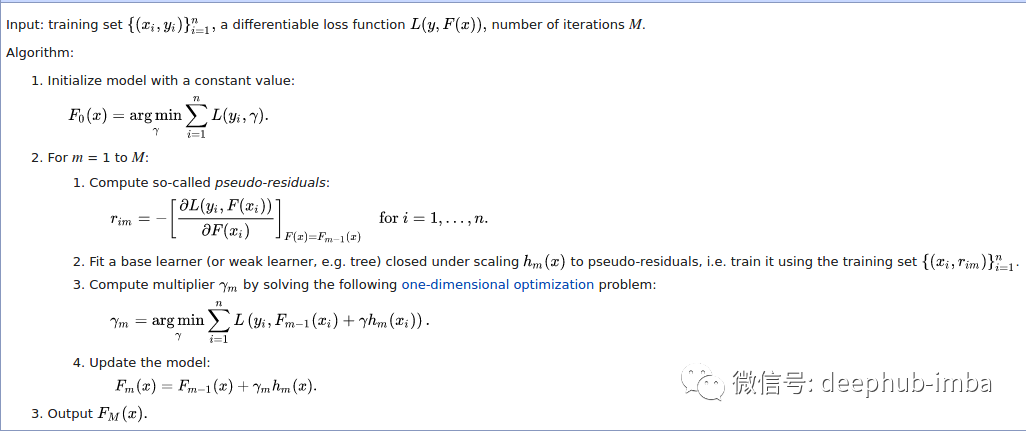

基于梯度提升(Boosting )的回歸樹簡介

來源:DeepHub IMBA 本文約500字,建議閱讀5分鐘

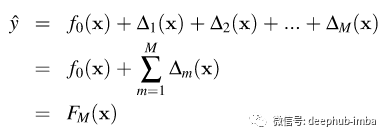

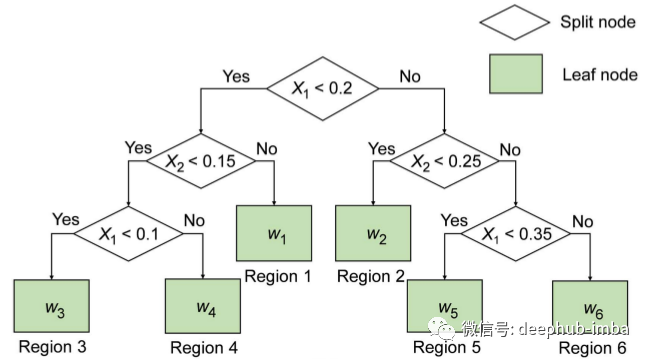

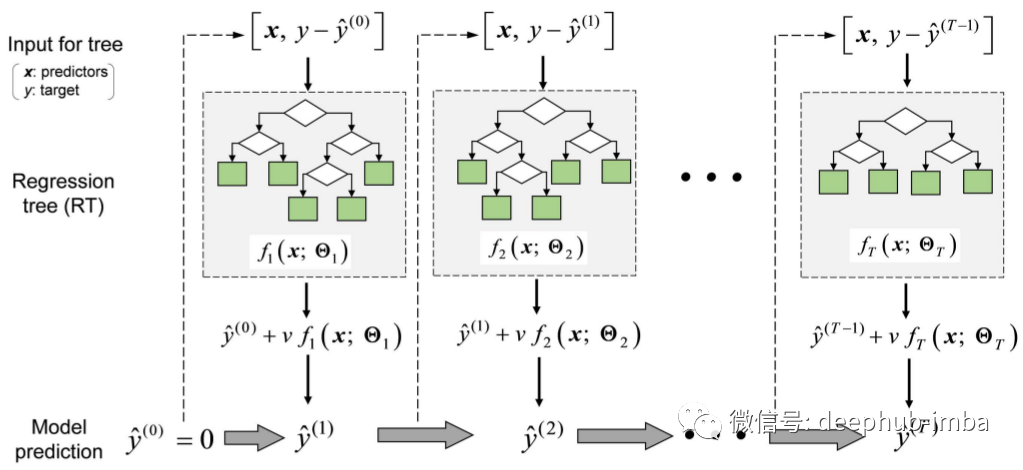

Boosting 是一種松散的策略,它將多個簡單模型組合成一個復合模型。

評論

圖片

表情

<b id="afajh"><abbr id="afajh"></abbr></b>

下載APP

下載APP

來源:DeepHub IMBA 本文約500字,建議閱讀5分鐘

Boosting 是一種松散的策略,它將多個簡單模型組合成一個復合模型。

<b id="afajh"><abbr id="afajh"></abbr></b>