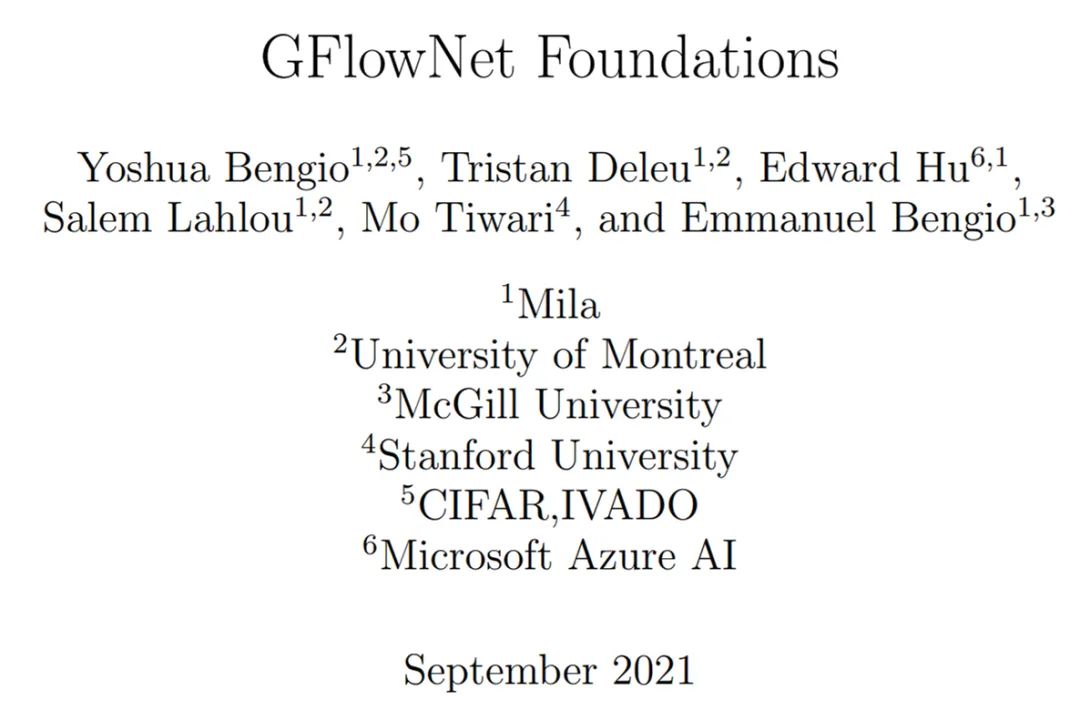

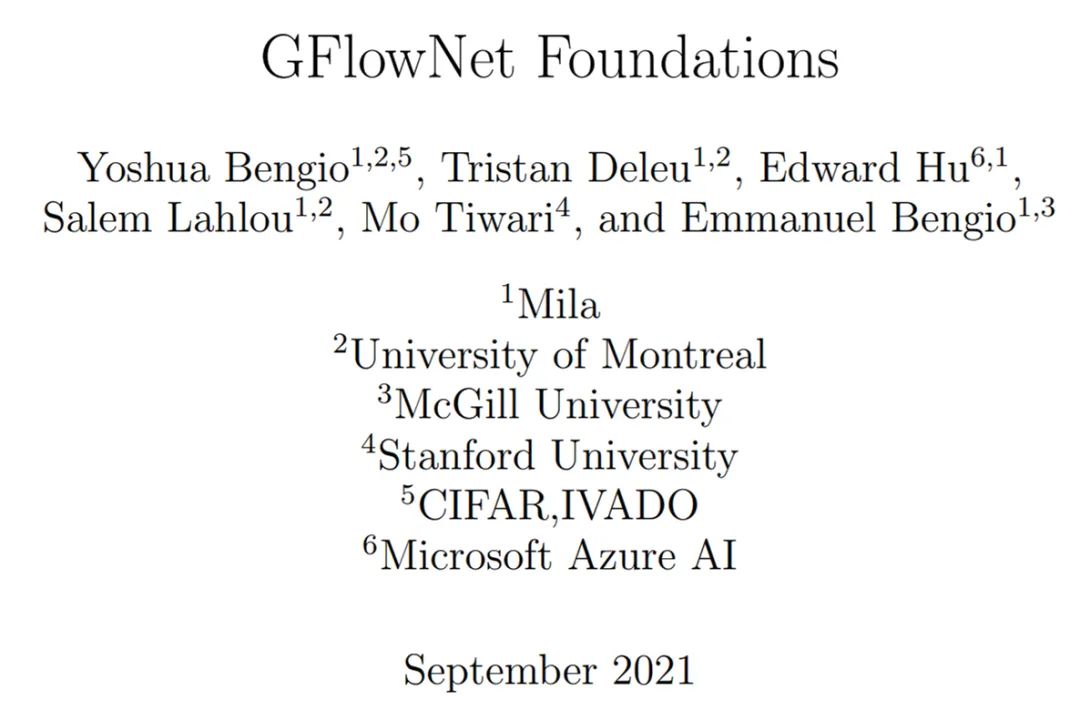

70頁論文,圖靈獎得主Yoshua Bengio一作:「生成流網(wǎng)絡」拓展深度學習領(lǐng)域

日期?:?2021年11月30日?? ? ??

正文共?:2939字

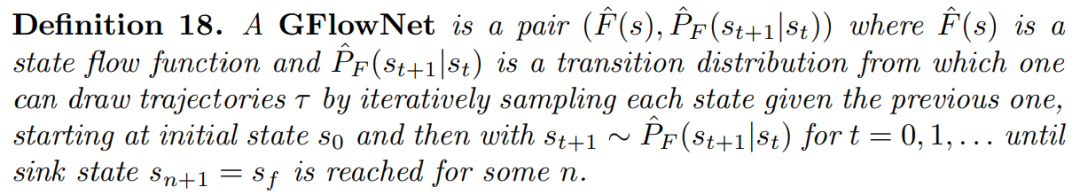

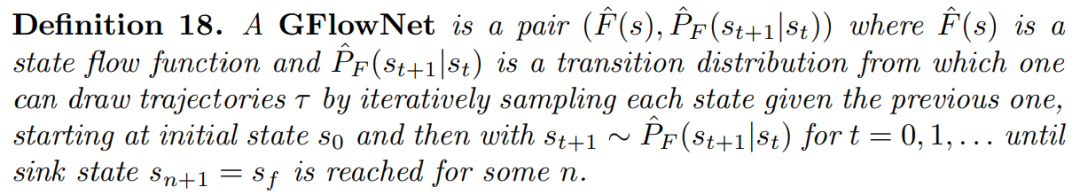

GFlowNet 會成為新的深度學習技術(shù)嗎?

—?THE END —

評論

圖片

表情

<b id="afajh"><abbr id="afajh"></abbr></b>

下載APP

下載APP日期?:?2021年11月30日?? ? ??

正文共?:2939字

GFlowNet 會成為新的深度學習技術(shù)嗎?

—?THE END —

<b id="afajh"><abbr id="afajh"></abbr></b>